笔记整理:和东顺,天津大学硕士,研究方向为软件缺陷分析

论文链接:https://aclanthology.org/2024.acl-long.558/

发表会议:ACL 2024

1. 动机

虽然大语言模型(LLMs)已经在自然语言理解和生成任务中取得了显著的成绩,但是它们依然存在一些关键性的限制,包括但不限于以下几点:

(1)难以融合新知识:现有的LLMs在处理新知识时常常遇到困难,特别是在需要将新知识与现有知识进行综合分析的情况下。

(2)幻觉(Hallucinations):在生成文本时,LLMs可能会产生与上下文不符或事实不符的信息,这是由于模型缺乏对输入信息的有效验证机制。

(3)解释推理过程的能力有限:当LLMs生成答案或结论时,往往难以清晰地表达它们是如何从给定的信息中得出这些结论的,即缺乏透明度。

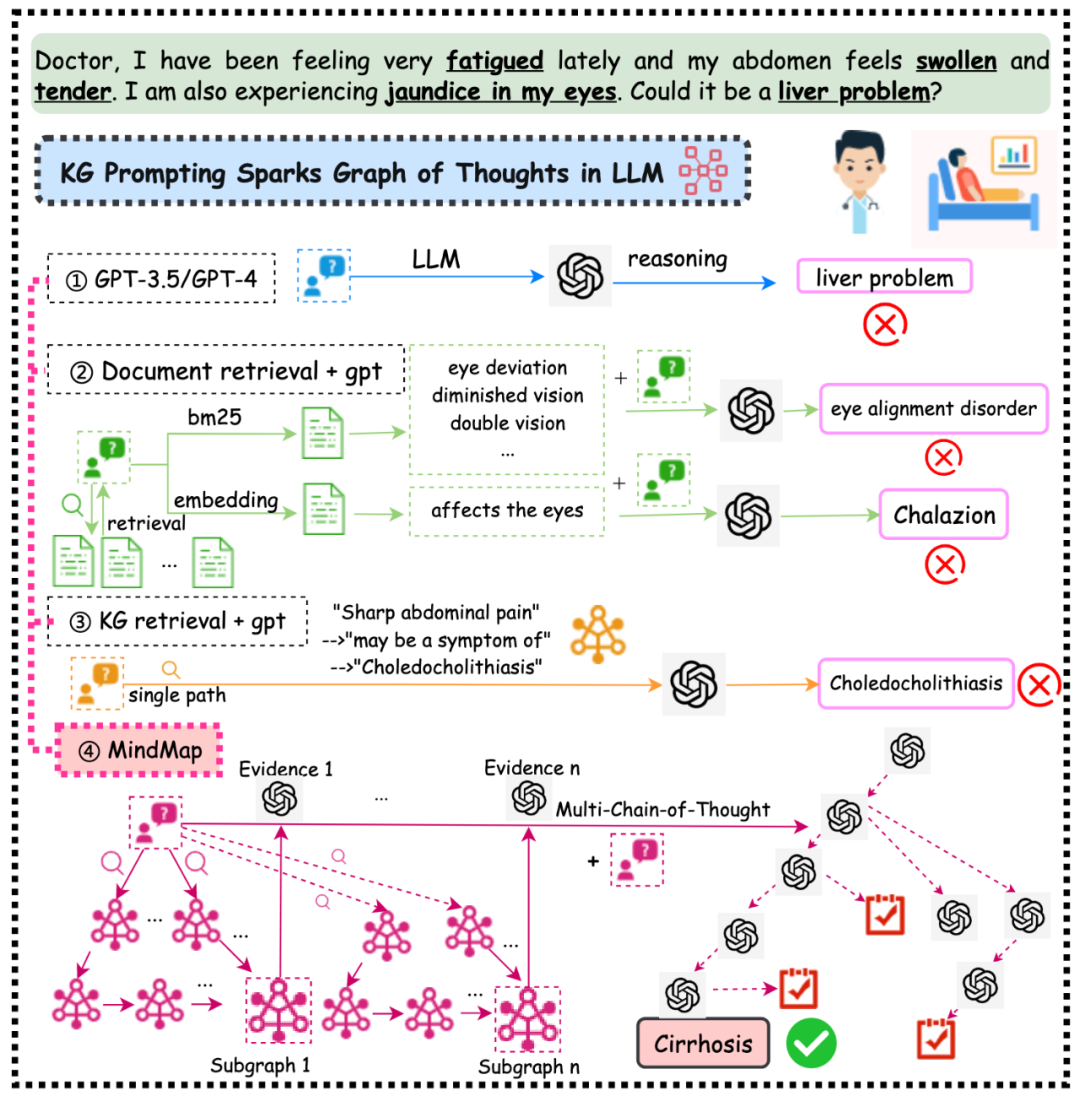

为了解决这些问题,本文提出了名为MindMap的方法。MindMap是一个创新的提示(Prompting)管道,它利用了知识图谱(Knowledge Graphs, KGs)来增强LLMs的推理能力和透明度。通过这种方法,MindMap不仅能让LLMs理解KGs的输入,还能让模型在隐性知识与外部知识的组合基础上进行推理。更重要的是,MindMap能够揭示LLMs的思维导图,这实际上反映了模型基于知识本体的推理路径。

图1: 本文方法与其他提示基线比较:纯LLM、文档检索+LLM和KG检索+LLM

2. 贡献

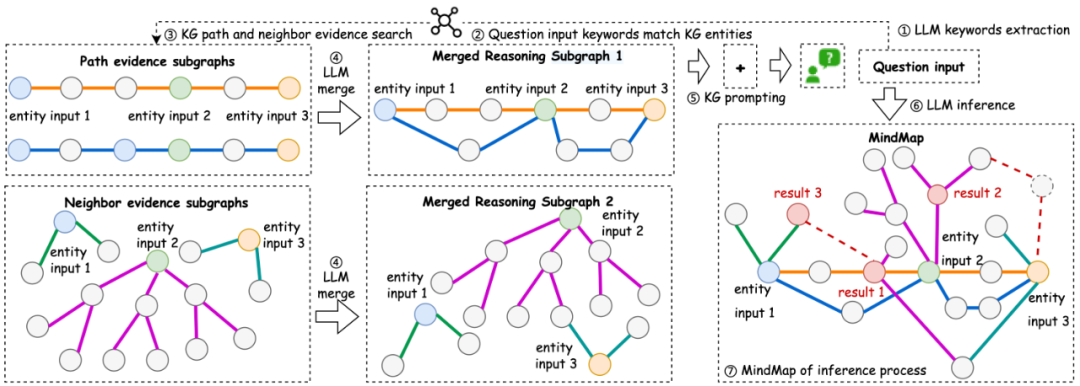

本文建立了一种即插即用的提示方法MindMap,能让 LLM 理解图输入,从而构建自己的思维导图,支持基于证据的推理生成。该框架的概念演示图如图2所示:

图2:证据查询子图、合并推理子图和思维导图的概念演示。实体输入 Vq 可从输入中识别。相同颜色的线和圆表示它们相互对应。思维导图框中的红色虚线表示基于 LLM 知识的增强操作

具体而言,MindMap可以激发LLM的思维图:

(1)整合从KGs中检索到的事实和LLM的隐含知识;

(2)发现输入KGs中的新模式;

(3)对思维图进行推理以产生最终输出。

本文在三个数据集上进行了实验,结果表明 MindMap 的性能远远超过了一系列提示方法。这项工作强调了 LLM 如何学会与 KG 进行协同推理。通过整合隐式和显式知识,LLM可以实现透明、可靠的推理,并适应额外KG信息的不同正确性水平。

3. 方法

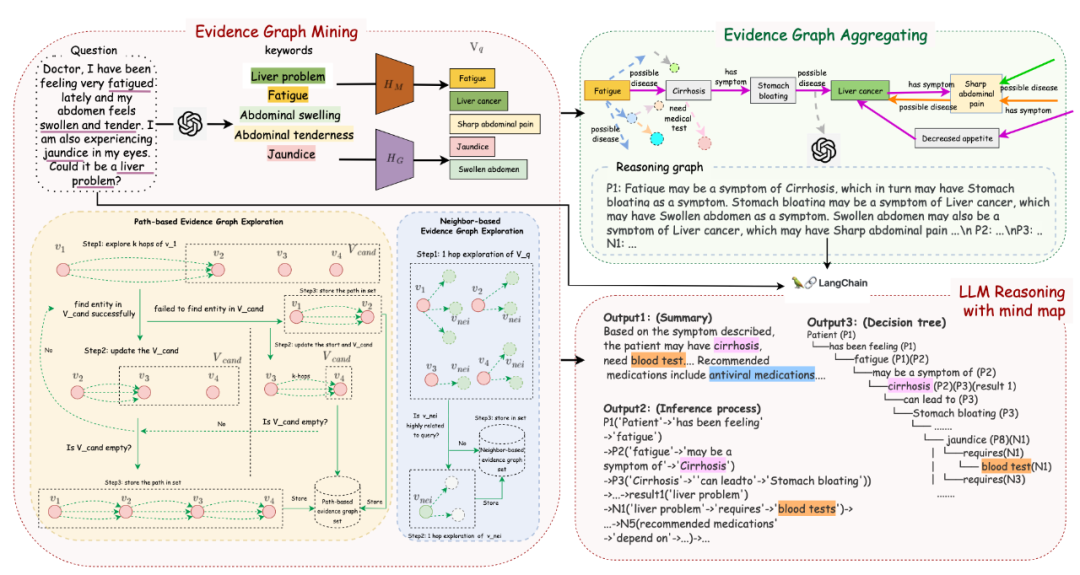

MindMap 的框架如图3所示:

图3: MindMap框架。左侧部分展示了证据图挖掘的各个组成部分,右侧部分展示了证据图聚合和使用思维导图的 LLM 推理

3.1 证据图挖掘

从外部 KG 发现相关证据子图 Gq 主要分为两个阶段。

(1)实体识别

首先,使用大语言模型(LLMs)来识别问题(Query)中的关键实体。这一过程通过构建一个包含问题分析、模板短语以及两个例子的提示来实现。随后,使用BERT相似度来匹配这些实体和关键词。具体来说,对LLMs抽取的所有关键词实体和外部知识图谱中的所有实体进行编码,形成密集嵌入向量,然后计算这些向量之间的余弦相似度矩阵。

(2)证据子图构建

证据子图构建的目标是基于提取的实体构建证据子图。构建证据子图的过程可以分为两部分:

基于路径的探索:从选定的节点出发,在知识图谱中追踪最多k步的中间路径,形成路径片段。这一过程持续进行,直到所有的片段都连接起来,形成一系列的子图,存储在Gpath中。

基于邻居的探索:通过扩展每个节点到其邻居节点的距离为1步,增加关系三元组到Gnei中。这种方法将额外的相关证据纳入到证据子图中

为了管理和维护信息量,避免过载并保持多样性,通过聚类和采样方法对基于路径和基于邻居的子图进行修剪。最终形成的证据图保留了最优信息的同时保证了多样性。

3.2 证据图汇总

在这一阶段,LLM 被指示将不同的证据子图整合为统一的推理图。该推理图在完成后将作为步骤 III 的外部增强图输入,提供所有证据子图的整体视角,以增强输出生成过程。为了生成最终的附加知识子图输入,首先从上一部分中提取了至少 k 个基于路径的证据子图和 k 个基于邻居的证据子图,每个子图都代表了查询实体之间可能存在的联系。然后,将每个子图格式化为实体链,并分配一个序列号。接下来,LLMs被提示去理解和合并这些检索出的证据子图,以构建推理图。

3.3 基于思维导图进行LLM推理

在这一阶段,LLMs被指导去融合已经构建好的推理图以及它们的隐性知识。这意味着LLMs需要将从外部知识图谱中获取的信息与自己内部的已有知识相结合。随后,LLMs需要基于上述整合后的知识来生成最终的答案。这一阶段还包括构建一个思维导图,该导图揭示了LLMs的推理路径。

4. 实验

4.1 实验设置

本文评估了MindMap在三个医学问答数据集的复杂问题解答任务中对外部知识图谱的利用情况:GenMedGPT-5k、CMCQA 和 ExplainCPE。这些数据集分别涵盖了医患对话、多轮临床对话和中国国家执业药师考试的选择题。为了支持知识图谱增强方法,本文构建了两个知识图谱(EMCKG 和 CMCKG),其中包含与医学概念相关的实体和关系。ExplainCPE数据集利用知识不匹配的CMCKG来评估错误检索知识对模型性能的影响。本文将MindMap整合隐性知识和显性知识的能力与各种基线进行了比较,包括GPT-3.5和GPT-4,以及使用树形结构进行推理的思维树方法(TOT)。此外,本文还考虑了三种检索增强基线:BM25 retriever、Text Embedding retriever 和 KG retriever。这些基线利用不同的证据检索方法和来源,以 gpt-3.5-turbo-0613 作为所有基于检索方法的骨干。

4.2 医疗问答

使用 GenMedGPT-5K 测试了 LLM 如何处理医疗领域的问题解答,其中 LLM 需要回答疾病诊断、药物推荐和测试推荐等问题。

(1)评估指标

使用BERTScore和 GPT-4 Rating进行定量评估。BERTScore 衡量生成答案与参考答案之间的语义相似性。GPT4 用于:(1)根据基本事实对答案质量进行排序;(2)根据四个标准对答案对进行比较:答案多样性和完整性、总体事实正确性、疾病诊断正确性和药物推荐正确性。此外,还引入了一种新的幻觉量化指标,用于估算生成的答案与事实的偏离程度。为了计算该指标,首先使用步骤 I 生成的问题-额外实体数据,训练基于 mT5-large 的关键词提取模型(NER-MT5)。然后将 MindMap 的输出、其他基线和标签输入 NER-MT5 模型,得到每个答案的关键词列表。最后将关键词用逗号连接起来,作为 ner-sentences,并计算不同输出的 ner-sentences 之间的 tfidf 相似度得分。得分越低,说明答案中的幻觉越多。

(2)结果

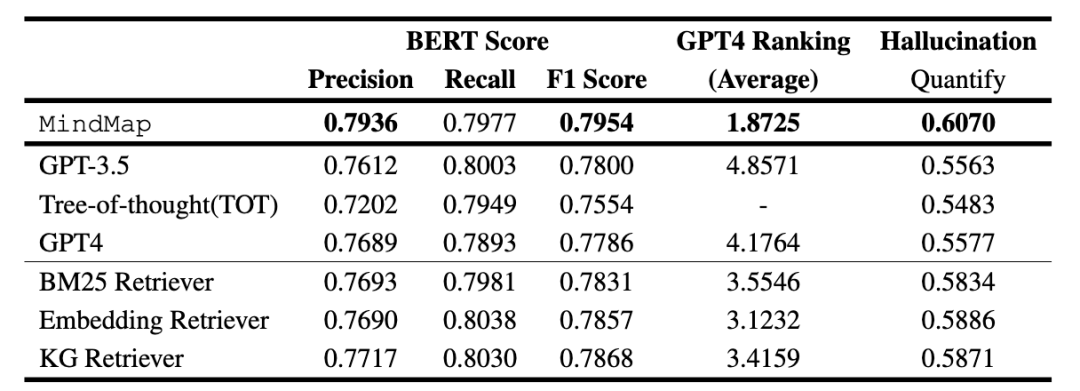

表1根据 BERTScore、GPT-4 排名得分和幻觉量化得分对各种方法进行了评估。虽然 BERTScore 在各种方法中显示出相似的结果,但 MindMap 稍有进步,这可能是由于医学回答中的共同基调。不过,对于医学问题来说,全面的领域知识至关重要,而 BERTScore 并不能很好地捕捉到这一点。GPT-4排名得分和幻觉量化显示,MindMap明显优于其他方法,其平均GPT-4排名为1.8725,幻觉得分较低。这突出表明,与GPT3.5和GPT-4等基线模型相比,MindMap有能力生成有证据基础、可信且准确的答案,而GPT-4等基线模型由于依赖于内隐知识,可能会产生不正确的答案。此外,表 2 显示 MindMap 始终优于其他方法,强调了整合外部知识以减少 LLM 幻觉并提供准确答案的价值。

表1: GenMedGPT-5k 所有方法的 BERTScore 和 GPT4 排名

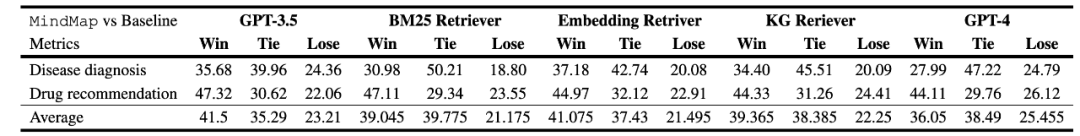

表 2:在 GenMedGPT-5k 上,GPT-4 对 MindMap 与基线在多样性和完整性得分(%)、事实总匹配得分(%)和疾病诊断(%)方面的胜率进行了配对比较

4.3 长对话问答

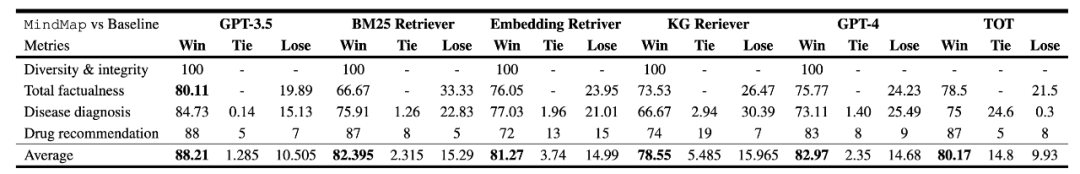

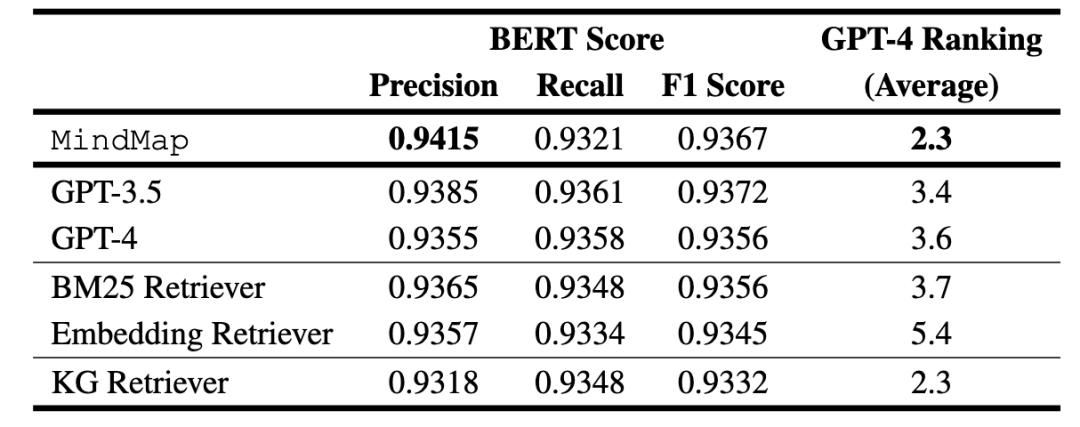

在以需要复杂推理的冗长对话为特点的CMCQA数据集上进行的实验中,表3显示,尽管与KG Retriever类似,但MindMap的排名始终优于大多数基线。此外,在表4中,根据GPT-4判断,MindMap在成对胜率方面一直优于基线。尽管与GenMedGPT-5K相比,由于知识图谱(KG)不足以涵盖CMCQA问题的所有必要事实,MindMap的性能差距有所缩小,但它仍然超越了包括KG Retriever在内的所有基于检索的方法。这表明以前基于检索的方法可能会过度依赖检索到的外部知识,从而影响语言模型(LLM)利用其内隐知识把握复杂逻辑和对话细微差别的能力。相反,MindMap 在图推理中同时利用了外部知识和内隐知识,从而得到了更准确的答案。

表 3:所有方法在 CMCQA 数据集上的 BERTScore 和 GPT-4 排名

表 4:GPT-4对MindMap在CMCQA疾病诊断和药物推荐方面的胜率与基线的成对比较

4.4 从KG生成不匹配的知识

在解决MindMap对KG事实正确性的稳健性问题时,利用第二个数据集--ExplainPE--中使用的相同的KG数据集。因此,检索到的知识可能会出现冗余或缺乏准确信息的情况。这一点尤为重要,因为它反映了生产中的一种常见情况,即 LLM 经常需要将其内隐知识和从外部来源获取的知识合并在一起生成答案。

(1)评估指标

根据生成选择的准确性和解释的质量对所有方法进行评估。为了评估解释质量,使用 BERTScore 和 GPT-4 排名。

(2)结果

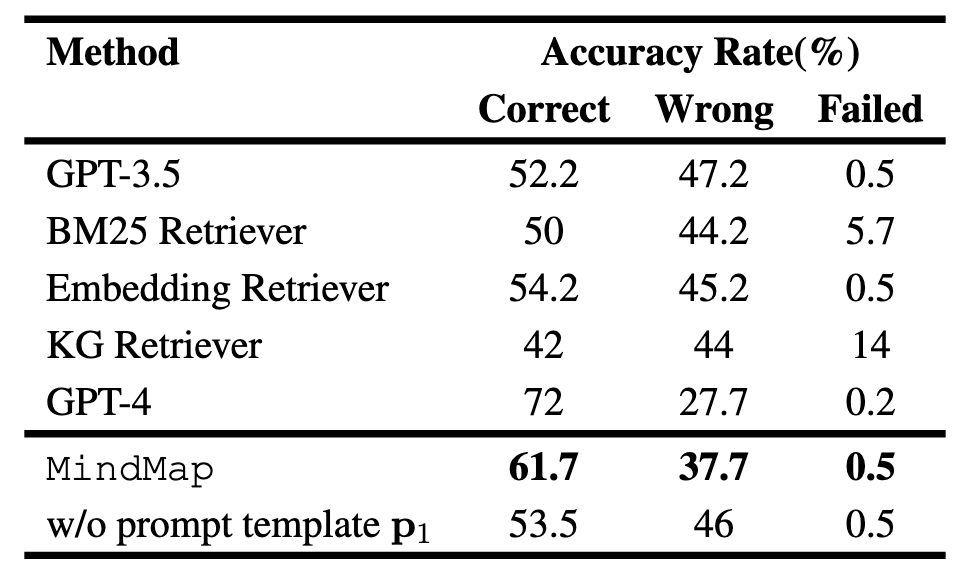

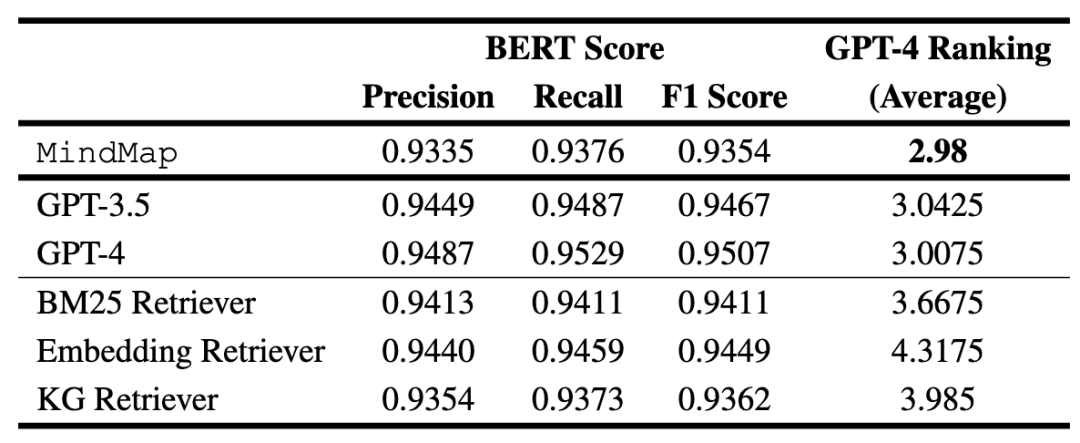

在表 5 中,与各种基线相比, MindMap显示出更高的准确率,这肯定了它比文档检索提示技术更有效。有趣的是,直接将检索到的知识纳入提示中有时会降低答案质量,KG Retriever 和 BM25 Retriever 的表现就不如普通的 GPT-3.5 模型。造成这种差异的原因是外部知识不匹配,导致语言模型(LLM)受到误导。该模型倾向于依赖检索到的知识,如果不准确,LLM 可能会产生错误。指令提示的消融分析显示,提示LLM "结合你已有的知识"使成绩提高了8.2%。此外,表6突出显示了MindMap为答案生成理由的能力,在GPT-4中获得了2.98的排名。

表 5:ExplainCPE 的准确率得分

表 6:MindMap 与基线在 ExplainCPE 数据集中的 BERTScore 和 GPT-4 偏好排序的定量比较

4.5 消融研究

将MindMap与两种变体进行了比较:纯邻居和纯路径。纯邻接法侧重于基于邻接的证据探索,而纯路径法侧重于基于路径的证据探索。尽管使用了额外的标记,但与纯邻居和纯路径方法相比,MindMap 在幻觉量化方面仍有显著改进。这凸显了结合基于路径和基于邻居的方法来减少幻觉的重要性。值得注意的是,与基于路径的方法相比,基于邻居的方法在提高事实准确性方面更为有效。对于涉及医疗咨询的任务,基于路径的方法在查找相关外部信息方面更胜一筹,但在处理多跳答案(如药物和测试建议)时则显得力不从心。

5. 总结

本文介绍了知识图谱提示:1)赋予语言学习者理解知识图谱输入的能力;2)促进语言学习者结合内隐知识和检索到的外部知识进行推理。然后,本文研究了激发思维导图的问题,在思维导图中,LLMs 进行推理并生成答案,其理由用图表示。通过在三个问题与答案数据集上进行广泛的实验,验证了本文的方法与直接使用LLMs 或RAG方法相比取得了显著的收益,并且对不匹配的检索知识具有鲁棒性,为在生产中实现可靠、透明的 LLM 推断打开了大门。

OpenKG

OpenKG(中文开放知识图谱)旨在推动以中文为核心的知识图谱数据的开放、互联及众包,并促进知识图谱算法、工具及平台的开源开放。

点击阅读原文,进入 OpenKG 网站。