刚开始进行激光-相机联合标定的时候,出现了不少问题,在此记录一下整体标定流程,以防忘记。在此,特别感谢佳明师弟,在录制数据集时提供的帮助。0.系统配置:

Ubuntu18.04系统

ROS Melodic

opencv 3.2.0

激光雷达:vlp-16

一. 安装autoware(如果实在安装不上,可以从第二步开始)

这部分网上教程挺多的,但我在编译的过程中仍存在不少bug,唉~_~。

二.安装calibration_camera_lidar,从autoware分离出来的相机雷达联合标定ros包

由于我安装的是autoware1.14版本,在界面中无法找到Calibration Tool Kit,因此,从网上下载autoware激光-相机标定部分代码。代码链接:https://github.com/XidianLemon/calibration_camera_lidar按照要求编译即可。

1、安装nlopt

编译标定工具箱依赖于nlopt,需要先行安装,安装链接:https://github.com/stevengj/nlopt

2、安装标定工具箱

标定工具箱安装教程参考:https://github.com/XidianLemon/calibration_camera_lidar,把工程克隆到自己本地工程的src目录下编译即可。

注:我的ubuntu是18.04版本的,对应的ROS版本为melodic,直接编译会有一些小问题。

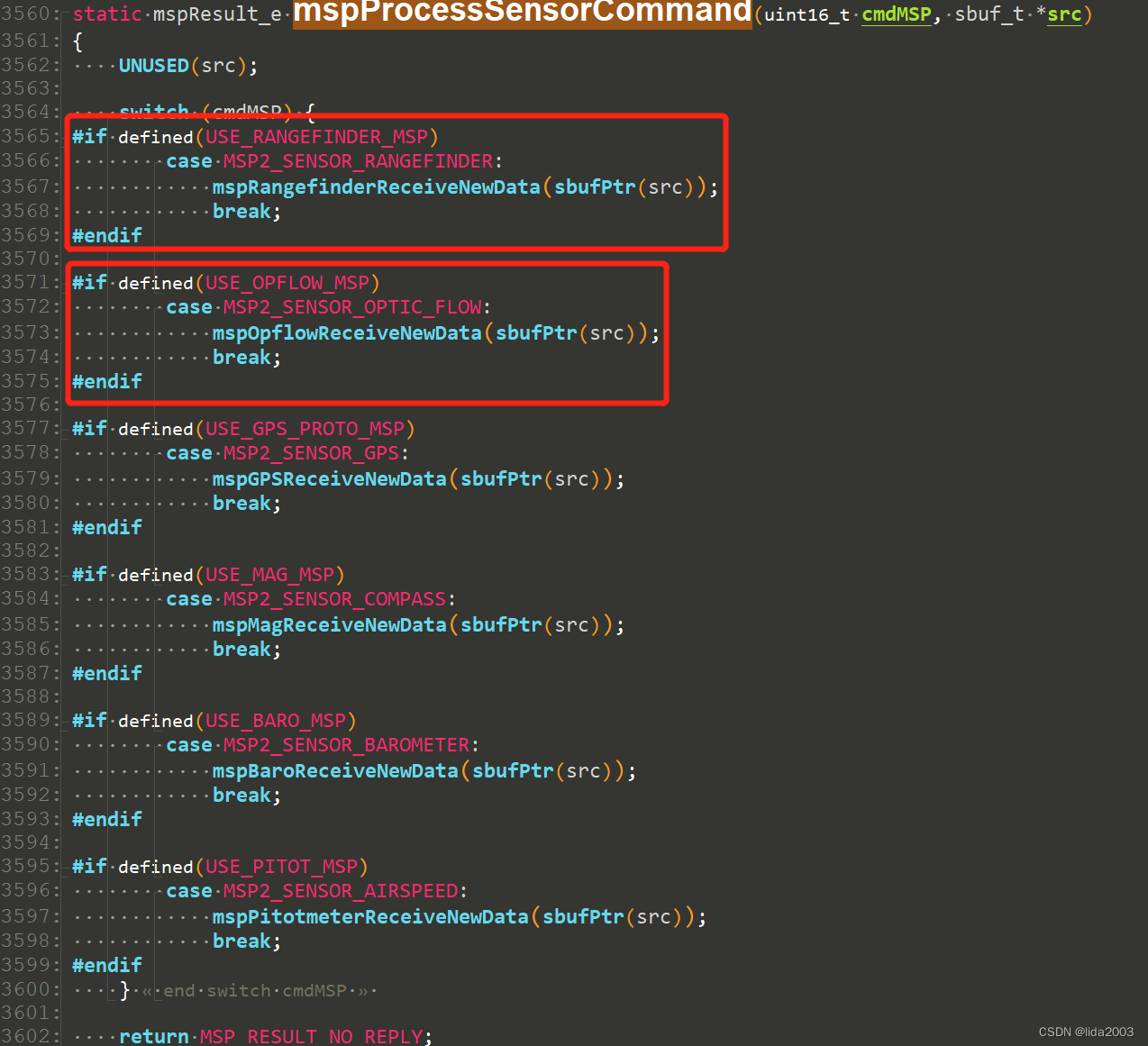

(1)此时直接运行标定程序,会报找不到可执行文件 calibration_camera_lidar的问题。因为我的系统是ubuntu18.04对应支持的ROS是melodic,因此需要对calibration_camera_lidar功能包下的CMakeLists.txt进行修改,添加ROS的melodic版本的支持,如下图所示,修改CMakeLists.txt中所有 (indigo|jade|kinetic) 为 (indigo|jade|kinetic|melodic)此时直接运行标定程序,会报找不到可执行文件 calibration_camera_lidar的问题。因为我的系统是ubuntu18.04对应支持的ROS是melodic,因此需要对calibration_camera_lidar功能包下的CMakeLists.txt进行修改,添加ROS的melodic版本的支持,如下图所示,修改CMakeLists.txt中所有 (indigo|jade|kinetic ) 为 (indigo|jade|kinetic|melodic)(2)编译问题CMakeFiles/calibrationtoolkit.dir/CalibrationToolkit/calibrationtoolkit.cpp.o: In function nlopt::opt::get_errmsg() const': /usr/local/include/nlopt.hpp:516: undefined reference tonlopt_get_errmsg’ ,实际上这个错误应该是重复安装冲突了。解决办法:

sudo apt remove libnlopt-dev

三.激光-相机标定部分

3.1相机标定

棋盘格链接:https://markhedleyjones.com/projects/calibration-checkerboard-collection

3.1.1相机标定(单目–ROS方法)(我选用的棋盘格边长为108mm,总方格为9*7)

rosrun camera_calibration cameracalibrator.py --size 8x6 --square 0.108 image:=/usb_cam/image_raw camera:=/usb_cam

3.1.2相机标定(单目–autoware方法):

rosrun autoware_camera_lidar_calibrator cameracalibrator.py --square 0.108 --size 8x6 image:=/usb_cam/image_raw

(界面与ROS方法的基本一样,用法也基本一样)

(注:我在使用时,需要和摄像头打开界面联合使用,不知道为啥。。。(下载编译usb_cam到drivers_ws 界面下使用命令:roslaunch usb_cam usb_cam-test.launch ))

3.1.3双目–autoware方法(手头没有双目相机,暂时没使用,先记录一下):

rosrun autoware_camera_lidar_calibrator cameracalibrator.py --square SQUARE_SIZE --size MxN right:=/image_topic left:=/image_topic

(注: --square : 棋盘格中每隔方格的边长大小。单位是m

--size : 棋盘格的尺寸是几成几。注意是inner,也就是除去边长最外圈,方格数-1。如果这个参数设置不正确的话,会在下面标定步骤中发现标定程序毫无反应。image_topic : 发布图像的话题名。(right, light : 左右眼图像的话题名)

2.激光相机联合标定

2.1启动录制的数据包(数据包的录制时的站位可参考:无人驾驶汽车系统入门(二十二)——使用Autoware实践激光雷达与摄像机组合标定_AdamShan的博客-CSDN博客)

录制的数据包需要注意:

(a)标定板要同时在相机和雷达的视野内(b)这个工具订阅的是/points_raw,所以需要指定/velodyne_points:=/points_raw(必须要把话题名改成/points_raw,不然autoware接收不到)(c)不停调整标定板的角度,并且在同一个角度停留久一点,接下来标定捕获图片与点云振才能顺利。

rosbag play bagName.bag /velodyne_points:=/points_raw --pause

(添加–pause可以手动暂停,方便后面的标定;当然也可以在autoware界面中打开rosbag,只不过需要提前把rosbag的/velodyne_points话题名给更换一下)

2.2 启动标定工具:

roscore

source ~/catin_ws/devel/setup.bash

rosrun calibration_camera_lidar calibration_toolkit

(a)选择相应的话题名和标定方式:

(b)打开后界面如下图所示:在最上方填入Patter Size为0.108 x 0.108(单位为m,因为我用的棋盘格边长为108mm,所以这里填0.108);Pattern Number为8 x 6(棋盘格数目为9 x 7,去掉最外面的一圈,实际内部角点数为8 x 6)。(此图为网图,按照自己需求更改,load加载相机内参时,需要把.yaml,改成.yml)

但是右边的点云窗口没有显示数据,需要我们调整视角才可以,视角的调整方法如下:

简单解释下,建议直接操作,很容易:

移动点云:上下左右方向键、PgUp、PgDn

旋转点云:a、d、w、s、q、e

切换模式:数字 1 和数字 2

视角缩放:减号缩小、加号放大

点云大小:o 键使用小点云、p 使用大点云

改变点云窗口背景颜色:b

先调节点云界面,右上框的颜色,默认是黑色,点一下该框,按下B键,换成浅色调(便于观察)。

qweasd六个健用于旋转,将右边框角度调到与左边一致;step1.调好角度后,按下空格暂停数据播放,点击grab按钮step2.在右下图选择标定版所在的点云,点击calibrate标定按钮等待一会右边会出现外参矩阵等数据。没有出现下面的图像也没关系,重新播放在grab点云帧。step3.点击project按钮左下图中红点会散落到标定板,你可以根据标定版上红点投影情况以及重投影误差确认标定结果。不断重复以上两个步骤,达到标定目的。点击save保存标定结果,可以保存相机,雷达各自的内参标定结果以及联合标定结果(remove可以用来删除标定错误的图像和点云)

最后的标定结果如下所示:

标定结果测试

获取到外参标定yaml文件后,需要对联合标定的结果进行测试,可以在Autoware中使用Calibration Publisher,来发布和对齐LiDAR与Camera之间的转换

1.打开autoware

source install/setup.bash

roslaunch runtime_manager runtime_manager.launch

2.切换到Sensing感知模块,点击右下区域的Calibration Publisher

3.打开Autoware/Sensing下的Point Image节点

在Rviz中,Panels/Add New Panel内添加ImageViewerPlugin,填写Image Topic,本例为/camrea/rgb/image_raw,Point Topic,本例为/points_image.初步显示结果如下图所示:

参考博客:使用calibration_toolkit进行相机和三维激光雷达的联合标定(详细步骤)_xtdx_xty的博客-CSDN博客

https://zhuanlan.zhihu.com/p/147638876https://www.jianshu.com/p/5e5902b46f3d?utm_campaign=haruki&utm_content=note&utm_medium=reader_share&utm_source=weixinhttps://blog.csdn.net/AdamShan/article/details/81670732

————————————————

版权声明:本文为CSDN博主「nuo112」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/nuo112/article/details/116404760