文章目录

- 报错

- 解决办法

- 成功解决问题

报错

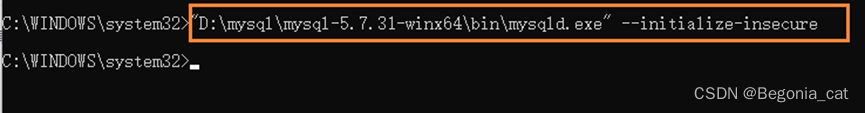

根据“MySQL下载安装使用-完整详细步骤”下载安装好MySQL后,以管理员身份启动cmd,输入:

"D:\mysql\mysql-5.7.31-winx64\bin \mysqld.exe" --initialize-insecure

# 自己的mysql安装目录 + --initialize-insecure

运行后报错:

MSVCR120.dll丢失

应用程序无法启动0x7b mysql

解决办法

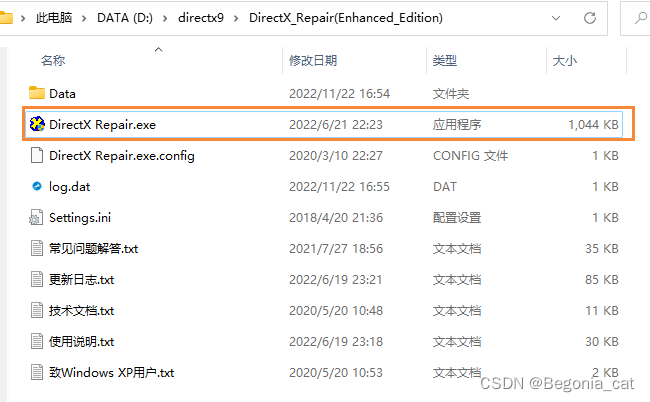

查阅资料,很多博主说可以使用DirectX修复工具一键修复。于是笔者下载了DirectX修复工具:

下载链接:DirectX修复工具V4.2增强版。

DirectX修复工具介绍:DirectX修复工具增强版

Ps:感谢大神分享的免费下载链接😄

下载之后如下图所示:

双击DirectX Repair.exe即可自动检测并修复电脑现存的BUG。

(修复过程忘截图啦,总之,非常好用,非常便捷👍)

成功解决问题

再次以管理员身份打开cmd,运行代码,成功!