概述

在人工智能领域,CLIP和DINOv2是计算机视觉领域的两大巨头。CLIP彻底改变了图像理解,而DINOv2为自监督学习带来了新的方法。

在本文中,我们将踏上一段旅程,揭示定义CLIP和DINOv2的优势和微妙之处。我们的目标是发现这些模型中哪一个在图像相似性任务的世界中真正表现出色。让我们见证巨头的碰撞,看看哪个模型会脱颖而出。

CLIP_6">1 使用CLIP计算图像相似性

使用CLIP计算两张图像之间的相似性是一个简单的过程,只需两步:首先,提取两张图像的特征,然后计算它们的余弦相似度。

首先,确保安装了必要的软件包。建议设置并使用虚拟环境:

# 首先设置虚拟环境

virtualenv venv-similarity

source venv-similarity/bin/activate

# 安装所需软件包

pip install transformers Pillow torch

接下来,计算图像相似性:

import torch

from PIL import Image

from transformers import AutoProcessor, CLIPModel

import torch.nn as nndevice = torch.device('cuda' if torch.cuda.is_available() else "cpu")

processor = AutoProcessor.from_pretrained("openai/clip-vit-base-patch32")

model = CLIPModel.from_pretrained("openai/clip-vit-base-patch32").to(device)# 从image1中提取特征

image1 = Image.open('img1.jpg')

with torch.no_grad():inputs1 = processor(images=image1, return_tensors="pt").to(device)image_features1 = model.get_image_features(**inputs1)# 从image2中提取特征

image2 = Image.open('img2.jpg')

with torch.no_grad():inputs2 = processor(images=image2, return_tensors="pt").to(device)image_features2 = model.get_image_features(**inputs2)# 计算它们的余弦相似度并将其转换为0到1之间的分数

cos = nn.CosineSimilarity(dim=0)

sim = cos(image_features1[0],image_features2[0]).item()

sim = (sim + 1) / 2

print('Similarity:', sim)

使用提供的两张相似图像的示例,获得的相似度分数令人印象深刻,达到了96.4%。

DINOv2_48">2 使用DINOv2计算图像相似性

使用DINOv2计算两张图像之间的相似性过程与CLIP类似。用DINOv2需要与前面提到的相同的软件包集,无需额外安装:

from transformers import AutoImageProcessor, AutoModel

from PIL import Image

import torch.nn as nndevice = torch.device('cuda' if torch.cuda.is_available() else "cpu")

processor = AutoImageProcessor.from_pretrained('facebook/dinov2-base')

model = AutoModel.from_pretrained('facebook/dinov2-base').to(device)image1 = Image.open('img1.jpg')

with torch.no_grad():inputs1 = processor(images=image1, return_tensors="pt").to(device)outputs1 = model(**inputs1)image_features1 = outputs1.last_hidden_stateimage_features1 = image_features1.mean(dim=1)image2 = Image.open('img2.jpg')

with torch.no_grad():inputs2 = processor(images=image2, return_tensors="pt").to(device)outputs2 = model(**inputs2)image_features2 = outputs2.last_hidden_stateimage_features2 = image_features2.mean(dim=1)cos = nn.CosineSimilarity(dim=0)

sim = cos(image_features1[0],image_features2[0]).item()

sim = (sim + 1) / 2

print('Similarity:', sim)

使用与CLIP示例中相同的一对图像,DINOv2获得的相似度分数为96.4%:

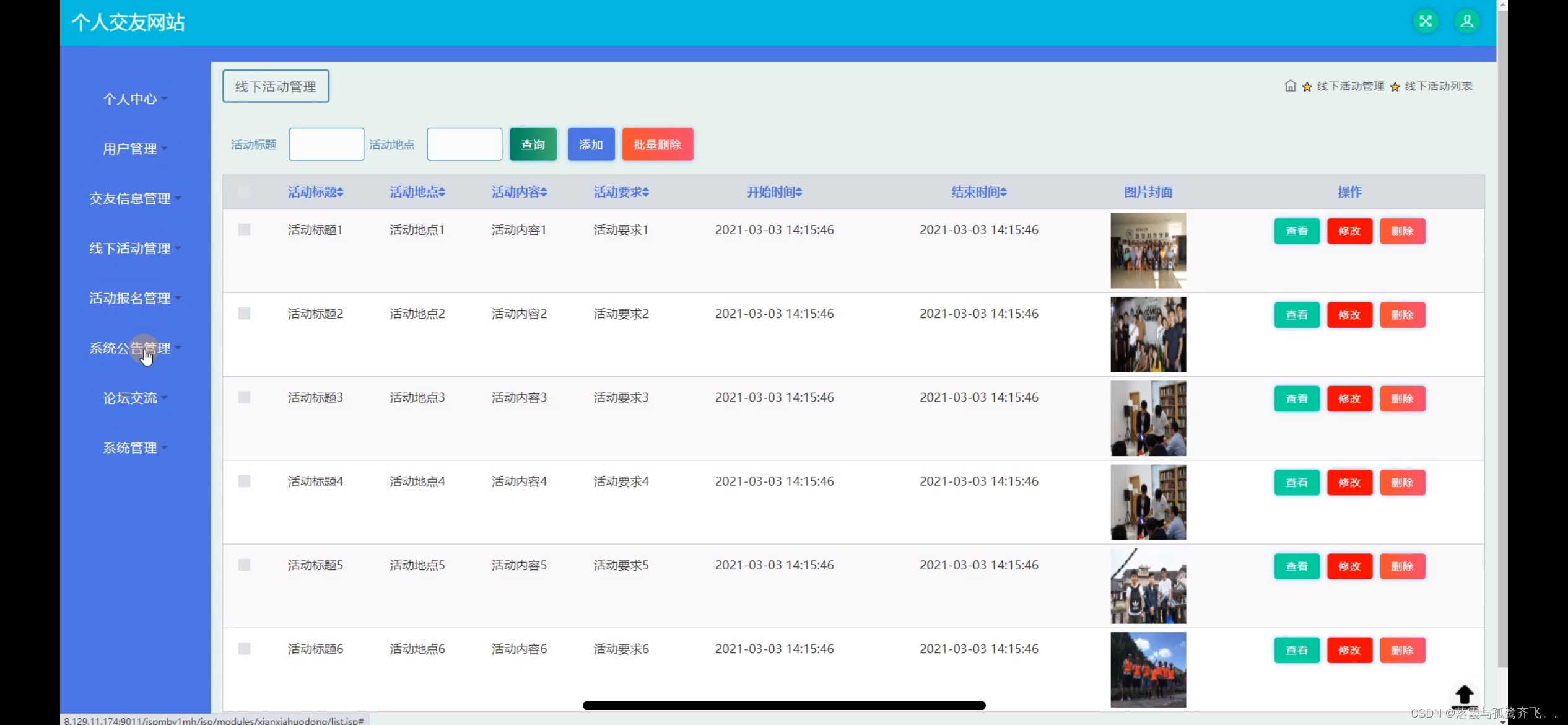

3. 使用COCO数据集进行测试

在深入评估它们的性能之前,使用COCO数据集中的图像比较CLIP和DINOv2产生的结果。

实现流程:

- 遍历数据集以提取所有图像的特征。

- 将嵌入存储在FAISS索引中。

- 提取输入图像的特征。

- 检索最相似的三张图像。

3.1 特征提取和创建

import torch

from PIL import Image

from transformers import AutoProcessor, CLIPModel, AutoImageProcessor, AutoModel

import faiss

import os

import numpy as npdevice = torch.device('cuda' if torch.cuda.is_available() else "cpu")# 加载CLIP模型和处理器

processor_clip = AutoProcessor.from_pretrained("openai/clip-vit-base-patch32")

model_clip = CLIPModel.from_pretrained("openai/clip-vit-base-patch32").to(device)# 加载DINOv2模型和处理器

processor_dino = AutoImageProcessor.from_pretrained('facebook/dinov2-base')

model_dino = AutoModel.from_pretrained('facebook/dinov2-base').to(device)# 获取所有文件名

images = []

for root, dirs, files in os.walk('./val2017/'):for file in files:if file.endswith('jpg'):images.append(root + '/' + file)# 定义一个函数,用于归一化嵌入并将其添加到索引中

def add_vector_to_index(embedding, index):# 将嵌入转换为numpy数组vector = embedding.detach().cpu().numpy()# 转换为float32 numpy数组vector = np.float32(vector)# 归一化向量:在搜索时避免错误结果很重要faiss.normalize_L2(vector)# 添加到索引中index.add(vector)def extract_features_clip(image):with torch.no_grad():inputs = processor_clip(images=image, return_tensors="pt").to(device)image_features = model_clip.get_image_features(**inputs)return image_featuresdef extract_features_dino(image):with torch.no_grad():inputs = processor_dino(images=image, return_tensors="pt").to(device)outputs = model_dino(**inputs)image_features = outputs.last_hidden_statereturn image_features.mean(dim=1)# 创建两个索引

index_clip = faiss.IndexFlatL2(512)

index_dino = faiss.IndexFlatL2(768)# 遍历数据集以提取特征X2并将特征存储在索引中

for image_path in images:img = Image.open(image_path).convert('RGB')clip_features = extract_features_clip(img)add_vector_to_index(clip_features, index_clip)dino_features = extract_features_dino(img)add_vector_to_index(dino_features, index_dino)# 将索引本地存储

faiss.write_index(index_clip, "clip.index")

faiss.write_index(index_dino, "dino.index")

3.2 图像相似性搜索

import faiss

import numpy as np

import torch

from transformers import AutoImageProcessor, AutoModel, AutoProcessor, CLIPModel

from PIL import Image

import os# 输入图像

source = 'laptop.jpg'

image = Image.open(source)

device = torch.device('cuda' if torch.cuda.is_available() else "cpu")# 加载DINOv2和CLIP的模型和处理器

processor_clip = AutoProcessor.from_pretrained("openai/clip-vit-base-patch32")

model_clip = CLIPModel.from_pretrained("openai/clip-vit-base-patch32").to(device)

processor_dino = AutoImageProcessor.from_pretrained('facebook/dinov2-base')

model_dino = AutoModel.from_pretrained('facebook/dinov2-base').to(device)# 为CLIP提取特征

with torch.no_grad():inputs_clip = processor_clip(images=image, return_tensors="pt").to(device)image_features_clip = model_clip.get_image_features(**inputs_clip)# 为DINOv2提取特征

with torch.no_grad():inputs_dino = processor_dino(images=image, return_tensors="pt").to(device)outputs_dino = model_dino(**inputs_dino)image_features_dino = outputs_dino.last_hidden_stateimage_features_dino = image_features_dino.mean(dim=1)def normalizeL2(embeddings):vector = embeddings.detach().cpu().numpy()vector = np.float32(vector)faiss.normalize_L2(vector)return vectorimage_features_dino = normalizeL2(image_features_dino)

image_features_clip = normalizeL2(image_features_clip)# 搜索最相似的5张图像

index_clip = faiss.read_index("clip.index")

index_dino = faiss.read_index("dino.index")# 获取图像的距离和相关索引

d_dino, i_dino = index_dino.search(image_features_dino, 5)

d_clip, i_clip = index_clip.search(image_features_clip, 5)

结果

使用四张不同的图像作为输入,搜索产生了以下结果:

4. 在DISC21数据集上进行基准测试

为了比较它们的性能,我们将遵循这篇文章中描述的相同方法。我们还将重用上面的脚本提取特征,然后计算图像相似性。

4.1 数据集

为了对CLIP和DINOv2进行基准测试,我们选择了DISC21数据集,该数据集是专门为图像相似性搜索创建的。由于其大小为350GB,我们将使用其中150,000张图像的子集。

4.2 使用的指标

在指标方面,我们将计算:

- 准确率:正确预测的图像与图像总数的比率。

- 前3准确率:在前三张最相似图像中找到正确图像的次数与图像总数的比率。

- 计算时间:处理整个数据集所需的时间。

4.3 基准测试结果

-

特征提取

-

准确率和前3准确率

-

检查结果

5. 分析

DINOv2显然是领先者,在极具挑战性的数据集上实现了令人印象深刻的64%的准确率。相比之下,CLIP的准确率较为适中,达到28.45%。

关于计算效率,两个模型的特征提取时间非常相似。这种相似性使得在这方面没有一个模型具有明显优势。

5.1 局限性

虽然这个基准测试提供了有价值的见解,但认识到其局限性很重要。评估是在1448张图像的子集上进行的,而与之对比的是150,000张图像的池。考虑到整个数据集有210万张图像,这种缩小的范围是为了节省资源。

值得注意的是,MetaAI使用DISC21数据集作为其模型的基准,这可能使DINOv2具有有利优势。然而,我们在COCO数据集上的测试揭示了有趣的细微差别:DINOv2显示出更强的识别图像主要元素的能力,而CLIP则擅长关注输入图像中的特定细节(如公交车图像所示)。

最后,必须考虑CLIP和DINOv2之间嵌入维度的差异。CLIP使用的嵌入维度为512,而DINOv2使用的是768。虽然可以选择使用具有匹配嵌入维度的更大的CLIP模型,但值得注意的是,这是以速度为代价的。在一个小子集上的快速测试显示性能略有提升,但没有达到DINOv2所展示的水平。

5.2 结论

DINOv2在图像相似性任务中表现出更高的准确率,展示了其在实际应用中的潜力。CLIP虽然值得称赞,但相比之下有所不足。值得注意的是,CLIP在需要关注小细节的场景中可能特别有用。两个模型的计算效率相似,因此选择取决于具体任务。

原文地址:https://medium.com/aimonks/clip-vs-dinov2-in-image-similarity-6fa5aa7ed8c6