1.Spark用来干啥的?

Spark是一个开源的大数据处理框架,主要用于分布式计算和数据处理。Spark可以处理大量的数据,并且可以在分布式计算中进行数据处理和分析,具有高效性和可扩展性。Spark支持多种编程语言,并且可以与Hadoop等其他大数据处理工具集成使用。Spark可以用于数据处理、机器学习、图形处理、流处理等多个领域。Spark还支持实时数据处理和批处理,可以在处理大量数据时提供高效的性能和可靠的结果。因此,Spark是目前大数据处理领域中最为流行和强大的工具之一。

2.Hadoop用来干啥的?

Hadoop是一个开源的分布式存储和计算框架,它的主要作用是处理大规模数据的存储和分析。Hadoop可以将大量数据分成多个块进行存储,这些块可以分布在不同的节点上,从而实现高效的数据存储和处理。Hadoop还提供了一系列工具和组件,例如MapReduce、HDFS、YARN等,可以帮助开发者在分布式环境下进行数据处理和计算。Hadoop被广泛应用于互联网、金融、医疗、电信等行业,可以用于大数据分析、数据挖掘、机器学习等领域。

3.spark主要的技术有什么?

- 分布式计算模型:Spark采用基于内存的分布式计算模型,即Resilient Distributed Datasets (RDD),与Hadoop MapReduce相比更高效。

- 多语言支持:Spark支持Java、Scala、Python等多种编程语言。

- Spark Streaming:Spark Streaming是Spark提供的一种实时流数据处理功能,能够实现高吞吐量、低延迟的处理。

- MLlib:MLlib是Spark提供的一个机器学习库,支持常见的机器学习算法和特征处理方法。

- GraphX:GraphX是Spark提供的一个图计算框架。

- Spark SQL:Spark SQL提供了对结构化数据的查询和处理能力,支持SQL查询、DataFrame和Dataset API等操作方式。

- PySpark:PySpark是Spark的Python API,可以方便地在Python中使用Spark。

4.学习spark需要用到哪些软件?

- Spark:需要下载和安装Spark本身,可前往官方网站

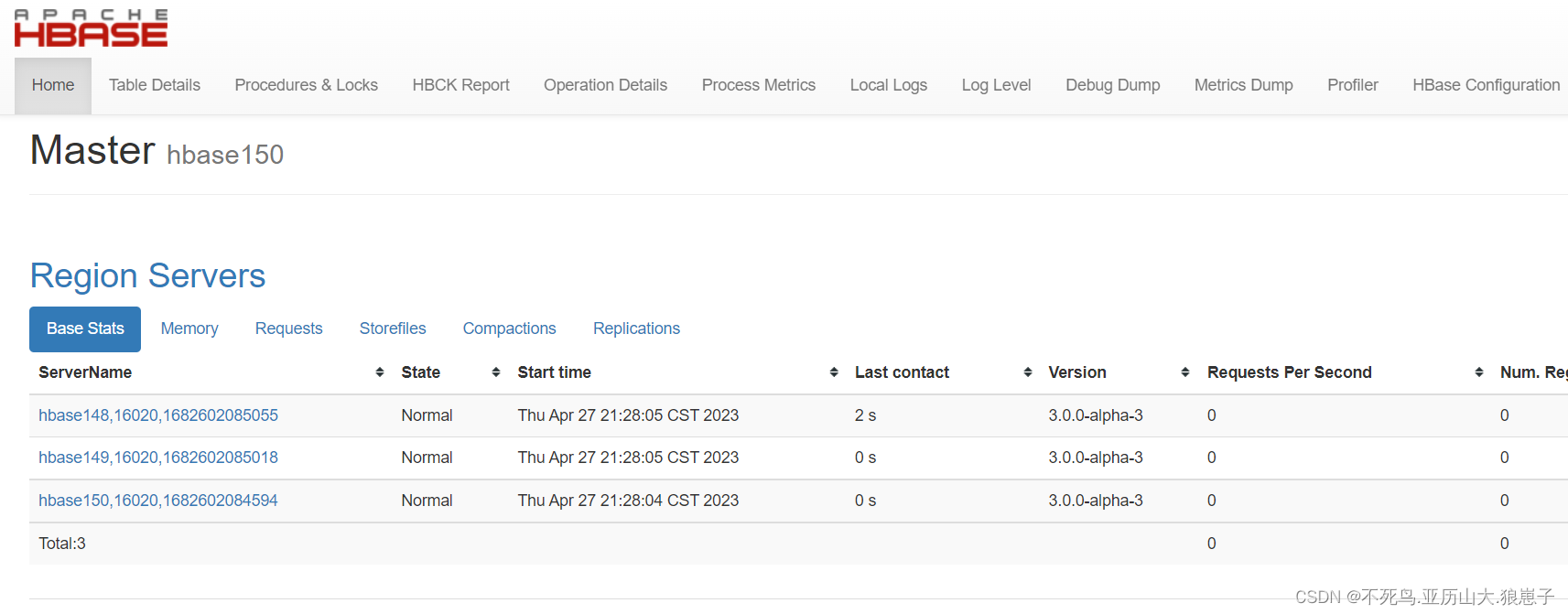

- Hadoop:虽然不是必需品,但如果要在HDFS上运行Spark作业,则需要安装或配置Hadoop。如果您未安装Hadoop,则可以通过使用本地文件系统来运行Spark作业。

- IDE:为了编写、测试和运行Spark应用程序,您需要一个IDE(Integrated Development Environment)。Eclipse和IntelliJ IDEA都是受欢迎的IDE选择,并可以与Spark配合使用。

- 数据库:如果您想要处理结构化数据,则可能需要连接到数据库,比如MySQL或PostgreSQL等。

- 数据集:学习Spark也需要有适当的数据集,以便演示和练习Spark API的各种操作。您可以从Internet上找到许多在线数据集,也可以自己创建一些本地数据集。