1、A Dynamic Multi-Scale Voxel Flow Network for Video Prediction

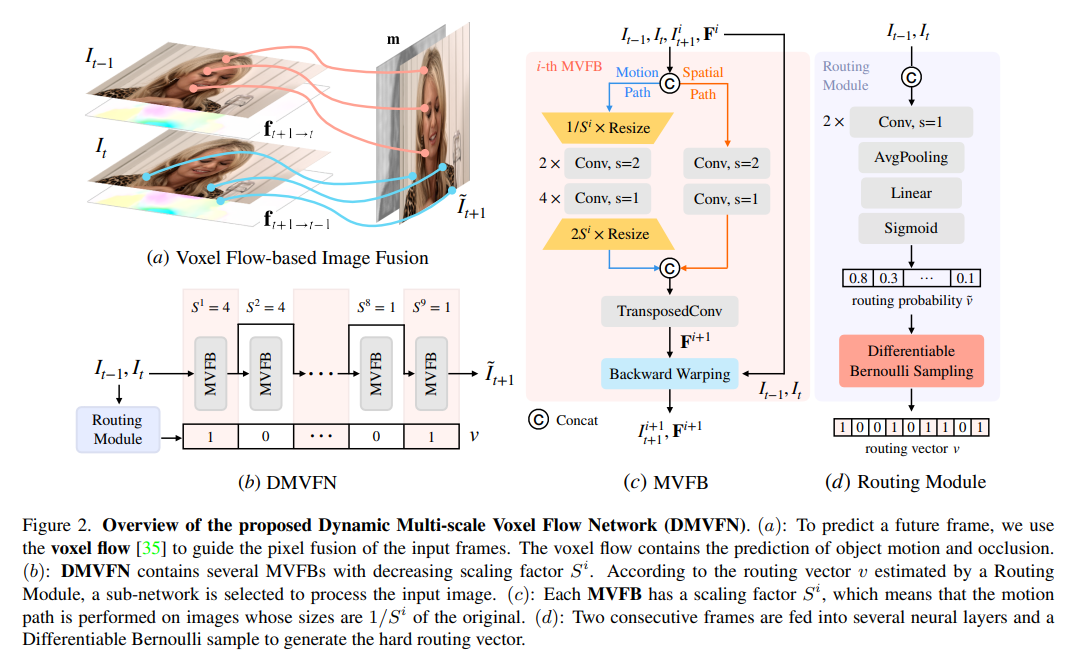

视频预测(video prediction)的性能已经通过先进的深度神经网络大幅提高。然而,大多数当前的方法存在着大的模型尺寸和需要额外的输入(如,语义/深度图)以实现良好的性能。出于效率考虑,本文提出了一个动态多尺度体素流网络(Dynamic Multi-scale Voxel Flow Network,DMVFN),只基于RGB图像,可以在更低的计算成本下实现更好的视频预测性能,比之前的方法快一个数量级。

DMVFN的核心是一个可以有效感知视频帧的运动尺度的可微分路由模块(differentiable routing module)。一旦训练完成,在推理阶段为不同的输入选择自适应子网络。在几个基准测试上的实验表明,相比于Deep Voxel Flow,DMVFN速度快一个数量级,超越了最新的基于迭代的OPT在生成图像质量上的表现。

https://huxiaotaostasy.github.io/DMVFN/

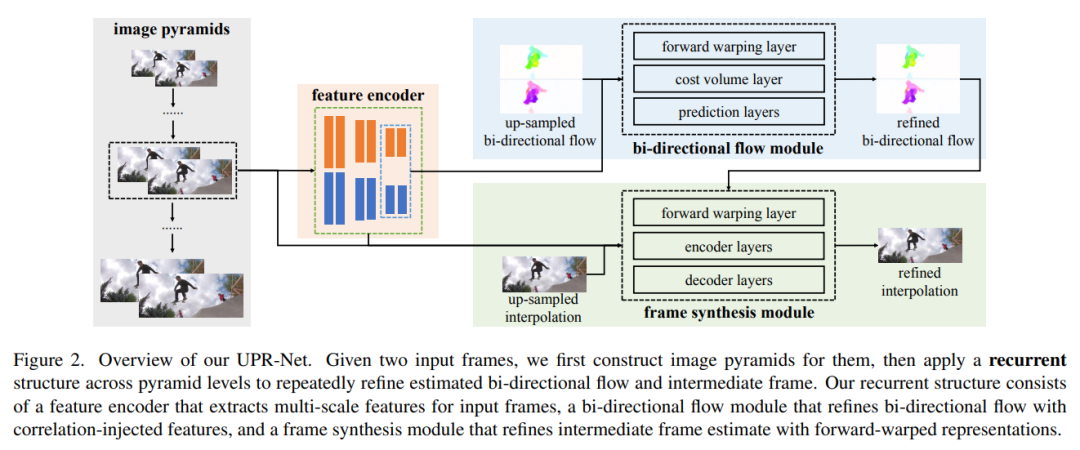

2、A Unified Pyramid Recurrent Network for Video Frame Interpolation

流引导合成(Flow-guided synthesis),为帧插值提供了一个通用的框架,其中估计光流以指导合成两个连续输入之间的中间帧。本文提出了一种新型的统一金字塔循环网络(UPR-Net)用于帧插值。UPR-Net利用灵活的金字塔框架,利用轻量级循环模块进行双向流估计和中间帧合成。在每个金字塔级别,它利用估计的双向流为帧合成生成正向变形表示;跨越金字塔级别,它使迭代的优化用于光流和中间帧。迭代合成策略可以显著提高大运动情况下的帧插值的鲁棒性。

尽管基于UPR-Net的基础版本极度轻量(1.7M参数),但在大量基准测试上表现出色。UPR-Net系列的代码和训练模型在https://github.com/srcn-ivl/UPR-Net

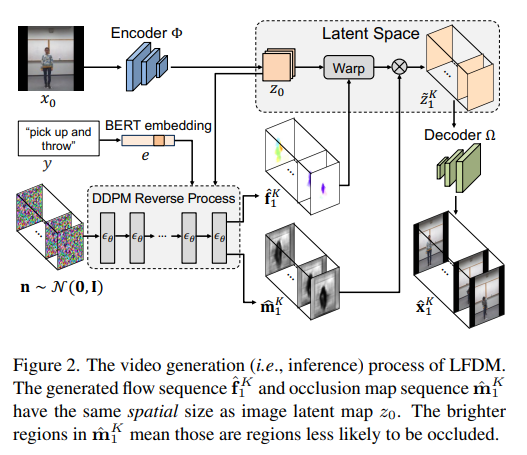

3、Conditional Image-to-Video Generation with Latent Flow Diffusion Models

条件图像到视频(Conditional image-to-video,cI2V)生成,旨在从图像(例如,人脸)和条件(例如,类别标签,例如微笑)开始合成一个新的 plausible 视频。cI2V任务的关键挑战在于同时生成与给定图像和条件对应的空间外观和时间性动态。

本文提出一种使用基于新型潜流扩散模型(latent flow diffusion models,LFDM)的cI2V方法。与以前直接合成相比,LFDM更好利用给定图像的空间内容,在潜在空间中进行变形来合成细节和运动。LFDM训练分为两个独立阶段:(1)无监督学习阶段,用于训练潜在流自动编码器以进行空间内容生成,其中流预测器用于估计视频帧对之间的潜在流(2)条件学习阶段,用于训练基于3D-UNet的扩散模型(DM)以进行时间潜在流生成。LFDM仅需要学习低维潜在流空间以进行运动生成,计算高效。

在多个数据集上进行了全面实验,证明LFDM始终优于现有技术。此外,展示LFDM可以通过简单微调图像解码器来轻松适应新领域。代码在https://github.com/nihaomiao/CVPR23_LFDM

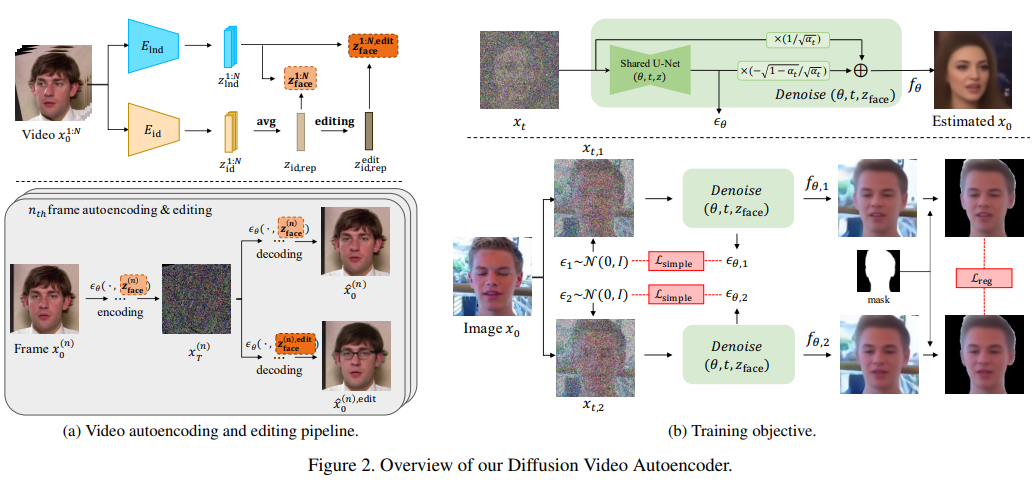

4、Diffusion Video Autoencoders: Toward Temporally Consistent Face Video Editing via Disentangled Video Encoding

受最近人脸图像编辑方法的卓越性能启发,有几项研究自然地提出将这些方法扩展到视频编辑任务中。其中一个主要的挑战是编辑帧之间的时间一致性,这仍然没有解决。

为此,提出了一种基于扩散自动编码器的新的人脸视频编辑框架,能够通过简单地操作具有时间稳定性的特征即可实现视频编辑以达到一致性。模型另一个独特优势是,基于扩散模型可以同时满足重建和编辑能力,并且不同于现有的基于GAN的方法,可以抵御极端情况,自然场景人脸视频(例如遮挡的面部)。

https://diff-video-ae.github.io/

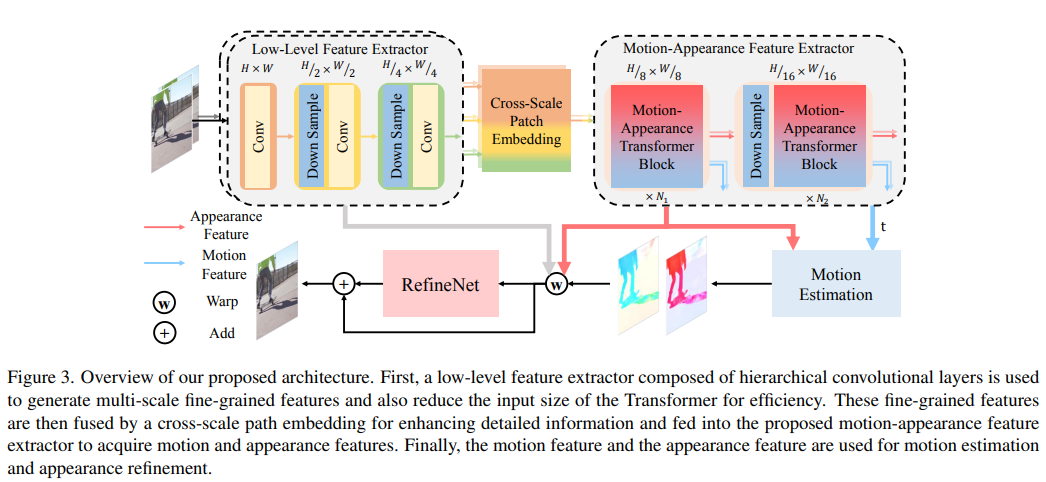

5、Extracting Motion and Appearance via Inter-Frame Attention for Efficient Video Frame Interpolation

有效地提取帧间运动和外观信息对于视频帧插值(video frame interpolation,VFI)非常重要。以往要么混合提取这两种信息,要么针对每种信息都要有详尽的单独模块,这会导致表示的模糊性和效率不高。

本文提出一种新模块,通过统一的操作明确地提取运动和外观信息。具体而言,重新考虑帧间注意力中的信息处理,并重用其注意力图以用于外观特征增强和运动信息提取。此外,为了实现高效的VFI,模块可以无缝集成到混合CNN和Transformer体系结构中。这种混合管道可以缓解帧间注意力的计算复杂性,同时保留详细的低级结构信息。

实验结果表明,无论是在固定间隔还是任意间隔的插值方面,方法在各种数据集上都实现了最先进性能。同时,与具有相似性能的模型相比,具有更小的计算开销。源代码和模型在https://github.com/MCG-NJU/EMA-VF

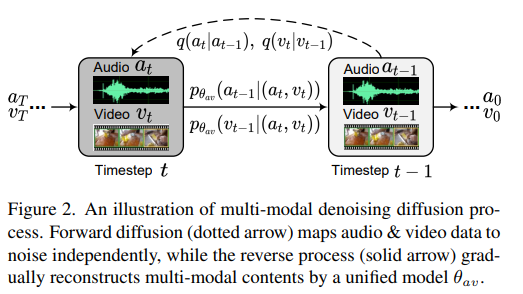

6、MM-Diffusion: Learning Multi-Modal Diffusion Models for Joint Audio and Video Generation

提出了第一个联合音频-视频生成的框架,可以同时带来引人入胜的观看和听觉体验,旨在实现高质量的逼真视频。为了生成联合音视频对,提出了一种新的多模态扩散模型(即MM-Diffusion),其中包括两个耦合去噪自编码器。与现有的单模态扩散模型不同,MM-Diffusion由一个顺序的多模态U-Net组成,通过设计用于联合去噪过程。用于音频和视频的两个子网络逐步从高斯噪声中学习生成对齐的音频视频对。

实验结果表明,在无条件音视频生成和零样本条件任务(例如,视频到音频)方面具有优越的结果。代码和预训练模型在https://github.com/researchmm/MM-Diffusion

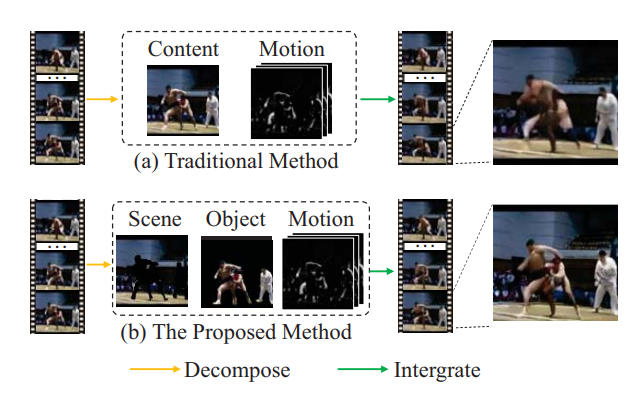

7、MOSO: Decomposing MOtion, Scene and Object for Video Prediction

运动、场景和物体是视频的三个主要视觉组成部分。特别是,物体代表前景,场景代表背景,运动则追踪它们的动态。基于这个认识,本文提出了一个两阶段的运动、场景和物体分解框架(MOtion, Scene and Object decomposition,MOSO),用于视频预测,包括MOSO-VQVAE和MOSO-Transformer。

在第一阶段中,MOSO-VQVAE将先前视频剪辑分解为运动、场景和物体组件,并将它们表示为不同的离散token组。然后,在第二阶段中,MOSO-Transformer基于先前的标记预测后续视频剪辑的物体和场景token,并在生成的物体和场景token级别上添加动态运动。

框架可以轻松扩展到无条件视频生成和视频帧插值任务。实验结果表明,方法在视频预测和无条件视频生成的五个具有挑战性的基准测试中取得了新的最优性能:BAIR、RoboNet、KTH、KITTI和UCF101。此外,MOSO可以通过组合来自不同视频的对象和场景产生逼真的视频。

https://github.com/iva-mzsun/MOSO

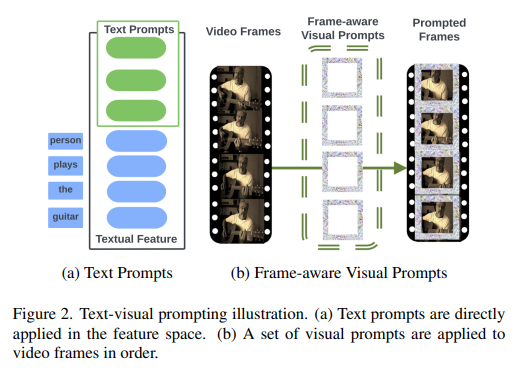

8、Text-Visual Prompting for Efficient 2D Temporal Video Grounding

本文研究了时间视频定位(temporal video grounding,TVG)的问题,它旨在预测由文本句子描述的时刻在视频中的起始/结束时间点。由于精细3D视觉特征优势,TVG在近年来取得明显进展。然而,3D卷积神经网络(CNNs)的高复杂性耗时,需大量的存储和计算资源。

为了实现高效的TVG,提出一种新的文本-视觉提示(TVP)框架,将优化的扰动模式(optimized perturbation patterns,称之为“prompts”)并入TVG模型的视觉输入和文本特征中。与3D CNN相比,TVP有效地在2D TVG模型中共同训练视觉编码器和语言编码器,并使用低复杂度的稀疏2D视觉特征来提高跨模态特征融合的性能。此外,提出了一种用于有效学习TVG的时间距离IoU(TDIoU)损失。基于Charades-STA和ActivityNet Captions数据集的实验证明,TVP显著提升了2D TVG的性能(如Charades-STA上的9.79%改进和ActivityNet Captions上的30.77%改进),且用3D视觉特征进行TVG相比,推断加速达到5倍。

https://github.com/intel

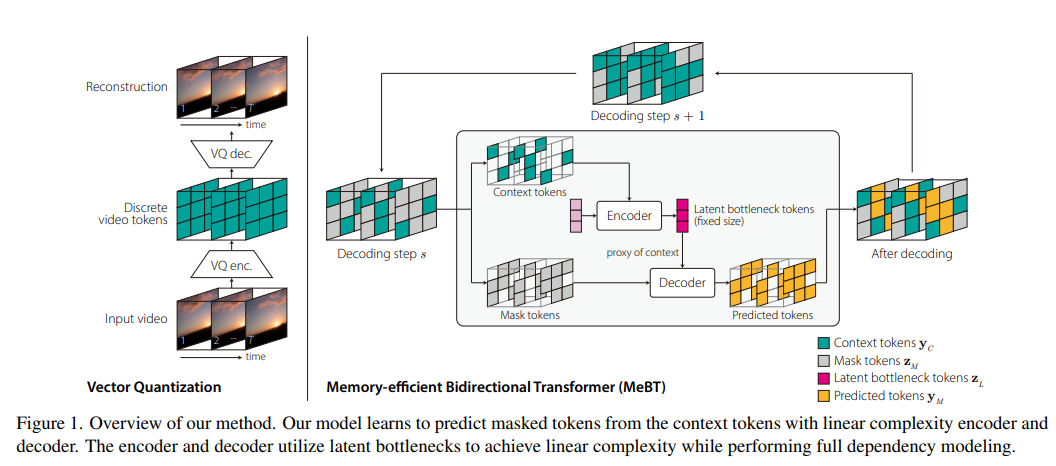

9、Towards End-to-End Generative Modeling of Long Videos with Memory-Efficient Bidirectional Transformers

Autoregressive transformer在视频生成方面表现出色。然而,受到自注意力的二次复杂性限制,不能直接学习视频中的长期依赖性,并且由于自回归过程而受到慢速推理时间和误差传播影响。

本文提出一种记忆效率的双向transformer(Memory-efficient Bidirectional Transformer,MeBT),用于端到端学习视频中的长期依赖性和快速推理。基于最新进展,方法学习从部分观察到的patch中并行解码视频的整个时空volume。在编码和解码方面均具有线性时间复杂度,通过将可观察的上下文token投影到固定数目的潜在token中,并通过交叉注意力将它们条件化为编码、解码掩码token。

由于线性复杂度和双向建模,方法在质量和速度上对适度长时间内视频的生成比自回归有着显著改进。视频和代码在https://sites.google.com/view/mebt-cvpr2023

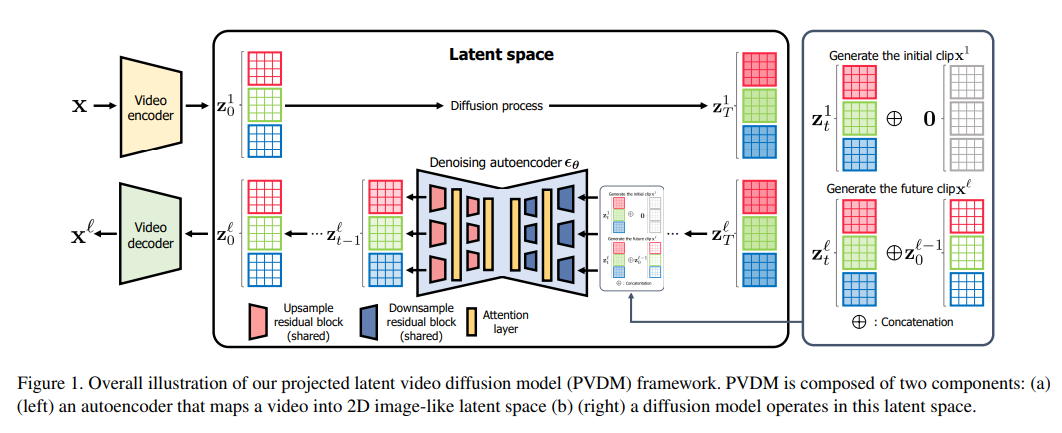

10、Video Probabilistic Diffusion Models in Projected Latent Space

尽管深度生成模型取得了显著进展,但由于高维度和复杂的时空动态以及大的空间变化,合成高分辨率和时间连贯的视频仍然是一个挑战。最近扩散模型研究显示了它们解决这一问题的潜力,但它们面临着计算和内存效率问题。

为了解决这个问题,本文提出了一个新的视频生成生成模型,称为投影潜在视频扩散模型(PVDM),它是一个概率扩散模型,可以在低维潜在空间中学习视频分布,因此可以在有限的资源下高效地训练高分辨率视频。具体来说,PVDM由两个组件组成:(a)一个自编码器,将给定的视频投影为2D形状的潜在向量,这些向量分解了视频像素的复杂立方体结构;以及(b)一个扩散模型体系结构,专门为新分解潜在空间和训练/采样过程设计,并使用单个模型合成任意长度的视频。流行视频生成数据集上的实验证明了PVDM相对于以前的视频合成方法的优越性;例如,PVDM在UCF-101长视频(128帧)生成基准测试中获得了639.7的FVD得分,比先前的最优方法提高了1773.4。

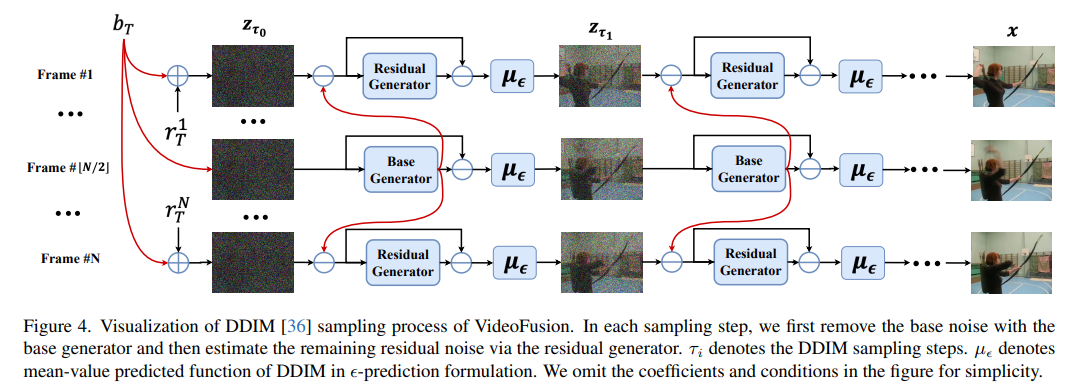

11、VideoFusion: Decomposed Diffusion Models for High-Quality Video Generation

扩散概率模型(DPM)通过逐步向数据添加噪声构建正向扩散过程,并学习反向去噪过程以生成新的样本,已被证明可处理复杂的数据分布。尽管在图像生成方面取得了成功,但将DPM应用于视频生成仍具有挑战,因为它面临高维度的数据空间。以前的方法通常采用标准扩散过程,在其中同一视频中的帧使用独立的噪声进行破坏,忽略了内容冗余和时间相关性。

本文通过将每帧噪声解决为在所有帧之间共享的基础噪声和沿时间轴变化的残余噪声,提出了一个分解扩散过程。去噪流程采用两个联合学习的网络相应地匹配噪声分解。各种数据集上的实验确认了方法(称为VideoFusion)在高质量视频生成方面超越了基于GAN和基于扩散的替代方案。

关注公众号【机器学习与AI生成创作】,更多精彩等你来读

深入浅出stable diffusion:AI作画技术背后的潜在扩散模型论文解读

深入浅出ControlNet,一种可控生成的AIGC绘画生成算法!

经典GAN不得不读:StyleGAN

戳我,查看GAN的系列专辑~!

戳我,查看GAN的系列专辑~!

一杯奶茶,成为AIGC+CV视觉的前沿弄潮儿!

最新最全100篇汇总!生成扩散模型Diffusion Models

ECCV2022 | 生成对抗网络GAN部分论文汇总

CVPR 2022 | 25+方向、最新50篇GAN论文

ICCV 2021 | 35个主题GAN论文汇总

超110篇!CVPR 2021最全GAN论文梳理

超100篇!CVPR 2020最全GAN论文梳理

拆解组新的GAN:解耦表征MixNMatch

StarGAN第2版:多域多样性图像生成

附下载 | 《可解释的机器学习》中文版

附下载 |《TensorFlow 2.0 深度学习算法实战》

附下载 |《计算机视觉中的数学方法》分享

《基于深度学习的表面缺陷检测方法综述》

《零样本图像分类综述: 十年进展》

《基于深度神经网络的少样本学习综述》

《礼记·学记》有云:独学而无友,则孤陋而寡闻

点击一杯奶茶,成为AIGC+CV视觉的前沿弄潮儿!,加入 AI生成创作与计算机视觉 知识星球!