时尚图像编辑是一种应用计算机视觉和机器学习技术来改变或增强时尚摄影图像的领域。这种编辑可以包括更改服装颜色、形状或整体风格,以及调整模特在图像中的姿态或场景背景。

在您提到的背景中,现有的时尚图像编辑方法依赖于如分割器和关键点提取器这样的辅助工具,这些工具帮助识别和修改图像中的特定区域。然而,这些方法通常受限于其处理的服装类型和背景的复杂性,大多数仅限于具有简单背景的通用服装类型。

为了解决这些限制,研究中引入了新的方法和技术:

-

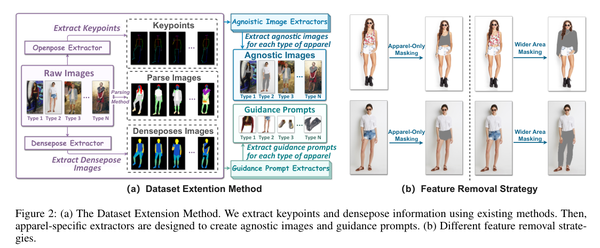

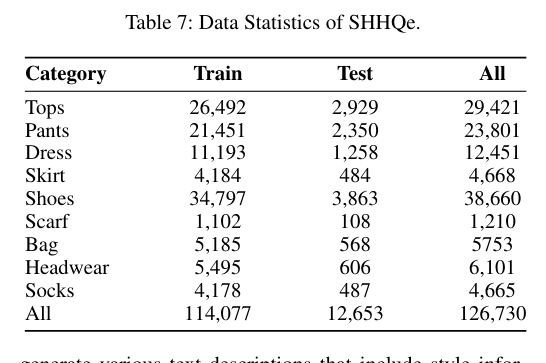

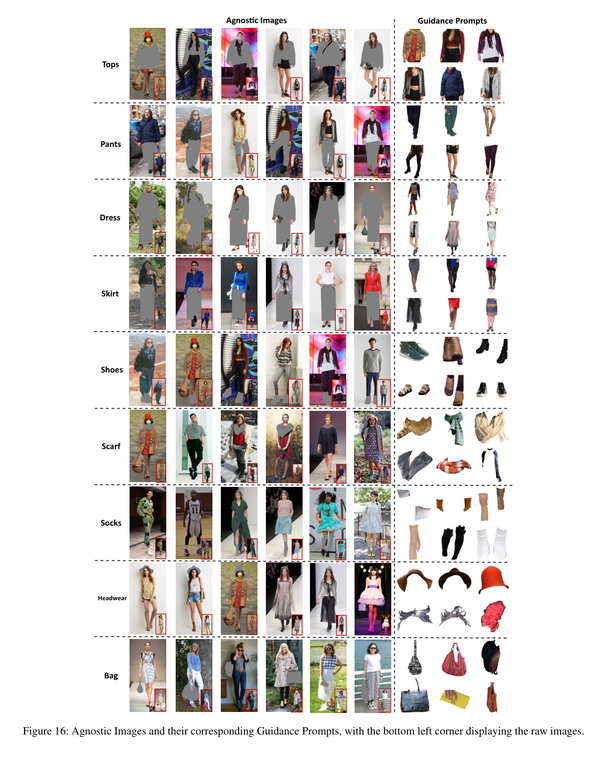

数据集扩展:研究扩展了包含更多种类服装和复杂背景的人体生成数据集,使模型能更好地适应各种真实场景。

-

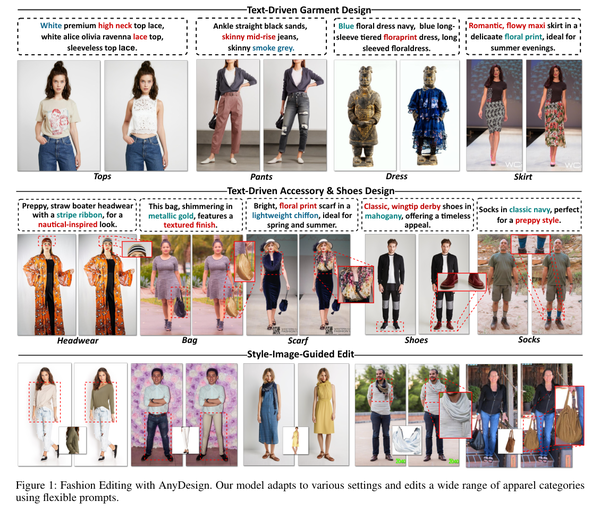

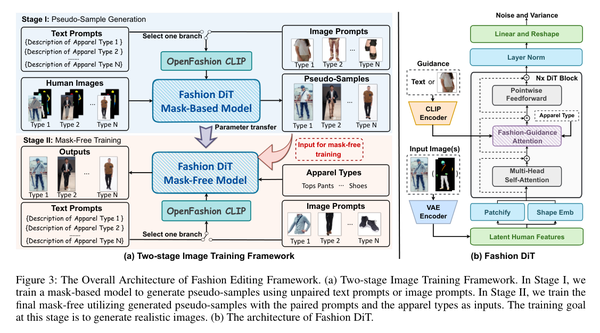

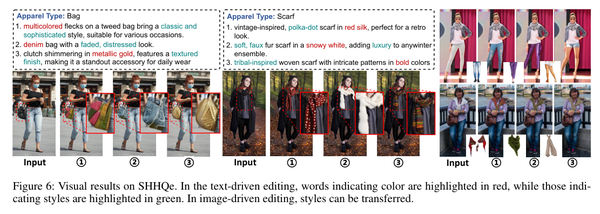

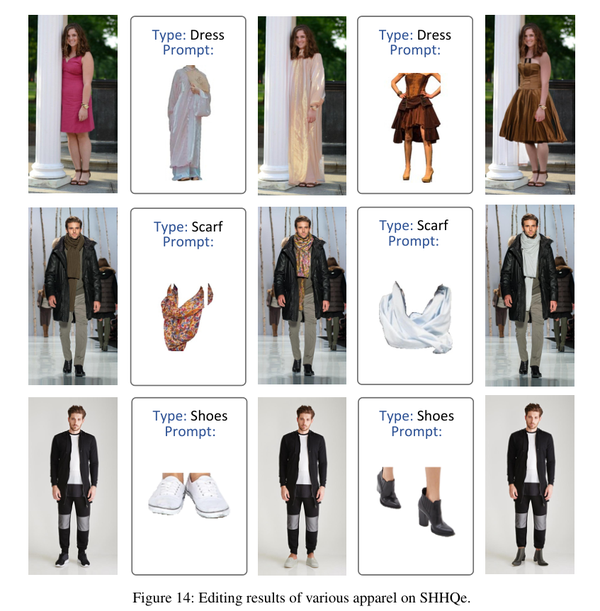

AnyDesign方法:这是一种基于扩散模型的时尚图像编辑方法,它允许用户对图像中的多个区域进行编辑,无需使用掩码。用户可以通过输入一个人像图像和相应的文本或图像提示来指导编辑过程。

-

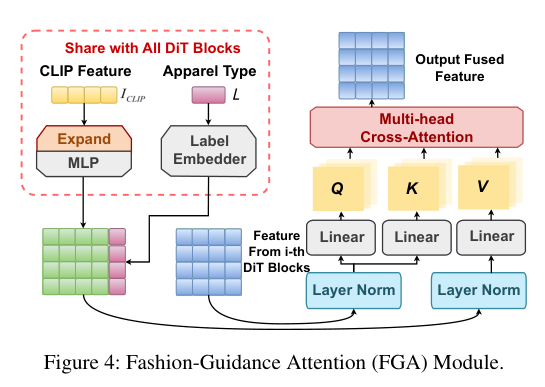

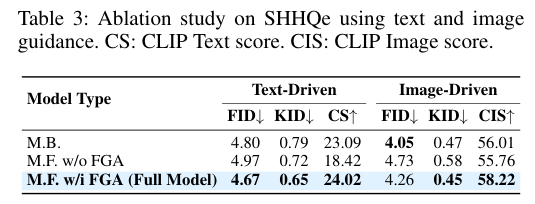

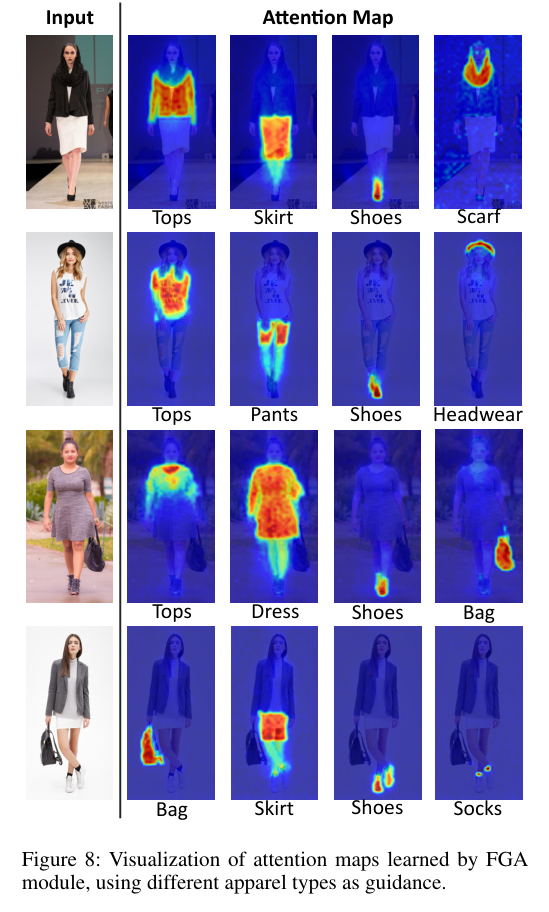

Fashion DiT与FGA模块:引入了Fashion DiT和配备了Fashion-Guidance Attention (FGA)模块的方法。FGA模块旨在更好地融合显式的服装类型信息和通过CLIP模型编码的服装特征,从而实现更精准和个性化的编辑效果。

这些方法不仅提高了时尚图像编辑的质量和灵活性,也拓展了其应用范围,使其能更好地适应多样化的商业和个人需求。通过这种技术的应用,可以更加自由地创造和修改时尚内容,为设计师、摄影师以及内容创作者提供了强大的工具,以更具创意和效率地展示和营销服装产品。

论文作者:Yunfang Niu,Lingxiang Wu,Dong Yi,Jie Peng,Ning Jiang,Haiying Wu,Jinqiao Wang

作者单位:Chinese Academy of Sciences;University of Chinese Academy of Sciences;Wuhan AI Research;Huazhong University of Science and Technology;Mashang Consumer Finance Co.

论文链接:http://arxiv.org/abs/2408.11553v1

内容简介:

1)方向:时尚图像编辑

2)应用:时尚编辑应用领域

3)背景:现有的时尚图像编辑方法通常需要辅助工具如分割器和关键点提取器,且缺乏灵活统一的框架。此外,这些方法在处理服装类型方面存在限制,因为大多数数据集只包含干净背景下的通用服装,如上衣、裤子和连衣裙。这些限制影响了方法在实际场景中的适用性。

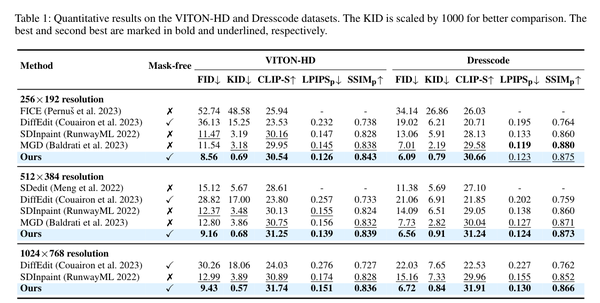

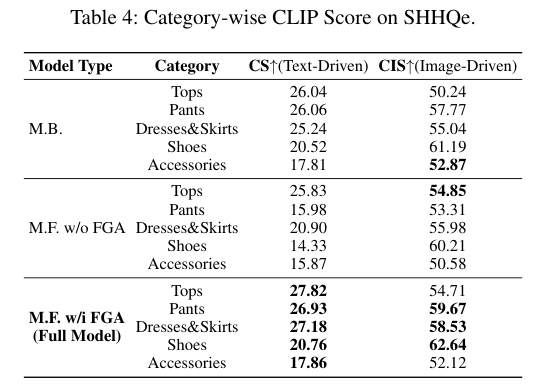

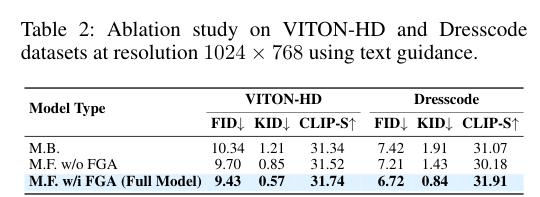

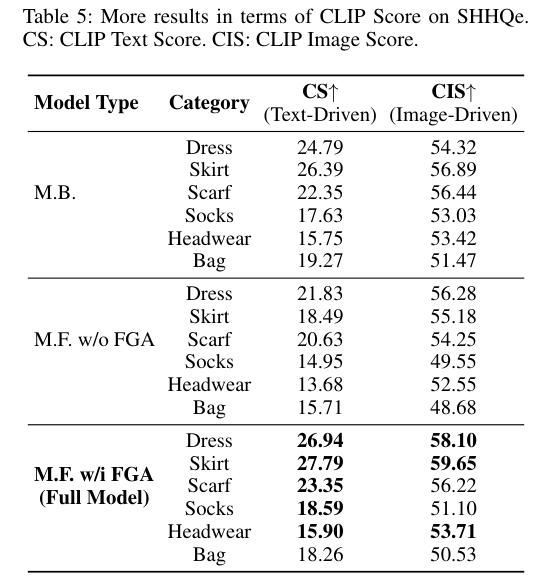

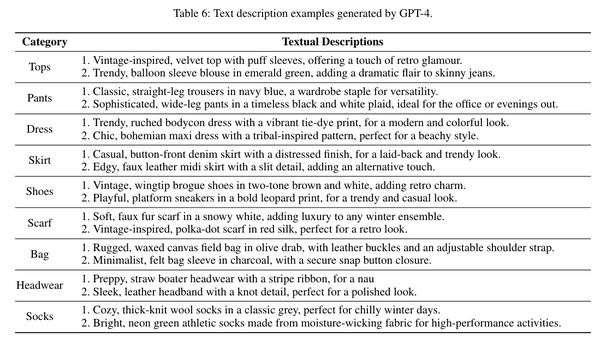

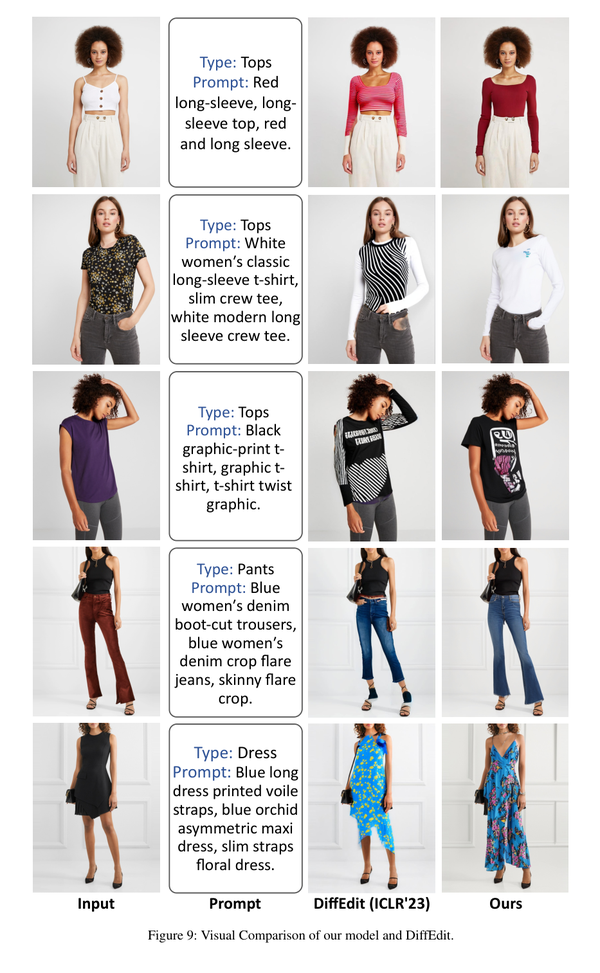

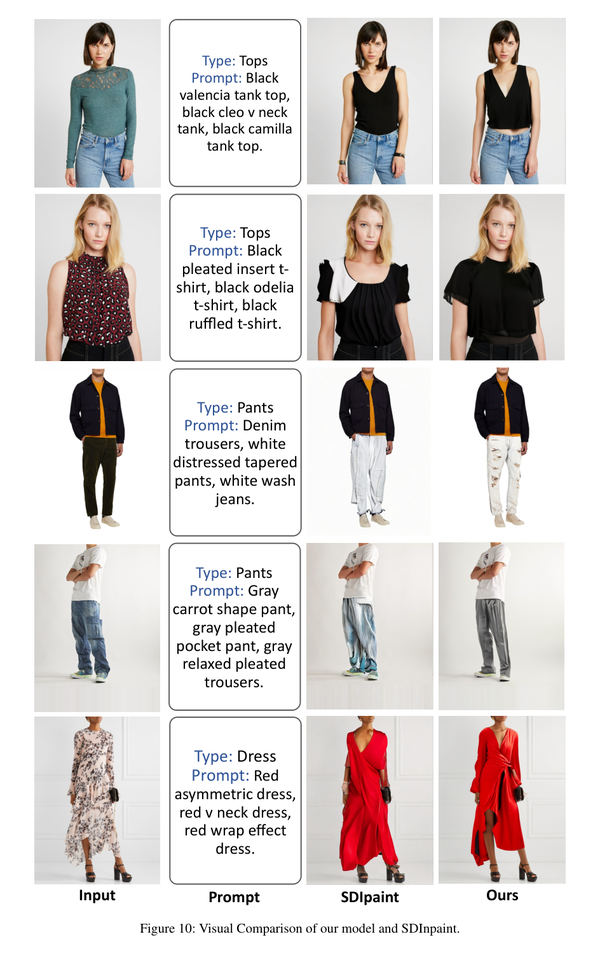

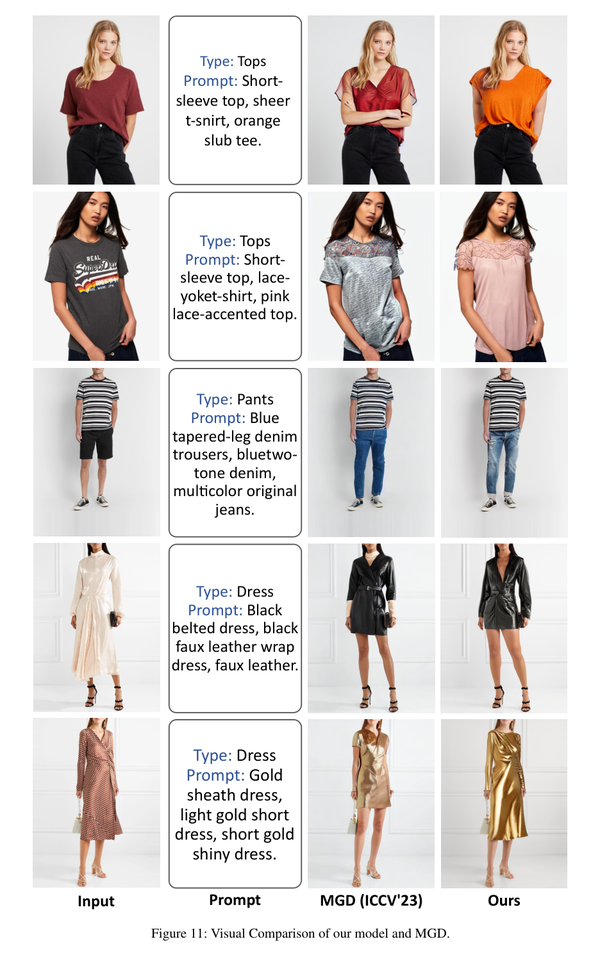

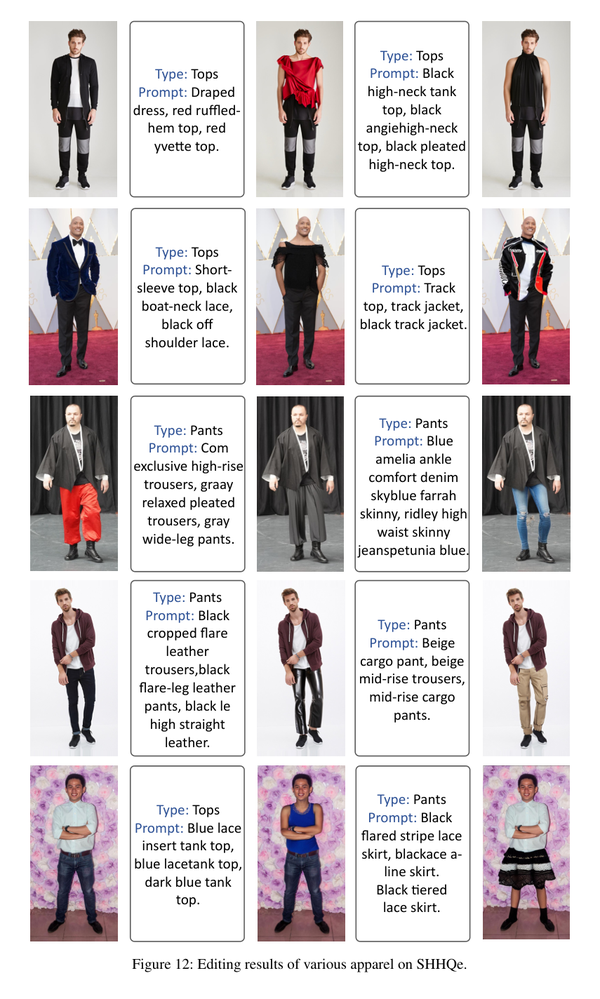

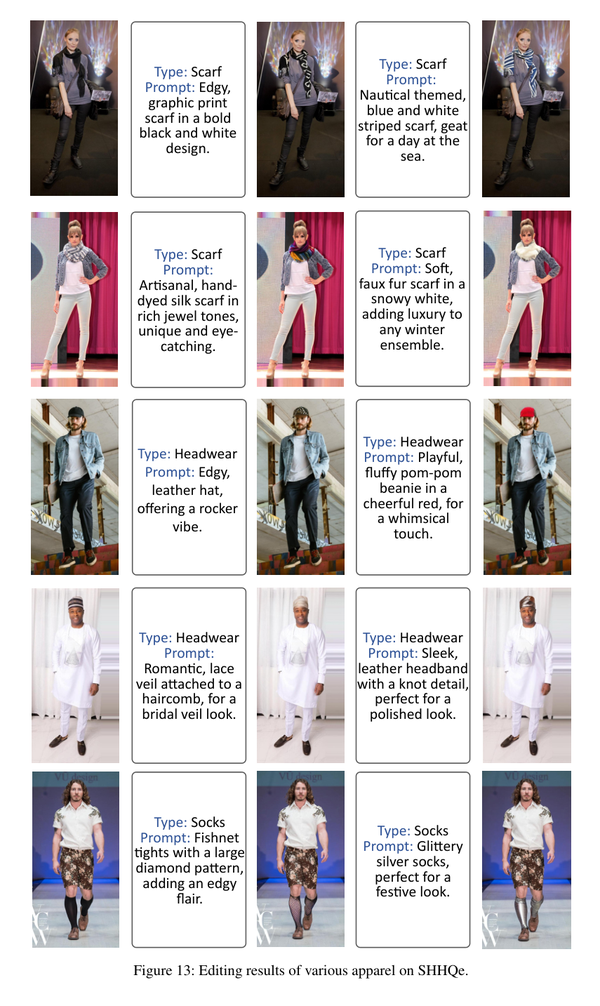

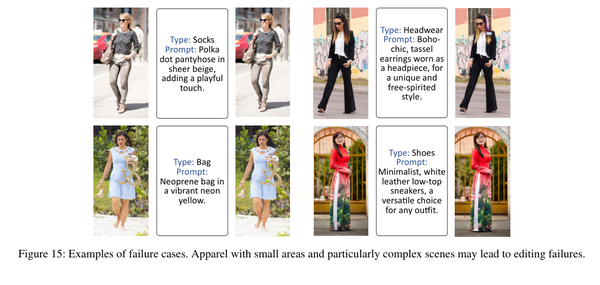

4)方法:为解决上述问题,研究首先扩展了现有人体生成数据集,涵盖了更多种类的服装和更复杂的背景。这些扩展的数据集包含了穿戴各种服装的人物,如上衣、裤子、连衣裙、裙子、头饰、围巾、鞋子、袜子和包包。此外,提出了AnyDesign,一种基于扩散模型的方法,支持在多种区域进行无掩模编辑。用户只需输入一个人像图像和相应的文本或图像提示。该方法还引入了Fashion DiT,并配备了Fashion-Guidance Attention (FGA) 模块,旨在融合显式服装类型和CLIP编码的服装特征。

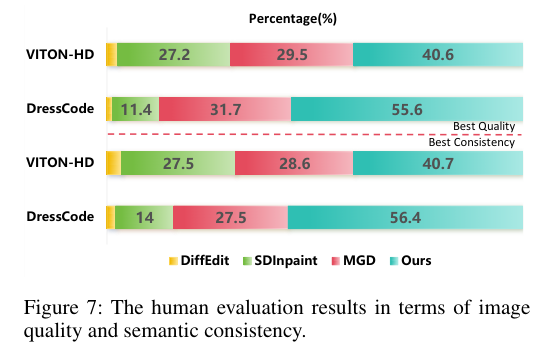

5)结果:定性和定量实验表明,所提出的方法在时尚图像编辑方面表现优异,生成的编辑效果高质量,并且超越了现有的文本引导时尚编辑方法。