笔记整理:李娟,浙江大学博士,研究方向为知识图谱表示学习

论文链接:https://arxiv.org/pdf/2208.07622.pdf

代码链接:https://github.com/TamSiuhin/KRACL

介绍

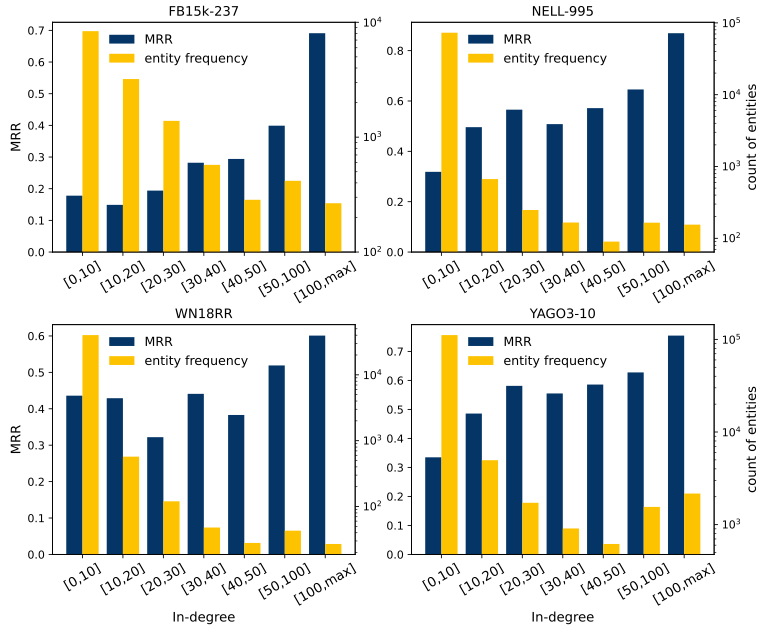

知识图谱(KG)通常是不完整的,知识表示学习(KGE)方法将知识图谱中实体和关系映射到低维向量空间,通过向量间的计算完成知识图谱补全等任务。下图展示了不同入度值范围下RotatE方法的MRR指标和数据集的实体出现频率统计,说明现有KG存在稀疏性,即KG中大部分实体的入度值较低,且已有KGE方法如RotatE在入度低的实体上预测结果表现较差。针对KG的稀疏性挑战,本文提出通过图上下文和对比学习缓解稀疏问题。

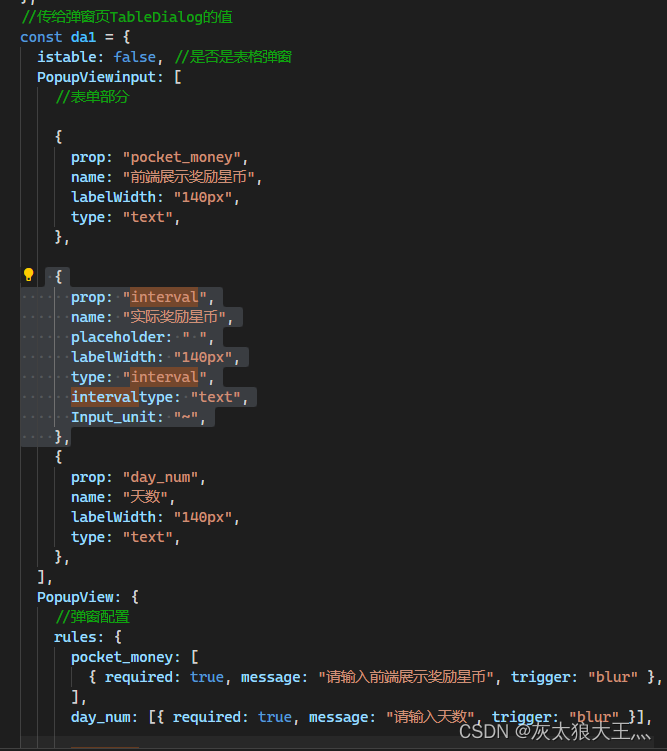

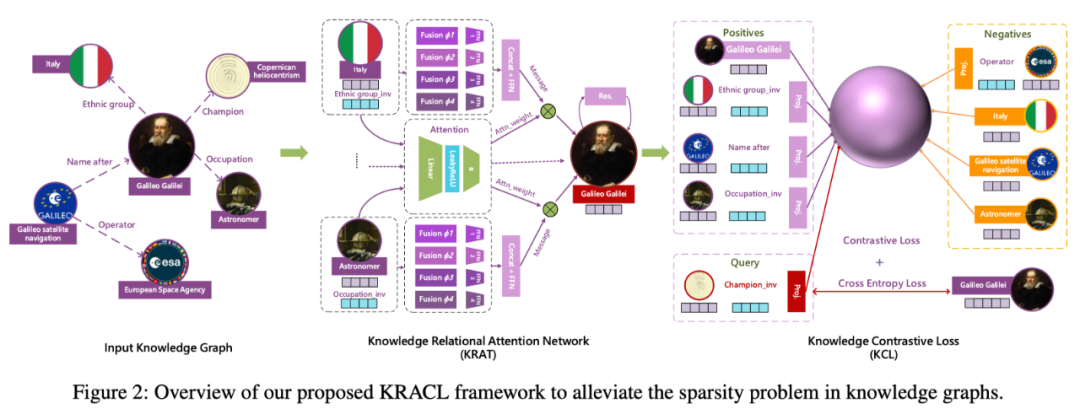

KRACL方法框架如下:

方法

主要包括两个模块:

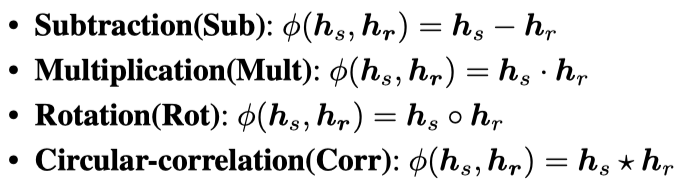

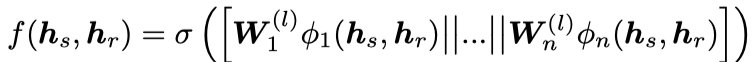

(1)KRAT(知识关系注意力网络):将邻居三元组映射到不同空间使用注意力机制完成聚合,模块捕获了不同上下文三元组的重要性。通过T层KRAT后,模块可捕获多跳上下文。该模块先使用不同的运算符将邻居关系-实体对映射到不同表示空间:

再将消息组合得到聚合消息:

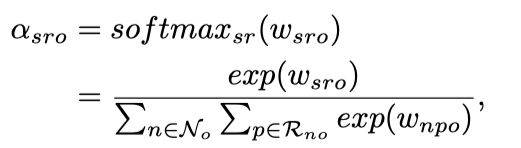

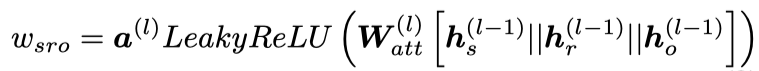

然后计算注意力分数:

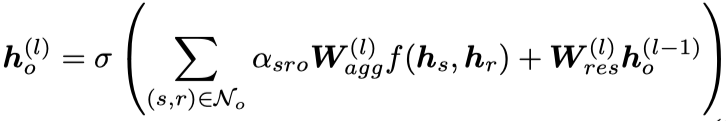

最后通过注意力机制聚合所有上下文信息,实体更新计算为:

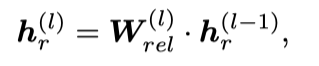

关系更新计算为:

通过KRAT获取实体和关系表示后输入ConvE计算预测损失:

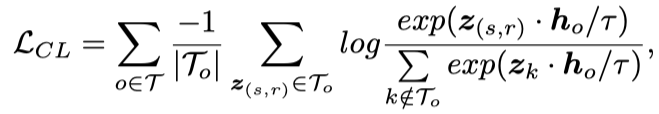

(2)KCL(知识对比损失):对比损失引入了更多负样本,丰富对稀疏实体的反馈。对比损失的计算为:

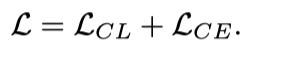

其中实体的正样本为实体本身及实体的邻居实体-关系对,负样本为除了实体外的其他实体。模型最终的损失函数定义为两部分损失之和:

实验

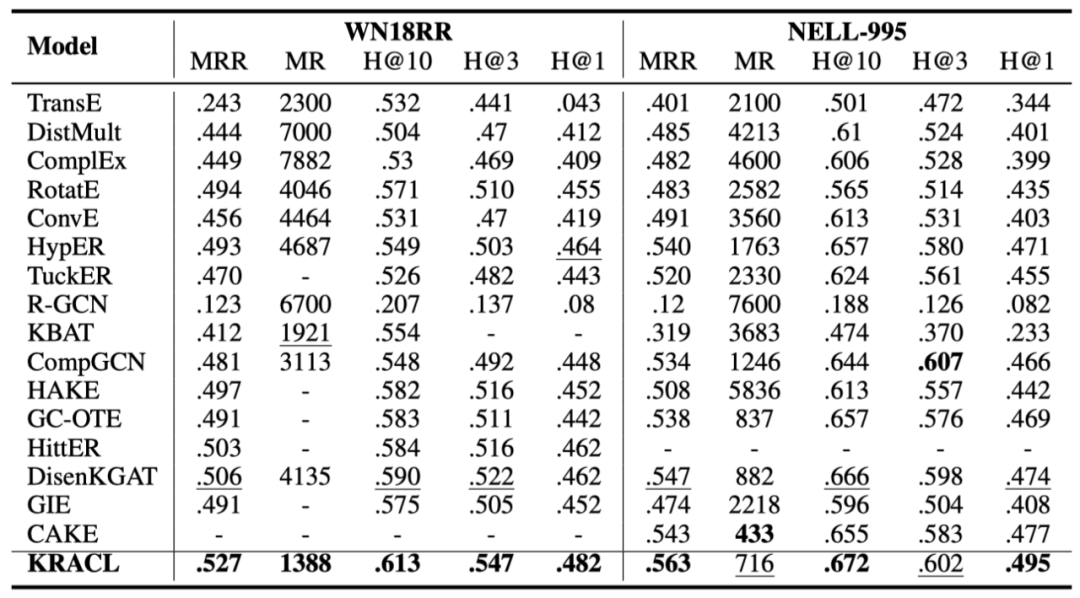

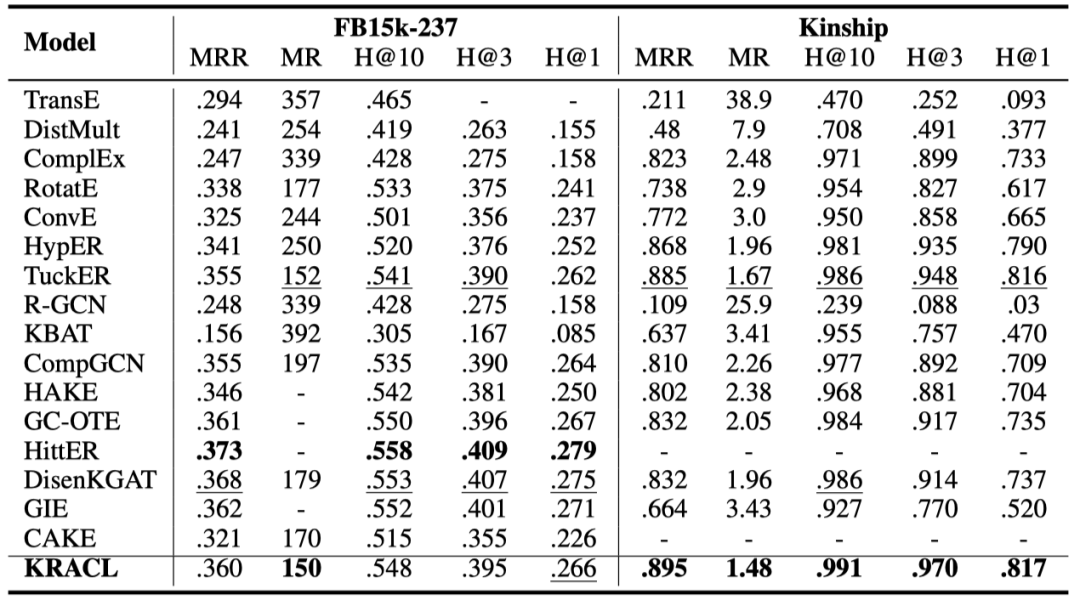

本文在稀疏数据集WN18RR和NELL-995,以及稠密数据集FB15K237和Kinship上完成了链接预测实验,证明了方法的有效性:

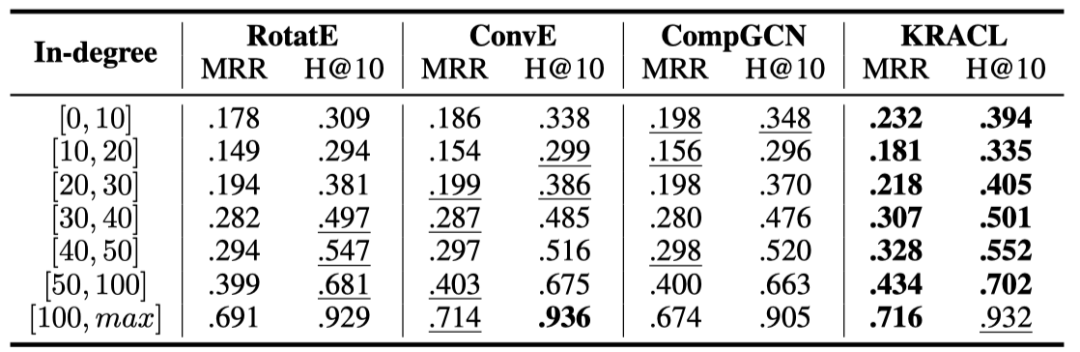

统计了不同入度范围实体的预测结果,KRACL对稀疏实体效果的提升明显:

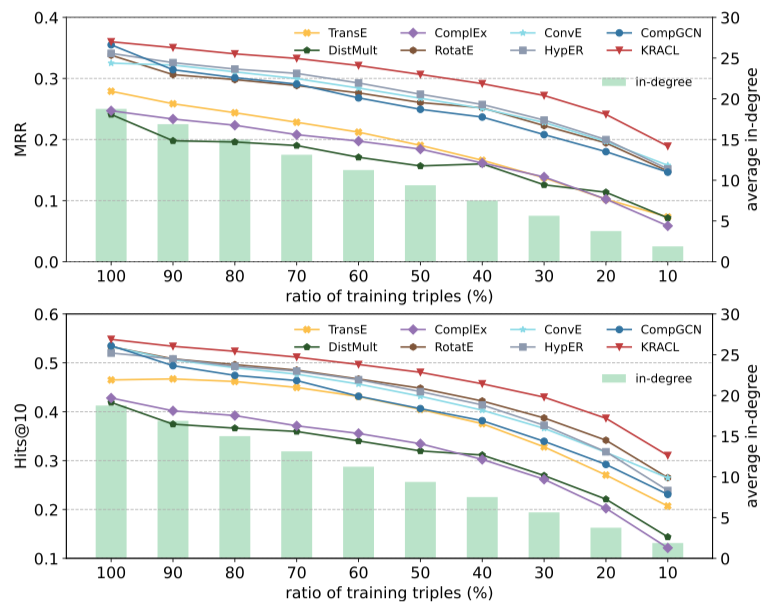

为进一步验证方法对稀疏性的缓解,统计了不同百分比训练集时模型的预测结果:

同时,本文还评估了不同GNN方法结合不同变换操作的效果验证了KRACL的有效性,通过消融实验验证了模块的有效性,以及通过在噪声数据集的预测结果验证了KRACL的鲁棒性。

OpenKG

OpenKG(中文开放知识图谱)旨在推动以中文为核心的知识图谱数据的开放、互联及众包,并促进知识图谱算法、工具及平台的开源开放。

点击阅读原文,进入 OpenKG 网站。