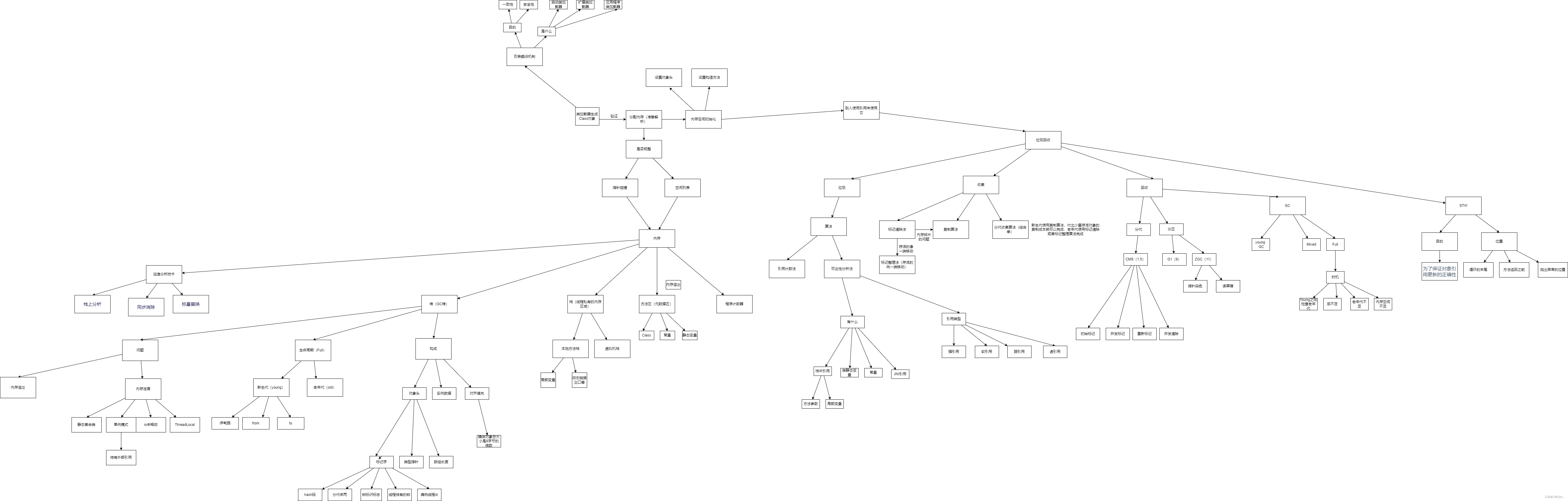

词元化(分词)

- BPE 分词

- WordPiece 分词

- Unigram 分词

- 分词器的选用

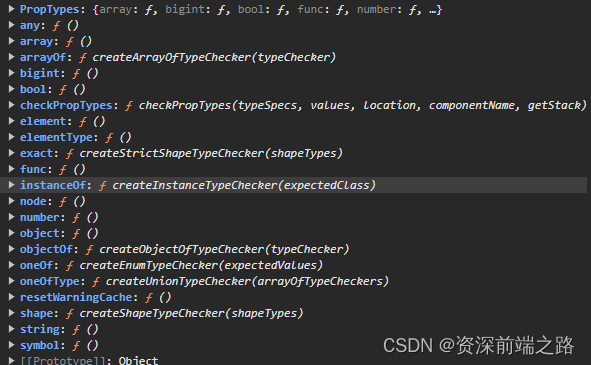

词元化(Tokenization)是数据预处理中的一个关键步骤,旨在将原始文本分割成模型可识别和建模的词元序列,作为大语言模型的输入数据。传统自然语言处理研究(如基于条件随机场的序列标注)主要使用基于词汇的分词方法,这种方法更符合人类的语言认知。然而,基于词汇的分词在某些语言(如中文分词)中可能对于相同的输入产生不同的分词结果,导致生成包含海量低频词的庞大词表,还可能存在未登录词(Out-of-vocabulary, OOV)等问题。因此,一些语言模型开始采用字符作为最小单位来分词。例如,ELMo 采用了 CNN 词编码器。最近,子词分词器(Subword Tokenizer)被广泛应用于基于 Transformer 的语言模型中,包括 BPE 分词、WordPiece 分词和 Unigram 分词三种常见方法。作为一个很好的学习资源,Hugging Face 也维护了一个在线自然语言处理课程1,其中的分词部分提供了非常具体的演示实例,我们推荐初学者可以参考学习。下面,我们简要介绍三种代表性的词元化方法。

BPE 分词

在 1994 年&