小罗碎碎念

今天和大家分享一篇2025-02-21发表于nature communications的文章,内容涉及病理+空转+单细胞。

从组织学图像推断细胞空间分布对癌症研究意义重大,但现有方法存在标注工作量大、分辨率或特征挖掘不足等局限。研究旨在开发一种高效准确的方法。

本文提出弱监督深度学习方法 HistoCell,基于多种癌症组织学图像,解耦形态特征与转录组表达数据关联。经特征提取、分层编码等流程,利用多方法获取弱监督标签,预测细胞类型、状态和空间网络。

| 作者身份 | 姓名 | 单位 |

|---|---|---|

| 第一作者 | Peng Zhang、Chaofei Gao | 清华大学自动化系生物信息学教研室/生物信息学教育部重点实验室/清华信息科学与技术国家实验室(筹) |

| 通讯作者 | Shao Li | 清华大学自动化系生物信息学教研室/生物信息学教育部重点实验室/清华信息科学与技术国家实验室(筹) |

在多种癌症组织数据上,HistoCell 性能超越现有方法且稳健。在空间转录组分析、组织架构注释、临床指标识别和生物标志物筛选等方面有应用潜力,虽有局限,但为空间生物学和临床医学研究提供了重要工具。

推文速览

一、文献概述

二、HistoCell概述

三、数据收集与预处理

四、HistoCell 复现流程概述

(注意,完整的项目复现流程,请关注后续的推送,本期推送只是介绍大致流程)

知识星球

如需获取推文中提及的各种资料,欢迎加入我的知识星球!

一、文献概述

“Systematic inference of super-resolution cell spatial profiles from histology images”发表于Nature Communications,提出了一种名为HistoCell的弱监督深度学习方法,能从组织学图像中推断超分辨率细胞空间分布,为癌症研究提供了有力工具。

- 研究背景:从组织学图像推断细胞空间分布对癌症诊疗意义重大。现有方法存在局限性,如完全监督模型需大量人工标注,基于空间转录组学的方法分辨率和细胞特征挖掘不足。

- HistoCell方法框架:基于弱监督学习,通过解耦组织学形态特征与空间转录组表达数据的关联,对9种癌症类型分别建立预训练模型。利用多方法获取弱监督标签,提取图像形态和拓扑特征并编码,最终预测细胞类型、状态和空间网络。

- 实验结果

- 基准分析:在多种癌症组织数据上,HistoCell预测细胞类型和状态的性能优异,超越现有方法,且对训练数据量、图像分辨率等变化稳健。

- 应用分析:在空间转录组数据分析中,HistoCell能增强细胞类型反卷积准确性;可准确注释组织架构,发现细微结构;能识别多种癌症的临床相关空间组织指标,用于预测化疗反应和预后;还能筛选与胃癌恶性转化风险相关的细胞群和指标。

- 研究结论:HistoCell可从组织学图像准确推断超分辨率细胞空间分布,在多方面有应用潜力。但该模型也存在局限,如受细胞分割影响、拓扑分析有局限等。总体而言,HistoCell为空间生物学和临床医学研究提供了重要工具 。

二、HistoCell概述

2-1:HistoCell的示意图

HistoCell是一种弱监督和无需注释的组织学图像分析方法,用于推断包含细胞类型、细胞状态及其在单个核水平的空间网络的超分辨率细胞空间剖面。

这张图展示了HistoCell方法的工作流程:

- 输入数据:针对九种不同的癌症类型,使用组织学图像作为输入。

- 处理过程:通过特征提取,获取细胞核形态特征和空间拓扑特征,再经过分层编码,依次确定细胞区室、细胞类型和细胞状态,从而得出细胞空间图谱。

- 应用方向:得到的细胞空间图谱可用于组织架构注释、识别临床相关的空间特征,以及基于图像的细胞标记物筛选 。

作为HistoCell方法合理性的提案,在本研究中引入了一个观点,即可以从以下三个角度确定组织学图像中每个核的细胞信息:

- 1)分割核本身的形态特征;

- 2)核与其空间邻域之间的拓扑特征;

- 3)核的细胞层次分类,包括细胞类型所属的组织区域以及细胞类型中的细胞状态或细胞亚群组成。

2-2:HistoCell的模型架构

作为预训练输入,HistoCell需要共注册高分辨率组织学图像的ST数据,以及匹配的scRNA-seq数据作为细胞类型和细胞状态解卷积的参考数据。

数据输入及前期处理

细胞分割(Cell segmentation):对组织学图像(Histology image)进行处理,将其分割成大小为256×256像素的小块,便于后续分析。

特征提取

- 图块特征提取(Tile feature extraction):利用ResNet - 18网络对分割后的图像图块提取特征。

- 细胞特征嵌入和拓扑特征提取:

- 细胞特征嵌入(Cell feature embedding):同样使用ResNet - 18网络对单个细胞图像进行特征提取和嵌入。

- 拓扑特征提取(Topological feature extraction):通过图注意力网络(GAT),基于细胞间的空间关系,提取细胞的拓扑特征,捕捉细胞之间的相互作用。

分层编码与弱监督学习

- 分层编码(Hierarchical encoding):将提取到的特征通过长短期记忆网络(LSTM)进行分层编码,整合不同层次的信息。

- 弱监督(Weak supervision):在整个过程中利用弱监督学习的方式,减少对大量标注数据的依赖。

线性投影与输出

- 线性投影(Linear projection):编码后的特征经过线性投影层,分别预测组织层面信息、细胞类型(Cell type)和细胞状态(Cell state)。

反卷积分析

- 结合空间数据(Spatial data)中的基因表达(Gene expression)信息,以单细胞RNA测序(scRNA - seq)数据作为参考,通过细胞类型反卷积(Cell - type deconvolution)和细胞状态反卷积(Cell - state deconvolution),得到不同细胞类型和状态的比例,进一步分析细胞组成和状态信息。

HistoCell从组织学图像瓦片中提取单个分割细胞核的形态和拓扑特征,并生成单核水平的细胞层次信息,以解卷积结果作为弱监督标签。GAT图注意力变换器,LSTM长短期记忆。

三、数据收集与预处理

3-1:空间转录组数据

本研究为了进行模型的预训练和内部验证,从公开可获取的数据资源中收集了一系列与高分辨率组织学图像共注册的空间转录组学(ST)数据集(补充表1)。

表中还提供了数据链接,此处仅选择一个作为演示。

共收集了9种癌症类型的99个样本,以及152,168个点,其中25个样本来自甲醛固定石蜡包埋(FFPE)组织,其余74个样本来自冷冻组织。

此外,为了训练与胃癌发生相关的模型,作者对两个早期恶性肿瘤FFPE样本进行了空间转录组测序(10× Genomics),这些样本中同时存在低级别异型增生灶(GSE287979),从而生成了一个与高分辨率病理图像共注册的胃癌相关ST数据集。

在反卷积之前,移除了基因表达水平低的点(总计数<3),并将原始表达矩阵进行了归一化和对数转换。

收集的点位水平ST数据的详细信息总结在补充表1中。

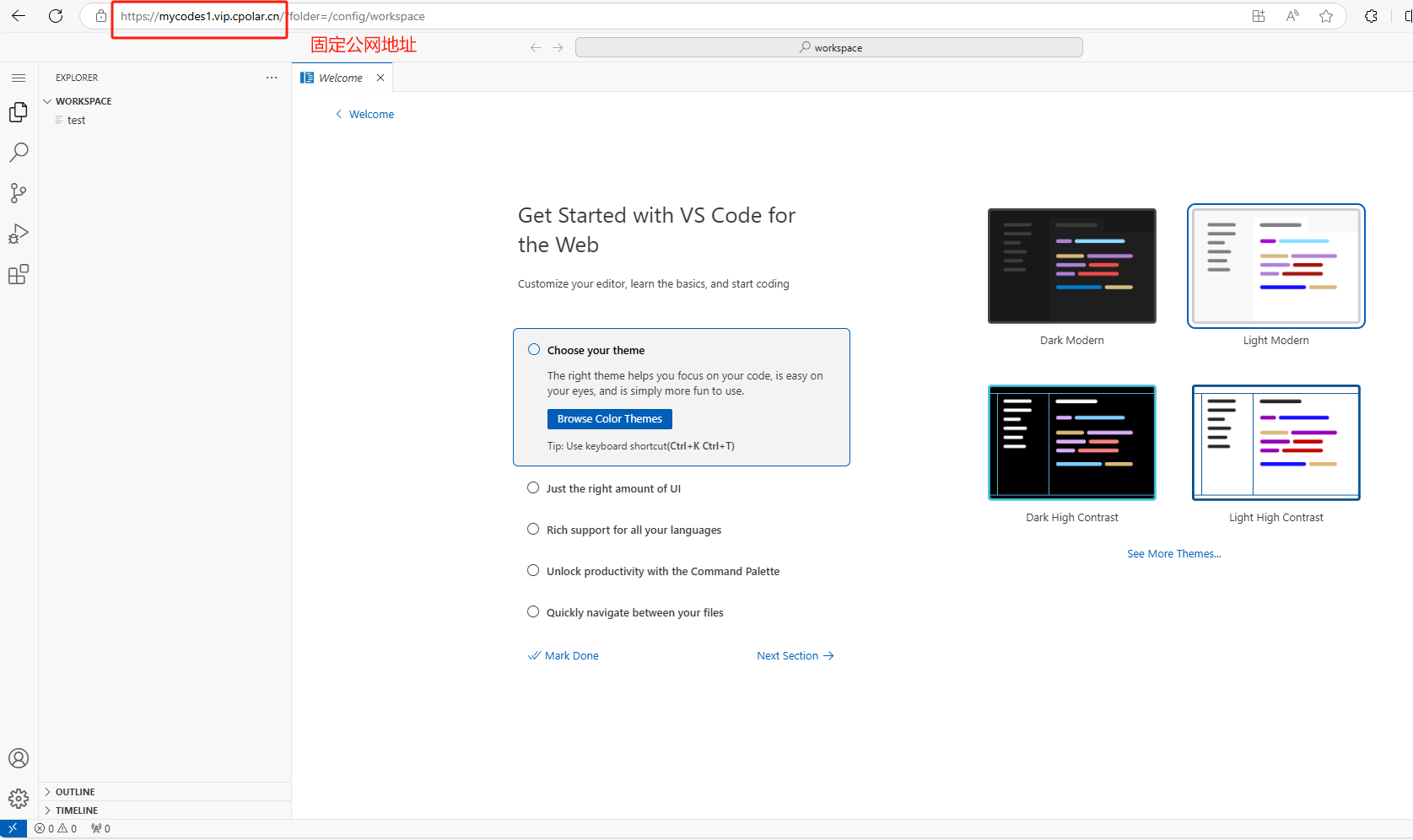

数据集作者也已经上传,界面如下。

为了评估HistoCell在单核水平细胞类型预测和独立ST数据反卷积增强方面的性能,作者还收集了来自10× Xenium平台的乳腺癌ST数据(GSE243280),该数据集包含共注册的高分辨率组织学图像和单细胞水平表达数据。

通过Xenium分析仪,在整个组织切片上以单细胞分辨率构建了空间转录组图谱,通过解码目标基因的光学特征。

在复制1中检测到167,780个细胞,在复制2中检测到118,752个细胞,两者均包含313个测序基因。每个单细胞的类型根据标志基因进行注释。

3-2:单细胞RNA测序数据

为了对点位水平ST数据在模型预训练过程中进行细胞类型反卷积分析,共收集了9个与ST数据匹配的单细胞RNA测序(scRNA-seq)数据集作为参考。

每个数据集,作者导出表达矩阵作为反卷积分析的输入,并收集相应研究中注释的细胞类型。同样,作者也进行了表达归一化,并移除了总表达计数低于3的细胞。

收集的scRNA-seq数据集的详细信息总结在补充表2中。

3-3:组织学图像数据

在本研究中,为了进行模型评估和应用分析,从多个来源收集了高分辨率的组织学图像,主要为全切片图像(WSI),包括公开可获取的图像数据资源(TCGA, PanNuke, Camelyon16)以及与ST数据共注册的图像(10× Visium和10× Xenium)。

通常,来自公开可获取图像数据资源的组织学图像可以分为三类:

- 带有切片级别标签/表型的图像(TCGA)

- 带有组织区域注释的图像(Camelyon16)

- 带有单核水平手动注释的图像(PanNuke)

对于TCGA数据集,作者收集了HistoCell涉及的8种癌症类型(BRCA, COAD, OVC, PRAD, PDAC, LIHC, KIRC和LUSC)的组织学图像及相应的临床结果,以进行泛癌症细胞核形态学特征分析和临床相关的空间组织指标(SOIs)的识别。

Camelyon16是一个淋巴结组织学图像数据集,包含每个浸润性乳腺癌区域的 manual annotations。因此,作者从训练集中分别收集了100个转移性和100个正常样本,以进行组织结构注释和转移相关SOIs的识别。

至于PanNuke数据集,从19种组织类型中收集了7961个256×256像素的图像块,所有图像块均手动注释了单核水平细胞类型,包括肿瘤细胞、炎症细胞、连接/软组织细胞、死细胞、上皮细胞和背景。

在本研究中,作者使用了跨9种癌症类型的5002个图像块作为模型评估的外部验证数据集。

四、HistoCell 复现流程概述

4-1:项目概述

目标

通过弱监督深度学习,仅利用组织病理学图像解析 层次化空间细胞信息,包括:

- 组织区域划分(如肿瘤、间质)、

- 单细胞类型(如癌细胞、免疫细胞)、

- 细胞状态(如代谢活跃状态)。

弱监督来源

使用空间转录组(ST)数据解卷积得到的细胞组成作为监督信号,无需单细胞级别的标注。

优势

支持全切片图像(WSI)处理,可生成超分辨率空间细胞图谱。

4-2:环境配置

依赖项

通过 pip install -r requirements.txt 安装,需确保 Python 环境(未指定版本,建议 ≥3.8)。

硬件建议

GPU 加速(WSI 处理及模型训练均需高性能计算)。

4-3:数据准备与预处理

数据要求

训练阶段

输入数据:

- 配对的 scRNA-seq 和 ST 数据:用于解卷积获取细胞组成。

- 高分辨率组织病理图像:需根据 ST 数据的坐标切割为小块(代码示例见

./tutorial/tutorial.ipynb)。

解卷积工具:

支持 CARD、RCTD、Tangram、Cell2location 等方法,用户可自行选择。

推理阶段

输入数据:仅需组织病理图像,支持两种格式:

- WSI 文件(.svs/.tif):需用 CLAM 工具分割为 256x256 像素的块。

- 分块图像(任意格式):直接输入。

关键预处理步骤

- 细胞分割:

- 推荐工具:HoVerNet,输出 JSON 格式的细胞轮廓、中心点、类型概率等信息。

- 替代方案:Mask R-CNN、Cerbebrus 等。

- 数据格式:

- 分块图像、JSON 分割结果、解卷积的细胞比例需对齐。

4-4:模型预训练

- 核心脚本:

train.py(需配置configs.py参数)。 - 参数示例:

python train.py \ --model Breast_Benchmark_H1 \ # 模型名称 --tissue BRCA \ # 组织类型(如乳腺癌) --deconv RCTD \ # 解卷积方法 --k_class 6 \ # 细胞类型/状态类别数 --tissue_compartment ./tcs/tissue_compartment_addtype.json # 组织区域定义文件 - 扩展功能:

- 交叉验证:

train_cv.py(需指定折数--folder 10)。 - 细胞状态预测:

train_state.py和train_state_cv.py。

- 交叉验证:

- 注意:训练代码暂未公开,需等待论文发表。

4-5:模型推理

- 预训练模型与数据:需从 Google Drive 下载并置于

./demo。 - 运行命令:

python infer.py \ --model Breast_Benchmark_H1 \ # 预训练模型名称 --epoch 30 \ # 训练轮次 --omit_gt # 忽略真实标签(仅推理) - 输出:预测结果以字典形式存储为

.pkl文件,包含细胞类型/状态的像素级分布。

4-6:结果与应用

可视化展示(见

tutorial.ipynb)

- 组织区域划分:区分肿瘤、间质等区域(图

tissue_compartment.jpg)。 - 单细胞类型:癌细胞(红)、间质细胞(蓝)、巨噬细胞(绿)的空间分布(图

cell_type1.jpg)。 - 细胞状态:代谢或功能状态的可视化(图

cell_state.jpg)。

应用场景

- 精细组织注释:聚类细胞生成亚区域,识别微小病灶(图

segmentation.jpg)。 - 细胞类型解卷积:结合形态学与表达数据提升精度(图

deconvolution1.jpg)。 - 空间生物标志物:通过细胞空间网络关联临床预后(图

biomarker.jpg)。

4-7:注意事项与潜在问题

- 数据获取:

- scRNA-seq 和 ST 数据需与病理图像空间对齐,需自行处理坐标匹配。

- 硬件限制:

- WSI 处理需高性能 GPU,内存需求较高(建议 ≥16GB 显存)。

- 代码依赖:

- 当前训练代码未公开,推理需依赖预训练模型。

- 解卷积方法选择:

- 不同方法(如 RCTD vs. Tangram)可能影响监督信号质量,需实验验证。

- 结果分析:

.pkl文件需自行解析,官方未提供可视化工具。

结束语

本期推文的内容就到这里啦,如果需要获取医学AI领域的最新发展动态,请关注小罗的推送!如需进一步深入研究,获取相关资料,欢迎加入我的知识星球!