文章目录

- 💯前言

- 💯抖音上的爆火AI数字人视频

- 💯注册HeyGen账号

- 💯复刻抖音爆款AI数字人

- 💯最终生成效果

- 💯小结

对比原视频效果:

左为原视频,右为本文生成

本文生成输入视频的完整效果:(注意:背景音乐是后期加上去的)

本文数字人视频完整生成结果

💯前言

- 随着人工智能技术的迅速发展,数字人不再是科幻电影中的虚构产物,而是逐渐走进了我们的日常生活。曾经只有大型企业和专业团队才能运用的这项技术,如今已经触手可及,大众也可以轻松使用。无论是内容创作者、企业宣传,还是个人娱乐,数字人都提供了一种全新的表达方式,让每个人都能够通过人工智能的力量,打造出独具特色的作品。

HeyGen

💯抖音上的爆火AI数字人视频

-

数字人在抖音上是一种非常新颖且有吸引力的表现形式。由于其独特的视觉效果和流畅的交互体验,AI数字人迅速成为了短视频平台上的热门趋势。不论是用于知识分享、品牌宣传,还是娱乐内容,这种技术都为创作者带来了前所未有的可能性。它不仅突破了传统真人视频的限制,还能够以高效、低成本的方式实现个性化的内容表达,吸引了大量用户的关注和互动。

-

本文将以这个点赞量12.6w的爆款数字人视频为例,手把手教你如何从零开始,初步体验AI数字人技术的入门步骤。这篇文章适合新手,内容简单易懂,不需要你具备太多技术背景。本文将带你了解如何选择基础的AI工具、简单地调整内容呈现方式,并进行基本的后期处理。通过这篇入门级教程,你将轻松掌握AI数字人制作的基础概念,开启你的数字创作之旅!

💯注册HeyGen账号

-

进入HeyGen官网点击Get started。

-

点击注册,如果有Google邮箱的话可以直接用Google

-

填写邮箱

-

登录邮箱拿到验证码填入

-

设置密码,长度必须为 8 到 35 个字符,包括大写、小写字母、数字和特殊字符。

-

注册成功后会跳转到HeyGen主界面,注意:一个账号一个月可以免费生成三次视频。

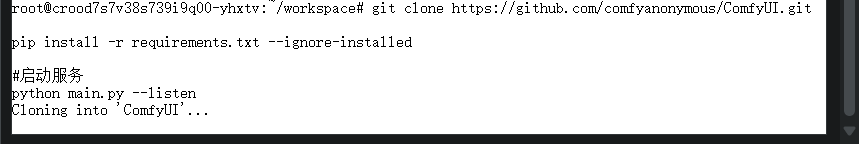

💯复刻抖音爆款AI数字人

-

在HeyGen主界面中,您可以轻松地开始您的视频制作。进入界面后,点击左侧菜单中的“Create video”按钮,即“创建视频”,如图所示。

-

在选择视频布局时,您可以根据需求选择横屏或竖屏模式。为了更好地展示数字人,我们建议选择竖屏模式。在创建视频的界面中,点击“Use portrait”按钮,即“使用肖像”选项

-

在这一步骤中,您需要选择一个合适的头像来作为视频中的数字人。进入头像选择界面后,点击“Studio Avatar”(工作室头像)选项

-

在选择头像的界面中,往下滚动页面,找到与爆款视频相同的数字人形象,如图中红框所示。

Looking for a wife? Must find a woman with a big temper. No temper is like a glass of water. Quench thirst, but tasteless. A woman with a temper is not the same. Her bark is worse than her bite. She is particularly kind. She worries about her family at home and her temper comes quickly and goes quickly. She's like a strong drink you can't forget. If you do, cherish it. Do you understand?

-

在这一步中,需要为您的数字人输入与目标视频相同的文案内容。点击左侧菜单中的“Script 脚本”选项,在文本框中输入视频中使用的文案内容,如上所示。

-

在这一步中,为了让数字人能够更好地传达视频内容,您可以选择合适的语音选项。点击“Script 脚本”界面中的语音选择区域,如图所示,可以从多个语音选项中进行挑选。不同的语音有着不同的语调、情感和节奏,选择一个与视频内容最契合的语音类型,可以让数字人的表现更加自然和有吸引力。

- 这里推荐用

ctrl+G搜索Molly-Newscaster更方便快捷

- 在调整语音设置时,您可以根据需要修改数字人的语速,使其更符合视频的整体节奏和氛围。在“Script 脚本”界面中,点击语音设置旁边的选项按钮,进入“Voice settings 语音设置”菜单,如图所示。

- 差不多是设置1.5倍速

-

text模块可在视频里面加文本和标识。

-

为了确保数字人的画面与语音完美同步,您需要将时间轴上的数字人画面时长调整为与说话时间一致。

-

在完成所有设置并确认无误后,最后一步就是提交生成您的AI数字人视频。在编辑页面的右上角,点击“Submit 提交”按钮,如图所示。系统将开始处理您所设定的脚本、语音和画面,生成最终的视频。

-

在视频生成完成后,您可以在HeyGen平台的主界面中看到所有已生成的视频,下载到本地。

💯最终生成效果

本文生成的数字人视频最终效果:(注意:背景音乐是后期加上去的)

本文数字人视频完整生成结果

💯小结

-

虽然这篇文章仅是入门级别的教程,但它展示了数字人技术的无限潜力。我们可以看到,抖音上的爆款数字人视频不仅仅是娱乐内容的呈现,更是新媒体创作的一个缩影。这些技术使得创作者能够以更具创意和个性化的方式表达自我,同时也大大降低了制作门槛。 -

在创作过程中,我们意识到,无论是内容创作者还是企业推广,掌握AI数字人技术都是一个值得尝试的方向。它不仅能够提升内容的吸引力,还能为用户带来独特的体验。我希望这篇文章能为那些和我一样对数字人技术感兴趣的朋友提供帮助,让大家在数字创作的世界中找到属于自己的风格。

-

继续探索、不断尝试,我们都可以成为数字时代的创作者!希望你在阅读后也能感受到AI数字人带来的乐趣和可能性,期待看到更多精彩的数字人作品!

import tensorflow as tf;from tensorflow.keras import layers;import numpy as np;import matplotlib.pyplot as plt;np.random.seed(42);tf.random.set_seed(42);latent_dim=100;image_size=64;batch_size=64;epochs=10000;def build_generator():model=tf.keras.Sequential();model.add(layers.Dense(8*8*256,use_bias=False,input_shape=(latent_dim,)));model.add(layers.BatchNormalization());model.add(layers.LeakyReLU());model.add(layers.Reshape((8,8,256)));model.add(layers.Conv2DTranspose(128,(5,5),strides=(2,2),padding='same',use_bias=False));model.add(layers.BatchNormalization());model.add(layers.LeakyReLU());model.add(layers.Conv2DTranspose(64,(5,5),strides=(2,2),padding='same',use_bias=False));model.add(layers.BatchNormalization());model.add(layers.LeakyReLU());model.add(layers.Conv2DTranspose(3,(5,5),strides=(2,2),padding='same',use_bias=False,activation='tanh'));return model;def build_discriminator():model=tf.keras.Sequential();model.add(layers.Conv2D(64,(5,5),strides=(2,2),padding='same',input_shape=[image_size,image_size,3]));model.add(layers.LeakyReLU());model.add(layers.Dropout(0.3));model.add(layers.Conv2D(128,(5,5),strides=(2,2),padding='same'));model.add(layers.LeakyReLU());model.add(layers.Dropout(0.3));model.add(layers.Conv2D(256,(5,5),strides=(2,2),padding='same'));model.add(layers.LeakyReLU());model.add(layers.Dropout(0.3));model.add(layers.Flatten());model.add(layers.Dense(1));return model;def discriminator_loss(real_output,fake_output):real_loss=tf.keras.losses.BinaryCrossentropy(from_logits=True)(tf.ones_like(real_output),real_output);fake_loss=tf.keras.losses.BinaryCrossentropy(from_logits=True)(tf.zeros_like(fake_output),fake_output);return real_loss+fake_loss;def generator_loss(fake_output):return tf.keras.losses.BinaryCrossentropy(from_logits=True)(tf.ones_like(fake_output),fake_output);generator_optimizer=tf.keras.optimizers.Adam(1e-4);discriminator_optimizer=tf.keras.optimizers.Adam(1e-4);generator=build_generator();discriminator=build_discriminator();@tf.function;def train_step(images,generator,discriminator,batch_size,latent_dim):noise=tf.random.normal([batch_size,latent_dim]);with tf.GradientTape()as gen_tape,tf.GradientTape()as disc_tape:generated_images=generator(noise,training=True);real_output=discriminator(images,training=True);fake_output=discriminator(generated_images,training=True);gen_loss=generator_loss(fake_output);disc_loss=discriminator_loss(real_output,fake_output);gradients_of_generator=gen_tape.gradient(gen_loss,generator.trainable_variables);gradients_of_discriminator=disc_tape.gradient(disc_loss,discriminator.trainable_variables);generator_optimizer.apply_gradients(zip(gradients_of_generator,generator.trainable_variables));discriminator_optimizer.apply_gradients(zip(gradients_of_discriminator,discriminator.trainable_variables));return gen_loss,disc_loss;(train_images,train_labels),(_,_)=tf.keras.datasets.cifar10.load_data();train_images=train_images.reshape(train_images.shape[0],image_size,image_size,3).astype('float32');train_images=(train_images-127.5)/127.5;train_dataset=tf.data.Dataset.from_tensor_slices(train_images).shuffle(60000).batch(batch_size);def train(generator,discriminator,dataset,epochs,latent_dim,batch_size):for epoch in range(epochs):for image_batch in dataset:gen_loss,disc_loss=train_step(image_batch,generator,discriminator,batch_size,latent_dim);if epoch%100==0:print(f"Epoch {epoch}, Gen Loss: {gen_loss}, Disc Loss: {disc_loss}");generate_and_save_images(generator,epoch,latent_dim);def generate_and_save_images(model,epoch,latent_dim):noise=tf.random.normal([16,latent_dim]);generated_images=model(noise,training=False);fig=plt.figure(figsize=(4,4));for i in range(generated_images.shape[0]):plt.subplot(4,4,i+1);plt.imshow((generated_images[i]*127.5+127.5).astype(np.uint8));plt.axis('off');plt.savefig(f'generated_images_epoch_{epoch}.png');plt.show();train(generator,discriminator,train_dataset,epochs,latent_dim,batch_size)

![[PICO VR眼镜]眼动追踪串流Unity开发与使用方法,眼动追踪打包报错问题解决(Eye Tracking/手势跟踪)](https://i-blog.csdnimg.cn/direct/63442aacb4c548288c3041b3de670fe9.png)