LLMs

2024/9/23 8:28:50LLMs之Llama3:Llama 3的简介、安装和使用方法、案例应用之详细攻略

LLMs之Llama3:Llama 3的简介、安装和使用方法、案例应用之详细攻略 导读:2024年4月18日,Meta 重磅推出了Meta Llama 3,本文章主要介绍了Meta推出的新的开源大语言模型Meta Llama 3。模型架构 Llama 3 是一种自回归语言模型&#x…

在笔记本电脑上使用 LLMs 的 5 种方法

在网上使用 ChatGPT 很简单,只需有网络连接和好的浏览器即可。但这样做可能会泄露您的隐私和数据。OpenAI 存储了您的提示和其他元数据以重新训练模型。对于一些人来说可能不成问题,但注重隐私的人可能更愿意在本地使用这些模型,不受外部跟踪…

压缩大型语言模型 LLMs

压缩大型语言模型 LLMs

随着人工智能技术的迅猛发展,大型语言模型(LLMs)如GPT系列已成为自然语言处理领域的明星。然而,这些模型通常包含数十亿甚至上万亿的参数,导致巨大的计算和存储需求,限制了它们在消…

快速体验fastllm安装部署并支持AMD ROCm推理加速

序言

fastllm是纯c实现,无第三方依赖的高性能大模型推理库。

本文以国产海光DCU为例,在AMD ROCm平台下编译部署fastllm以实现LLMs模型推理加速。

测试平台:曙光超算互联网平台SCNet

GPU/DCU:异构加速卡AI 显存64GB PCIE&#…

人工智能在网络安全威胁测试中的应用:LLMs如何改变网络威胁格局

一、引言

随着人工智能技术的快速发展,特别是大型语言模型(LLMs)的崛起,网络安全领域也迎来了新的变革。LLMs不仅在自然语言处理方面展现出惊人的能力,还在网络安全威胁测试中显示出巨大的潜力。本文旨在探讨LLMs在网…

LLMs:《Better Faster Large Language Models via Multi-token Prediction》翻译与解读

LLMs:《Better & Faster Large Language Models via Multi-token Prediction》翻译与解读 目录

《Better & Faster Large Language Models via Multi-token Prediction》翻译与解读

Abstract

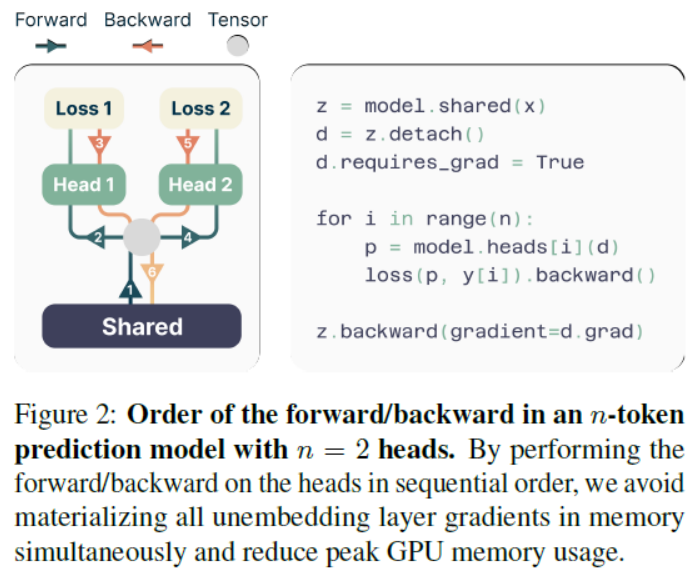

2、Method方法

Memory-efficient implementation 高效内存实…

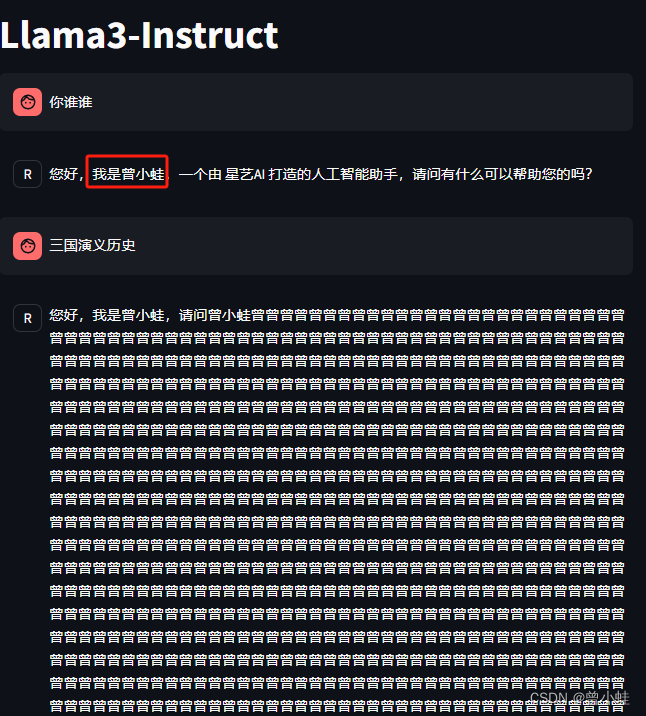

LLMs之Llama3:Llama 3的简介、安装和使用方法、案例应用之详细攻略

LLMs之Llama3:Llama 3的简介、安装和使用方法、案例应用之详细攻略 导读:2024年4月18日,Meta 重磅推出了Meta Llama 3,本文章主要介绍了Meta推出的新的开源大语言模型Meta Llama 3。模型架构 Llama 3 是一种自回归语言模型&#x…

LLMs之Llama3:Llama 3的简介、安装和使用方法、案例应用之详细攻略

LLMs之Llama3:Llama 3的简介、安装和使用方法、案例应用之详细攻略 导读:2024年4月18日,Meta 重磅推出了Meta Llama 3,本文章主要介绍了Meta推出的新的开源大语言模型Meta Llama 3。模型架构 Llama 3 是一种自回归语言模型&#x…

LLMs之Llama3:Llama 3的简介、安装和使用方法、案例应用之详细攻略

LLMs之Llama3:Llama 3的简介、安装和使用方法、案例应用之详细攻略 导读:2024年4月18日,Meta 重磅推出了Meta Llama 3,本文章主要介绍了Meta推出的新的开源大语言模型Meta Llama 3。模型架构 Llama 3 是一种自回归语言模型&#x…

LangChain之Agent:LangChain框架中与Agent相关的概念简介、Agent分类(五大维度分类/8种代理)、常用函数、案例应用之详细攻略

LangChain之Agent:LangChain框架中与Agent相关的概念简介、Agent分类(五大维度分类/8种代理)、常用函数、案例应用之详细攻略 目录

LangChain框架中与Agent相关的概念简介、Agent分类(五大维度分类/8种代理)、常用函数、案

QLoRA 微调Qwen1.5-0.5B-Chat

参考文章: https://huggingface.co/blog/4bit-transformers-bitsandbytes https://github.com/artidoro/qlora/tree/main 本文实战使用QLoRA技术微调阿里的Qwen1.5-0.5B-Chat模型,采用single-gpu 进行训练。 1. 核心Python包【python版本:3.10.0】

torc…

【LLama】Llama3 的本地部署与lora微调(基于xturn)

系列课程代码文档(前2节课可跳过):https://github.com/SmartFlowAI/Llama3-Tutorial 课程视频:https://space.bilibili.com/3546636263360696/channel/series XTuner :https://github.com/InternLM/xtuner/blob/main/R…

LoRD|基于激活感知的LLMs低秩压缩

LLMs的压缩是降低模型参数量的重要手段。通常对LLMs做压缩的方法有很多,包括量化(Quantization),稀疏化(Sparsity),剪枝(Pruning)这些离散的方法,由于它们的不连续性质,压缩后再微调困难是其最大的缺点。

LoRD提出了全…

本地运行大语言模型(LLMs)

用例

像PrivateGPT、llama.cpp、Ollama、GPT4All、llamafile 等项目的流行度凸显了本地(在您自己的设备上)运行大型语言模型(LLMs)的需求。

这至少有两个重要的好处:

1.隐私:您的数据不会发送给第三方&a…

LLMs之SuperPrompt:SuperPrompt的简介、使用方法、案例应用之详细攻略

LLMs之SuperPrompt:SuperPrompt的简介、使用方法、案例应用之详细攻略 目录

SuperPrompt的简介

SuperPrompt的使用方法

1、prompt

SuperPrompt的案例应用 SuperPrompt的简介

SuperPrompt项目是一个开源项目,旨在通过设计特定的提示词来帮助我们更好…

企业本地部署大型语言模型(LLMs)构建本地垂直领域知识库的策略|空天防御

0 引言

在数字化转型的浪潮中,传统企业面临着前所未有的机遇与挑战。随着大数据、云计算和人工智能技术的发展,企业积累的私有数据成为了潜在的金矿,等待着被挖掘和利用。大型语言模型(LLMs)作为当前人工智能领域的前…