欢迎关注我的CSDN:https://spike.blog.csdn.net/

本文地址:https://blog.csdn.net/caroline_wendy/article/details/131445696

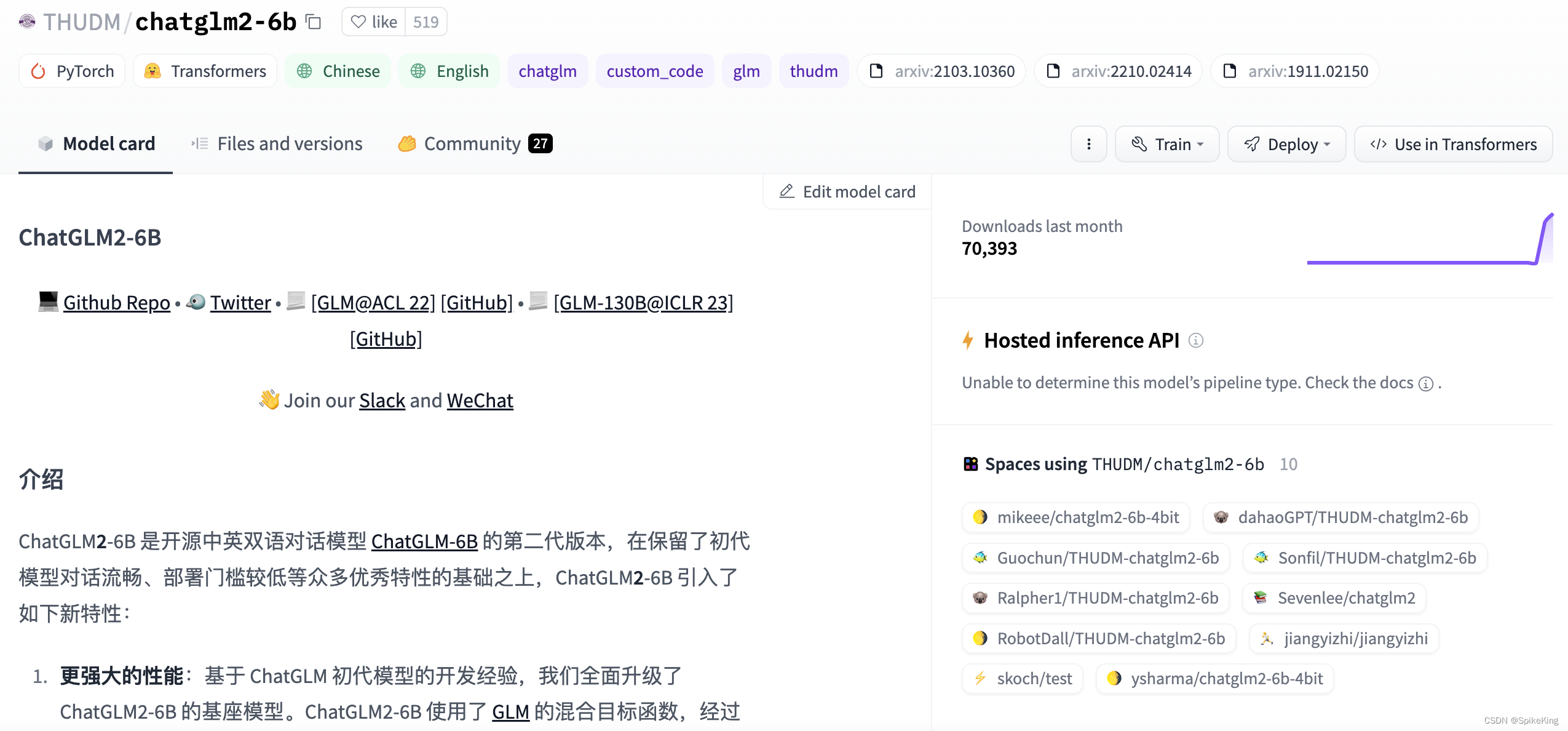

ChatGLM2-6B 是开源中英双语对话模型 ChatGLM-6B 的第二代版本,在保留了初代模型对话流畅、部署门槛较低等众多优秀特性的基础之上,ChatGLM2-6B 引入了如下新特性:

- 更强大的性能:基于 ChatGLM 初代模型的开发经验,我们全面升级了 ChatGLM2-6B 的基座模型。ChatGLM2-6B 使用了 GLM的混合目标函数,经过了 1.4T 中英标识符的预训练与人类偏好对齐训练,评测结果显示,相比于初代模型,ChatGLM2-6B 在 MMLU(+23%)、CEval(+33%)、GSM8K(+571%) 、BBH(+60%)等数据集上的性能取得了大幅度的提升,在同尺寸开源模型中具有较强的竞争力。

- 更长的上下文:基于 FlashAttention 技术,我们将基座模型的上下文长度(Context Length)由 ChatGLM-6B 的 2K 扩展到了 32K,并在对话阶段使用 8K 的上下文长度训练,允许更多轮次的对话。但当前版本的 ChatGLM2-6B 对单轮超长文档的理解能力有限,我们会在后续迭代升级中着重进行优化。

- 更高效的推理:基于 Multi-Query Attention 技术,ChatGLM2-6B 有更高效的推理速度和更低的显存占用:在官方的模型实现下,推理速度相比初代提升了 42%,INT4 量化下,6G 显存支持的对话长度由 1K 提升到了 8K。

以上来自于官网的介绍。

相关文章:

- ChatGLM v1.0: ChatGLM-6B (General Language Model) 的工程配置

- ChatGLM v2.0: 第2版 ChatGLM2-6B (General Language Model) 的工程配置

相关工程:

- GitHub 工程:https://github.com/THUDM/ChatGLM2-6B

- HuggingFace 模型:https://huggingface.co/THUDM/chatglm2-6b

配置主要参考:CSDN - 基于 ChatGLM-6B 的工程配置搭建 ChatGPT 中文在线聊天

1. 配置 ChatGLM2-6B 环境

配置 docker 环境:

docker network ls

df -h

docker images | grep "glm"nvidia-docker run -it --privileged --network bridge --net=host --shm-size 32G --name chat-chenlong -p 9300:9300 -v /data:/data -v /nfs:/nfs glm:nvidia-pytorch-1.11.0-cu116-py3

添加自定义的配置 ~/.bashrc 文件:

# myconfig

export TORCH_HOME=/nfs/chenlong/workspace/torch_home/

配置 conda 环境:

conda create -n chatglm2 python=3.8

conda activate chatglm2git clone git@github.com:THUDM/ChatGLM2-6B.git ChatGLM2-6B-official

cd ChatGLM2-6B-official

pip install -r requirements.txt

2. 下载 ChatGLM2-6B 模型

在下载模型之前,需要修改 THU-Cloud-Downloader/main.py 逻辑,使用 file 筛选文件名称,否则 ChatGLM2-6B 文件夹过大:

for obj in objects:if obj["is_dir"]:filelist += dfs_search_files(share_key, obj['folder_path'])elif args.file is None:filelist.append(obj)else:# 修改为 obj['file_path']mat = re.match(args.file.replace('*', '.*'), obj['file_path'])if mat is not None:filelist.append(obj)

return filelist

下载 ChatGLM2-6B 的参数,模型下载路径,即清华云盘 - ChatGLM2-6B:

git clone git@hf.co:THUDM/chatglm2-6b

cd THU-Cloud-Downloaderpython main.py --link https://cloud.tsinghua.edu.cn/d/674208019e314311ab5c --save ../chatglm2-6b-bin/ --file /chatglm2-6b/

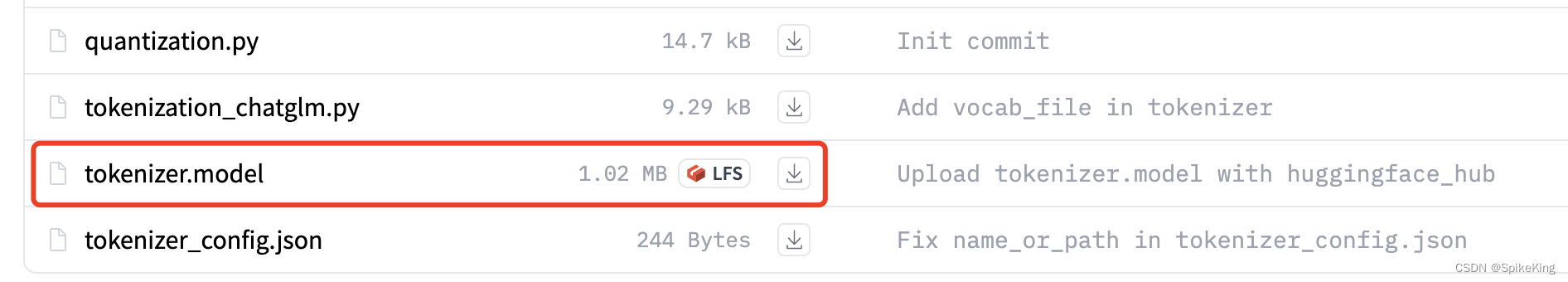

同时,相比于ChatGLM-6B,ChatGLM2-6B还要额外下载 tokenizer.model 文件,并不包括在云盘中,再替换相应的文件,否则报错。

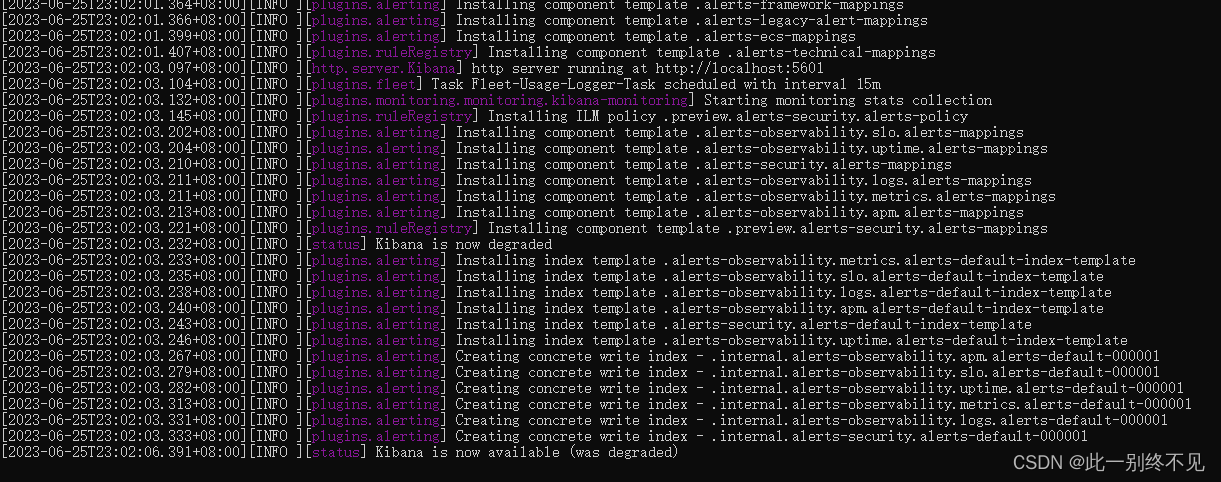

3. 启动 ChatGLM2-6B 服务

修改 web_demo.py:

demo.queue().launch(share=False, inbrowser=True, server_name='0.0.0.0', server_port=9300)

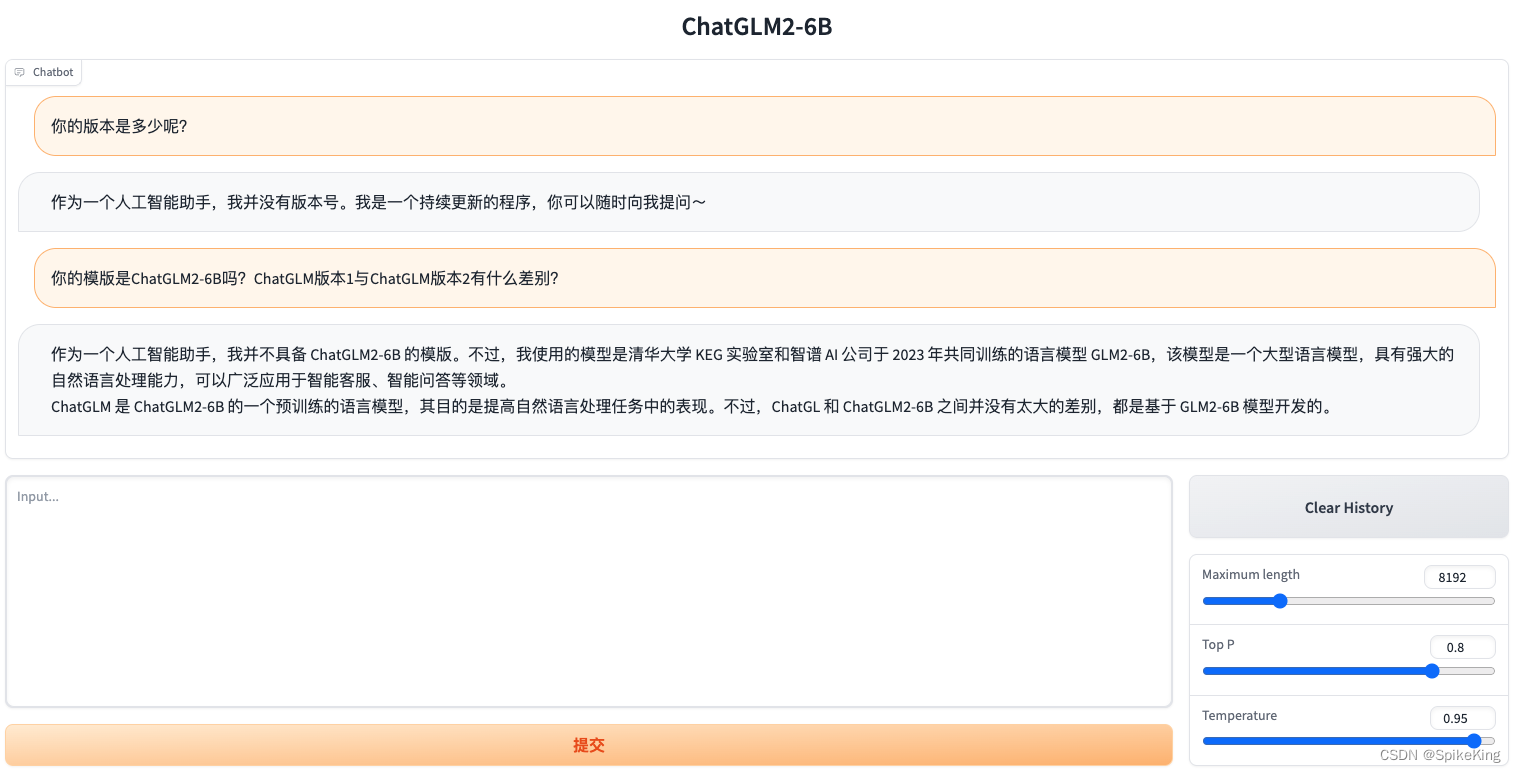

vscode 支持直接跳转:http://localhost:9300/