基础入门

物体跟踪技术是一种计算机视觉领域的重要技术,用于连续地检测和定位视频序列中的一个或多个目标物体。物体跟踪技术在众多领域都有广泛的应用,比如:自动驾驶、安防监控、增强现实等。物体跟踪的基本流程包含以下几个主要步骤。

1、初始化:确定跟踪的目标物体及其初始位置。

2、特征提取:提取目标物体的特征,这些特征可以是颜色、纹理、形状或其他描述符。

3、建模:根据提取的特征建立一个模型,用来描述目标物体。

4、跟踪:在后续帧中寻找与模型相匹配的目标物体,并更新其位置。

5、更新模型:根据新的观测结果更新模型,以适应目标物体的变化(比如:旋转、尺度变化等)。

6、评估:评估跟踪的效果,并采取措施应对丢失的情况(比如:重新初始化等)。

物体跟踪的方法可以分为以下几个大类。

1、基于特征的方法。

(1)颜色直方图:通过统计目标物体的颜色分布来建立模型。

(2)光流:利用像素点之间的运动矢量来跟踪物体。

(3)特征点:使用特征点(比如:SIFT、SURF、ORB等)进行跟踪。

2、基于外观模型的方法。

(1)粒子滤波:使用一组粒子表示概率分布,通过重采样更新粒子状态。

(2)均值漂移:通过迭代更新目标位置,使得目标中心的特征与模板特征最接近。

(3)卡尔曼滤波:使用线性动态系统模型预测目标状态,并通过观测进行校正。

3、基于深度学习的方法。

(1)卷积神经网络:使用CNN提取目标特征,并通过回归或分类的方式定位目标。

(2)视觉Transformer:利用Transformer架构处理图像数据,进行物体检测和跟踪。

(3)端到端学习:直接从数据中学习整个跟踪过程,无需手动设计特征。

在以上这些物体跟踪方法中,基于深度学习的方法因其强大的表现力和鲁棒性而成为最常用且效果最好的方法之一。特别是近年来,随着深度学习技术的发展,基于深度学习的物体跟踪方法已经取得了显著的进步,并在许多实际应用中取得了非常好的效果。

在OpenCV 4.X版本中,新引入了TrackerVit类,以在视频流中有效地跟踪目标物体。

TrackerVit

TrackerVit是一个基于深度学习的物体跟踪器,它利用Transformer模型的强大表征能力和序列建模能力,可以在视频序列中持续跟踪一个或多个目标物体。与传统的跟踪方法相比,基于Transformer的跟踪器可以在复杂的场景下保持较高的跟踪精度,并且对遮挡、光照变化和尺度变化等情况具有更好的鲁棒性。

Transformer模型最初是在自然语言处理(NLP)领域提出的,后来被广泛应用于计算机视觉领域。TrackerVit 利用Transformer模型的特点,可以有效地处理图像中的长距离依赖关系,并且能够通过自注意力机制捕捉全局上下文信息。具体来说,TrackerVit包含以下几个组件。

编码器:用于提取图像中的特征。

解码器:用于从编码器的输出中,重建目标物体的位置信息。

自注意力机制:允许模型关注输入序列中的不同部分,并捕捉全局上下文信息。

位置编码:为序列中的元素添加位置信息,使模型能够区分不同位置的信息。

TrackerVit的接口比较简单,主要有:create、init、update等,下面分别进行介绍。

create静态函数用于创建跟踪器,返回一个TrackerVIT类的指针。参数parameters中最重要的是net成员,用于指定物体跟踪的模型文件。

static Ptr<TrackerVit> create(const TrackerVit::Params& parameters = TrackerVit::Params());init函数用于初始化跟踪器。参数image为输入的图像,参数boundingBox为目标物体的初始位置和大小。

void init(InputArray image, const Rect& boundingBox);update函数用于更新跟踪器。参数image为输入的图像,参数boundingBox为目标物体的位置和大小,跟踪后会被更新。如果跟踪成功,则返回true;否则返回false。

bool update(InputArray image, CV_OUT Rect& boundingBox);实战解析

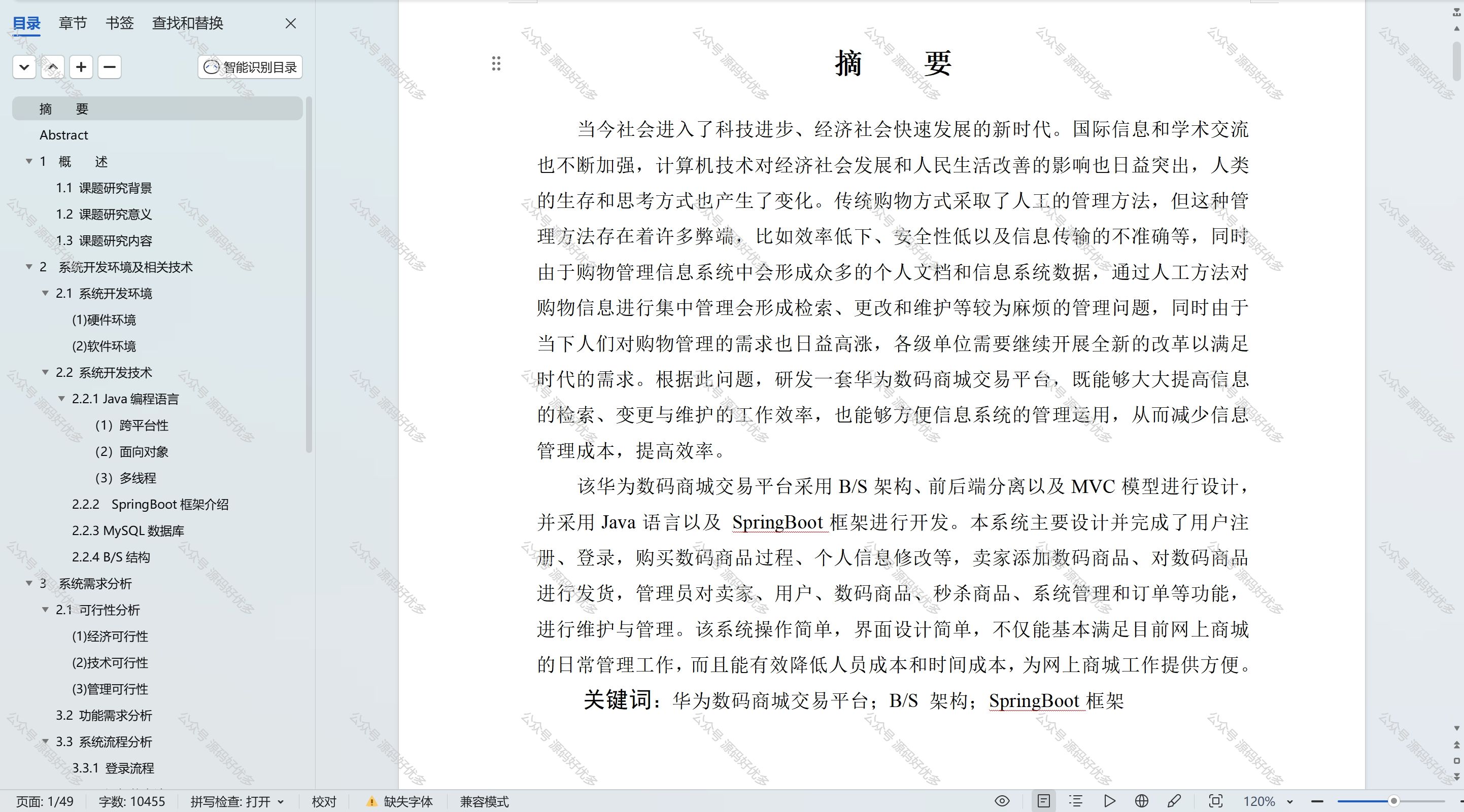

下面的实战代码实现了一个基于TrackerVit的物体跟踪应用,可以选择从视频文件或摄像头实时捕获视频流,并对选定的目标进行跟踪。

首先,根据宏定义的值来确定视频源。如果设置为0,则打开指定路径的视频文件;否则,打开摄像头设备。接着,我们创建TrackerVit实例并设置参数,包括指定ONNX模型文件路径、模型的后端、目标设备。随后,获取视频帧率并读取第一帧,根据宏定义的值决定是手动选择ROI还是使用固定的 ROI。如果是手动选择,则提示用户在第一帧上选择一个 ROI;否则,使用预先定义的 ROI。

接下来,我们初始化跟踪器,设置显示窗口,并进入主循环。在主循环中,我们不断从视频流中读取帧,并使用update方法更新跟踪器以获取跟踪结果。如果跟踪成功,则在帧上绘制跟踪到的边界框,并通过imshow函数显示出来。

#include <iostream>

#include <string>

using namespace std;#include <opencv2/opencv.hpp>

#include <opencv2/tracking.hpp>

using namespace cv;

using namespace cv::tracking;#define OBJECT_TRACKING_CAPTURE_MODE 0

#define OBJECT_TRACKING_FIX trueint main(int argc, char **argv)

{

#if OBJECT_TRACKING_CAPTURE_MODE == 0// 打开视频文件VideoCapture cap("ObjectTracking.mp4");if (!cap.isOpened()){cout << "Can not open or find the video file" << endl;return -1;}

#else// 打开摄像头VideoCapture cap(0);if (!cap.isOpened()){cout << "Can not open or find the camera" << endl;return -1;}

#endif// 创建TrackerVit实例TrackerVit::Params params;params.net = "object_tracking_vittrack_2023sep.onnx";params.backend = 0;params.target = 0;Ptr<TrackerVit> tracker = TrackerVit::create(params);// 获取视频的帧率int nFPS = (int)cap.get(CAP_PROP_FPS);// 读取第一帧Mat frame;cap >> frame;if (frame.empty()){cout << "Failed to read frame from video stream" << endl;return -1;}#if OBJECT_TRACKING_FIX// 固定某个目标Rect rectRoi(1180, 109, 116, 248);

#else// 画框选择某个目标Mat frame_bak = frame.clone();putText(frame_bak, "1. Drag a bounding box to track.", Point(50, 80), FONT_HERSHEY_SIMPLEX, 1, Scalar(0, 0, 255), 2);putText(frame_bak, "2. Press ENTER to confirm", Point(50, 120), FONT_HERSHEY_SIMPLEX, 1, Scalar(0, 0, 255), 2);Rect rectRoi = selectROI("VitTrack Demo", frame_bak);if (rectRoi.area() == 0){cout << "No ROI is selected" << endl;return -1;}

#endif// 初始化跟踪器tracker->init(frame, rectRoi);namedWindow("Object Tracking", WINDOW_NORMAL);resizeWindow("Object Tracking", 960, 540);while (true){cap >> frame;if (frame.empty()){break;}// 更新跟踪器bool updateOK = tracker->update(frame, rectRoi);if (updateOK){rectangle(frame, rectRoi, Scalar(0, 0, 255), 2);}else{// 跟踪失败cout << "Tracking failure detected" << endl;}imshow("Object Tracking", frame);// 按q键可以退出if (waitKey(1000 / nFPS) == 'q'){break;}}// 释放资源cap.release();destroyAllWindows();return 0;

}执行上面的代码,运行效果可参考下图。