MySQL 主从复制与读写分离

1、什么是读写分离?

读写分离,基本的原理是让主数据库处理事务性增、改、删操作(INSERT、UPDATE、DELETE),而从数据库处理SELECT查询操作。数据库复制被用来把事务性操作导致的变更同步到集群中的从数据库。

2、为什么要读写分离呢?读快写慢 分开操作不影响读的速率。

因为数据库的“写”(写10000条数据可能要3分钟)操作是比较耗时的。

但是数据库的“读”(读10000条数据可能只要5秒钟)。

所以读写分离,解决的是,数据库的写入,影响了查询的效率。

3、什么时候要读写分离?

数据库不一定要读写分离,如果程序使用数据库较多时,而更新少,查询多的情况下会考虑使用。利用数据库主从同步,再通过读写分离可以分担数据库压力,提高性能。

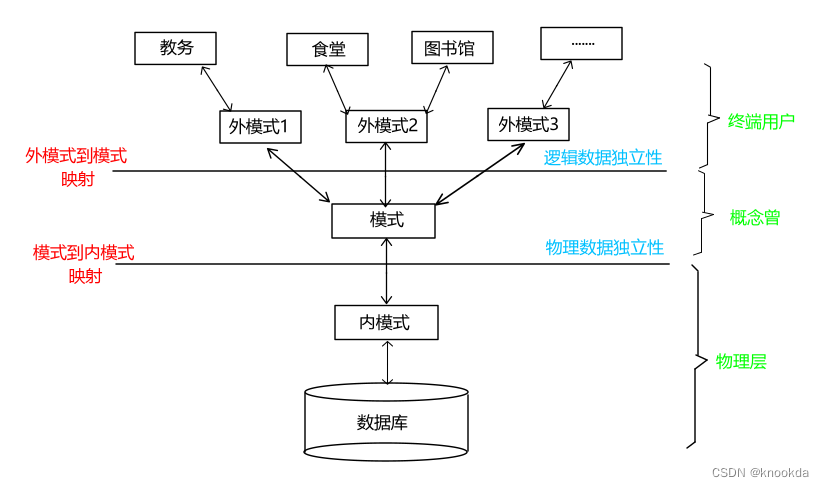

4、主从复制与读写分离

在实际的生产环境中,对数据库的读和写都在同一个数据库服务器中,是不能满足实际需求的。无论是在安全性、高可用性还是高并发等各个方面都是完全不能满足实际需求的。因此,通过主从复制的方式来同步数据,再通过读写分离来提升数据库的并发负载能力。有点类似于rsync,但是不同的是rsync是对磁盘文件做备份,而mysql主从复制是对数据库中的数据、语句做备份。

5、mysql支持的复制类型

(1)STATEMENT:基于语句的复制。在服务器上执行sql语句,在从服务器上执行同样的语句,mysql默认采用基于语句的复制,执行效率高。

(2)ROW:基于行的复制。把改变的内容复制过去,而不是把命令在从服务器上执行一遍。

(3)MIXED:混合类型的复制。默认采用基于语句的复制,一旦发现基于语句无法精确复制时,就会采用基于行的复制。

6、主从复制的工作过程

(1)Master节点将数据的改变记录成二进制日志(bin log),当Master上的数据发生改变时,则将其改变写入二进制日志中。

(2)Slave节点会在一定时间间隔内对Master的二进制日志进行探测其是否发生改变,如果发生改变,则开始一个I/O线程请求 Master的二进制事件。

(3)同时Master节点为每个I/O线程启动一个dump线程,用于向其发送二进制事件,并保存至Slave节点本地的中继日志(Relay log)中,Slave节点将启动SQL线程从中继日志中读取二进制日志,在本地重放,即解析成 sql 语句逐一执行,使得其数据和 Master节点的保持一致,最后I/O线程和SQL线程将进入睡眠状态,等待下一次被唤醒。

注:

●中继日志通常会位于 OS 缓存中,所以中继日志的开销很小。

●复制过程有一个很重要的限制,即复制在 Slave上是串行化的,也就是说 Master上的并行更新操作不能在 Slave上并行操作。

7、MySQL 读写分离原理

读写分离就是只在主服务器上写,只在从服务器上读。基本的原理是让主数据库处理事务性操作,而从数据库处理 select 查询。数据库复制被用来把主数据库上事务性操作导致的变更同步到集群中的从数据库。

8、目前较为常见的 MySQL 读写分离分为以下两种:

1)基于程序代码内部实现

在代码中根据 select、insert 进行路由分类,这类方法也是目前生产环境应用最广泛的。

优点是性能较好,因为在程序代码中实现,不需要增加额外的设备为硬件开支;缺点是需要开发人员来实现,运维人员无从下手。

但是并不是所有的应用都适合在程序代码中实现读写分离,像一些大型复杂的Java应用,如果在程序代码中实现读写分离对代码改动就较大。

2)基于中间代理层实现

代理一般位于客户端和服务器之间,代理服务器接到客户端请求后通过判断后转发到后端数据库,有以下代表性程序。

(1)MySQL-Proxy。MySQL-Proxy 为 MySQL 开源项目,通过其自带的 lua 脚本进行SQL 判断。

(2)Atlas。是由奇虎360的Web平台部基础架构团队开发维护的一个基于MySQL协议的数据中间层项目。它是在mysql-proxy 0.8.2版本的基础上,对其进行了优化,增加了一些新的功能特性。360内部使用Atlas运行的mysql业务,每天承载的读写请求数达几十亿条。支持事物以及存储过程。

(3)Amoeba。由陈思儒开发,作者曾就职于阿里巴巴。该程序由Java语言进行开发,阿里巴巴将其用于生产环境。但是它不支持事务和存储过程。

(4)Mycat。是一款流行的基于Java语言编写的数据库中间件,是一个实现了MySql协议的服务器,其核心功能是分库分表。配合数据库的主从模式还可以实现读写分离。

由于使用MySQL Proxy 需要写大量的Lua脚本,这些Lua并不是现成的,而是需要自己去写。这对于并不熟悉MySQL Proxy 内置变量和MySQL Protocol 的人来说是非常困难的。

Amoeba是一个非常容易使用、可移植性非常强的软件。因此它在生产环境中被广泛应用于数据库的代理层。

实验:

Master 服务器:192.168.92.30 mysql5.7

Slave1 服务器:192.168.92.40 mysql5.7

Slave2 服务器:192.168.92.50 mysql5.7

Amoeba 服务器:192.168.92.60 jdk1.6、Amoeba

客户端 服务器:192.168.92.70 mysql

##均先关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

----------------------搭建 MySQL主从复制--------------------------------

----Mysql主从服务器时间同步----

##主服务器设置

yum install ntp -y #安装ntp时钟同步

vim /etc/ntp.conf #修改ntp 的配置文件

#末尾添加

server 127.127.92.0 #设置本地是时钟源,注意修改网段

fudge 127.127.92.0 stratum 8 #设置时间层级为8(限制在15内)

service ntpd start

#从服务器设置

yum install ntp ntpdate -y #安装ntpdate同步服务器时间

service ntpd start #启动服务

/usr/sbin/ntpdate 192.168.92.30 #进行时间同步

crontab -e #设置定时任务

*/30 * * * * /usr/sbin/ntpdate 192.168.92.30 #每三十秒同步一次

----主服务器的mysql配置-----

vim /etc/my.cnf #配置MySQL启动时加载的配置文件

server-id = 11 #只要你需要主从同步,就一定要注意server-id的配置,否则会出现主从复制异常。server-id是一个全局变量。server-id用于标识数据库实例,防止在链式主从、多主多从拓扑中导致SQL语句的无限循环

log-bin=mysql-bin #添加,主服务器开启二进制日志

log-slave-updates=true #添加,允许slave从master复制数据时可以写入到自己的二进制日志

expire_logs_days = 7 #设置二进制日志文件过期时间,默认值为0,表示logs不过期

max_binlog_size = 500M #设置二进制日志限制大小,如果超出给定值,日志就会发生滚动,默认值是1GB

systemctl restart mysqld #重启服务

mysql -u root -pabc123 #登录mysql

GRANT REPLICATION SLAVE ON *.* TO 'myslave'@'192.168.80.%' IDENTIFIED BY '123456'; #给从服务器授权

FLUSH PRIVILEGES; #当前user和privilige表中的用户信息/权限设置从mysql库(MySQL数据库的内置库)中提取到内存里.刷新MySQL的系统权限相关表

show master status;

//如显示以下

+-------------------+----------+--------------+------------------+

| File | Position | Binlog_Do_DB | Binlog_Ignore_DB |

+-------------------+----------+--------------+------------------+

| mysql-bin.000002 | 339 | | |

+-------------------+----------+--------------+------------------+

1 row in set (0.00 sec)

#File 列显示日志名,Position 列显示偏移量

----从服务器的mysql配置----

vim /etc/my.cnf

server-id = 22 #修改,注意id与Master的不同,两个Slave的id也要不同

relay-log=relay-log-bin #添加,开启中继日志,从主服务器上同步日志文件记录到本地

relay-log-index=slave-relay-bin.index #添加,定义中继日志文件的位置和名称,一般和relay-log在同一目录

relay_log_recovery = 1 #选配项

#当 slave 从库宕机后,假如 relay-log 损坏了,导致一部分中继日志没有处理,则自动放弃所有未执行的 relay-log,并且重新从 master 上获取日志,这样就保证了 relay-log 的完整性。默认情况下该功能是关闭的,将 relay_log_recovery 的值设置为 1 时, 可在 slave 从库上开启该功能,建议开启。

systemctl restart mysqld

mysql -u root -pabc123

CHANGE master to master_host='192.168.92.30',master_user='myslave',master_password='123456',master_log_file='mysql-bin.000002',master_log_pos=339; #配置同步,注意 master_log_file 和 master_log_pos 的值要与Master查询的一致

start slave; #启动同步,如有报错执行 reset slave;

show slave status\G #查看 Slave 状态

//确保 IO 和 SQL 线程都是 Yes,代表同步正常。

Slave_IO_Running: Yes #负责与主机的io通信

Slave_SQL_Running: Yes #负责自己的slave mysql进程

#一般 Slave_IO_Running: No 的可能性:

1、网络不通

2、my.cnf配置有问题

3、密码、file文件名、pos偏移量不对

4、防火墙没有关闭

============MySQL主从复制延迟=============

1、master服务器高并发,形成大量事务

2、网络延迟

3、主从硬件设备导致

cpu主频、内存io、硬盘io

4、是同步复制、而不是异步复制

从库优化Mysql参数。比如增大innodb_buffer_pool_size,让更多操作在Mysql内存中完成,减少磁盘操作。

从库使用高性能主机。包括cpu强悍、内存加大。避免使用虚拟云主机,使用物理主机,这样提升了i/o方面性。

从库使用SSD磁盘

网络优化,避免跨机房实现同步

----验证主从复制效果----

主服务器上进入执行 create database db_test;

去从服务器上查看 show databases;

----------------------搭建 MySQL读写分离--------------------------------

----Amoeba服务器配置----

##安装 Java 环境##

因为 Amoeba 基于是 jdk1.5 开发的,所以官方推荐使用 jdk1.5 或 1.6 版本,高版本不建议使用。

cd /opt/ #安装jdk

cp jdk-6u14-linux-x64.bin /usr/local/

cd /usr/local/

chmod +x jdk-6u14-linux-x64

./jdk-6u14-linux-x64.bin

//按yes,按enter

mv jdk1.6.0_14/ /usr/local/jdk1.6

vim /etc/profile #配置jdk的环境变量

export JAVA_HOME=/usr/local/jdk1.6

export CLASSPATH=.:$JAVA_HOME/lib:$JAVA_HOME/jre/lib

export PATH=$JAVA_HOME/bin:$JAVA_HOME/jre/bin:$PATH

export AMOEBA_HOME=/usr/local/amoeba

export PATH=$PATH:$AMOEBA_HOME/bin

source /etc/profile

java -version

#安装 Amoeba软件

mkdir /usr/local/amoeba

tar zxvf amoeba-mysql-binary-2.2.0.tar.gz -C /usr/local/amoeba/

chmod -R 755 /usr/local/amoeba/

/usr/local/amoeba/bin/amoeba

//如显示amoeba start|stop说明安装成功

##配置 Amoeba读写分离,两个 Slave 读负载均衡## 三台主机赋权给test用户全部权限密码为123.com

#先在Master、Slave1、Slave2 的mysql上开放权限给 Amoeba 访问

grant all on *.* to test@'192.168.92.%' identified by '123.com';

#再回到amoeba服务器配置amoeba服务:

cd /usr/local/amoeba/conf/

cp amoeba.xml amoeba.xml.bak

vim amoeba.xml ##主配置文件,配置虚拟mysql客户端,配置所有数据源以及 Amoeba 自身的参数,当 amoeba 运行起来后,我们使用这些参数就可以登录到 amoeba 虚拟的 mysql 了 #修改amoeba配置文件

--30行--

<property name="user">amoeba</property> ##数据库访问amoeba服务器时使用的账号

--32行--

<property name="password">123456</property> ##数据库访问amoeba服务器时使用账号时用的密码

--115行--

<property name="defaultPool">master</property> ##修改默认池

--117-去掉注释-

<property name="writePool">master</property> ##取消注释设置写池

<property name="readPool">slaves</property> ##取消注释设置读池

cp dbServers.xml dbServers.xml.bak ##做备份方便出错还原配置文件

vim dbServers.xml ##为了更好的进行模块区分,将真实 server 的配置放到了 dbServers.xml 文件中

#修改数据库配置文件

--23行--注释掉 作用:默认进入test库 以防mysql中没有test库时,会报错

<!-- <property name="schema">test</property> -->

--26--修改

<property name="user">test</property> ##amoeba访问三台mysql数据库的账户

--28-30--去掉注释

<property name="password">123.com</property> ##amoeba访问三台mysql数据库的账户密码

--45--修改,设置主服务器的名Master

<dbServer name="master" parent="abstractServer">

--48--修改,设置主服务器的地址

<property name="ipAddress">192.168.92.30</property>

--52--修改,设置从服务器的名slave1

<dbServer name="slave1" parent="abstractServer">

--55--修改,设置从服务器1的地址

<property name="ipAddress">192.168.92.40</property>

--58--复制上面6行粘贴,设置从服务器2的名slave2和地址

<dbServer name="slave2" parent="abstractServer">

<property name="ipAddress">192.168.92.50</property>

--65行--修改

<dbServer name="slaves" virtual="true"> ##修改多个服务器池的名称

--71行--修改

<property name="poolNames">slave1,slave2</property> ##添加两个从服务器的服务器名

/usr/local/amoeba/bin/amoeba start& 后台启动amoeba服务 #启动Amoeba软件,按ctrl+c 返回

netstat -anpt | grep java #查看8066端口是否开启,默认端口为TCP 8066

netstat -natp | grep 8066

----测试读写分离 ----

yum install -y mariadb-server mariadb ##安装数据库用于测试 数据从从服务器读取,主服务器写入 通过关闭同步复制验证

systemctl start mariadb.service

在客户端服务器上测试:

mysql -u amoeba -p123456 -h 192.168.80.20 -P8066

//通过amoeba服务器代理访问mysql ,在通过客户端连接mysql后写入的数据只有主服务会记录,然后同步给从--从服务器

在主服务器上:

use db_test;

create table test (id int(10),name varchar(10),address varchar(20));

在两台从服务器上:

stop slave; #关闭同步

use db_test;

//在slave1上:

insert into test values('1','zhangsan','this_is_slave1');

//在slave2上:

insert into test values('2','lisi','this_is_slave2');

//在主服务器上:

insert into test values('3','wangwu','this_is_master');

//在客户端服务器上:

use db_test;

select * from test; //客户端会分别向slave1和slave2读取数据,显示的只有在两个从服务器上添加的数据,没有在主服务器上添加的数据

insert into test values('4','qianqi','this_is_client'); //只有主服务器上有此数据

//在两个从服务器上执行 start slave; 即可实现同步在主服务器上添加的数据

start slave;