点击上方“3D视觉工坊”,选择“星标”

干货第一时间送达

【摘要】 — 三维建模是计算机视觉中的一个经典问题,其主要目标是得到物体/场景的三维信息(e.g. 点云或深度图)。然而只有三维信息还不足以逼真的渲染重现真实世界,还需要表面反射场信息才能在视觉上以假乱真。本文主要介绍美国南加州大学ICT Graphic Lab的Paul Debevec所引领开发的Light Stage技术,该技术已经成功应用在好莱坞电影特效和2014年美国总统奥巴马的数字人脸建模等诸多应用中。

1、反射场在三维成/呈像中的重要性

三维建模可以得到物体的几何信息,例如点云、深度图等。但为了在视觉上逼真的重现三维物体,只有几何信息是不够的。不同物体表面在不同光照环境下会呈现出不同的反射效果,例如玉石会呈现出高光和半透明的反射效果、棉麻织物会呈现出漫反射的效果。即使是相同表面,在不同光照下也会呈现出不同的反射效果,例如图1中的精灵在魔法灯的照射下,脸上呈现出相应的颜色和阴影;阿凡达在发光水母的照射下脸上和身上也会呈现对应的反射效果,这就是Relighting所产生的效果。在现实生活中Relighting是一种再正常不过的现象了。然而当电影中Relighting的效果与实际不符时,人眼会感受到莫名的异常。

模拟出与真实物体表面一致的反射特性,对提高计算机渲染成/呈像的逼真度至关重要。在实际的拍摄中并不存在精灵和阿凡达,也不存在魔法灯和发光的水母,如何生成Photorealistic的图像呢?通过计算机模拟反射场(Reflectance Field)是目前好莱坞大片中惯用的方法。反射场是对所有反射特性的一个普适数学模型,物体表面不同位置(x, y, z)在时刻(t)向半球范围内不同角度(θ, Φ)发出波长为(λ)的光线,由R(x, y, z, θ, Φ, λ, t)七个维度构成的光线的集合就是反射场。关于光场和反射场的异同点参见《Mars说光场(1)— 综述》。

图 1. 反射场Relighting示意图

2、USC Light Stage介绍

Light Stage是由美国南加州大学ICT Graphic Lab的保罗•德贝维奇(Paul Debevec)所领导开发的一个高保真的三维采集重建平台系统。该系统以高逼真度的3D人脸重建为主,并已经应用于好莱坞电影渲染中。从第一代系统Light Stage 1于2000年诞生,至今已经升级到Light Stage 6,最新的一代系统命名为Light Stage X。

2.1 Light Stage 1

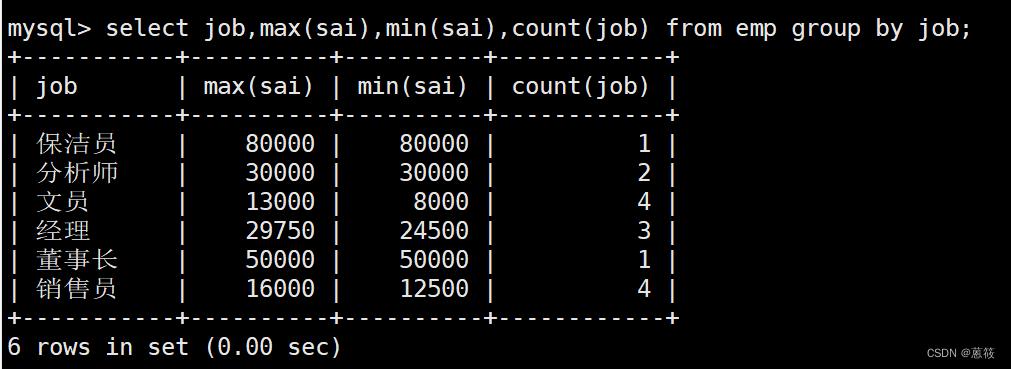

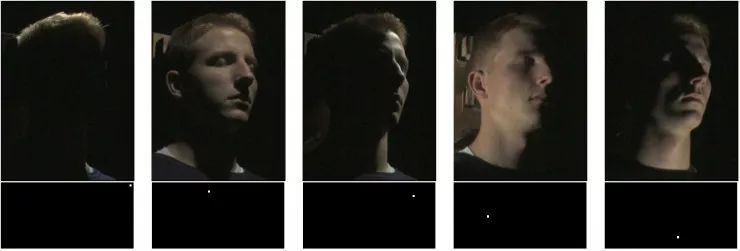

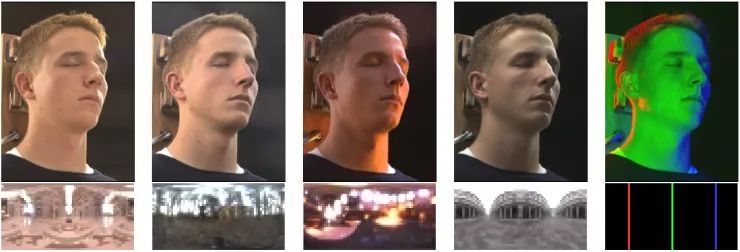

如图2所示,Light Stage 1 包括1个光源(strobe light)、2个相机(分辨率480x720)、1个投影仪,整个设备直径约3米[1]。光源可沿机械臂垂直移动,同时机械臂可带动光源水平旋转。整个采集过程包括两个阶段:第一阶段是以人脸为中心旋转光源,从而构成64x32个不同方向的等效光源入射到人脸上。与此同时,两个相机同步拍摄不同光照下的左侧脸和右侧脸,每个相机共拍摄2048张图片,如图3所示。需要说明的是光源和相机前分别覆盖了互相垂直的偏振片,用于分离散射和高光(separate diffuse and specular)。第二阶段是投影仪与2个相机配合完成基于结构光的三维重建,如图4所示。整个采集过程耗时约1分钟,采集过程中人脸需要持续保持静止,这对演员保持静止的能力提出了极高的要求。

图 2. Light Stage 1系统样机

Light Stage 1采集的图片样例如图3所示,第二行图片中亮点表示光源的位置,第一行图片表示对应光源照射下采集到的人脸图片,实际采集的反射场图片包括64x32光源位置下的2048张图片。采集三维几何模型通过结构光三维重建实现,如图4所示。

图 3. Light Stage 1 采集图片样例

图 4. Light Stage 1 基于结构光的三维重建

在进行Relighting渲染之前还需要通过Specular Ball / Mirror Ball采集环境光照,如图5所示。通过Mirror Ball采集的图片需要经过重采样得到离散的环境光照矩阵[2],然后将环境光照应用在反射场图中,得到如图6中Relighting的渲染效果。图6中第二行图片为Specular Ball在不同环境下采集的环境光照展开图,第一行图片为对应光照下人脸渲染结果。需要说明的是,图6中人脸Relighting的渲染图片只限于固定视点,如果需要改变视点需要结合结构光采集的三维几何模型。

图 5. Specular Ball 采集环境光

图 6. Light Stage 1 人脸Relighting效果

2.2 USC Light Stage 2

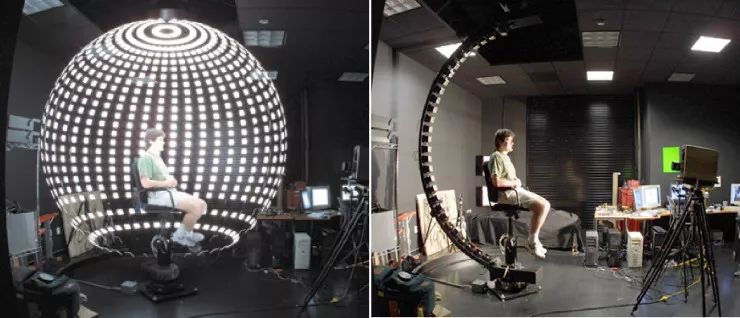

Light Stage 2 在Light Stage 1 的基础上增加了更多的光源,将23个白色光源分布于弧形机械臂上[3-5]。机械臂旋转到不同的经线位置,并依次点亮光源,最终形成42x23个不同方向的入射光源。采集时间从1分钟缩短到4秒,降低了演员维持静态表情的难度。如图7所示,右侧为Light Stage 2真机系统,左侧为采集过程中4秒长曝光拍摄图片。

图 7. Light Stage 2 采集示意图

2.3 USC Light Stage 3

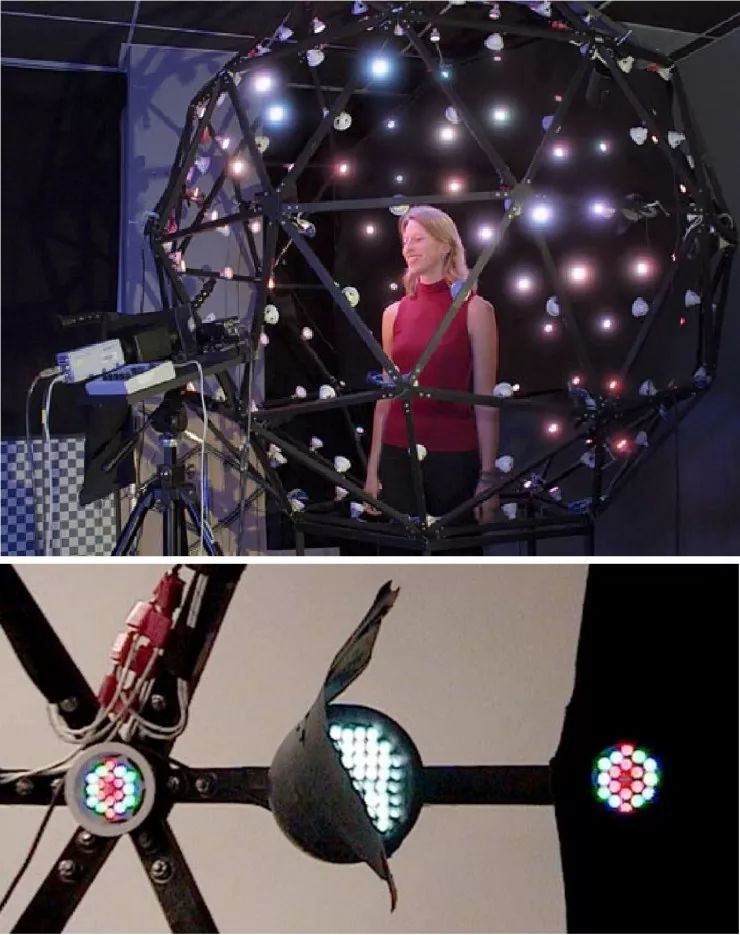

在不同的光照环境下,人脸会反射出不同的“脸色”,例如人脸在火炬前会被映红。通过改变环境光照而使物体表面呈现与之对应的反射状态称为“Relighting”。然而在电影拍摄中并不能把演员置身于任意真实的环境中,例如《指环王》中男主角佛罗多·巴金斯置身于火山岩中,又例如阿凡达置身于梦幻蓝色树丛中。Light Stage 3并不用于人脸建模,而是构建一个可控的彩色光照平台,从而可以实现人脸实时的Relighting[6-8]。

Light Stage 3的支撑结构为二十面体,包括42个顶点、120条边、80个面,如图8所示。在每个顶点和每条边的中心放置一个彩色光源,一共可放置162个彩色光源。由于球体底部5个顶点及其相应的边被移除用于演员站立,因此实际光源数量减少到156个。光源型号为Philips Color Kinetics,iColor MR gen3 LED Lamp。光源的亮度和颜色通过USB控制PWM占空比来实现。用于人脸图像采集的相机为Sony DXC-9000,帧率60fps,分辨率640x480,FOV 40度。Light Stage 3还包括6个红外光源和1个灰度相机。红外光源的峰值波长为850nm。灰度相机为Uniq Vision UP-610,帧率110 fps,分辨率640x480,FOV 42度,红外滤光片为Hoya R72。彩色相机和红外相机之间采用分光片确保彩色图像和红外图像对齐,30%反射进入红外相机,70%透射进入彩色相机,如图9所示。

图 8. Light Stage 3 采集系统样机

图 9. Light Stage 3 分光采集系统

如图10所示,Light Stage 3的工作流程如下:首先用Specular Ball采集目标环境光照,或者计算机生成虚拟环境的光照。然后控制156个彩色光源模拟出与目标环境光照相似的光线,演员在Light Stage 3产生的光照下进行表演。最后通过红外成像把Relighting的人像扣出并融合到电影中。由于Light Stage 3不能重建三维人脸模型,因此不能随意切换视点,需要演员精湛的演技将肢体形态与目标环境融合。最终Relighting合成视频如下所示。

图 10. Light Stage 3 采集图片样例及融合真实环境效果效果

2.4 USC Light Stage 5

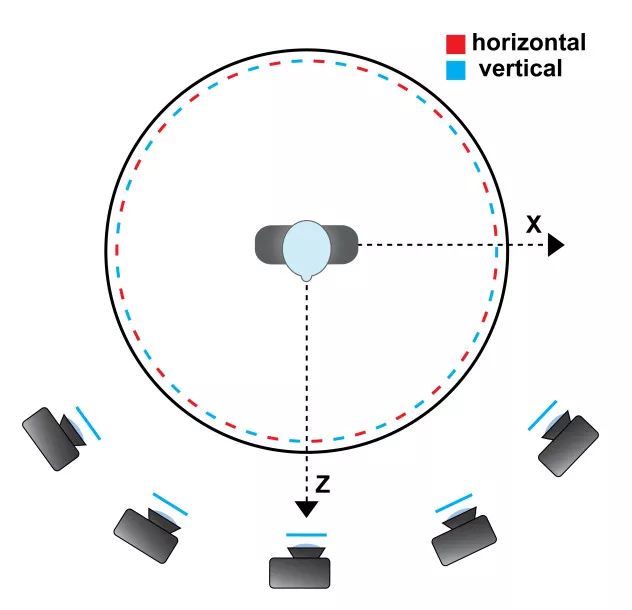

Light Stage 5采用与Light Stage 3同样的支撑结构,但把156个彩色光源换成156个白色光源,如图11所示[9-12]。每个白色光源包括12个Lumileds LED灯珠,平均分成2组,分别覆盖水平和垂直的偏振片。理想情况下,需要按照Light Stage 2的光照模式依次点亮每个光源并拍照,那么一共需要拍摄156张图片。Light Stage 5创新性地采用了球谐调和光照(Spherical Harmonic Lighting),如图12所示,将光照模式(Lighting Pattern)从156个减少到4个,分别是沿X/Y/Z方向递减的3个梯度光照和1个均匀全亮光照。由于需要拍摄水平和垂直两种偏振状态下的图片,因此每个相机一共需要拍摄8种光照模式下的8张图片。相比之前的Light Stage,整个采集的时间大大缩短。如果采用高速相机可以达到实时采集,如果采用单反相机需要2秒。

图 11. Light Stage 5 采集系统样机

图 12. Light Stage 5 偏振光布局

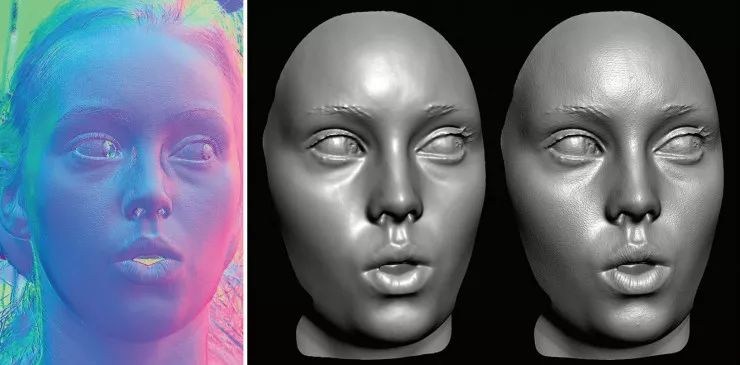

人脸包括低频和高频两种几何信息,低频几何信息主要是指鼻梁高低、脸型胖瘦等;高频几何信息主要是指毛孔、胡须、唇纹等。对于低频几何信息,Light Stage 5采用两种三维建模方法:一种是用DLP高速投影仪和Phantom高速摄像机构成基于结构光的实时三维重建。另一种是采用5个单反相机(Canon 1D Mark III)构成多视几何(Multi-view Geometry)重建三维人脸模型。在上述两种三维建模方法的基础上,进一步采用Photometric Stereo来生成高频几何模型。图13为Light Stage 5所完成的“Digital Emily”项目中重建的数字演员艾米丽[13,14],左侧为重建的高精度Normal Map,中间为只用Diffuse Component重建的人脸模型,右侧为同时加上Diffuse Component和Specular Component以后重建的高精细人脸。

图 13. Light Stage 5 Digital Emily人脸重建效果

2.5 USC Light Stage 6

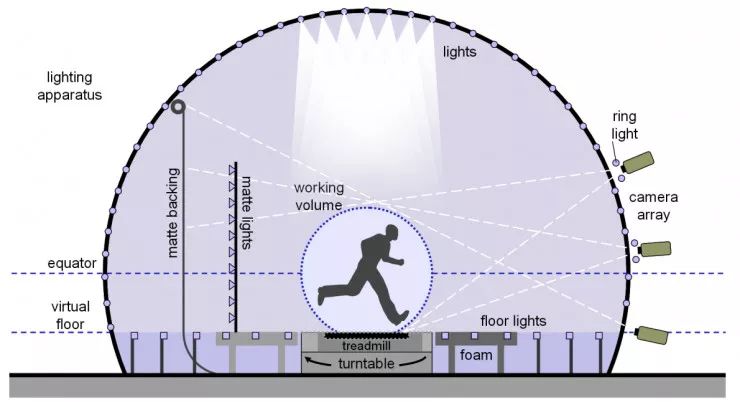

如图14和15所示,Light Stage 6是为采集演员全身反射场而设计[15]。支撑结构直径8米,为了使演员处于球体中心,去掉了球体底部1/3。Light Stage 6共包括1111个光源,每个光源由6颗LumiLEDs Luxeon V LED灯珠构成。采集系统包括3台垂直分布的高速摄像机以30fps同步采集图像,每一帧图像包括33种不同光照。所以高速相机实际的工作频率为990Hz。在支撑结构的中心有一个旋转平台,该旋转平台为演员有效的表演区域,直径2米。在采集过程中旋转平台会持续旋转,高速相机从而拍摄到不同视点的演员图像,演员需要不断的重复周期性动作,整个采集过程约几分钟。

图 14. Light Stage 6 采集系统样机

图 15. Light Stage 6 采集系统示意图

Light Stage 6并不对人体进行几何建模,而是采用与Light Stage 3类似的原理来实现Relighting。Light Stage 6相比Light Stage 3的改进之处在于视点可切换。Light Stage 6为了实现视点切换,需要演员周期性的重复动作,例如跑步,然后采集到所有不同光照下不同视点的图像。图16上侧图片为1/30秒内某一个相机采集的所有图片,包括26张不同光照下的图片(Lighting Frames),3张红外图片(Matting Frames)用于抠图,3张跟踪图片(Tracking Frames)用于光流对齐图片,1张预留图片(Strip Frame)目前无用,将用于后续其他潜在功能应用。图16下侧图片为相机阵列中上中下三个相机分别采集到的图片。如图17所示,所采集的图片分布于一个圆柱形上,当渲染不同视点下的Relighting图片时,从圆柱形上选择合适的视点进行融合。

图 16. Light Stage 6 采集图片样例

图 17. Light Stage 6 多视点渲染

2.6 Light Stage对比总结

Light Stage 1 和Light Stage 2都是基于稠密采样的反射场采集,因此采集时间较长。Light Stage 3采集彩色光源照射实时生成Relighting图片,但没有进行三维建模,所以应用场景有限。Light Stage 4的研发被搁置了,所以取消了Light Stage 4的命名,转而直接研发Light Stage 5。Light Stage 5基于球谐调和进行反射场的低阶采样,是相对比较成熟的一代系统,已经在《本杰明•巴顿》、《蜘蛛侠》等电影特效中得到应用。最新研发的系统为Light Stage X,小型可移动,专门针对高精度人脸反射场采集建模;其光照亮度、光谱、偏振状态都可以基于USB接口通过电脑编程控制,自动化程度更高,采集时间更短。2014年采集美国时任总统奥巴马头像时,就是基于Light Stage X系统,如图18为采集现场,图19为重建结果。Paul Debevec及其团队核心成员于2016年加入谷歌DayDream部门,主要是将光场技术应用于泛VR领域,其团队于2018年8月在steam平台上上线了《Welcome to light field》体验应用。

(图片来于 http://vgl.ict.usc.edu/Research/PresidentialPortrait/)

图 18. Light Stage X为美国时任总统奥巴马采集人脸头像现场

(图片来源于 http://vgl.ict.usc.edu/Research/PresidentialPortrait/)

图 19. 美国时任总统奥巴马重建头像

[1] Debevec P, Hawkins T, Tchou C, et al. Acquiring the reflectance field of a human face[C]// SIGGRAPH '00 : Proc. Conference on Computer Graphics and Interactive Techniques. 2000:145-156.

[2] Debevec P. A median cut algorithm for light probe sampling[C]// ACM SIGGRAPH. ACM, 2008:1-3.

[3] Tim Hawkins, Jonathan Cohen, Chris Tchou, Paul Debevec, Light Stage 2.0, In SIGGRAPH Technical Sketches, 2001.

[4] Hawkins T, Cohen J, Debevec P. A photometric approach to digitizing cultural artifacts[C]// Conference on Virtual Reality, Archeology, and Cultural Heritage. ACM, 2001:333-342.

[5] Hawkins T, Wenger A, Tchou C, et al. Animatable facial reflectance fields[C]// Fifteenth Eurographics Conference on Rendering Techniques. Eurographics Association, 2004:309-319.

[6] Jones A, Gardner A, Bolas M, et al. Simulating Spatially Varying Lighting on a Live Performance[C]// European Conference on Visual Media Production. IET, 2006:127-133.

[7] Wenger A, Hawkins T, Debevec P. Optimizing Color Matching in a Lighting Reproduction System for Complex Subject and Illuminant Spectra.[C]// Eurographics Workshop on Rendering Techniques, Leuven, Belgium, June. DBLP, 2003:249-259.

[8] Debevec P, Wenger A, Tchou C, et al. A lighting reproduction approach to live-action compositing[C]// Conference on Computer Graphics & Interactive Techniques. ACM, 2002:547-556.

[9] Wenger A, Gardner A, Tchou C, et al. Performance relighting and reflectance transformation with time-multiplexed illumination[C]// ACM, 2005:756-764.

[10] Ghosh A, Hawkins T, Peers P, et al. Practical modeling and acquisition of layered facial reflectance[J]. Acm Transactions on Graphics, 2008, 27(5):1-10.

[11] Ma W C, Hawkins T, Peers P, et al. Rapid acquisition of specular and diffuse normal maps from polarized spherical gradient illumination[C]// Eurographics Conference on Rendering Techniques. Eurographics Association, 2007:183-194.

[12] Ghosh A, Fyffe G, Tunwattanapong B, et al. Multiview Face Capture using Polarized Spherical Gradient Illumination[J]. Acm Transactions on Graphics, 2011, 30(6):1-10.

[13] Alexander O, Rogers M, Lambeth W, et al. Creating a Photoreal Digital Actor: The Digital Emily Project[C]// Visual Media Production, 2009. CVMP '09. Conference for. IEEE, 2010:176-187.

[14] Alexander O, Rogers M, Lambeth W, et al. The digital Emily project: achieving a photorealistic digital actor[J]. IEEE Computer Graphics & Applications, 2010, 30(4):20.

[15] Einarsson P, Jones A, Lamond B, et al. Relighting human locomotion with flowed reflectance fields[C]// ACM SIGGRAPH 2006 Sketches. ACM, 2006:76.

增强现实核心技术产业联盟(ID:CARA--2019)

来源:AI职通车

本文仅做学术分享,如有侵权,请联系删文。

下载1

在「3D视觉工坊」公众号后台回复:3D视觉,即可下载 3D视觉相关资料干货,涉及相机标定、三维重建、立体视觉、SLAM、深度学习、点云后处理、多视图几何等方向。

下载2

在「3D视觉工坊」公众号后台回复:3D视觉github资源汇总,即可下载包括结构光、标定源码、缺陷检测源码、深度估计与深度补全源码、点云处理相关源码、立体匹配源码、单目、双目3D检测、基于点云的3D检测、6D姿态估计源码汇总等。

下载3

在「3D视觉工坊」公众号后台回复:相机标定,即可下载独家相机标定学习课件与视频网址;后台回复:立体匹配,即可下载独家立体匹配学习课件与视频网址。

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列、三维点云系列、结构光系列、手眼标定、相机标定、orb-slam3等视频课程)、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近2000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、可答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~