Tune-A-Video: One-Shot Tuning of Image Diffusion Models for Text-to-Video Generation

Project:https://tuneavideo.github.io

原文链接:Tnue-A-Video:用于文本到视频生成的图像扩散模型的One-shot Tuning (by 小样本视觉与智能前沿)

目录

文章目录

- Tune-A-Video: One-Shot Tuning of Image Diffusion Models for Text-to-Video Generation

- 01 现有工作的不足?

- 02 文章解决了什么问题?

- 03 关键的解决方案是什么?

- 04 主要的贡献是什么?

- 05 有哪些相关的工作?

- 06 方法具体是如何实现的?

- Network Inflation

- Fine-Tuning and Inference

- 1)Model fine-tuning

- 2)基于DDIM反演的结构指导

- 07 实验结果和对比效果如何?

- Applications

- 1)Object editing.

- 2)Background change.

- 3)Style transfer.

- 4)个性化可控生成

- 定性结果

- 定量结果

- 08 消融研究告诉了我们什么?

- 09 这个工作还是可以如何优化?

- 10 结论

01 现有工作的不足?

为了复制文本到图像(T2I)生成的成功,最近的工作使用大规模视频数据集来训练文本到视频(T2V)生成器。尽管他们的结果很有希望,但这种范式在计算上是昂贵的。

02 文章解决了什么问题?

我们提出了一种新的T2V生成设置-单次视频调优,其中只有一个文本视频对。我们的模型建立在最先进的T2I扩散模型上,该模型是在大量图像数据上预训练的。

03 关键的解决方案是什么?

我们引入了Tune-A-Video,它涉及定制的时空注意机制和有效的一次性调整策略。在推理中,我们采用DDIM反演为采样提供结构指导。

04 主要的贡献是什么?

- 我们为 T2V 生成引入了 One-Shot Video Tuning 的新设置,消除了使用大规模视频数据集进行训练的负担。

- 我们提出了 Tune-A-Video,这是第一个使用预训练的 T2I 模型生成 T2V 的框架。

- 我们提出了有效的注意力调整和结构反转,显着提高了时间一致性。

05 有哪些相关的工作?

- Text-to-Image diffusion models.

- Text-to-Video generative models.

- Text-driven video editing.

- Generation from a single video.

06 方法具体是如何实现的?

Network Inflation

spatial self-attention mechanism:

![]()

![]()

其中, z v i z_{v_i} zvi 是帧 v i v_i vi对应的潜码表示。 W ∗ W^* W∗是将输入投影到查询、键和值的可学习矩阵,d 是键和查询特征的输出维度。

我们提出使用稀疏版本的因果注意机制(causal attention mechanism),其中在帧 z v i z_{v_i} zvi 和帧 z v 1 z_{v_1} zv1 和 z v i − 1 z_{v_{i-1}} zvi−1 之间计算注意矩阵,保持低计算复杂度在 O ( 2 m ( N ) 2 ) O(2m(N)^2) O(2m(N)2)。

我们实现Attention(Q,k,V)如下:

![]()

其中 [ ⋅ ] [\cdot] [⋅]表示连接操作,视觉描述见图5。

Fine-Tuning and Inference

1)Model fine-tuning

我们微调整个时间自注意力 (T-Attn) 层,因为它们是新添加的。此外,我们建议通过更新交叉注意力中的查询投影来细化文本-视频对齐(Cross-Attn)。在实践中,与完全调优[39]相比,微调注意块在计算上是有效的,同时保留了预训练的T2I扩散模型的原始特性。我们在标准ldm[37]中使用相同的训练目标。图4 说明了带有突出显示可训练参数的微调过程。

2)基于DDIM反演的结构指导

通过没有文本条件的DDIM反演得到源视频V的潜在噪声。该噪声作为DDIM采样的起点,由编辑后的提示 T ∗ \mathcal{T}^* T∗指导。输出视频 V ∗ \mathcal{V}^* V∗ 由下式给出:

![]()

07 实验结果和对比效果如何?

Applications

1)Object editing.

我们的方法的主要应用之一是通过编辑文本提示来修改对象。这允许轻松替换、添加或删除对象。图 6 显示了一些示例.

2)Background change.

我们的方法还允许用户更改视频背景(即对象所在的位置),同时保留对象运动的一致性。例如,我们可以通过添加新位置/时间描述并将图 7 中的国家侧道路视图更改为海洋视图,将图 6 中滑雪人的背景修改为“海滩上”或“太阳落下”。

3)Style transfer.

由于预训练 T2I 模型的开放域知识,我们的方法将视频转换为各种难以仅从视频数据中学习的风格(12)。例如,我们通过将全局样式描述符附加到提示中,将现实世界的视频转换为漫画风格(图 6,或 Van Gogh风格(图 10)。

4)个性化可控生成

我们的方法可以很容易地与个性化的T2I模型集成(例如,DreamBooth[39],它以3-5张图像作为输入,并返回一个个性化的T2I模型),直接对它们进行细化。例如,我们可以使用“现代迪士尼风格”或“土豆头先生”个性化的DreamBooth来创建特定风格或主题的视频(图11)。我们的方法还可以与T2I适配器[29]和ControlNet[52]等条件T2I模型集成,在不需要额外训练成本的情况下对生成的视频进行不同的控制。例如,我们可以使用一系列人体姿势作为控制来进一步编辑运动(例如,图1中的舞蹈)。

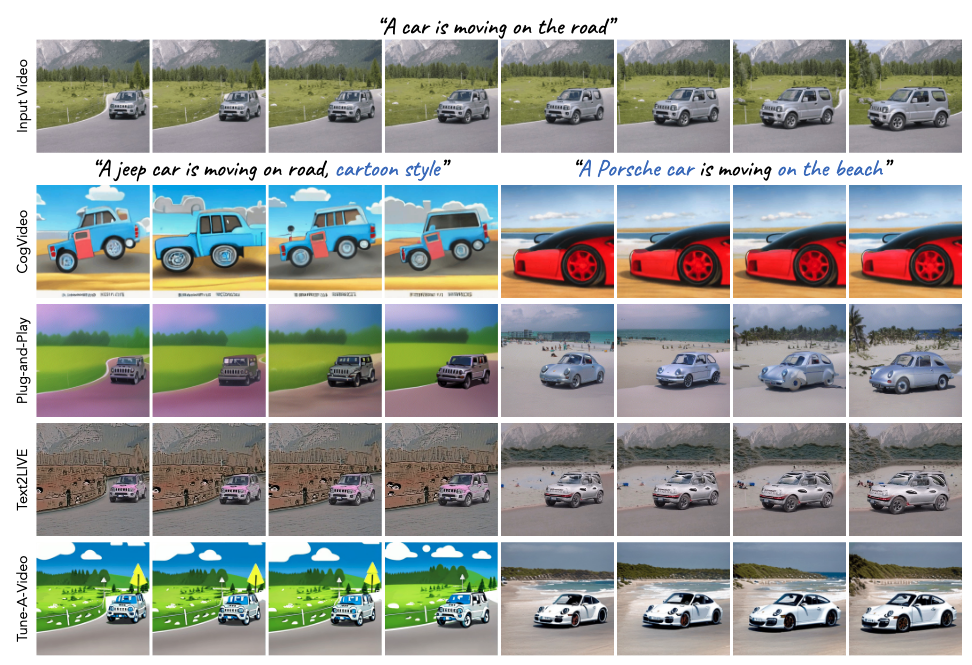

定性结果

我们在图7中给出了我们的方法与几个基线的视觉比较。 相比之下,我们的方法生成了时间连贯的视频,保留了输入视频中的结构信息,并与编辑过的单词和细节保持一致。另外的定性比较可以在图12中找到。

定量结果

我们通过automatic metrics和用户研究来根据基线量化我们的方法,并在表1中报告框架一致性和文本可信度。

08 消融研究告诉了我们什么?

我们在Tune-A-Video中进行了一项消融研究,以评估时空注意(ST-Attn)机制、DDIM反演和微调的重要性。每个设计都是单独的,以分析其影响。结果如图8所示。

这些结果表明,我们所有的关键设计都有助于我们方法的成功结果。

09 这个工作还是可以如何优化?

图9给出了输入视频中包含多个目标并出现遮挡时,我们的方法失败的情况。这可能是由于T2I模型在处理多个对象和对象交互方面的固有局限性。一个潜在的解决方案是使用附加的条件信息,如深度,使模型能够区分不同的对象及其相互作用。这方面的研究要留待将来研究。

10 结论

在本文中,我们介绍了T2V生成的一项新任务–one-shot视频调优。该任务涉及仅使用单个文本视频对和预训练的T2I模型来训练T2V生成器。我们提出Tune-A-Video,一个简单而有效的框架,用于文本驱动的视频生成和编辑。为了生成连续视频,我们提出了一种有效的调优策略和结构反演,可以生成时间相干视频。大量的实验证明了我们的方法在广泛的应用中取得了显著的效果。

原文链接:Tnue-A-Video:用于文本到视频生成的图像扩散模型的One-shot Tuning (by 小样本视觉与智能前沿)