JVM 面试题目

1.请简单描述下 JVM 运行时数据区包括哪些部分?

JVM 在执行 Java 程序的过程中会把它管理的内存分为若干个不同的区域,这些组成部

分有些是线程私有的,有些则是线程共享的

线程私有的:程序计数器,虚拟机栈,本地方法栈

线程共享的:方法区,堆

2.JVM 中是怎么判断对象可回收的?

可达性分析算法

这个算法的基本思想就是通过一系列的称为 “GC Roots” 的对象作为起点,从这些节

点开始向下搜索,节点所走过的路径称为引用链,当一个对象到 GC Roots 没有任何引用链

相连的话,则证明此对象是不可用的,可以被回收的。

3.方法区主要存储什么信息?

方法区是所有线程共享。主要用于存储类的信息、常量池、方法数据、方法代码等。方

法区逻辑上属于堆的一部分,但是为了与堆进行区分,通常又叫“非堆”。

4.请简单描述下 JVM 出现的几种异常?

主要是两种:StackOverFlowError 和 OutOfMemoryError.

StackOverFlowError:

当线程请求栈的深度超过当前 Java 虚拟机栈的最大深度的时候,就抛出

StackOverFlowError 异常。

OutOfMemoryError:

- 当线程请求栈时内存用完了,无法再动态扩展了,此时抛出 OutOfMemoryError 异

常。 - 堆内存或者永久代代/元空间不够,无法在分配对象或存放数据,同时堆空间或者

永久代/元空间无法再拓展,,此时抛出 OutOfMemoryError 异常。 - 垃圾回收器占用 JVM 中 98%的资源,同时回收效率不到 2%,JVM 会抛出

OutOfMemoryError,

5.在默认参数下,如果 Eden 区的大小为 80M,求堆空

间总大小?

根据比例可以推算出(Eden:survivor1:survivor2 =8:1:1),两个 survivor 区各 10M,

新生代 100M。老年代默认是年轻代的两倍,即 200M。那么堆总大小就是 3000M。

6.什么是程序计数器?为什么 JVM 需要它?

程序计数器记录当前线程正在执行的字节码的地址或行号。

JVM 中存在线程切换,主要作用是为了确保多线程情况下 JVM 程序的正常执行。

7.请描述下 JVM 中对象创建需要的几个步骤?

1)检查加载

先执行相应的类加载过程。如果没有,则进行类加载。

2)分配内存

分配方式两种:指针碰撞和空闲列表,Java 堆空间规整的话采用指针碰撞,不规整采

用空闲列表

3)内存空间初始化

JVM需要将分配到的内存空间都初始化为零值(如int值为0,boolean值为false等等)。

4)设置

虚拟机要对对象进行必要的设置,例如这个对象是哪个类的实例、如何才能找到类的元

数据信息、对象的哈希码、对象的 GC 分代年龄等信息。这些信息存放在对象的对象头之中。

5)对象初始化

最后调用构造方法。

8.JVM 对象的访问定位有哪两种?HostSpot 版本中用

哪种?

句柄和直接指针两种方式,

句柄: 如果使用句柄的话,那么 Java 堆中将会划分出一块内存来作为句柄池,

reference 中存储的就是对象的句柄地址,而句柄中包含了对象实例数据与类型数据各自的

具体地址信息;

直接指针: 如果使用直接指针访问,那么 Java 堆对象的布局中就必须考虑如何放置

访问类型数据的相关信息,而 reference 中存储的直接就是对象的地址。

HotSpot 中使用直接指针,使用直接指针访问方式最大的好处就是速度快,它节省了一

次指针定位的时间开销。

9.JVM 中存在哪些引用? - 强引用

以前我们使用的大部分引用实际上都是强引用,这是使用最普遍的引用。如果一个对象

具有强引用,那就类似于必不可少的生活用品,垃圾回收器绝不会回收它。当内存空 间不

足,Java 虚拟机宁愿抛出 OutOfMemoryError 错误,使程序异常终止,也不会靠随意回收具

有强引用的对象来解决内存不足问题。 - 软引用(SoftReference)

如果一个对象只具有软引用,那就类似于可有可无的生活用品。如果内存空间足够,垃

圾回收器就不会回收它,如果内存空间不足了,就会回收这些对象的内存。只要垃圾回收器

没有回收它,该对象就可以被程序使用。软引用可用来实现内存敏感的高速缓存。

软引用可以和一个引用队列(ReferenceQueue)联合使用,如果软引用所引用的对象被

垃圾回收,JAVA 虚拟机就会把这个软引用加入到与之关联的引用队列中。 - 弱引用(WeakReference)

如果一个对象只具有弱引用,那就类似于可有可无的生活用品。弱引用与软引用的区别

在于:只具有弱引用的对象拥有更短暂的生命周期。在垃圾回收器线程扫描它 所管辖的内

存区域的过程中,一旦发现了只具有弱引用的对象,不管当前内存空间足够与否,都会回收

它的内存。不过,由于垃圾回收器是一个优先级很低的线程, 因此不一定会很快发现那些

只具有弱引用的对象。

弱引用可以和一个引用队列(ReferenceQueue)联合使用,如果弱引用所引用的对象被

垃圾回收,Java 虚拟机就会把这个弱引用加入到与之关联的引用队列中。 - 虚引用(PhantomReference)

"虚引用"顾名思义,就是形同虚设,与其他几种引用都不同,虚引用并不会决定对象的

生命周期。如果一个对象仅持有虚引用,那么它就和没有任何引用一样,在任何时候都可能

被垃圾回收。

虚引用主要用来跟踪对象被垃圾回收的活动。

在程序设计中除了强引用,使用软引用的情况较多,这是因为软引用可以加速 JVM 对垃

圾内存的回收速度,可以维护系统的运行安全,防止内存溢出(OutOfMemory)等问题的产

生

10.JVM 中垃圾收集有哪些算法,各自的特点? - 标记-清除算法

标记-清除算法分为“标记”和“清除”阶段:首先标记出所有需要回收的对象,在标

记完成后统一回收所有被标记的对象。它是最基础的收集算法,效率也很高,但是会带来两

个明显的问题:

1)效率问题

2)空间问题(标记清除后会产生大量不连续的碎片) - 复制算法

为了解决效率问题,“复制”收集算法出现了。它可以将内存分为大小相同的两块,每

次使用其中的一块。当这一块的内存使用完后,就将还存活的对象复制到另一块去,然后再

把使用的空间一次清理掉。这样就使每次的内存回收都是对内存区间的一半进行回收。 - 标记-整理算法

根据老年代的特点特出的一种标记算法,标记过程仍然与“标记-清除”算法一样,但

后续步骤不是直接对可回收对象回收,而是让所有存活的对象向一端移动,然后直接清理掉

端边界以外的内存。

11.HotSpot 中的堆为什么要分为新生代和老年代?

将 Java 堆分为新生代和老年代,这样我们就可以根据各个年代的特点选择合适的垃圾

收集算法。

比如在新生代中,每次收集都会有大量对象死去,所以可以选择复制算法,只需要付出

少量对象的复制成本就可以完成每次垃圾收集。而老年代的对象存活几率是比较高的,而且

没有额外的空间对它进行分配担保,所以我们必须选择“标记-清除”或“标记-整理”算法

进行垃圾收集

12.JVM 中哪几种情况需要对类进行初始化?

虚拟机规范严格规定了有且只有五种情况必须立即对类进行“初始化”:

1。使用 new 关键字实例化对象的时候、读取或设置一个类的静态字段的时候,已经调

用一个类的静态方法的时候。

2.使用 Java.lang.reflect 包的方法对类进行反射调用的时候,如果类没有初始化,则

需要先触发其初始化。

3.当初始化一个类的时候,如果发现其父类没有被初始化就会先初始化它的父类。

4.当虚拟机启动的时候,用户需要指定一个要执行的主类(就是包含 main()方法的那

个类),虚拟机会先初始化这个类;

5.使用动态语言支持的时候,如果一个 Java.lang.invoke.MethodHandle 实例最后的解

析结果 REF_getstatic,REF_putstatic,REF_invokeStatic 的方法句柄,并且这个方法句柄

所对应的类没有进行初始化,则需要先出触发其初始化。

13.请简单描述下双亲委派模型?

双亲委派模型(Pattern Delegation Model),要求除了顶层的启动类加载器外,其余

的类加载器都应该有自己的父类加载器。这里父子关系通常是子类通过组合关系而不是继承

关系来复用父加载器的代码。

双亲委派模型的工作过程: 如果一个类加载器收到了类加载的请求,先把这个请求委

派给父类加载器去完成(所以所有的加载请求最终都应该传送到顶层的启动类加载器中),

只有当父加载器反馈自己无法完成加载请求时,子加载器才会尝试自己去加载。 - CMS 收集器有哪些特点?

总的来说,优点:并发收集,低停顿。缺点:CMS 收集器对 CPU 资源很敏感、CMS 收集器不

能处理浮动垃圾。

CMS 收集器是基于“标记—清除”算法实现的,它的运作过程相对于前面几种收集器来

说更复杂一些,整个过程分为 4 个步骤,包括:

1、初始标记-短暂,仅仅只是标记一下 GC Roots 能直接关联到的对象,速度很快。

2、并发标记-和用户的应用程序同时进行,进行 GC Roots 追踪的过程,标记从 GCRoots

开始关联的所有对象开始遍历整个可达分析路径的对象。这个时间比较长,所以采用并发处

理(垃圾回收器线程和用户线程同时工作)

3、重新标记-短暂,为了修正并发标记期间因用户程序继续运作而导致标记产生变动的

那一部分对象的标记记录,这个阶段的停顿时间一般会比初始标记阶段稍长一些,但远比并

发标记的时间短。

4、并发清除,由于整个过程中耗时最长的并发标记和并发清除过程收集器线程都可以

与用户线程一起工作,所以,从总体上来说,CMS 收集器的内存回收过程是与用户线程一起

并发执行的。

CMS 对处理器资源敏感,毕竟采用了并发的收集、当处理核心数不足 4 个时,CMS 对用

户的影响较大。

浮动垃圾:由于 CMS 并发清理阶段用户线程还在运行着,伴随程序运行自然就还会有新

的垃圾不断产生,这一部分垃圾出现在标记过程之后,CMS 无法在当次收集中处理掉它们,

只好留待下一次 GC 时再清理掉。这一部分垃圾就称为“浮动垃圾”。

由于浮动垃圾的存在,因此需要预留出一部分内存,意味着 CMS 收集不能像其它收集

器那样等待老年代快满的时候再回收。在 1.6 的版本中老年代空间使用率阈值(92%),如果

预留的内存不够存放浮动垃圾,就会出现 Concurrent Mode Failure,这时虚拟机将临时启

用 Serial Old 来替代 CMS。

15.G1 收集器有哪些特点?

在G1之前的其他收集器进行收集的范围都是整个新生代或者老年代,而G1不再是这样。

使用 G1 收集器时,Java 堆的内存布局就与其他收集器有很大差别,它将整个 Java 堆划分

为多个大小相等的独立区域(Region),虽然还保留有新生代和老年代的概念,但新生代和

老年代不再是物理隔离的了,它们都是一部分 Region(不需要连续)的集合。每一个区域

可以通过参数-XX:G1HeapRegionSize=size 来设置。

Region 中还有一块特殊区域 Humongous 区域,专门用于存储大对象,一般只要认为一

个对象超过了 Region 容量的一般可认为是大对象,如果对象超级大,那么使用连续的 N 个

Humongous 区域来存储。

并行与并发:G1 能充分利用多 CPU、多核环境下的硬件优势,使用多个 CPU(CPU 或者

CPU 核心)来缩短 Stop-The-World 停顿的时间,部分其他收集器原本需要停顿 Java 线程执

行的 GC 动作,G1 收集器仍然可以通过并发的方式让 Java 程序继续执行。

分代收集:与其他收集器一样,分代概念在 G1 中依然得以保留。虽然 G1 可以不需要其

他收集器配合就能独立管理整个 GC 堆,但它能够采用不同的方式去处理新创建的对象和已

经存活了一段时间、熬过多次 GC 的旧对象以获取更好的收集效果。

空间整合:与 CMS 的“标记—清理”算法不同,G1 从整体来看是基于“标记—整理”

算法实现的收集器,从局部(两个 Region 之间)上来看是基于“复制”算法实现的,但无

论如何,这两种算法都意味着 G1 运作期间不会产生内存空间碎片,收集后能提供规整的可

用内存。这种特性有利于程序长时间运行,分配大对象时不会因为无法找到连续内存空间而

提前触发下一次 GC。

同时 G1 追求可预测的停顿时间,G1 尝试调整新生代和老年代的比例,堆大小,晋升年

龄来达到这个目标时间。

一般在 G1 和 CMS 中间选择的话平衡点在 6~8G,只有内存比较大 G1 才能发挥优势。

16、JVM 类加载机制有哪几步,分别每一步做了什么

工作?

包括:加载(Loading)、验证(Verification)、准备(Preparation)、解析(Resolution)、

初始化(Initialization)阶段。其中验证、准备、解析 3 个部分统称为连接(Linking)。

加载

什么是需要开始类第一个阶段“加载”,虚拟机规范没有强制约束,这点交给虚拟机的

具体实现来自由把控。

“加载 loading”阶段是整个类加载(class loading)过程的一个阶段。

虚拟机需要完成以下 3 件事情:

1)通过一个类的全限定名来获取定义此类的二进制字节流。

2)将这个字节流所代表的静态存储结构转化为方法区的运行时数据结构。

3)在内存中生成一个代表这个类的 Java.lang.Class 对象,作为方法区这个类的各种

数据的访问入口。

验证

是连接阶段的第一步,这一阶段的目的是为了确保 Class 文件的字节流中包含的信息符

合当前虚拟机的要求,并且不会危害虚拟机自身的安全。但从整体上看,验证阶段大致上会

完成下面 4 个阶段的检验动作:文件格式验证、元数据验证、字节码验证、符号引用验证。

准备

是正式为类变量分配内存并设置类变量初始值的阶段,这些变量所使用的内存都将在方

法区中进行分配。这个阶段中有两个容易产生混淆的概念需要强调一下,首先,这时候进行

内存分配的仅包括类变量(被 static 修饰的变量),而不包括实例变量,实例变量将会在

对象实例化时随着对象一起分配在 Java 堆中。其次,这里所说的初始值“通常情况”下是

数据类型的零值,

解析

是虚拟机将常量池内的符号引用替换为直接引用的过程。部分详细内容见解析

初始化

初始化阶段,虚拟机规范则是严格规定了有且只有 6 种情况必须立即对类进行“初始

化”(而加载、验证、准备自然需要在此之前开始):

1)遇到 new、getstatic、putstatic 或 invokestatic 这 4 条字节码指令时,如果类没

有进行过初始化,则需要先触发其初始化。生成这 4 条指令的最常见的 Java 代码场景是:

使用 new 关键字实例化对象的时候。

读取或设置一个类的静态字段(被 final 修饰、已在编译期把结果放入常量池的静态字

段除外)的时候

调用一个类的静态方法的时候。

2)使用 Java.lang.reflect 包的方法对类进行反射调用的时候,如果类没有进行过初

始化,则需要先触发其初始化。

3)当初始化一个类的时候,如果发现其父类还没有进行过初始化,则需要先触发其父

类的初始化。

4)当虚拟机启动时,用户需要指定一个要执行的主类(包含 main()方法的那个类),

虚拟机会先初始化这个主类。

5)当使用 JDK 1.7 的动态语言支持时,如果一个 Java.lang.invoke.MethodHandle 实

例最后的解析结果 REF_getStatic、REF_putStatic、REF_invokeStatic 的方法句柄,并且

这个方法句柄所对应的类没有进行过初始化,则需要先触发其初始化。

6)当一个接口中定义了 JDK1.8 新加入的默认方法(被 default 关键字修饰的接口方法)

时,如果这个接口的实现类发生了初始化,那该接口要在其之前被初始化。

初始化是类加载过程的最后一步,前面的类加载过程中,除了在加载阶段用户应用程序

可以通过自定义类加载器参与之外,其余动作完全由虚拟机主导和控制。到了初始化阶段,

则根据程序员通过程序制定的主观计划去初始化类变量和其他资源,或者可以从另外一个角

度来表达:初始化阶段是执行类构造器<clinit>()方法的过程。<clinit>()方法是

由编译器自动收集类中的所有类变量的赋值动作和静态语句块(static{}块)中的语句合并

产生的,编译器收集的顺序是由语句在源文件中出现的顺序所决定的。

<clinit>()方法对于类或接口来说并不是必需的,如果一个类中没有静态语句块,

也没有对类变量的赋值操作,那么编译器可以不为这个类生成<clinit>()方法。

并发编程面试题目

1.在 Java 中守护线程和用户线程的区别?

Java 中的线程分为两种:守护线程(Daemon)和用户线程(User)。

任何线程都可以设置为守护线程和用户线程,通过方法 Thread.setDaemon(bool on);

true 则把该线程设置为守护线程,反之则为用户线程。Thread.setDaemon()必须在

Thread.start()之前调用,否则运行时会抛出异常。

两者的区别:

唯一的区别是判断虚拟机(JVM)何时离开,Daemon 是为其他线程提供服务,如果全部

的 User Thread 已经结束,Daemon 没有可服务的线程,JVM 关闭。

扩展:Thread Dump 打印出来的线程信息,含有 daemon 字样的线程即为守护进程

2.线程与进程的区别

进程是操作系统配资源的最小单元,线程是操作系统调度的最小单元。

一个程序至少有一个进程,一个进程至少有一个线程。

3.什么是多线程中的上下文切换

多线程会共同使用一组计算机上的 CPU,而线程数大于给程序分配的 CPU 数量时,为了

让各个线程都有执行的机会,就需要轮转使用 CPU。不同的线程切换使用 CPU 发生的切换数

据等就是上下文切换。

4.死锁与活锁的区别,死锁与饥饿的区别?

死锁:是指两个或两个以上的进程(或线程)在执行过程中,因争夺资源而造成的一

种互相等待的现象,若无外力作用,它们都将无法推进下去。

产生死锁的必要条件:

互斥条件:所谓互斥就是进程在某一时间内独占资源。

请求与保持条件:一个进程因请求资源而阻塞时,对已获得的资源保持不放。

不剥夺条件:进程已获得资源,在末使用完之前,不能强行剥夺。

循环等待条件:若干进程之间形成一种头尾相接的循环等待资源关系。

活锁:任务或者执行者没有被阻塞,由于某些条件没有满足,导致一直重复尝试,失

败,尝试,失败。

活锁和死锁的区别在于,处于活锁的实体是在不断的改变状态,所谓的“活”, 而处

于死锁的实体表现为等待;活锁有可能自行解开,死锁则不能。

饥饿:一个或者多个线程因为种种原因无法获得所需要的资源,导致一直无法执行的

状态。 - synchronized 底层实现原理

synchronized (this)原理:涉及两条指令:monitorenter,monitorexit;再说同

步方法,从同步方法反编译的结果来看,方法的同步并没有通过指令 monitorenter 和

monitorexit 来实现,相对于普通方法,其常量池中多了 ACC_SYNCHRONIZED 标示符。

JVM 就是根据该标示符来实现方法的同步的:当方法被调用时,调用指令将会检查方法

的 ACC_SYNCHRONIZED 访问标志是否被设置,如果设置了,执行线程将先获取 monitor,获

取成功之后才能执行方法体,方法执行完后再释放 monitor。在方法执行期间,其他任何线

程都无法再获得同一个 monitor 对象。

注意,这个问题可能会接着追问,Java 对象头信息,偏向锁,轻量锁,重量级锁及其

他们相互间转化。

6.什么是线程组,为什么在 Java 中不推荐使用?

ThreadGroup 类,可以把线程归属到某一个线程组中,线程组中可以有线程对象,也可

以有线程组,组中还可以有线程,这样的组织结构有点类似于树的形式。

1.线程组 ThreadGroup 对象中比较有用的方法是 stop、resume、suspend 等方法,由

于这几个方法会导致线程的安全问题(主要是死锁问题),已经被官方废弃掉了,所以线程

组本身的应用价值就大打折扣了。

2.线程组 ThreadGroup 不是线程安全的,这在使用过程中获取的信息并不全是及时有

效的,这就降低了它的统计使用价值。

7.什么是 Executors 框架?为什么使用 Executor 框

架?

Executor 框架是一个根据一组执行策略调用,调度,执行和控制的异步任务的框架。

每次执行任务创建线程 new Thread()比较消耗性能,创建一个线程是比较耗时、耗

资源的。

调用 new Thread()创建的线程缺乏管理,而且可以无限制的创建,线程之间的相互

竞争会导致过多占用系统资源而导致系统瘫痪,还有线程之间的频繁交替也会消耗很多系统

资源。

接使用 new Thread() 启动的线程不利于扩展,比如定时执行、定期执行、定时定期

执行、线程中断等都不便实现。

8.在 Java 中 Executor 和 Executors 的区别?

Executors 工具类的不同方法按照我们的需求创建了不同的线程池,来满足业务的需

求。

Executor 接口对象能执行我们的线程任务。

ExecutorService 接口继承了 Executor 接口并进行了扩展,提供了更多的方法我们能

获得任务执行的状态并且可以获取任务的返回值。

使用 ThreadPoolExecutor 可以创建自定义线程池。

9.什么是原子操作?在 Java Concurrency API 中有

哪些原子类(atomic classes)?

原子操作(atomic operation)意为”不可被中断的一个或一系列操作” 。

处理器使用基于对缓存加锁或总线加锁的方式来实现多处理器之间的原子操作。

在Java中可以通过锁和循环CAS的方式来实现原子操作。CAS操作——Compare & Set,

或 是 Compare & Swap ,现在几乎所有的 CPU 指令都支持 CAS 的原子操作。

Java.util.concurrent.atomic 下提供了大量的原子操作类,比如原子类:AtomicBoolean,

AtomicInteger, AtomicLong ,AtomicReference ,原子数组: AtomicIntegerArray,

AtomicLongArray,AtomicReferenceArray ,原子属性更新器:AtomicLongFieldUpdater,

AtomicIntegerFieldUpdater,AtomicReferenceFieldUpdater - Java Concurrency API 中的 Lock 接口(Lock

interface)是什么?对比 synchronized 它有什么

优势?

Lock 接口比同步方法和同步块提供了更具扩展性的锁操作。

他们允许更灵活的结构,可以具有完全不同的性质,并且可以支持多个相关类的条件

对象。

它的优势有:可以使锁更公平,可以使线程在等待锁的时候响应中断,可以让线程尝

试获取锁,并在无法获取锁的时候立即返回或者等待一段时间,可以在不同的范围,以不同

的顺序获取和释放锁。

整体上来说 Lock 是 synchronized 的扩展版,Lock 提供了无条件的、可轮询的(tryLock

方法)、定时的(tryLock 带参方法)、可中断的(lockInterruptibly)、可多条件队列

的(newCondition 方法)锁操作。另外 Lock 的实现类基本都支持非公平锁(默认)和公平

锁,synchronized 只支持非公平锁,当然,在大部分情况下,非公平锁是高效的选择。 - 什么是阻塞队列?阻塞队列的实现原理是什

么?如何使用阻塞队列来实现生产者-消费者模

型?

阻塞队列(BlockingQueue)是一个支持两个附加操作的队列。

这两个附加的操作是:在队列为空时,获取元素的线程会等待队列变为非空。当队列

满时,存储元素的线程会等待队列可用。

阻塞队列常用于生产者和消费者的场景,生产者是往队列里添加元素的线程,消费者

是从队列里拿元素的线程。阻塞队列就是生产者存放元素的容器,而消费者也只从容器里拿

元素。

JDK7 提供了 7 个阻塞队列。在实现上,主要是利用了 Condition 和 Lock 的等待通知模

式。 - 什么是 Callable 和 Future?

Callable 接口类似于 Runnable,从名字就可以看出来了,但是 Runnable 不会返回结

果,并且无法抛出返回结果的异常,而 Callable 功能更强大一些,被线程执行后,可以返

回值,这个返回值可以被 Future 拿到,也就是说,Future 可以拿到异步执行任务的返回值。

可以认为是带有回调的 Runnable。

Future 接口表示异步任务,是还没有完成的任务给出的未来结果。所以说 Callable

用于产生结果,Future 用于获取结果。 - 什么是 FutureTask?

在 Java 并发程序中 FutureTask 表示一个可以取消的异步运算。它有启动和取消运算、

查询运算是否完成和取回运算结果等方法。只有当运算完成的时候结果才能取回,如果运算

尚未完成 get 方法将会阻塞。一个 FutureTask 对象可以对调用了 Callable 和 Runnable 的

对象进行包装,由于 FutureTask 也是调用了 Runnable 接口所以它可以提交给 Executor 来

执行。 - 什么是竞争条件?

当多个进程都企图对共享数据进行某种处理,而最后的结果又取决于进程运行的顺序

时,则我们认为这发生了竞争条件(race condition)。 - 启动线程的方式有几种?

两种,启动线程的方式有:

1、X extends Thread;,然后 X.start

2、X implements Runnable;然后交给 Thread 运行 - 为什么我们调用 start()方法时会执行 run()

方法,为什么我们不能直接调用 run()方法?

当你调用 start()方法时你将创建新的线程,并且执行在 run()方法里的代码。

但是如果你直接调用 run()方法,它不会创建新的线程也不会执行调用线程的代码,

只会把 run 方法当作普通方法去执行。 - 执行两次 start 方法可以吗?

不行,程序会抛出 IlegelState 异常。 - 在 Java 中 CycliBarriar 和 CountdownLatch 有

什么区别?

CyclicBarrier 可以重复使用,而 CountdownLatch 不能重复使用。 - 什么是不可变对象,它对写并发应用有什么帮

助?

不可变对象(Immutable Objects)即对象一旦被创建它的状态(对象的数据,也即对

象属性值)就不能改变,反之即为可变对象(Mutable Objects)。

不可变对象的类即为不可变类(Immutable Class)。Java 平台类库中包含许多不可变

类,如 String、基本类型的包装类、BigInteger 和 BigDecimal 等。

不可变对象天生是线程安全的。它们的常量(域)是在构造函数中创建的。既然它们

的状态无法修改,这些常量永远不会变。

不可变对象永远是线程安全的。

只有满足如下状态,一个对象才是不可变的;

它的状态不能在创建后再被修改;

所有域都是 final 类型;并且,

它被正确创建 - notify()和 notifyAll()有什么区别?

当一个线程进入 wait 之后,就必须等其他线程 notify/notifyall,使用 notifyall,可

以唤醒所有处于 wait 状态的线程,使其重新进入锁的争夺队列中,而 notify 只能唤醒一个。

如果没把握,建议 notifyAll,防止 notigy 因为信号丢失而造成程序异常。 - 什么是可重入锁(ReentrantLock)?谈谈它的

实现。

线程可以重复进入任何一个它已经拥有的锁所同步着的代码块,synchronized、

ReentrantLock 都是可重入的锁。在实现上,就是线程每次获取锁时判定如果获得锁的线程

是它自己时,简单将计数器累积即可,每 释放一次锁,进行计数器累减,直到计算器归零,

表示线程已经彻底释放锁。 - 当一个线程进入某个对象的一个 synchronized

的实例方法后,其它线程是否可进入此对象的其它

方法?

如果其他方法没有 synchronized 的话,其他线程是可以进入的。

所以要开放一个线程安全的对象时,得保证每个方法都是线程安全的。 - 乐观锁和悲观锁的理解及如何实现,有哪些实现

方式?

悲观锁:总是假设最坏的情况,每次去拿数据的时候都认为别人会修改,所以每次在

拿数据的时候都会上锁,这样别人想拿这个数据就会阻塞直到它拿到锁。Java 里面的同步

原语 synchronized 关键字的实现是悲观锁。

乐观锁:顾名思义,就是很乐观,每次去拿数据的时候都认为别人不会修改,所以不

会上锁,但是在更新的时候会判断一下在此期间别人有没有去更新这个数据,可以使用版本

号等机制。在 Java 中 j 原子变量类就是使用了乐观锁的一种实现方式 CAS 实现的。

乐观锁的实现方式:

使用版本标识来确定读到的数据与提交时的数据是否一致。提交后修改版本标识,不

一致时可以采取丢弃和再次尝试的策略。

Java 中的 Compare and Swap 即 CAS ,当多个线程尝试使用 CAS 同时更新同一个变量

时,只有其中一个线程能更新变量的值,而其它线程都失败,失败的线程并不会被挂起,而

是被告知这次竞争中失败,并可以再次尝试。 - 什么是 CAS 操作,缺点是什么?

CAS 的基本思路就是,如果这个地址上的值和期望的值相等,则给其赋予新值,否则不

做任何事儿,但是要返回原值是多少。每一个 CAS 操作过程都包含三个运算符:一个内存地

址 V,一个期望的值 A 和一个新值 B,操作的时候如果这个地址上存放的值等于这个期望的

值 A,则将地址上的值赋为新值 B,否则不做任何操作。

CAS 缺点:

ABA 问题:

比如说一个线程 one 从内存位置 V 中取出 A,这时候另一个线程 two 也从内存中取出 A,

并且 two 进行了一些操作变成了 B,然后 two 又将 V 位置的数据变成 A,这时候线程 one 进

行 CAS 操作发现内存中仍然是 A,然后 one 操作成功。尽管线程 one 的 CAS 操作成功,但可

能存在潜藏的问题。从 Java1.5 开 始 JDK 的 atomic 包里提供了一个类

AtomicStampedReference 来解决 ABA 问题。

循环时间长开销大:

对于资源竞争严重(线程冲突严重)的情况,CAS 自旋的概率会比较大,从而浪费更多

的 CPU 资源,效率低于 synchronized。

只能保证一个共享变量的原子操作:

当对一个共享变量执行操作时,我们可以使用循环 CAS 的方式来保证原子操作,但是

对多个共享变量操作时,循环 CAS 就无法保证操作的原子性,这个时候就可以用锁。 - SynchronizedMap 和 ConcurrentHashMap 有什么

区别?

SynchronizedMap 一次锁住整张表来保证线程安全,所以每次只能有一个线程来访为

map。

ConcurrentHashMap 使用分段锁来保证在多线程下的性能。 - 写时复制容器可以用于什么应用场景?

CopyOnWrite 并发容器用于对于绝大部分访问都是读,且只是偶尔写的并发场景。比如

白名单,黑名单,商品类目的访问和更新场景。

透露的思想

读写分离,读和写分开

最终一致性

使用另外开辟空间的思路,来解决并发冲突 - volatile 有什么用?能否用一句话说明下

volatile 的应用场景?

volatile 保证内存可见性和禁止指令重排。

volatile 用于多线程环境下的一写多读,或者无关联的多写。 - 为什么代码会重排序?

在执行程序时,为了提供性能,处理器和编译器常常会对指令进行重排序,但是不能

随意重排序,不是你想怎么排序就怎么排序,它需要满足以下两个条件:

在单线程环境下不能改变程序运行的结果;

存在数据依赖关系的不允许重排序 - 在 Java 中 wait 和 sleep 方法的不同?

最大的不同是在等待时 wait 会释放锁,而 sleep 一直持有锁。Wait 通常被用于线程间

交互,sleep 通常被用于暂停执行。 - 一个线程运行时发生异常会怎样?

如果异常没有被捕获该线程将会停止执行。Thread.UncaughtExceptionHandler 是用于

处理未捕获异常造成线程突然中断情况的一个内嵌接口。当一个未捕获异常将造成线程中断

的时候 JVM 会使用 Thread.getUncaughtExceptionHandler ()来查询线程的

UncaughtExceptionHandler并将线程和异常作为参数传递给handler的uncaughtException

()方法进行处理。 - 为什么 wait, notify 和 notifyAll 这些方法不

在 thread 类里面?

JAVA 提供的锁是对象级的而不是线程级的,每个对象都有锁,通过线程获得。如果线

程需要等待某些锁那么调用对象中的 wait()方法就有意义了。如果 wait()方法定义在

Thread 类中,线程正在等待的是哪个锁就不明显了。简单的说,由于 wait,notify 和

notifyAll 都是锁级别的操作,所以把他们定义在 Object 类中因为锁属于对象。 - 什么是 ThreadLocal 变量?

ThreadLocal 是 Java 里一种特殊的变量。每个线程都有一个 ThreadLocal 就是每个线

程都拥有了自己独立的一个变量,竞争条件被彻底消除了。

其实现原理是,在 Thread 中有一个 ThreadLocalMap 类型的成员变量,线程的变量副

本就放在这个 ThreadLocalMap 中,这个 ThreadLocalMap 就是以 ThreadLocal 为 key,线程

的变量副本为 value。 - Java 中 interrupted 和 isInterrupted 方法的

区别?

interrupted() 和 isInterrupted()的主要区别是前者会将中断状态清除而后者

不会。Java 多线程的中断机制是用内部标识来实现的,调用 Thread.interrupt()来中断

一个线程就会设置中断标识为 true。当中断线程调用静态方法 Thread.interrupted()来

检查中断状态时,中断状态会被清零。而非静态方法 isInterrupted()用来查询其它线程

的中断状态且不会改变中断状态标识。 - 为什么wait和notify方法要在同步块中调用?

主要是因为 Java API 强制要求这样做,如果你不这么做,你的代码会抛出

IllegalMonitorStateException 异常。 - 为什么你应该在循环中检查等待条件?

处于等待状态的线程可能会收到错误警报和伪唤醒,如果不在循环中检查等待条件,

程序就会在没有满足结束条件的情况下退出。因此,当一个等待线程醒来时,不能认为它原

来的等待状态仍然是有效的,在 notify()方法调用之后和等待线程醒来之前这段时间它

可能会改变。这就是在循环中使用 wait()方法效果更好的原因 - 怎么检测一个线程是否拥有锁?

在 Java.lang.Thread 中有一个方法叫 holdsLock(),它返回 true 如果当且仅当当前

线程拥有某个具体对象的锁。 - 你如何在 Java 中获取线程堆栈信息?

kill -3 [Java pid]

不会在当前终端输出,它会输出到代码执行的或指定的地方去。比如,kill -3 tomcat

pid, 输出堆栈到 log 目录下。

Jstack [Java pid]

这个比较简单,在当前终端显示,也可以重定向到指定文件中。

或者使用 Java 提供的拟机线程系统的管理接口 ManagementFactory.getThreadMXBean

()。 - Java 线程池中 submit() 和 execute()方法

有什么区别?

两个方法都可以向线程池提交任务,execute()方法的返回类型是 void,它定义在

Executor 接口中。

而 submit()方法可以返回持有计算结果的 Future 对象,它定义在 ExecutorService

接口中,它扩展了 Executor 接口 - 你对线程优先级的理解是什么?

每一个线程都是有优先级的,一般来说,高优先级的线程在运行时会具有优先权,但

这依赖于线程调度的实现,这个实现是和操作系统相关的(OS dependent)。我们可以定义

线程的优先级,但是这并不能保证高优先级的线程会在低优先级的线程前执行。线程优先级

是一个 int 变量(从 1-10),1 代表最低优先级,10 代表最高优先级。

Java 的线程优先级调度会委托给操作系统去处理,所以与具体的操作系统优先级有关,

如非特别需要,一般无需设置线程优先级。 - 你如何确保 main()方法所在的线程是 Java 程

序最后结束的线程?

可以使用 Thread 类的 join()方法(或者 CountDownLatch 工具类)来确保所有程序

创建的线程在 main()方法退出前结束。 - 为什么 Thread 类的 sleep()和 yield ()方

法是静态的?

Thread 类的 sleep()和 yield()方法将在当前正在执行的线程上运行。所以在其他

处于等待状态的线程上调用这些方法是没有意义的。这就是为什么这些方法是静态的。它们

可以在当前正在执行的线程中工作,并避免程序员错误的认为可以在其他非运行线程调用这

些方法。 - 现在有 T1、T2、T3 三个线程,你怎样保证 T2 在

T1 执行完后执行,T3 在 T2 执行完后执行?

可以用 join 方法实现。 - 用 Java 写代码来解决生产者——消费者问题。

阻塞队列实现即可,也可以用 wait 和 notify 来解决这个问题,或者用 Semaphore - Java 中如何停止一个线程?

使用共享变量的方式

在这种方式中,之所以引入共享变量,是因为该变量可以被多个执行相同任务的线程

用来作为是否中断的信号,通知中断线程的执行。

使用 interrupt 方法终止线程

如果一个线程由于等待某些事件的发生而被阻塞,又该怎样停止该线程呢?比如当一

个线程由于需要等候键盘输入而被阻塞,或者调用 Thread.join()方法,或者 Thread.sleep

()方法,在网络中调用 ServerSocket.accept()方法,或者调用了 DatagramSocket.receive

()方法时,都有可能导致线程阻塞,使线程处于处于不可运行状态时,即使主程序中将该

线程的共享变量设置为 true,但该线程此时根本无法检查循环标志,当然也就无法立即中

断。所以应该尽量使用 Thread 提供的 interrupt()方法,因为该方法虽然不会中断一个

正在运行的线程,但是它可以使一个被阻塞的线程抛出一个中断异常,从而使线程提前结束

阻塞状态。 - JVM中哪个参数是用来控制线程的栈堆栈大小的

-Xss - 如果同步块内的线程抛出异常锁会释放吗?

会 - 单例模式的双重检查实现是什么?为什么并不

安全?如何在 Java 中创建线程安全的

Singleton?

不安全的根本原因是重排序会导致未初始化完成的对象可以被其他线程看见而导致错

误。创建安全的单例模式有:延迟占位模式、在声明的时候就 new 这个类的实例、枚举 - 请概述线程池的创建参数,怎么样合理配置一个

线程池的参数?

线程的构造方法如下:

public ThreadPoolExecutor ( int corePoolSize,int maximumPoolSize,long

keepAliveTime,TimeUnit unit,BlockingQueue workQueue,ThreadFactory

threadFactory,RejectedExecutionHandler handler)

corePoolSize

线程池中的核心线程数,当提交一个任务时,线程池创建一个新线程执行任务,直到

当前线程数等于 corePoolSize;

如果当前线程数为 corePoolSize,继续提交的任务被保存到阻塞队列中,等待被执行;

如果执行了线程池的 prestartAllCoreThreads()方法,线程池会提前创建并启动所

有核心线程。

maximumPoolSize

线程池中允许的最大线程数。如果当前阻塞队列满了,且继续提交任务,则创建新的

线程执行任务,前提是当前线程数小于 maximumPoolSize

keepAliveTime

线程空闲时的存活时间,即当线程没有任务执行时,继续存活的时间。默认情况下,

该参数只在线程数大于 corePoolSize 时才有用

TimeUnit

keepAliveTime 的时间单位

workQueue

用于保存等待执行的任务的阻塞队列,一般来说,我们应该尽量使用有界队列,因为

使用无界队列作为工作队列会对线程池带来如下影响。

1)当线程池中的线程数达到 corePoolSize 后,新任务将在无界队列中等待,因此线

程池中的线程数不会超过 corePoolSize。

2)由于 1,使用无界队列时 maximumPoolSize 将是一个无效参数。

3)由于 1 和 2,使用无界队列时 keepAliveTime 将是一个无效参数。

4)更重要的,使用无界 queue 可能会耗尽系统资源,有界队列则有助于防止资源耗尽,

同时即使使用有界队列,也要尽量控制队列的大小在一个合适的范围。

所以我们一般会使用, ArrayBlockingQueue 、 LinkedBlockingQueue 、

SynchronousQueue、PriorityBlockingQueue。

threadFactory

创建线程的工厂,通过自定义的线程工厂可以给每个新建的线程设置一个具有识别度

的线程名,当然还可以更加自由的对线程做更多的设置,比如设置所有的线程为守护线程。

Executors 静态工厂里默认的 threadFactory,线程的命名规则是“pool-数字-thread-

数字”。

RejectedExecutionHandler

线程池的饱和策略,当阻塞队列满了,且没有空闲的工作线程,如果继续提交任务,

必须采取一种策略处理该任务,线程池提供了 4 种策略:

(1)AbortPolicy:直接抛出异常,默认策略;

(2)CallerRunsPolicy:用调用者所在的线程来执行任务;

(3)DiscardOldestPolicy:丢弃阻塞队列中靠最前的任务,并执行当前任务;

(4)DiscardPolicy:直接丢弃任务;

当然也可以根据应用场景实现 RejectedExecutionHandler 接口,自定义饱和策略,如

记录日志或持久化存储不能处理的任务。

线程池的工作机制总结

1)如果当前运行的线程少于 corePoolSize,则创建新线程来执行任务(注意,执行这

一步骤需要获取全局锁)。

2)如果运行的线程等于或多于 corePoolSize,则将任务加入 BlockingQueue。

3)如果无法将任务加入 BlockingQueue(队列已满),则创建新的线程来处理任务。

4)如果创建新线程将使当前运行的线程超出 maximumPoolSize,任务将被拒绝,并调

用 RejectedExecutionHandler.rejectedExecution()方法。

合理地配置线程池

要想合理地配置线程池,就必须首先分析任务特性

要想合理地配置线程池,就必须首先分析任务特性,可以从以下几个角度来分析。

?任务的性质:CPU 密集型任务、IO 密集型任务和混合型任务。

?任务的优先级:高、中和低。

?任务的执行时间:长、中和短。

?任务的依赖性:是否依赖其他系统资源,如数据库连接。

性质不同的任务可以用不同规模的线程池分开处理。

CPU 密集型任务应配置尽可能小的线程,如配置 Ncpu+1 个线程的线程池。由于 IO 密集

型任务线程并不是一直在执行任务,则应配置尽可能多的线程,如 2*Ncpu。

混合型的任务,如果可以拆分,将其拆分成一个 CPU 密集型任务和一个 IO 密集型任务,

只要这两个任务执行的时间相差不是太大,那么分解后执行的吞吐量将高于串行执行的吞吐

量。如果这两个任务执行时间相差太大,则没必要进行分解。可以通过 Runtime.getRuntime

().availableProcessors()方法获得当前设备的 CPU 个数。

对于 IO 型的任务的最佳线程数,有个公式可以计算

Nthreads = NCPU * UCPU * (1 + W/C)

其中:

?NCPU 是处理器的核的数目

?UCPU 是期望的 CPU 利用率(该值应该介于 0 和 1 之间)

?W/C 是等待时间与计算时间的比率

等待时间与计算时间我们在 Linux 下使用相关的 vmstat 命令或者 top 命令查看。

优先级不同的任务可以使用优先级队列 PriorityBlockingQueue 来处理。它可以让优

先级高的任务先执行。

执行时间不同的任务可以交给不同规模的线程池来处理,或者可以使用优先级队列,

让执行时间短的任务先执行。

依赖数据库连接池的任务,因为线程提交 SQL 后需要等待数据库返回结果,等待的时

间越长,则 CPU 空闲时间就越长,那么线程数应该设置得越大,这样才能更好地利用 CPU。

建议使用有界队列。有界队列能增加系统的稳定性和预警能力,可以根据需要设大一

点儿,比如几千。

假设,我们现在有一个 Web 系统,里面使用了线程池来处理业务,在某些情况下,系

统里后台任务线程池的队列和线程池全满了,不断抛出抛弃任务的异常,通过排查发现是数

据库出现了问题,导致执行 SQL 变得非常缓慢,因为后台任务线程池里的任务全是需要向数

据库查询和插入数据的,所以导致线程池里的工作线程全部阻塞,任务积压在线程池里。

如果当时我们设置成无界队列,那么线程池的队列就会越来越多,有可能会撑满内存,

导致整个系统不可用,而不只是后台任务出现问题。 - 请概述锁的公平和非公平,JDK 内部是如何实现

的。

公平锁是指所有试图获得锁的线程按照获取锁的顺序依次获得锁,而非公平锁则是当

前的锁状态没有被占用时,当前线程可以直接占用,而不需要等待。在实现上,非公平锁逻辑

基本跟公平锁一致,唯一的区别是,当前线程不需要判断同步队列中是否有等待线程。

非公平锁性能高于公平锁性能。首先,在恢复一个被挂起的线程与该线程真正运行之

间存在着严重的延迟。而且,非公平锁能更充分的利用 cpu 的时间片,尽量的减少 cpu 空闲

的状态时间。

使用场景的话呢,其实还是和他们的属性一一相关,比如:如果业务中线程占用(处

理)时间要远长于线程等待,那用非公平锁其实效率并不明显,但是用公平锁可以保证不会

有线程被饿死。 - 请概述 AQS

是用来构建锁或者其他同步组件的基础框架,比如 ReentrantLock 、

ReentrantReadWriteLock 和 CountDownLatch 就是基于 AQS 实现的。它使用了一个 int 成员

变量表示同步状态,通过内置的 FIFO 队列来完成资源获取线程的排队工作。它是 CLH 队列

锁的一种变体实现。它可以实现 2 种同步方式:独占式,共享式。

AQS 的主要使用方式是继承,子类通过继承 AQS 并实现它的抽象方法来管理同步状态,

同步器的设计基于模板方法模式,所以如果要实现我们自己的同步工具类就需要覆盖其中几

个可重写的方法,如 tryAcquire、tryReleaseShared 等等。

这样设计的目的是同步组件(比如锁)是面向使用者的,它定义了使用者与同步组件

交互的接口(比如可以允许两个线程并行访问),隐藏了实现细节;同步器面向的是锁的实

现者,它简化了锁的实现方式,屏蔽了同步状态管理、线程的排队、等待与唤醒等底层操作。

这样就很好地隔离了使用者和实现者所需关注的领域。

在内部,AQS 维护一个共享资源 state,通过内置的 FIFO 来完成获取资源线程的排队

工作。该队列由一个一个的 Node 结点组成,每个 Node 结点维护一个 prev 引用和 next 引用,

分别指向自己的前驱和后继结点,构成一个双端双向链表。

同时与 Condition 相关的等待队列,节点类型也是 Node,构成一个单向链表。 - 请概述 volatile

volatile 关键字的作用主要有两点:

多线程主要围绕可见性和原子性两个特性而展开,使用 volatile 关键字修饰的变量,

保证了其在多线程之间的可见性,即每次读取到 volatile 变量,一定是最新的数据。但是

volatile 不能保证操作的原子,对任意单个 volatile 变量的读/写具有原子性,但类似于

++这种复合操作不具有原子性。。

代码底层在执行时为了获取更好的性能会对指令进行重排序,多线程下可能会出现一

些意想不到的问题。使用 volatile 则会对禁止重排序,当然这也一定程度上降低了代码执

行效率。

同时在内存语义上,当写一个 volatile 变量时,JMM 会把该线程对应的本地内存中的

共享变量值刷新到主内存,当读一个 volatile 变量时,JMM 会把该线程对应的本地内存置

为无效。线程接下来将从主内存中读取共享变量。

在 Java 中对于 volatile 修饰的变量,编译器在生成字节码时,会在指令序列中插入

内存屏障来禁止特定类型的处理器重排序问题、强制刷新和读取。

在具体实现上,volatile 关键字修饰的变量会存在一个“lock:”的前缀。它不是一种

内存屏障,但是它能完成类似内存屏障的功能。Lock 会对 CPU 总线和高速缓存加锁,可以

理解为 CPU 指令级的一种锁。

同时该指令会将当前处理器缓存行的数据直接写会到系统内存中,且这个写回内存的

操作会使在其他 CPU 里缓存了该地址的数据无效。 - HashMap 和 HashTable 有什么区别?

A:①、HashMap 是线程不安全的,HashTable 是线程安全的;

②、由于线程安全,所以 HashTable 的效率比不上 HashMap;

③、HashMap 最多只允许一条记录的键为 null,允许多条记录的值为 null,而

HashTable 不允许;

④、HashMap 默认初始化数组的大小为 16,HashTable 为 11,前者扩容时,扩大两倍,

后者扩大两倍+1;

⑤、HashMap 需要重新计算 hash 值,而 HashTable 直接使用对象的 hashCode - Java 中的另一个线程安全的与 HashMap 极其

类似的类是什么?同样是线程安全,它与

HashTable 在线程同步上有什么不同?

A:ConcurrentHashMap 类(是 Java 并发包 Java.util.concurrent 中提供的一个线

程安全且高效的 HashMap 实现)。

HashTable 是使用 synchronize 关键字加锁的原理(就是对对象加锁);

而针对 ConcurrentHashMap,在 JDK 1.7 中采用分段锁的方式;JDK 1.8 中直接采用

了 CAS(无锁算法)+ synchronized,也采用分段锁的方式并大大缩小了锁的粒度。 - HashMap & ConcurrentHashMap 的区别?

A:除了加锁,原理上无太大区别。

另外,HashMap 的键值对允许有 null,但是 ConCurrentHashMap 都不允许。

在数据结构上,红黑树相关的节点类 - 为什么 ConcurrentHashMap 比 HashTable 效

率要高?

A:HashTable 使用一把锁(锁住整个链表结构)处理并发问题,多个线程竞争一把锁,

容易阻塞;

ConcurrentHashMap

JDK 1.7 中使用分段锁(ReentrantLock + Segment + HashEntry),相当于把一个

HashMap 分成多个段,每段分配一把锁,这样支持多线程访问。锁粒度:基于 Segment,包

含多个 HashEntry。

JDK 1.8 中使用 CAS + synchronized + Node + 红黑树。锁粒度:Node(首结点)(实

现 Map.Entry<K,V>)。锁粒度降低了。 - 针对 ConcurrentHashMap 锁机制具体分析(JDK

1.7 VS JDK 1.8)?

JDK 1.7 中,采用分段锁的机制,实现并发的更新操作,底层采用数组+链表的存储结

构,包括两个核心静态内部类 Segment 和 HashEntry。

①、Segment 继承 ReentrantLock(重入锁) 用来充当锁的角色,每个 Segment 对

象守护每个散列映射表的若干个桶;

②、HashEntry 用来封装映射表的键-值对;

③、每个桶是由若干个 HashEntry 对象链接起来的链表。

JDK 1.8 中,采用 Node + CAS + Synchronized 来保证并发安全。取消类 Segment,

直接用 table 数组存储键值对;当 HashEntry 对象组成的链表长度超过

TREEIFY_THRESHOLD 时,链表转换为红黑树,提升性能。底层变更为数组 + 链表 + 红黑树。 - ConcurrentHashMap 在 JDK 1.8 中,为什么要

使用内置锁 synchronized 来代替重入锁

ReentrantLock?

1、JVM 开发团队在 1.8 中对 synchronized 做了大量性能上的优化,而且基于 JVM 的

synchronized 优化空间更大,更加自然。

2、在大量的数据操作下,对于 JVM 的内存压力,基于 API 的 ReentrantLock 会开

销更多的内存。 - ConcurrentHashMap 简单介绍?

①、重要的常量:

private transient volatile int sizeCtl;

当为负数时,-1 表示正在初始化,-N 表示 N - 1 个线程正在进行扩容;

当为 0 时,表示 table 还没有初始化;

当为其他正数时,表示初始化或者下一次进行扩容的大小。

②、数据结构:

Node 是存储结构的基本单元,继承 HashMap 中的 Entry,用于存储数据;

TreeNode 继承 Node,但是数据结构换成了二叉树结构,是红黑树的存储结构,用于

红黑树中存储数据;

TreeBin 是封装 TreeNode 的容器,提供转换红黑树的一些条件和锁的控制。

③、存储对象时(put() 方法):

1.如果没有初始化,就调用 initTable() 方法来进行初始化;

2.如果没有 hash 冲突就直接 CAS 无锁插入;

3.如果需要扩容,就先进行扩容;

4.如果存在 hash 冲突,就加锁来保证线程安全,两种情况:一种是链表形式就直接

遍历到尾端插入,一种是红黑树就按照红黑树结构插入;

5.如果该链表的数量大于阀值 8,就要先转换成红黑树的结构,break 再一次进入循

环

6.如果添加成功就调用 addCount() 方法统计 size,并且检查是否需要扩容。

④、扩容方法 transfer():默认容量为 16,扩容时,容量变为原来的两倍。

helpTransfer():调用多个工作线程一起帮助进行扩容,这样的效率就会更高。

⑤、获取对象时(get()方法):

1.计算 hash 值,定位到该 table 索引位置,如果是首结点符合就返回;

2.如果遇到扩容时,会调用标记正在扩容结点 ForwardingNode.find()方法,查找

该结点,匹配就返回;

3.以上都不符合的话,就往下遍历结点,匹配就返回,否则最后就返回 null。 - ConcurrentHashMap 的并发度是什么?

1.7 中程序运行时能够同时更新 ConccurentHashMap 且不产生锁竞争的最大线程数。

默认为 16,且可以在构造函数中设置。当用户设置并发度时,ConcurrentHashMap 会使用

大于等于该值的最小 2 幂指数作为实际并发度(假如用户设置并发度为 17,实际并发度则

为 32)。

1.8 中并发度则无太大的实际意义了,主要用处就是当设置的初始容量小于并发度,将

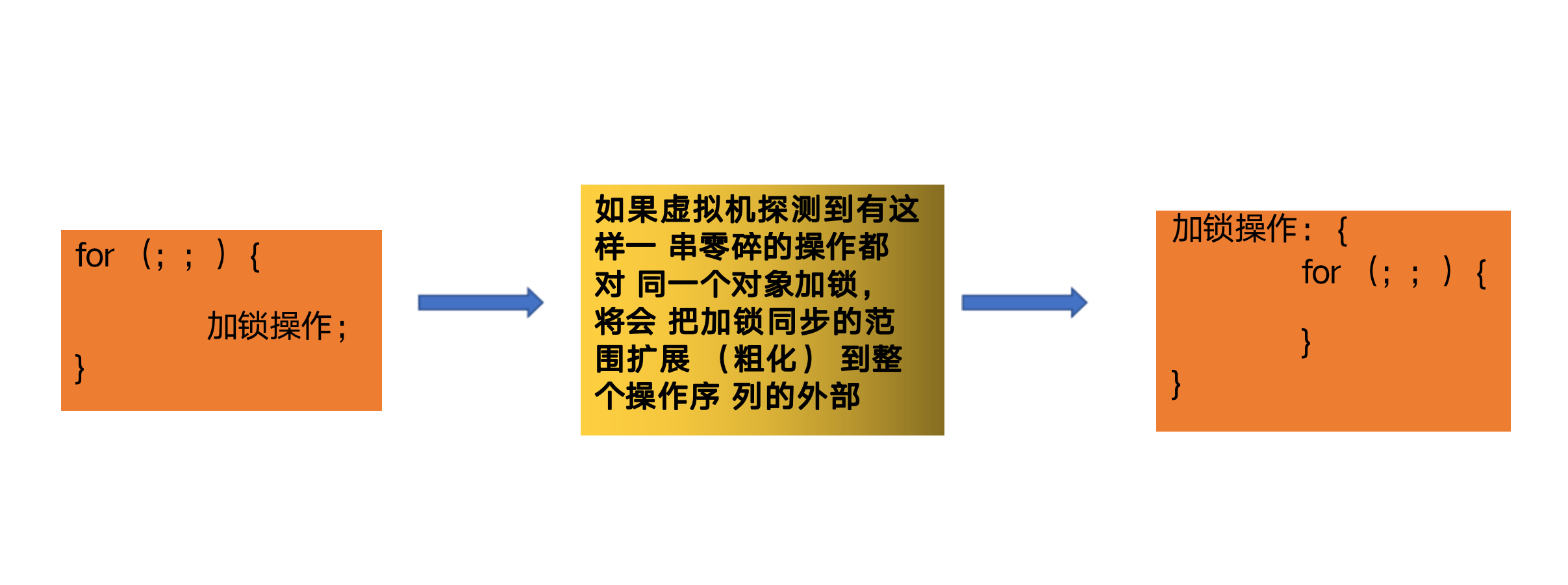

初始容量提升至并发度大小。 - 什么是锁消除和锁粗化?

锁消除:指虚拟机即时编译器在运行时,对一些代码上要求同步,但被检测到不可能

存在共享数据竞争的锁进行消除。主要根据逃逸分析。

锁粗化:原则上,同步块的作用范围要尽量小。但是如果一系列的连续操作都对同一

个对象反复加锁和解锁,甚至加锁操作在循环体内,频繁地进行互斥同步操作也会导致不必

要的性能损耗。锁粗化就是增大锁的作用域。 - 除了 ReetrantLock, JUC 下还有哪些并发工

具?

通常所说的并发包(JUC)也就是 Java.util.concurrent 及其子包,集中了 Java 并

发的各种基础工具类,具体主要包括几个方面:

提供了 CountDownLatch、CyclicBarrier、Semaphore 等,比 Synchronized 更加高

级,可以实现更加丰富多线程操作的同步结构。

提供了 ConcurrentHashMap、有序的 ConcunrrentSkipListMap,或者通过类似快照机

制实现线程安全的动态数组 CopyOnWriteArrayList 等,各种线程安全的容器。

提供了 ArrayBlockingQueue 、 SynchorousQueue 或针对特定场景的

PriorityBlockingQueue 等,各种阻塞队列实现。

强大的 Executor 框架,可以创建各种不同类型的线程池,调度任务运行等。 - 什么是 Java 的内存模型,Java 中各个线程是

怎么彼此看到对方的变量的?

Java 的内存模型定义了程序中各个变量的访问规则,即在虚拟机中将变量存储到内存

和从内存中取出这样的底层细节。

此处的变量包括实例字段、静态字段和构成数组对象的元素,但是不包括局部变量和

方法参数,因为这些是线程私有的,不会被共享,所以不存在竞争问题。

Java 中各个线程是怎么彼此看到对方的变量的呢?Java 中定义了主内存与工作内存

的概念:

所有的变量都存储在主内存,每条线程还有自己的工作内存,保存了被该线程使用到

的变量的主内存副本拷贝。

线程对变量的所有操作(读取、赋值)都必须在工作内存中进行,不能直接读写主内

存的变量。不同的线程之间也无法直接访问对方工作内存的变量,线程间变量值的传递需要

通过主内存。

Spring 面试题目

1.你为什么使用 Spring?

轻量级:Spring 在大小和透明性方面绝对属于轻量级的,基础版本的 Spring 框架大约

只有 2MB。

控制反转(IOC):Spring 使用控制反转技术实现了松耦合。依赖被注入到对象,而不是

创建或寻找依赖对象。

面向切面编程(AOP): Spring 支持面向切面编程,同时把应用的业务逻辑与系统的服

务分离开来。

容器:Spring 包含并管理应用程序对象的配置及生命周期。

MVC 框架:Spring 的 web 框架是一个设计优良的 web MVC 框架,很好的取代了一些 web

框架。

事务管理:Spring 对下至本地业务上至全局业务(JAT)提供了统一的事务管理接口。

异常处理:Spring 提供一个方便的 API 将特定技术的异常(由 JDBC, Hibernate, 或 JDO

抛出)转化为一致的、Unchecked 异常。 - Spring 支持几种 bean 的作用域?

1)singleton:默认,每个容器中只有一个 bean 的实例,单例的模式由 BeanFactory

自身来维护。

2)prototype:为每一个 bean 请求提供一个实例。

3)request:为每一个网络请求创建一个实例,在请求完成以后,bean 会失效并被垃圾

回收器回收。

4)session:与 request 范围类似,确保每个 session 中有一个 bean 的实例,在 session

过期后,bean 会随之失效。

5)global-session:全局作用域,global-session 和 Portlet 应用相关。当你的应用

部署在 Portlet 容器中工作时,它包含很多 portlet。如果你想要声明让所有的 portlet 共

用全局的存储变量的话,那么这全局变量需要存储在 global-session 中。全局作用域与

Servlet 中的 session 作用域效果相同。

3.请问 Spring 有几种自动装配模式?

自动装配提供五种不同的模式供 Spring 容器用来自动装配 beans 之间的依赖注入:

no:默认的方式是不进行自动装配,通过手工设置 ref 属性来进行装配 bean。

byName:通过参数名自动装配,Spring 容器查找 beans 的属性,这些 beans 在 XML 配

置文件中被设置为 byName。之后容器试图匹配、装配和该 bean 的属性具有相同名字的 bean。

byType:通过参数的数据类型自动自动装配,Spring 容器查找 beans 的属性,这些 beans

在 XML 配置文件中被设置为 byType。之后容器试图匹配和装配和该 bean 的属性类型一样的

bean。如果有多个 bean 符合条件,则抛出错误。

constructor:这个同 byType 类似,不过是应用于构造函数的参数。如果在 BeanFactory

中不是恰好有一个 bean 与构造函数参数相同类型,则抛出一个严重的错误。

autodetect:如果有默认的构造方法,通过 construct 的方式自动装配,否则使用

byType 的方式自动装配。

4.对 Java 接口代理模式的实现原理的理解?

答:

1、字符串拼凑出代理类

2、用流的方式写到.Java 文件

3、动态编译.Java 文件

4、自定义类加载器把.class 文件加载到 jvm

5、返回代理类实例

其实核心就是根据接口反射出接口中的所有方法,然后通过拼凑或者 cglib 字节码的方

式把代理类反射出来,而代理类在内存中就会对某种类型的类进行调用,invocationHandler

(Jdk)或者 MethodInterceptor(cglib)

5.怎么理解面向切面编程的切面?

答:

切面指的是一类功能,比如事务,缓存,日志等。切面的作用是在目标对象方法执行前

或者后执行切面方法

6.什么是 IOC 容器?

答:

Spring IOC 负责创建对象、管理对象(通过依赖注入)、整合对象、配置对象以及管理

这些对象的生命周期。

Ioc 是把对象的控制权较给框架或容器,容器中存储了众多我们需要的对象,然后我们

就无需再手动的在代码中创建对象。需要什么对象就直接告诉容器我们需要什么对象,容器

会把对象根据一定的方式注入到我们的代码中。注入的过程被称为 DI。有时候需要动态的

指定我们需要什么对象,这个时候要让容器在众多对象中去寻找,容器寻找需要对象的过程,

称为 DL(Dependency Lookup, 依赖查找)。按照上面的理解,那么 IOC 包含了 DI 与 DL,并

且多了对象注册的过程。

7.为什么需要代理模式?

答:

代理其实是对开闭原则和里氏代换原则的一种实现,它强调在不修改老代码的基础上扩

展功能,代理模式大大提高了代码的灵活性,同时也使代码的可读性变差,同时动态代理也

加大了内存溢出的风险。

8.讲讲静态代理模式的优点及其瓶颈?

答:

静态代理一种傻瓜式的对目标类的增强,其核心就两点,1、跟目标类实现同一接口 2、

持有目标类的引用。 如果需要对目标类方法进行增强,就只要调用代理类的方法,在方法

里面写增强功能然后调用目标类方法即可。优点就是代码直观且执行速度快,缺点就是不够

灵活,代码量比较大,每一种类型的目标类都需要单独写一个代理类。

9.讲解 Spring 框架中基于 Schema 的 AOP 实现原理?

答:

这个是基于 xml 配置方式的 aop

<aop:config proxy-target-class=“true”>

<aop:pointcut expression=“execution(public void

org.aop.Object.Student.display())” id=“pointcut”/>

<aop:aspect ref=“advice”>

<aop:before method=“before” pointcut-ref=“pointcut”/>

<aop:after-returning method=“after” pointcut-ref=“pointcut” />

<aop:after-throwing method=“exception” pointcut-ref=“pointcut”

throwing=“x”/>

<aop:around method=“around” pointcut-ref=“pointcut”/>

</aop:aspect>

</aop:config>

AOP 实现流程

1、aop:config 自定义标签解析

2、自定义标签解析时封装对应的 aop 入口类,类的类型就是 BeanPostProcessor 接口

类型

3、Bean 实现化过程中会执行到 aop 入口类中

4、在 aop 入口类中,判断当前正在实例化的类是否在 pointcut 中,pointcut 可以理

解为一个模糊匹配,是一个 joinpoint 的集合

5、如果当前正在实例化的类在 pointcut 中,则返回该 bean 的代理,同时把所有配置

的 advice 封装成 MethodInterceptor 对象加入到容器中,封装成一个过滤器链

代理对象调用,jdk 调到 invocationHandler 中,cglib 调到 MethodInterceptor 的

callback 类中,然后在 invoke 方法中执行过滤器链。

10. 讲解 Spring 框架中如何基于 AOP 实现的事务管

理?

答:

事务管理,是一个切面。在 aop 环节中,其他环节都一样,事务管理就是有自己单独的

advice,有单独的通知,是 TransactionInterceptor,它一样的会在拦截器链中被执行到,

这个 TransactionInterceptor 拦截器类是通过解析tx:advice自定义标签得到的。

11. Spring 在 Bean 创建过程中是如何解决循环依赖

的?

答:

循环依赖只会存在在单例实例中,多例循环依赖直接报错。

A 类实例化后,把实例放 map 容器中,A 类中有一个 B 类属性,A 类实例化要进行 IOC

依赖注入,这时候 B 类需要实例化,B 类实例化跟 A 类一样,实例化后方 map 容器中。B 类

中有一个 A 类属性,接着 B 类的 IOC 过程,又去实例化 A 类,这时候实例化 A 类过程中从

map 容器发现 A 类已经在容器中了,就直接返回了 A 的实例,依赖注入到 B 类中 A 属性中,

B 类 IOC 完成后,B 实例化就完全完成了,就返回给 A 类的 IOC 过程。这就是循环依赖的解

决。

- Spring 中 Bean 是如何管理的?

答:

在 Spring 框架中,一旦把一个 bean 纳入到 Spring IoC 容器之中,这个 bean 的生命周

期就会交由容器进行管理,一般担当管理者角色的是 BeanFactory 或 ApplicationContext。

认识一下 Bean 的生命周期活动,对更好的利用它有很大的帮助。

概括来说主要有四个阶段:实例化,初始化,使用,销毁。 - 请具体描述 IOC 容器对 Bean 的生命周期控制流

程:

通过构造器或工厂方法创建 Bean 实例

. 为 Bean 的属性设置值和对其他 Bean 的引用

. 将 Bean 实例传递给 Bean 后置处理器的 postProcessBeforeInitialization 方法

. 调用 Bean 的初始化方法(init-method)

. 将 Bean 实例传递给 Bean 后置处理器的 postProcessAfterInitialization 方法

. Bean 可以使用了

. 当容器关闭时, 调用 Bean 的销毁方法(destroy-method) - BeanFactory 和 ApplicationContext 有什么区

别?

1)BeanFactory 是 Spring 里面最底层的接口,包含了各种 Bean 的定义,读取 bean 配

置文档,管理 bean 的加载、实例化,控制 bean 的生命周期,维护 bean 之间的依赖关系。

ApplicationContext 接口作为 BeanFactory 的派生,除了提供 BeanFactory 所具有的功能

外,还提供了更完整的框架功能。

2)BeanFactroy 采用的是延迟加载形式来注入 Bean 的,即只有在使用到某个 Bean 时(调

用 getBean()),才对该 Bean 进行加载实例化。ApplicationContext 是在容器启动时,一次

性创建了所有的 Bean。这样在容器启动时,我们就可以发现 Spring 中存在的配置错误,这

样有利于检查所依赖属性是否注。

3)BeanFactory 通常以编程的方式被创建,ApplicationContext 还能以声明的方式创

建,如使用 ContextLoader。

4)BeanFactory 和 ApplicationContext 都支持 BeanPostProcessor 、

BeanFactoryPostProcessor 的使用,但两者之间的区别是:BeanFactory 需要手动注册,而

ApplicationContext 则是自动注册。 - 谈谈 Spring Bean 创建过程中的设计模式?

策略模式、代理模式、适配器模式 - Spring MVC 运行流程

答:

第一步:发起请求到前端控制器(DispatcherServlet)

第二步:前端控制器请求 HandlerMapping 查找 Handler( 可以根据 xml 配置、注解进

行查找)

第三步:处理器映射器 HandlerMapping 向前端控制器返回 Handler

第四步:前端控制器调用处理器适配器去执行 Handler

第五步:处理器适配器去执行 Handler

第六步:Handler 执行完成给适配器返回 ModelAndView

第七步:处理器适配器向前端控制器返回 ModelAndView(ModelAndView 是 springmvc

框架的一个底层对象,包括 Model 和 view)

第八步:前端控制器请求视图解析器去进行视图解析(根据逻辑视图名解析成真正的视

图(jsp))

第九步:视图解析器向前端控制器返回 View

第十步:前端控制器进行视图渲染( 视图渲染将模型数据(在 ModelAndView 对象中)

填充到 request 域)

第十一步:前端控制器向用户响应结果 - Spring 框架中的单例 bean 是线程安全的吗?

一般的 Web 应用划分为展现层、服务层和持久层三个层次,在不同的层中编写对应的逻

辑,下层通过接口向上层开放功能调用。在一般情况下,从接收请求到返回响应所经过的所

有程序调用都同属于一个线程

ThreadLocal 是解决线程安全问题一个很好的思路,它通过为每个线程提供一个独立的

变量副本解决了变量并发访问的冲突问题。在很多情况下,ThreadLocal 比直接使用

synchronized 同步机制解决线程安全问题更简单,更方便,且结果程序拥有更高的并发性。

线程安全问题都是由全局变量及静态变量引起的。

无状态就是一次操作,不能保存数据。无状态对象(Stateless Bean),就是没有实例变

量的对象 .不能保存数据,是不变类,是线程安全的。

当然也可以通过加 sync 锁的方法来解决线程安全,这种以时间换空间的场景在高并发

场景下显然是不实际的。 - 解释 Spring 支持的几种 bean 的作用域

Spring 框架支持以下五种 bean 的作用域:

singleton:bean 在每个 Springioc 容器中只有一个实例。

prototype:一个 bean 的定义可以有多个实例。

request :每次 http 请求都会创建 一 个 bean ,该作用域仅在基于 web 的

SpringApplicationContext 情形下有效。

session:在一个 HTTPSession 中,一个 bean 定义对应一个实例。该作用域仅在基于

web 的 SpringApplicationContext 情形下有效。

global-session:在一个全局的 HTTPSession 中,一个 bean 定义对应一个实例。该

作用域仅在基于 web 的 SpringApplicationContext 情形下有效。

缺省的 Springbean 的作用域是 Singleton.

18.解释 Spring 框架中 bean 的生命周期

Spring 容器从 XML 文件中读取 bean 的定义,并实例化 bean。

Spring 根据 bean 的定义填充所有的属性。

如果 bean 实现了 BeanNameAware 接口,Spring 传递 bean 的 ID 到 setBeanName

方法。

如 果 Bean 实现了 BeanFactoryAware 接口, Spring 传 递 beanfactory 给

setBeanFactory 方法。

如果有任何与 bean 相关联的 BeanPostProcessors , Spring 会 在

postProcesserBeforeInitialization()方法内调用它们。

如果 bean 实现 IntializingBean 了,调用它的 afterPropertySet 方法,

如果 bean 声明了初始化方法,调用此初始化方法。

如果有 BeanPostProcessors 和 bean 关联,这些 bean 的

postProcessAfterInitialization()方法将被调用。

如果 bean 实现了 DisposableBean,它将调用 destroy()方法。

19.哪些是重要的 bean 生命周期方法?你能重载它

们吗?

有两个重要的 bean 生命周期方法,第一个是 setup,它是在容器加载 bean 的

时候被调用。第二个方法是 teardown 它是在容器卸载类的时候被调用。Thebean 标签

有两个重要的属性(init-method 和 destroy-method)。用它

们你可以自己定制初始化和注销方法。它们也有相应的注解(@PostConstruct

和@PreDestroy)。

SpringBoot 面试题目

1.什么是 Spring Boot?

多年来,随着新功能的增加, spring 变得越来越复杂。只需访问

https://spring.io/projects 页面,我们就会看到可以在我们的应用程序中使用的所有

Spring 项目的不同功能。如果必须启动一个新的 Spring 项目,我们必须添加构建路径或

添加 Maven 依赖关系,配置应用程序服务器,添加 spring 配置。因此,开始一个新的

spring 项目需要很多努力,因为我们现在必须从头开始做所有事情。

Spring Boot 是解决这个问题的方法。Spring Boot 已经建立在现有 spring 框架之上。

使用 spring 启动,我们避免了之前我们必须做的所有样板代码和配置。因此,Spring Boot

可以帮助我们以最少的工作量,更加健壮地使用现有的 Spring 功能。

2. Spring Boot 有哪些优点?

Spring Boot 的优点有:

减少开发,测试时间和努力。

使用 JavaConfig 有助于避免使用 XML。

避免大量的 Maven 导入和各种版本冲突。

提供意见发展方法。

通过提供默认值快速开始开发。

没有单独的 Web 服务器需要。这意味着你不再需要启动 Tomcat,Glassfish 或其他任

何东西。

需要更少的配置 因为没有 web.xml 文件。只需添加用@ Configuration 注释的类,然

后添加用@Bean 注释的方法,Spring 将自动加载对象并像以前一样对其进行管理。您甚至

可以将@Autowired 添加到 bean 方法中,以使 Spring 自动装入需要的依赖关系中。

基于环境的配置使用这些属性,您可以将您正在使用的环境传递到应用程序:-

Dspring.profiles.active

{enviornment}。在加载主应用程序属性文件后,Spring 将在

(application{environment} .properties)中加载后续的应用程序属性文件。

3.什么是 JavaConfig?

Spring JavaConfig 是 Spring 社区的产品,它提供了配置 Spring IoC 容器的纯 Java

方法。因此它有助于避免使用 XML 配置。使用 JavaConfig 的优点在于:

面向对象的配置。由于配置被定义为 JavaConfig 中的类,因此用户可以充分利用 Java

中的面向对象功能。一个配置类可以继承另一个,重写它的@Bean 方法等。

减少或消除 XML 配置。基于依赖注入原则的外化配置的好处已被证明。但是,许多开

发人员不希望在 XML 和 Java 之间来回切换。JavaConfig 为开发人员提供了一种纯 Java

方法来配置与 XML 配置概念相似的 Spring 容器。从技术角度来讲,只使用 JavaConfig 配

置类来配置容器是可行的,但实际上很多人认为将 JavaConfig 与 XML 混合匹配是理想的。

类型安全和重构友好。JavaConfig 提供了一种类型安全的方法来配置 Spring 容器。由于

Java 5.0 对泛型的支持,现在可以按类型而不是按名称检索 bean,不需要任何强制转换或

基于字符串的查找。

4.如何重新加载 Spring Boot 上的更改,而无需重

新启动服务器?

这可以使用 DEV 工具来实现。通过这种依赖关系,您可以节省任何更改,嵌入式 tomcat

将重新启动。Spring Boot 有一个开发工具(DevTools)模块,它有助于提高开发人员的生

产力。Java 开发人员面临的一个主要挑战是将文件更改自动部署到服务器并自动重启服务

器。开发人员可以重新加载 Spring Boot 上的更改,而无需重新启动服务器。这将消除每

次手动部署更改的需要。Spring Boot 在发布它的第一个版本时没有这个功能。这是开发人

员最需要的功能。DevTools 模块完全满足开发人员的需求。该模块将在生产环境中被禁用。

它还提供 H2 数据库控制台以更好地测试应用程序。

org.springframework.boot spring-boot-devtools true

5. Spring Boot 中的监视器是什么?

Spring boot actuator 是 spring 启动框架中的重要功能之一。Spring boot 监视器

可帮助您访问生产环境中正在运行的应用程序的当前状态。有几个指标必须在生产环境中进

行检查和监控。即使一些外部应用程序可能正在使用这些服务来向相关人员触发警报消息。

监视器模块公开了一组可直接作为 HTTP URL 访问的 REST 端点来检查状态。

6.如何在 Spring Boot 中禁用 Actuator 端点安全

性?

默认情况下,所有敏感的 HTTP 端点都是安全的,只有具有 ACTUATOR 角色的用户才能

访问它们。安全性是使用标准的 HttpServletRequest.isUserInRole 方法实施的。 我们可

以使用 management.security.enabled = false 来禁用安全性。只有在执行机构端点在防

火墙后访问时,才建议禁用安全性。

7.如何在自定义端口上运行 Spring Boot 应用程

序?

为了在自定义端口上运行 Spring Boot 应用程序,您可以在 application.properties

中指定端口。

server.port = 8090

8.什么是 YAML?

YAML 是一种人类可读的数据序列化语言。它通常用于配置文件。

与属性文件相比,如果我们想要在配置文件中添加复杂的属性,YAML 文件就更加结构

化,而且更少混淆。可以看出 YAML 具有分层配置数据。

9.如何实现 Spring Boot 应用程序的安全性?

为了实现 Spring Boot 的安全性,我们使用 spring-boot-starter-security 依赖项,

并且必须添加安全配置 。它只需要很少的代码。配置类 将必须扩展

WebSecurityConfigurerAdapter 并覆盖其方法。

10. 如何集成 Spring Boot 和 ActiveMQ?

对于集成 Spring Boot 和 ActiveMQ,我们使用 spring-boot-starter-activemq 依赖

关系。 它只需要很少的配置,并且不需要样板代码。

11. 如何使用 Spring Boot 实现分页和排序?

使用 Spring Boot 实现分页非常简单。使用 Spring Data-JPA 可以实现将可分页的

org.springframework.data.domain.Pageable 传递给存储库方法。

12. 什么是 Swagger?你用 Spring Boot 实现了它

吗?

Swagger 广泛用于可视化 API,使用 Swagger UI 为前端开发人员提供在线沙箱。

Swagger 是用于生成 RESTful Web 服务的可视化表示的工具,规范和完整框架实现。它使

文档能够以与服务器相同的速度更新。当通过 Swagger 正确定义时,消费者可以使用最少

量的实现逻辑来理解远程服务并与其进行交互。因此,Swagger 消除了调用服务时的猜测。

13. 什么是 Spring Profiles?

Spring Profiles 允许用户根据配置文件(dev,test,prod 等)来注册 bean。因此,

当应用程序在开发中运行时,只有某些 bean 可以加载,而在 PRODUCTION 中,某些其他

bean 可以加载。假设我们的要求是 Swagger 文档仅适用于 QA 环境,并且禁用所有其他文

档。这可以使用配置文件来完成。Spring Boot 使得使用配置文件非常简单。

14. 什么是 Spring Batch?

Spring Boot Batch 提供可重用的函数,这些函数在处理大量记录时非常重要,包括日

志/跟踪,事务管理,作业处理统计信息,作业重新启动,跳过和资源管理。它还提供了更

先进的技术服务和功能,通过优化和分区技术,可以实现极高批量和高性能批处理作业。简

单以及复杂的大批量批处理作业可以高度可扩展的方式利用框架处理重要大量的信息。

15. 什么是 FreeMarker 模板?

FreeMarker 是一个基于 Java 的模板引擎,最初专注于使用 MVC 软件架构进行动态网

页生成。使用 Freemarker 的主要优点是表示层和业务层的完全分离。程序员可以处理应用

程序代码,而设计人员可以处理 html 页面设计。最后使用 freemarker 可以将这些结合起

来,给出最终的输出页面。

16. 如何使用 Spring Boot 实现异常处理?

Spring 提供了一种使用 ControllerAdvice 处理异常的非常有用的方法。我们通过实

现一个 ControlerAdvice 类,来处理控制器类抛出的所有异常。

17. 您使用了哪些 starter maven 依赖项?

使用了下面的一些依赖项 spring-boot-starter-activemq

spring-boot-starter-security

spring-boot-starter-web

这有助于增加更少的依赖关系,并减少版本的冲突。

18. 什么是 CSRF 攻击?

CSRF 代表跨站请求伪造。这是一种攻击,迫使最终用户在当前通过身份验证的 Web 应

用程序上执行不需要的操作。CSRF 攻击专门针对状态改变请求,而不是数据窃取,因为攻

击者无法查看对伪造请求的响应。

19. 什么是 WebSockets?

WebSocket 是一种计算机通信协议,通过单个 TCP 连接提供全双工通信信道。

WebSocket 是双向的 -使用 WebSocket 客户端或服务器可以发起消息发送。

WebSocket 是全双工的 -客户端和服务器通信是相互独立的。

单个 TCP 连接 -初始连接使用 HTTP,然后将此连接升级到基于套接字的连接。然后这

个单一连接用于所有未来的通信

Light -与 http 相比,WebSocket 消息数据交换要轻得多。

20. 什么是 AOP?

在软件开发过程中,跨越应用程序多个点的功能称为交叉问题。这些交叉问题与应用程

序的主要业务逻辑不同。因此,将这些横切关注与业务逻辑分开是面向方面编程(AOP)的

地方。

21. 什么是 Apache Kafka?

Apache Kafka 是一个分布式发布 - 订阅消息系统。它是一个可扩展的,容错的发布 -

订阅消息系统,它使我们能够构建分布式应用程序。这是一个 Apache 顶级项目。Kafka 适

合离线和在线消息消费。

22. 我们如何监视所有 Spring Boot 微服务?

Spring Boot 提供监视器端点以监控各个微服务的度量。这些端点对于获取有关应用程

序的信息(如它们是否已启动)以及它们的组件(如数据库等)是否正常运行很有帮助。但

是,使用监视器的一个主要缺点或困难是,我们必须单独打开应用程序的知识点以了解其状

态或健康状况。想象一下涉及 50 个应用程序的微服务,管理员将不得不击中所有 50 个应

用程序的执行终端。

SpringCloud 面试题目

1.什么是 Spring Cloud?

Spring cloud 流应用程序启动器是基于 Spring Boot 的 Spring 集成应用程序,提供

与外部系统的集成。

Spring cloud Task,一个生命周期短暂的微服务框架,用于快速构建执行有限数据处

理的应用程序。

2.使用 Spring Cloud 有什么优势?

使用 Spring Boot 开发分布式微服务时,我们面临以下问题

与分布式系统相关的复杂性-这种开销包括网络问题,延迟开销,带宽问题,安全问题。

服务发现-服务发现工具管理群集中的流程和服务如何查找和互相交谈。它涉及一个服

务目录,在该目录中注册服务,然后能够查找并连接到该目录中的服务。

冗余-分布式系统中的冗余问题。

负载平衡 --负载平衡改善跨多个计算资源的工作负荷,诸如计算机,计算机集群,网

络链路,中央处理单元,或磁盘驱动器的分布。

性能-问题 由于各种运营开销导致的性能问题。

部署复杂性-Devops 技能的要求。

3.服务注册和发现是什么意思?Spring Cloud 如何

实现?

当我们开始一个项目时,我们通常在属性文件中进行所有的配置。随着越来越多的服务

开发和部署,添加和修改这些属性变得更加复杂。有些服务可能会下降,而某些位置可能会

发生变化。手动更改属性可能会产生问题。 Eureka 服务注册和发现可以在这种情况下提供

帮助。由于所有服务都在 Eureka 服务器上注册并通过调用 Eureka 服务器完成查找,因此

无需处理服务地点的任何更改和处理。

4.负载平衡的意义什么?

在计算中,负载平衡可以改善跨计算机,计算机集群,网络链接,中央处理单元或磁盘

驱动器等多种计算资源的工作负载分布。负载平衡旨在优化资源使用,最大化吞吐量,最小

化响应时间并避免任何单一资源的过载。使用多个组件进行负载平衡而不是单个组件可能会

通过冗余来提高可靠性和可用性。负载平衡通常涉及专用软件或硬件,例如多层交换机或域

名系统服务器进程。

5.什么是 Hystrix?它如何实现容错?

Hystrix 是一个延迟和容错库,旨在隔离远程系统,服务和第三方库的访问点,当出现

故障是不可避免的故障时,停止级联故障并在复杂的分布式系统中实现弹性。

通常对于使用微服务架构开发的系统,涉及到许多微服务。这些微服务彼此协作。

思考以下微服务

假设如果上图中的微服务 9 失败了,那么使用传统方法我们将传播一个异常。但这仍

然会导致整个系统崩溃。

随着微服务数量的增加,这个问题变得更加复杂。微服务的数量可以高达 1000.这是

hystrix 出现的地方

我们将使用 Hystrix 在这种情况下的 Fallback 方法功能。我们有两个服务

employee-consumer 使用由 employee-consumer 公开的服务。

简化图如下所示

现在假设由于某种原因,employee-producer 公开的服务会抛出异常。我们在这种情况

下使用 Hystrix 定义了一个回退方法。这种后备方法应该具有与公开服务相同的返回类型。

如果暴露服务中出现异常,则回退方法将返回一些值。

6.什么是 Hystrix 断路器?我们需要它吗?

由于某些原因,employee-consumer 公开服务会引发异常。在这种情况下使用 Hystrix

我们定义了一个回退方法。如果在公开服务中发生异常,则回退方法返回一些默认值。

如果 firstPage method() 中的异常继续发生,则 Hystrix 电路将中断,并且员工使

用者将一起跳过 firtsPage 方法,并直接调用回退方法。 断路器的目的是给第一页方法或

第一页方法可能调用的其他方法留出时间,并导致异常恢复。可能发生的情况是,在负载较

小的情况下,导致异常的问题有更好的恢复机会 。

7.什么是 Netflix Feign?它的优点是什么?

Feign 是受到 Retrofit,JAXRS-2.0 和 WebSocket 启发的 Java 客户端联编程序。

Feign 的第一个目标是将约束分母的复杂性统一到 http apis,而不考虑其稳定性。在

employee-consumer 的例子中,我们使用了 employee-producer 使用 REST 模板公开的

REST 服务。

但是我们必须编写大量代码才能执行以下步骤

使用功能区进行负载平衡。

获取服务实例,然后获取基本 URL。

利用 REST 模板来使用服务。 前面的代码如下

-

@Controller

-

public class ConsumerControllerClient {

-

@Autowired

-

private LoadBalancerClient loadBalancer;

-

public void getEmployee() throws RestClientException, IOException {

-

ServiceInstance serviceInstance=loadBalancer.choose(“employee-producer”);

-

System.out.println(serviceInstance.getUri());

-

String baseUrl=serviceInstance.getUri().toString();

-

baseUrl=baseUrl+"/employee";

-

RestTemplate restTemplate = new RestTemplate();

-

ResponseEntity response=null;

-

try{

-

response=restTemplate.exchange(baseUrl,

-

HttpMethod.GET, getHeaders(),String.class);

-

}catch (Exception ex)

-

{

-

System.out.println(ex);

-

}

-

System.out.println(response.getBody());

-

}

之前的代码,有像 NullPointer 这样的例外的机会,并不是最优的。我们将看到如何

使用 Netflix Feign 使呼叫变得更加轻松和清洁。如果 Netflix Ribbon 依赖关系也在类

路径中,那么 Feign 默认也会负责负载平衡。

8.什么是 Spring Cloud Bus?我们需要它吗?

考虑以下情况:我们有多个应用程序使用 Spring Cloud Config 读取属性,而 Spring

Cloud Config 从 GIT 读取这些属性。

下面的例子中多个员工生产者模块从 Employee Config Module 获取 Eureka 注册的财

产。如果假设 GIT 中的 Eureka 注册属性更改为指向另一台 Eureka 服务器,会发生什么

情况。在这种情况下,我们将不得不重新启动服务以获取更新的属性。

还有另一种使用执行器端点/刷新的方式。但是我们将不得不为每个模块单独调用这个

url。例如,如果 Employee Producer1 部署在端口 8080 上,则调用 http:// localhost:

8080 / refresh。同样对于 Employee Producer2 http:// localhost:8081 / refresh 等

等。这又很麻烦。这就是 Spring Cloud Bus 发挥作用的地方。Spring Cloud Bus 提供了

跨多个实例刷新配置的功能。因此,在上面的示例中,如果我们刷新 Employee Producer1,

则会自动刷新所有其他必需的模块。如果我们有多个微服务启动并运行,这特别有用。这是

通过将所有微服务连接到单个消息代理来实现的。无论何时刷新实例,此事件都会订阅到侦

听。

Mybatis 面试题目

1.什么是 MyBatis?

MyBatis 是一个可以自定义 SQL、存储过程和高级映射的持久层框架。

2.讲下 MyBatis 的缓存

答:MyBatis 的缓存分为一级缓存和二级缓存,一级缓存放在 session 里面,默认就有,

二级缓存放在它的命名空间里,默认是不打开的,使用二级缓存属性类需要实现

Serializable 序列化接口(可用来保存对象的状态),可在它的映射文件中配置 -

Mybatis 是如何进行分页的?分页插件的原理是

什么?

1)Mybatis 使用 RowBounds 对象进行分页,也可以直接编写 sql 实现分页,也可以

使用

Mybatis 的分页插件。

2)分页插件的原理:实现 Mybatis 提供的接口,实现自定义插件,在插件的拦截方法

内拦

截待执行的 sql,然后重写 sql。

举例:select * from student,拦截 sql 后重写为:select t.* from (select * from

student)t limit 0,10

4.简述 Mybatis 的插件运行原理,以及如何编写一

个插件?

1 ) Mybatis 仅可以编写针对 ParameterHandler 、 ResultSetHandler 、

StatementHandler、Executor 这 4 种接口的插件,Mybatis 通过动态代理,为需要拦截的

接口生成代理对象以实现接口方法拦截功能,每当执行这 4 种接口对象的方法时,就会进

入拦截方法,具体就是 InvocationHandler 的 invoke()方法,当然,只会拦截那些你指定

需要拦截的方法。

2)实现 Mybatis 的 Interceptor 接口并复写 intercept()方法,然后在给插件编写

注解,指定要拦截哪一个接口的哪些方法即可,记住,别忘了在配置文件中配置你编写的插

件。 -

Mybatis 动态 sql 是做什么的?都有哪些动态

sql?能简述一下动态 sql 的执行原理不?

1)Mybatis 动态 sql 可以让我们在 Xml 映射文件内,以标签的形式编写动态 sql,

完成逻辑判断和动态拼接 sql 的功能。

2)Mybatis 提供了 9 种动态 sql 标签:

trim|where|set|foreach|if|choose|when|otherwise|bind。

3)其执行原理为,使用 OGNL 从 sql 参数对象中计算表达式的值,根据表达式的值动

态拼接 sql,以此来完成动态 sql 的功能。 -

#{}和KaTeX parse error: Expected 'EOF', got '#' at position 14: {}的区别是什么? 1)#̲{}是预编译处理,{}是字符串替换。

2)Mybatis 在处理#{}时,会将 sql 中的#{}替换为?号,调用 PreparedStatement 的

set 方法来赋值;

3)Mybatis 在处理 时 , 就 是 把 {}时,就是把 时,就是把{}替换成变量的值。

4)使用#{}可以有效的防止 SQL 注入,提高系统安全性。

7.为什么说 Mybatis 是半自动 ORM 映射工具?它

与全自动的区别在哪里?

Hibernate 属于全自动 ORM 映射工具,使用 Hibernate 查询关联对象或者关联集合对

象时,可以根据对象关系模型直接获取,所以它是全自动的。而 Mybatis 在查询关联对象

或关联集合对象时,需要手动编写 sql 来完成,所以,称之为半自动 ORM 映射工具。 -

Mybatis 是否支持延迟加载?如果支持,它的实现

原理是什么?

1)Mybatis 仅支持 association 关联对象和 collection 关联集合对象的延迟加载,

association 指的就是一对一,collection 指的就是一对多查询。在 Mybatis 配置文件中,

可以配置是否启用延迟加载 lazyLoadingEnabled=true|false。

2)它的原理是,使用 CGLIB 创建目标对象的代理对象,当调用目标方法时,进入拦截

器方法,比如调用 a.getB().getName(),拦截器 invoke()方法发现 a.getB()是 null 值,

那么就会单独发送事先保存好的查询关联 B 对象的 sql,把 B 查询上来,然后调用

a.setB(b),于是 a 的对象 b 属性就有值了,接着完成 a.getB().getName()方法的调用。

这就是延迟加载的基本原理。 -

MyBatis 与 Hibernate 有哪些不同?

1)Mybatis 和 hibernate 不同,它不完全是一个 ORM 框架,因为 MyBatis 需要程序

员自己编写 Sql 语句,不过 mybatis 可以通过 XML 或注解方式灵活配置要运行的 sql 语

句,并将 Java 对象和 sql 语句映射生成最终执行的 sql,最后将 sql 执行的结果再映射

生成 Java 对象。

2)Mybatis 学习门槛低,简单易学,程序员直接编写原生态 sql,可严格控制 sql 执

行性能,灵活度高,非常适合对关系数据模型要求不高的软件开发,例如互联网软件、企业

运营类软件等,因为这类软件需求变化频繁,一但需求变化要求成果输出迅速。但是灵活的

前提是 mybatis 无法做到数据库无关性,如果需要实现支持多种数据库的软件则需要自定

义多套 sql 映射文件,工作量大。

3)Hibernate 对象/关系映射能力强,数据库无关性好,对于关系模型要求高的软件(例

如需求固定的定制化软件)如果用 hibernate 开发可以节省很多代码,提高效率。但是

Hibernate 的缺点是学习门槛高,要精通门槛更高,而且怎么设计 O/R 映射,在性能和对

象模型之间如何权衡,以及怎样用好 Hibernate 需要具有很强的经验和能力才行。

总之,按照用户的需求在有限的资源环境下只要能做出维护性、扩展性良好的软件架构

都是好架构,所以框架只有适合才是最好。 -

MyBatis 的好处是什么?

1)MyBatis 把 sql 语句从 Java 源程序中独立出来,放在单独的 XML 文件中编写,

给程序的维护带来了很大便利。

2)MyBatis 封装了底层 JDBC API 的调用细节,并能自动将结果集转换成 Java Bean 对

象,大大简化了 Java 数据库编程的重复工作。

3)因为 MyBatis 需要程序员自己去编写 sql 语句,程序员可以结合数据库自身的特

点灵活控制 sql 语句,因此能够实现比 Hibernate 等全自动 orm 框架更高的查询效率,

能够完成复杂查询。 -

简述 Mybatis 的 Xml 映射文件和 Mybatis 内

部数据结构之间的映射关系?

Mybatis 将所有 Xml 配置信息都封装到 All-In-One 重量级对象 Configuration 内

部。在 Xml 映射文件中,标签会被解析为 ParameterMap 对象,其每个子

元素会被解析为 ParameterMapping 对象。标签会被解析为 ResultMap 对象,

其每个子元素会被解析为 ResultMapping 对象。每一个、、、

标签均会被解析为 MappedStatement 对象,标签内的 sql 会被解析为 BoundSql

对象。 -

什么是 MyBatis 的接口绑定,有什么好处?

接口映射就是在 MyBatis 中任意定义接口,然后把接口里面的方法和 SQL 语句绑定,

我们直接调用接口方法就可以,这样比起原来了 SqlSession 提供的方法我们可以有更加灵

活的选择和设置. -

接口绑定有几种实现方式,分别是怎么实现的?

接口绑定有两种实现方式,一种是通过注解绑定,就是在接口的方法上面加上

@Select@Update 等注解里面包含 Sql 语句来绑定,另外一种就是通过 xml 里面写 SQL 来

绑定,在这种情况下,要指定 xml 映射文件里面的 namespace 必须为接口的全路径名. -

什么情况下用注解绑定,什么情况下用 xml 绑

定?

当 Sql 语句比较简单时候,用注解绑定;当 SQL 语句比较复杂时候,用 xml 绑定,一般

用 xml 绑定的比较多 -

MyBatis 实现一对一有几种方式?具体怎么操作

的?

有联合查询和嵌套查询,联合查询是几个表联合查询,只查询一次,通过在 resultMap

里面配置 association 节点配置一对一的类就可以完成;嵌套查询是先查一个表,根据这个

表里面的结果的外键 id,去再另外一个表里面查询数据,也是通过 association 配置,但另

外一个表的查询通过 select 属性配置。 -

Mybatis 能执行一对一、一对多的关联查询吗?

都有哪些实现方式,以及它们之间的区别?

能,Mybatis 不仅可以执行一对一、一对多的关联查询,还可以执行多对一,多对多的

关联查询,多对一查询,其实就是一对一查询,只需要把 selectOne()修改为 selectList()

即可;多对多查询,其实就是一对多查询,只需要把 selectOne()修改为 selectList()即

可。

关联对象查询,有两种实现方式,一种是单独发送一个 sql 去查询关联对象,赋给主

对象,然后返回主对象。另一种是使用嵌套查询,嵌套查询的含义为使用 join 查询,一部

分列是 A 对象的属性值,另外一部分列是关联对象 B 的属性值,好处是只发一个 sql 查

询,就可以把主对象和其关联对象查出来。 -

MyBatis 里面的动态 Sql 是怎么设定的?用什

么语法?

MyBatis 里面的动态 Sql 一般是通过 if 节点来实现,通过 OGNL 语法来实现,但是如

果要写的完整,必须配合 where,trim 节点,where 节点是判断包含节点有内容就插入

where,否则不插入,trim 节点是用来判断如果动态语句是以 and 或 or 开始,那么会自动

把这个 and 或者 or 取掉。 -

Mybatis 是如何将 sql 执行结果封装为目标对

象并返回的?都有哪些映射形式?

第一种是使用标签,逐一定义列名和对象属性名之间的映射关系。

第二种是使用 sql 列的别名功能,将列别名书写为对象属性名,比如 T_NAME AS NAME,

对象属性名一般是 name,小写,但是列名不区分大小写,Mybatis 会忽略列名大小写,智

能找到与之对应对象属性名,你甚至可以写成 T_NAME AS NaMe,Mybatis 一样可以正常工

作。 有了列名与属性名的映射关系后,Mybatis 通过反射创建对象,同时使用反射给对象

的属性逐一赋值并返回,那些找不到映射关系的属性,是无法完成赋值的。 -

Xml 映射文件中,除了常见的

select|insert|updae|delete 标签之外,还有哪些

标签?

还有很多其他的标签,、、、、,

加上动态 sql 的 9 个标签,trim|where|set|foreach|if|choose|when|otherwise|bind

等,其中为 sql 片段标签,通过标签引入 sql 片段,为不支

持自增的主键生成策略标签。 -

当实体类中的属性名和表中的字段名不一样,如

果将查询的结果封装到指定 pojo?

1)通过在查询的 sql 语句中定义字段名的别名。

2)通过来映射字段名和实体类属性名的一一对应的关系。 -

模糊查询 like 语句该怎么写

1)在 Java 中拼接通配符,通过#{}赋值

2)在 Sql 语句中拼接通配符 (不安全 会引起 Sql 注入) -

通常一个 Xml 映射文件,都会写一个 Dao 接口

与之对应, Dao 的工作原理,是否可以重载?

不能重载,因为通过 Dao 寻找 Xml 对应的 sql 的时候全限名+方法名的保存和寻找策

略。接口工作原理为 jdk 动态代理原理,运行时会为 dao 生成 proxy,代理对象会拦

截接口方法,去执行对应的 sql 返回数据。 -

Mybatis 映射文件中,如果 A 标签通过

include 引用了 B 标签的内容,请问,B 标签能否

定义在 A 标签的后面,还是说必须定义在 A 标签的

前面?

虽然 Mybatis 解析 Xml 映射文件是按照顺序解析的,但是,被引用的 B 标签依然可

以定义在任何地方,Mybatis 都可以正确识别。原理是,Mybatis 解析 A 标签,发现 A 标

签引用了 B 标签,但是 B 标签尚未解析到,尚不存在,此时,Mybatis 会将 A 标签标记

为未解析状态,然后继续解析余下的标签,包含 B 标签,待所有标签解析完毕,Mybatis 会

重新解析那些被标记为未解析的标签,此时再解析 A 标签时,B 标签已经存在,A 标签也

就可以正常解析完成了。 -

Mybatis 的 Xml 映射文件中,不同的 Xml 映射

文件,id 是否可以重复?

不同的 Xml 映射文件,如果配置了 namespace,那么 id 可以重复;如果没有配置

namespace,那么 id 不能重复;毕竟 namespace 不是必须的,只是最佳实践而已。原因就

是 namespace+id 是作为 Map<String,MappedStatement>的 key 使用的,如果没有

namespace,就剩下 id,那么,id 重复会导致数据互相覆盖。有了 namespace,自然 id 就

可以重复,namespace 不同,namespace+id 自然也就不同。 -

Mybatis 中如何执行批处理?

使用 BatchExecutor 完成批处理。 -

Mybatis 都有哪些 Executor 执行器?它们之

间的区别是什么?

Mybatis 有三种基本的 Executor 执行器, SimpleExecutor 、 ReuseExecutor 、

BatchExecutor。1)SimpleExecutor:每执行一次 update 或 select,就开启一个 Statement

对象,用完立刻关闭 Statement 对象。2)ReuseExecutor:执行 update 或 select,以 sql

作为 key 查找 Statement 对象,存在就使用,不存在就创建,用完后,不关闭 Statement

对象,而是放置于 Map3)BatchExecutor:完成批处理。 -

Mybatis 中如何指定使用哪一种 Executor 执

行器?

在 Mybatis 配置文件中,可以指定默认的 ExecutorType 执行器类型,也可以手动给

DefaultSqlSessionFactory 的创建 SqlSession 的方法传递 ExecutorType 类型参数。 -

Mybatis 执行批量插入,能返回数据库主键列表

吗?

能,JDBC 都能,Mybatis 当然也能。 -

Mybatis 是否可以映射 Enum 枚举类?

Mybatis 可以映射枚举类,不单可以映射枚举类,Mybatis 可以映射任何对象到表的一

列上。映射方式为自定义一个 TypeHandler,实现 TypeHandler 的 setParameter()和

getResult()接口方法。TypeHandler 有两个作用,一是完成从 JavaType 至 jdbcType 的

转换,二是完成 jdbcType 至 JavaType 的转换,体现为 setParameter()和 getResult()

两个方法,分别代表设置 sql 问号占位符参数和获取列查询结果。 -

如何获取自动生成的(主)键值?

配置文件设置 usegeneratedkeys 为 true -

在 mapper 中如何传递多个参数?

1)直接在方法中传递参数,xml 文件用#{0} #{1}来获取

2)使用 @param 注解:这样可以直接在 xml 文件中通过#{name}来获取 -

32、resultType resultMap 的区别?

1)类的名字和数据库相同时,可以直接设置 resultType 参数为 Pojo 类

2)若不同,需要设置 resultMap 将结果名字和 Pojo 名字进行转换 -

使用 MyBatis 的 mapper 接口调用时有哪些要

求?

1)Mapper 接口方法名和 mapper.xml 中定义的每个 sql 的 id 相同

2 ) Mapper 接口方法的输入参数类型和 mapper.xml 中定义的每个 sql 的

parameterType 的

类型相同

3)Mapper 接口方法的输出参数类型和 mapper.xml 中定义的每个 sql 的 resultType

的类型相同

Mapper.xml 文件中的 namespace 即是 mapper 接口的类路径。 -

Mybatis 比 IBatis 比较大的几个改进是什

么?

1)有接口绑定,包括注解绑定 sql 和 xml 绑定 Sql

2)动态 sql 由原来的节点配置变成 OGNL 表达式 3)

在一对一,一对多的时候引进了 association,在一对多的时候引入了 collection 节

点,不过都是在 resultMap 里面配置 -

IBatis 和 MyBatis 在核心处理类分别叫什

么?

IBatis 里面的核心处理类交 SqlMapClient,MyBatis 里面的核心处理类叫做

SqlSession。 -

IBatis 和 MyBatis 在细节上的不同有哪些?

1)在 sql 里面变量命名有原来的#变量# 变成了#{变量}

2)原来的 变 量 变量 变量变成了${变量}

3)原来在 sql 节点里面的 class 都换名字交 type

4)原来的 queryForObject queryForList 变成了 selectOne selectList5)原来的别

名设置在映射文件里面放在了核心配置文件里

Mysql 面试题目

1.数据库三范式是什么? -

第一范式(1NF):字段具有原子性,不可再分。(所有关系型数据库系统都满足第一

范式数据库表中的字段都是单一属性的,不可再分) -

第二范式(2NF)是在第一范式(1NF)的基础上建立起来的,即满足第二范式(2NF)

必须先满足第一范式(1NF)。要求数据库表中的每个实例或行必须可以被惟一地区分。通

常需要为表加上一个列,以存储各个实例的惟一标识。这个惟一属性列被称为主关键字或主

键。 -

满足第三范式(3NF)必须先满足第二范式(2NF)。简而言之,第三范式(3NF)要

求一个数据库表中不包含已在其它表中已包含的非主关键字信息。>所以第三范式具有如下

特征: >>1. 每一列只有一个值 >>2. 每一行都能区分。 >>3. 每一个表都不包含其他表已

经包含的非主关键字信息。

2.有哪些数据库优化方面的经验? -

用 PreparedStatement, 一般来说比 Statement 性能高:一个 sql 发给服务器去

执行,涉及步骤:语法检查、语义分析, 编译,缓存。 -

有外键约束会影响插入和删除性能,如果程序能够保证数据的完整性,那在设计数

据库时就去掉外键。 -

表中允许适当冗余,譬如,主题帖的回复数量和最后回复时间等

-

UNION ALL 要比 UNION 快很多,所以,如果可以确认合并的两个结果集中不包含重

复数据且不需要排序时的话,那么就使用 UNION ALL。 >>UNION 和 UNION ALL 关键字都是

将两个结果集合并为一个,但这两者从使用和效率上来说都有所不同。 >1. 对重复结果的

处理:UNION 在进行表链接后会筛选掉重复的记录,Union All 不会去除重复记录。 >2. 对

排序的处理:Union 将会按照字段的顺序进行排序;UNION ALL 只是简单的将两个结果合并

后就返回。

3.请简述常用的索引有哪些种类? -

普通索引: 即针对数据库表创建索引

-

唯一索引: 与普通索引类似,不同的就是:MySQL 数据库索引列的值必须唯一,但

允许有空值 -

主键索引: 它是一种特殊的唯一索引,不允许有空值。一般是在建表的时候同时创

建主键索引 -

组合索引: 为了进一步榨取 MySQL 的效率,就要考虑建立组合索引。即将数据库表

中的多个字段联合起来作为一个组合索引。

4.以及在 mysql 数据库中索引的工作机制是什么?

数据库索引,是数据库管理系统中一个排序的数据结构,以协助快速查询、更新数据库

表中数据。索引的实现通常使用 B 树及其变种 B+树 -

MySQL 的基础操作命令:

-

MySQL 是否处于运行状态:Debian 上运行命令 service mysql status,在 RedHat

上运行命令 service mysqld status -

开启或停止 MySQL 服务 :运行命令 service mysqld start 开启服务;运行命令

service mysqld stop 停止服务 -

Shell 登入 MySQL: 运行命令 mysql -u root -p

-

列出所有数据库:运行命令 show databases;

-

切换到某个数据库并在上面工作:运行命令 use databasename; 进入名为

databasename 的数据库 -

列出某个数据库内所有表: show tables;

-

获取表内所有 Field 对象的名称和类型 :describe table_name;

-

mysql 的复制原理以及流程。

Mysql 内建的复制功能是构建大型,高性能应用程序的基础。将 Mysql 的数据分布到

多个系统上去,这种分布的机制,是通过将 Mysql 的某一台主机的数据复制到其它主机

(slaves)上,并重新执行一遍来实现的。 * 复制过程中一个服务器充当主服务器,而一

个或多个其它服务器充当从服务器。主服务器将更新写入二进制日志文件,并维护文件的一

个索引以跟踪日志循环。这些日志可以记录发送到从服务器的更新。 当一个从服务器连接

主服务器时,它通知主服务器在日志中读取的最后一次成功更新的位置。从服务器接收从那

时起发生的任何更新,然后封锁并等待主服务器通知新的更新。

过程如下 -

主服务器把更新记录到二进制日志文件中。

-

从服务器把主服务器的二进制日志拷贝到自己的中继日志(replay log)中。

-

从服务器重做中继日志中的时间,把更新应用到自己的数据库上。

-

mysql 支持的复制类型?

-

基于语句的复制: 在主服务器上执行的 SQL 语句,在从服务器上执行同样的语句。

MySQL 默认采用基于语句的复制,效率比较高。 一旦发现没法精确复制时,会自动选着基

于行的复制。 -

基于行的复制:把改变的内容复制过去,而不是把命令在从服务器上执行一遍. 从

mysql5.0 开始支持 -

混合类型的复制: 默认采用基于语句的复制,一旦发现基于语句的无法精确的复制

时,就会采用基于行的复制。 -

mysql 中 myisam 与 innodb 的区别?

-

事务支持 > MyISAM:强调的是性能,每次查询具有原子性,其执行数度比 InnoDB 类

型更快,但是不提供事务支持。 > InnoDB:提供事务支持事务,外部键等高级数据库功能。

具有事务(commit)、回滚(rollback)和崩溃修复能力(crash recovery capabilities)的事

务安全(transaction-safe (ACID compliant))型表。 -

InnoDB 支持行级锁,而 MyISAM 支持表级锁. >> 用户在操作 myisam 表时,select,

update,delete,insert 语句都会给表自动加锁,如果加锁以后的表满足 insert 并发的

情况下,可以在表的尾部插入新的数据。 -

InnoDB 支持 MVCC, 而 MyISAM 不支持

-

InnoDB 支持外键,而 MyISAM 不支持

-

表主键 > MyISAM:允许没有任何索引和主键的表存在,索引都是保存行的地址。 >

InnoDB:如果没有设定主键或者非空唯一索引,就会自动生成一个 6 字节的主键(用户不可

见),数据是主索引的一部分,附加索引保存的是主索引的值。 -

InnoDB 不支持全文索引,而 MyISAM 支持。

-

可移植性、备份及恢复 > MyISAM:数据是以文件的形式存储,所以

在跨平台的数据转移中会很方便。在备份和恢复时可单独针对某个表进

行操作。 > InnoDB:免费的方案可以是拷贝数据文件、备份

binlog,或者用 mysqldump,在数据量达到几十 G 的时候就相对痛

苦了 -

存储结构 > MyISAM:每个 MyISAM 在磁盘上存储成三个文件。第一个文件的名字以

表的名字开始,扩展名指出文件类型。.frm 文件存储表定义。数据文件的扩展名为.MYD

(MYData)。索引文件的扩展名是.MYI (MYIndex)。 > InnoDB:所有的表都保存在同一个数

据文件中(也可能是多个文件,或者是独立的表空间文件),InnoDB 表的大小只受限于操

作系统文件的大小,一般为 2GB。 -

mysql中varchar与char的区别以及 varchar(50)

中的 50 代表的涵义? -

varchar 与 char 的区别: char 是一种固定长度的类型,varchar 则是一种可变长

度的类型. -

varchar(50)中 50 的涵义 : 最多存放 50 个字节

-

int(20)中 20 的涵义: int(M)中的 M indicates the maximum display width (最

大显示宽度)for integer types. The maximum legal display width is 255. -

MySQL 中 InnoDB 支持的四种事务隔离级别名

称,以及逐级之间的区别? -

Read Uncommitted(读取未提交内容)

在该隔离级别,所有事务都可以看到其他未提交事务的执行结果。本隔离级别很少用

于实际应用,因为它的性能也不比其他级别好多少。读取未提交的数据,也被称之为脏读

(Dirty Read)。 -

Read Committed(读取提交内容)

这是大多数数据库系统的默认隔离级别(但不是 MySQL 默认的)。它满足了隔离的简

单定义:一个事务只能看见已经提交事务所做的改变。这种隔离级别也支持所谓的不可重复

读(Nonrepeatable Read),因为同一事务的其他实例在该实例处理其间可能会有新的

commit,所以同一 select 可能返回不同结果。 -

Repeatable Read(可重读)

这是 MySQL 的默认事务隔离级别,它确保同一事务的多个实例在并发读取数据时,会

看到同样的数据行。不过理论上,这会导致另一个棘手的问题:幻读(PhantomRead)。简

单的说,幻读指当用户读取某一范围的数据行时,另一个事务又在该范围内插入了新行,当

用户再读取该范围的数据行时,会发现有新的“幻影” 行。InnoDB 和 Falcon 存储引擎通

过多版本并发控制(MVCC,Multiversion Concurrency Control 间隙锁)机制解决了该问

题。注:其实多版本只是解决不可重复读问题,而加上间隙锁(也就是它这里所谓的并发控

制)才解决了幻读问题。

Serializable(可串行化)

这是最高的隔离级别,它通过强制事务排序,使之不可能相互冲突,从而解决幻读问

题。简言之,它是在每个读的数据行上加上共享锁。在这个级别,可能导致大量的超时现象

和锁竞争。 -

表中有大字段 X(例如:text 类型),且字段 X

不会经常更新,以读为主,将该字段拆成子表好处是

什么?

如果字段里面有大字段(text,blob)类型的,而且这些字段的访问并不多,这时候放在

一起就变成缺点了。MYSQL 数据库的记录存储是按行存储的,数据块大小又是固定的(16K),

每条记录越小,相同的块存储的记录就越多。此时应该把大字段拆走,这样应付大部分小字

段的查询时,就能提高效率。当需要查询大字段时,此时的关联查询是不可避免的,但也是

值得的。拆分开后,对字段的 UPDAE 就要 UPDATE 多个表了 -

MySQL 中 InnoDB 引擎的行锁是通过加在什么

上完成(或称实现)的?

InnoDB 行锁是通过给索引上的索引项加锁来实现的,这一点 MySQL 与 Oracle 不同,

后者是通过在数据块中对相应数据行加锁来实现的。InnoDB 这种行锁实现特点意味着:只

有通过索引条件检索数据,InnoDB 才使用行级锁,否则,InnoDB 将使用表锁! -

若一张表中只有一个字段 VARCHAR(N)类型,

utf8 编码,则 N 最大值为多少(精确到数量级即

可)?

由于 utf8 的每个字符最多占用 3 个字节。而 MySQL 定义行的长度不能超过 65535,

因此 N 的最大值计算方法为:(65535-1-2)/3。减去 1 的原因是实际存储从第二个字节开

始,减去 2 的原因是因为要在列表长度存储实际的字符长度,除以 3 是因为 utf8 限制:

每个字符最多占用 3 个字节。 -

[SELECT *] 和[SELECT 全部字段]的 2 种写法

有何优缺点? -

前者要解析数据字典,后者不需要

-

结果输出顺序,前者与建表列顺序相同,后者按指定字段顺序。

-

表字段改名,前者不需要修改,后者需要改

-

后者可以建立索引进行优化,前者无法优化

-

后者的可读性比前者要高

-

HAVNG 子句 和 WHERE 的异同点?

-

语法上:where 用表中列名,having 用 select 结果别名

-

影响结果范围:where 从表读出数据的行数,having 返回客户端的行数

-

索引:where 可以使用索引,having 不能使用索引,只能在临时结果集操作

-

where 后面不能使用聚集函数,having 是专门使用聚集函数的。

-

MySQL 当记录不存在时 insert,当记录存在时

update,语句怎么写?

INSERT INTO table (a,b,c) VALUES (1,2,3) ON DUPLICATE KEY

UPDATE c=c+1; -

一张表,里面有 ID 自增主键,当 insert 了 17

条记录之后,删除了第 15,16,17 条记录,再把

Mysql 重启,再 insert 一条记录,这条记录的 ID

是 18 还是 15 ?

(1)如果表的类型是 MyISAM,那么是 18

因为 MyISAM 表会把自增主键的最大 ID 记录到数据文件里,重启 MySQL 自增主键的

最大 ID 也不会丢失

(2)如果表的类型是 InnoDB,那么是 15

InnoDB 表只是把自增主键的最大 ID 记录到内存中,所以重启数据库或者是对表进行

OPTIMIZE 操作,都会导致最大 ID 丢失 -

Mysql 的技术特点是什么?

Mysql 数据库软件是一个客户端或服务器系统,其中包括:支持各种客户端程序和库的

多线程 SQL 服务器、不同的后端、广泛的应用程序编程接口和管理工具。 -

Heap 表是什么?

HEAP 表存在于内存中,用于临时高速存储。BLOB 或 TEXT 字段是不允许的,只能使用

比较运算符=,<,>,=>,= < HEAP 表不支持 AUTO_INCREMENT 索引不可为 NULL -

Mysql 服务器默认端口是什么?

Mysql 服务器的默认端口是 3306。 -

与 Oracle 相比,Mysql 有什么优势?

Mysql 是开源软件,随时可用,无需付费。

Mysql 是便携式的

带有命令提示符的 GUI。

使用 Mysql 查询浏览器支持管理 -

如何区分 FLOAT 和 DOUBLE?

以下是 FLOAT 和 DOUBLE 的区别:

浮点数以 8 位精度存储在 FLOAT 中,并且有四个字节。

浮点数存储在 DOUBLE 中,精度为 18 位,有八个字节。 -

区分 CHAR_LENGTH 和 LENGTH?

CHAR_LENGTH 是字符数,而 LENGTH 是字节数。Latin 字符的这两个数据是相同的,但

是对于 Unicode 和其他编码,它们是不同的。 -

请简洁描述 Mysql 中 InnoDB 支持的四种事务

隔离级别名称,以及逐级之间的区别?

SQL 标准定义的四个隔离级别为:

read uncommited :读到未提交数据

read committed:脏读,不可重复读

repeatable read:可重读

serializable :串行事物 -

在 Mysql 中 ENUM 的用法是什么?

ENUM 是一个字符串对象,用于指定一组预定义的值,并可在创建表时使用。Create

table size(name ENUM('Smail,‘Medium’,‘Large’); -

如何定义 REGEXP?

REGEXP 是模式匹配,其中匹配模式在搜索值的任何位置。 -

CHAR 和 VARCHAR 的区别?

以下是 CHAR 和 VARCHAR 的区别:

CHAR 和 VARCHAR 类型在存储和检索方面有所不同

CHAR 列长度固定为创建表时声明的长度,长度值范围是 1 到 255

当 CHAR 值被存储时,它们被用空格填充到特定长度,检索 CHAR 值时需删除尾随空格。 -

列的字符串类型可以是什么?

字符串类型是:

SET

BLOB

ENUM

CHAR

TEXT

VARCHAR -

如何获取当前的 Mysql 版本?

SELECT VERSION();用于获取当前 Mysql 的版本。 -

Mysql 中使用什么存储引擎?

存储引擎称为表类型,数据使用各种技术存储在文件中。

技术涉及:

Storage mechanism

Locking levels

Indexing

Capabilities and functions. -

Mysql 驱动程序是什么?

以下是 Mysql 中可用的驱动程序:

PHP 驱动程序

JDBC 驱动程序

ODBC 驱动程序

CWRAPPER

PYTHON 驱动程序

PERL 驱动程序

RUBY 驱动程序

CAP11PHP 驱动程序

Ado.net5.mxj -

TIMESTAMP 在 UPDATE CURRENT_TIMESTAMP 数

据类型上做什么?

创建表时 TIMESTAMP 列用 Zero 更新。只要表中的其他字段发生更改,UPDATE

CURRENT_TIMESTAMP 修饰符就将时间戳字段更新为当前时间。 -

主键和候选键有什么区别?

表格的每一行都由主键唯一标识,一个表只有一个主键。主键也是候选键。按照惯例,

候选键可以被指定为主键,并且可以用于任何外键引用。 -

如何使用 Unix shell 登录 Mysql?

我们可以通过以下命令登录:

[mysql dir]/bin/mysql -h hostname -u -

myisamchk 是用来做什么的?

它用来压缩 MyISAM 表,这减少了磁盘或内存使用。 -

如何控制 HEAP 表的最大尺寸?

Heal 表的大小可通过称为 max_heap_table_size 的 Mysql 配置变量来控制。 -

MyISAM Static 和 MyISAM Dynamic 有什么区

别?

在 MyISAM Static 上的所有字段有固定宽度。动态 MyISAM 表将具有像 TEXT,BLOB 等

字段,以适应不同长度的数据类型。MyISAM Static 在受损情况下更容易恢复。 -

federated 表是什么?

federated 表,允许访问位于其他服务器数据库上的表。 -

如果一个表有一列定义为 TIMESTAMP,将发生什

么?

每当行被更改时,时间戳字段将获取当前时间戳。 -

列设置为 AUTO INCREMENT 时,如果在表中达到

最大值,会发生什么情况?

它会停止递增,任何进一步的插入都将产生错误,因为密钥已被使用。 -

怎样才能找出最后一次插入时分配了哪个自动

增量?

LAST_INSERT_ID 将返回由 Auto_increment 分配的最后一个值,并且不需要指定表名

称。 -

你怎么看到为表格定义的所有索引?

索引是通过以下方式为表格定义的:

SHOW INDEX FROM -

LIKE 声明中的%和_是什么意思?

%对应于 0 个或更多字符,_只是 LIKE 语句中的一个字符。 -

如何在 Unix 和 Mysql 时间戳之间进行转换?

UNIX_TIMESTAMP 是从 Mysql 时间戳转换为 Unix 时间戳的命令

FROM_UNIXTIME 是从 Unix 时间戳转换为 Mysql 时间戳的命令 -

列对比运算符是什么?

在 SELECT 语句的列比较中使用=,<>,<=,<,> =,>,<<,>>,<=>,AND,OR 或 LIKE

运算符。 -

我们如何得到受查询影响的行数?

行数可以通过以下代码获得:

SELECT COUNT(user_id)FROM users; -

Mysql 查询是否区分大小写?

不区分

SELECT VERSION(), CURRENT_DATE;

SeLect version(), current_date;

seleCt vErSiOn(), current_DATE;

所有这些例子都是一样的,Mysql 不区分大小写。 -

LIKE 和 REGEXP 操作有什么区别?

LIKE 和 REGEXP 运算符用于表示^和%。

SELECT * FROM employee WHERE emp_name REGEXP “^b”;

SELECT * FROM employee WHERE emp_name LIKE “%b”; -

BLOB 和 TEXT 有什么区别?

BLOB 是一个二进制对象,可以容纳可变数量的数据。有四种类型的 BLOB -

TINYBLOB

BLOB

MEDIUMBLOB 和

LONGBLOB

它们只能在所能容纳价值的最大长度上有所不同。

TEXT 是一个不区分大小写的 BLOB。四种 TEXT 类型

TINYTEXT

TEXT

MEDIUMTEXT 和

LONGTEXT

它们对应于四种 BLOB 类型,并具有相同的最大长度和存储要求。BLOB 和 TEXT 类型

之间的唯一区别在于对 BLOB 值进行排序和比较时区分大小写,对 TEXT

值不区分大小写。 -

mysql_fetch_array 和 mysql_fetch_object

的区别是什么?

以下是 mysql_fetch_array 和 mysql_fetch_object 的区别:

mysql_fetch_array() - 将结果行作为关联数组或来自数据库的常规数组返回。

mysql_fetch_object - 从数据库返回结果行作为对象。 -

我们如何在 mysql 中运行批处理模式?

以下命令用于在批处理模式下运行:

mysql;

mysql mysql.out -

MyISAM 表格将在哪里存储,并且还提供其存储

格式?

每个 MyISAM 表格以三种格式存储在磁盘上:

·“.frm”文件存储表定义

·数据文件具有“.MYD”(MYData)扩展名

索引文件具有“.MYI”(MYIndex)扩展名 -

Mysql 中有哪些不同的表格?

共有 5 种类型的表格:

MyISAM

Heap

Merge

INNODB

ISAM

MyISAM 是 Mysql 的默认存储引擎。 -

ISAM 是什么?

ISAM 简称为索引顺序访问方法。它是由 IBM 开发的,用于在磁带等辅助存储系统上存

储和检索数据。 -

InnoDB 是什么?

lnnoDB 是一个由 Oracle 公司开发的 Innobase Oy 事务安全存储引擎。 -

Mysql 如何优化 DISTINCT?

DISTINCT 在所有列上转换为 GROUP BY,并与 ORDER BY 子句结合使用。

1

SELECT DISTINCT t1.a FROM t1,t2 where t1.a=t2.a; -

如何输入字符为十六进制数字?

如果想输入字符为十六进制数字,可以输入带有单引号的十六进制数字和前缀(X),

或者只用(Ox)前缀输入十六进制数字。

如果表达式上下文是字符串,则十六进制数字串将自动转换为字符串。 -

如何显示前 50 行?

在 Mysql 中,使用以下代码查询显示前 50 行:

SELECT*FROM

LIMIT 0,50; -

可以使用多少列创建索引?

任何标准表最多可以创建 16 个索引列。 -

NOW()和 CURRENT_DATE()有什么区别?

NOW()命令用于显示当前年份,月份,日期,小时,分钟和秒。

CURRENT_DATE()仅显示当前年份,月份和日期。 -

什么样的对象可以使用 CREATE 语句创建?

以下对象是使用 CREATE 语句创建的:

DATABASE

EVENT

FUNCTION

INDEXPROCEDURE

TABLE

TRIGGER

USER

VIEW -

Mysql 表中允许有多少个 TRIGGERS?

在 Mysql 表中允许有六个触发器,如下:

BEFORE INSERT

AFTER INSERT

BEFORE UPDATE

AFTER UPDATE

BEFORE DELETE

AFTER DELETE -

什么是非标准字符串类型?

以下是非标准字符串类型:

TINYTEXT

TEXT

MEDIUMTEXT

LONGTEXT -

什么是通用 SQL 函数?

CONCAT(A, B) - 连接两个字符串值以创建单个字符串输出。通常用于将两个或多个字

段合并为一个字段。

FORMAT(X, D)- 格式化数字 X 到 D 有效数字。

CURRDATE(), CURRTIME()- 返回当前日期或时间。

NOW() - 将当前日期和时间作为一个值返回。

MONTH(),DAY(),YEAR(),WEEK(),WEEKDAY() - 从日期值中提取给定数据。

HOUR(),MINUTE(),SECOND() - 从时间值中提取给定数据。

DATEDIFF(A,B) - 确定两个日期之间的差异,通常用于计算年龄

SUBTIMES(A,B) - 确定两次之间的差异。

FROMDAYS(INT) - 将整数天数转换为日期值。 -

解释访问控制列表

ACL(访问控制列表)是与对象关联的权限列表。这个列表是 Mysql 服务器安全模型的

基础,它有助于排除用户无法连接的问题。

Mysql 将 ACL(也称为授权表)缓存在内存中。当用户尝试认证或运行命令时,Mysql 会

按照预定的顺序检查 ACL 的认证信息和权限。 -

Mysql 支持事务吗?

在缺省模式下,MYSQL 是 autocommit 模式的,所有的数据库更新操作都会即时提交,

所以在缺省情况下,mysql 是不支持事务的。

但是如果你的 MYSQL 表类型是使用 InnoDB Tables 或 BDB tables 的话,你的 MYSQL

就可以使用事务处理,使用 SET AUTOCOMMIT=0 就可以使 MYSQL 允许在非 autocommit 模

式,在非 autocommit 模式下,你必须使用 COMMIT 来提交你的更改,或者用 ROLLBACK 来

回滚你的更改。

示例如下:

一

START TRANSACTION;

SELECT @A:=SUM(salary) FROM table1 WHERE type=1;

UPDATE table2 SET summmary=@A WHERE type=1;

COMMIT; -

Mysql 里记录货币用什么字段类型好

NUMERIC 和 DECIMAL 类型被 Mysql 实现为同样的类型,这在 SQL92 标准允许。他们

被用于保存值,该值的准确精度是极其重要的值,例如与金钱有关的数据。当声明一个类是

这些类型之一时,精度和规模的能被(并且通常是)指定;

例如:

salary DECIMAL(9,2)

在这个例子中,9(precision)代表将被用于存储值的总的小数位数,而 2(scale)代表

将被用于存储小数点后的位数。

因此,在这种情况下,能被存储在 salary 列中的值的范围是从-9999999.99 到

9999999.99。

在 ANSI/ISO SQL92 中,句法 DECIMAL§等价于 DECIMAL(p,0)。

同样,句法 DECIMAL 等价于 DECIMAL(p,0),这里实现被允许决定值 p。Mysql 当前不

支持 DECIMAL/NUMERIC 数据类型的这些变种形式的任一种。

这一般说来不是一个严重的问题,因为这些类型的主要益处得自于明显地控制精度和规

模的能力。DECIMAL 和 NUMERIC 值作为字符串存储,而不是作为二进制浮点数,以便保存

那些值的小数精度。

一个字符用于值的每一位、小数点(如果 scale>0)和“-”符号(对于负值)。如果 scale

是 0,DECIMAL 和 NUMERIC 值不包含小数点或小数部分。DECIMAL 和 NUMERIC 值得最大的

范围与 DOUBLE 一样,但是对于一个给定的 DECIMAL 或

NUMERIC 列,实际的范围可由制由给定列的 precision 或 scale 限制。

当这样的列赋给了小数点后面的位超过指定 scale 所允许的位的值,该值根据 scale

四舍五入。

当一个 DECIMAL 或 NUMERIC 列被赋给了其大小超过指定(或缺省的)precision 和

scale 隐含的范围的值,Mysql 存储表示那个范围的相应的端点值。

我希望本文可以帮助你提升技术水平。那些,感觉学的好难,甚至会令你沮丧的人,别

担

心,我认为,如果你愿意试一试本文介绍的几点,会向前迈进,克服这种感觉。这些要

点

也许对你不适用,但你会明确一个重要的道理:接受自己觉得受困这个事实是摆脱这个

困

境的第一步。 -

Mysql 数据表在什么情况下容易损坏?

服务器突然断电导致数据文件损坏。

强制关机,没有先关闭 mysql 服务等。 -

Mysql 有关权限的表都有哪几个?

Mysql 服务器通过权限表来控制用户对数据库的访问,权限表存放在 mysql 数据库里,

由 mysql_install_db 脚本初始化。这些权限表分别 user,db,table_priv,columns_priv

和 host。 -

Mysql 中有哪几种锁?

MyISAM 支持表锁,InnoDB 支持表锁和行锁,默认为行锁

表级锁:开销小,加锁快,不会出现死锁。锁定粒度大,发生锁冲突的概率最高,并发

量最低

行级锁:开销大,加锁慢,会出现死锁。锁力度小,发生锁冲突的概率小,并发度最高

Dubbo 面试题目 -

Dubbo 支持哪些协议,每种协议的应用场景,优缺

点?

dubbo: 单一长连接和 NIO 异步通讯,适合大并发小数据量的服务调用,以及消费者

远大于提供者。传输协议 TCP,异步,Hessian 序列化;

rmi: 采用 JDK 标准的 rmi 协议实现,传输参数和返回参数对象需要实现

Serializable 接口,使用 Java 标准序列化机制,使用阻塞式短连接,传输数据包大小混

合,消费者和提供者个数差不多,可传文件,传输协议 TCP。多个短连接,TCP 协议传输,

同步传输,适用常规的远程服务调用和 rmi 互操作。在依赖低版本的 Common-Collections

包,Java 序列化存在安全漏洞;

webservice: 基于 WebService 的远程调用协议,集成 CXF 实现,提供和原生

WebService 的互操作。多个短连接,基于 HTTP 传输,同步传输,适用系统集成和跨语言

调用;

http: 基于 Http 表单提交的远程调用协议,使用 Spring 的 HttpInvoke 实现。多

个短连接,传输协议 HTTP,传入参数大小混合,提供者个数多于消费者,需要给应用程序

和浏览器 JS 调用;

hessian: 集成 Hessian 服务,基于 HTTP 通讯,采用 Servlet 暴露服务,Dubbo 内

嵌 Jetty 作为服务器时默认实现,提供与 Hession 服务互操作。多个短连接,同步 HTTP 传

输,Hessian 序列化,传入参数较大,提供者大于消费者,提供者压力较大,可传文件;

memcache: 基于 memcached 实现的 RPC 协议

redis: 基于 redis 实现的 RPC 协议 -

Dubbo 超时时间怎样设置?

Dubbo 超时时间设置有两种方式:

服务提供者端设置超时时间,在 Dubbo 的用户文档中,推荐如果能在服务端多配置就

尽量多配置,因为服务提供者比消费者更清楚自己提供的服务特性。

服务消费者端设置超时时间,如果在消费者端设置了超时时间,以消费者端为主,即优

先级更高。因为服务调用方设置超时时间控制性更灵活。如果消费方超时,服务端线程不会

定制,会产生警告。 -

Dubbo 有些哪些注册中心?

Multicast 注册中心: Multicast 注册中心不需要任何中心节点,只要广播地址,就

能进行服务注册和发现。基于网络中组播传输实现;

Zookeeper 注册中心: 基于分布式协调系统 Zookeeper 实现,采用 Zookeeper 的

watch 机制实现数据变更;

redis 注册中心: 基于 redis 实现,采用 key/Map 存储,住 key 存储服务名和类

型,Map 中 key 存储服务 URL,value 服务过期时间。基于 redis 的发布/订阅模式通知

数据变更;

Simple 注册中心

Dubbo 集群的负载均衡有哪些策略 Dubbo 提供了常见的集群策略实现,并预扩展点

予以自行实现。

Random LoadBalance: 随机选取提供者策略,有利于动态调整提供者权重。截面碰撞

率高,调用次数越多,分布越均匀;

RoundRobin LoadBalance: 轮循选取提供者策略,平均分布,但是存在请求累积的问

题;

LeastActive LoadBalance: 最少活跃调用策略,解决慢提供者接收更少的请求;

ConstantHash LoadBalance: 一致性 Hash 策略,使相同参数请求总是发到同一提供

者,一台机器宕机,可以基于虚拟节点,分摊至其他提供者,避免引起提供者的剧烈变动; -

Dubbo 是什么?

Dubbo 是一个分布式、高性能、透明化的 RPC 服务框架,提供服务自动注册、自动发

现等高效服务治理方案, 可以和 Spring 框架无缝集成。 -

Dubbo 的主要应用场景?

透明化的远程方法调用,就像调用本地方法一样调用远程方法,只需简单配置,没有任

何 API 侵入。

软负载均衡及容错机制,可在内网替代 F5 等硬件负载均衡器,降低成本,减少单点。

服务自动注册与发现,不再需要写死服务提供方地址,注册中心基于接口名查询服务提

供者的 IP 地址,并且能够平滑添加或删除服务提供者。 -

Dubbo 的核心功能?

主要就是如下 3 个核心功能:

Remoting:网络通信框架,提供对多种 NIO 框架抽象封装,包括“同步转异步”和“请

求-响应”模式的信息交换方式。

Cluster:服务框架,提供基于接口方法的透明远程过程调用,包括多协议支持,以及

软负载均衡,失败容错,地址路由,动态配置等集群支持。

Registry:服务注册,基于注册中心目录服务,使服务消费方能动态的查找服务提供方,

使地址透明,使服务提供方可以平滑增加或减少机器。

? -

Dubbo 服务注册与发现的流程?流程说明:

Provider(提供者)绑定指定端口并启动服务

指供者连接注册中心,并发本机 IP、端口、应用信息和提供服务信息发送至注册中心

存储

Consumer(消费者),连接注册中心 ,并发送应用信息、所求服务信息至注册中心

注册中心根据 消费 者所求服务信息匹配对应的提供者列表发送至 Consumer 应用缓

存。

Consumer 在发起远程调用时基于缓存的消费者列表择其一发起调用。

Provider 状态变更会实时通知注册中心、在由注册中心实时推送至 Consumer

设计的原因:

Consumer 与 Provider 解偶,双方都可以横向增减节点数。

注册中心对本身可做对等集群,可动态增减节点,并且任意一台宕掉后,将自动切换到

另一台

去中心化,双方不直接依懒注册中心,即使注册中心全部宕机短时间内也不会影响服务

的调用

服务提供者无状态,任意一台宕掉后,不影响使用 -

Dubbo 的架构设计?

Dubbo 框架设计一共划分了 10 个层:

服务接口层(Service):该层是与实际业务逻辑相关的,根据服务提供方和服务消费

方的业务设计对应的接口和实现。

配置层(Config):对外配置接口,以 ServiceConfig 和 ReferenceConfig 为中心。

服务代理层(Proxy):服务接口透明代理,生成服务的客户端 Stub 和服务器端

Skeleton。

服务注册层(Registry):封装服务地址的注册与发现,以服务 URL 为中心。

集群层(Cluster):封装多个提供者的路由及负载均衡,并桥接注册中心,以 Invoker

为中心。

监控层(Monitor):RPC 调用次数和调用时间监控。

远程调用层(Protocol):封将 RPC 调用,以 Invocation 和 Result 为中心,扩展

接口为 Protocol、Invoker 和 Exporter。

信息交换层(Exchange):封装请求响应模式,同步转异步,以 Request 和 Response

为中心。

网络传输层(Transport):抽象 mina 和 netty 为统一接口,以 Message 为中心。 -

Dubbo 的服务调用流程?Dubbo 支持哪些协议,每

种协议的应用场景,优缺点?

dubbo: 单一长连接和 NIO 异步通讯,适合大并发小数据量的服务调用,以及消费者

远大于提供者。传输协议 TCP,异步,Hessian 序列化;

rmi: 采用 JDK 标准的 rmi 协议实现,传输参数和返回参数对象需要实现

Serializable 接口,使用 Java 标准序列化机制,使用阻塞式短连接,传输数据包大小混

合,消费者和提供者个数差不多,可传文件,传输协议 TCP。 多个短连接,TCP 协议传输,

同步传输,适用常规的远程服务调用和 rmi 互操作。在依赖低版本的 Common-Collections

包,Java 序列化存在安全漏洞;

webservice: 基于 WebService 的远程调用协议,集成 CXF 实现,提供和原生

WebService 的互操作。多个短连接,基于 HTTP 传输,同步传输,适用系统集成和跨语言

调用;

http: 基于 Http 表单提交的远程调用协议,使用 Spring 的 HttpInvoke 实现。多

个短连接,传输协议 HTTP,传入参数大小混合,提供者个数多于消费者,需要给应用程序

和浏览器 JS 调用;

hessian: 集成 Hessian 服务,基于 HTTP 通讯,采用 Servlet 暴露服务,Dubbo 内

嵌 Jetty 作为服务器时默认实现,提供与 Hession 服务互操作。多个短连接,同步 HTTP 传

输,Hessian 序列化,传入参数较大,提供者大于消费者,提供者压力较大,可传文件;

memcache: 基于 memcached 实现的 RPC 协议

redis: 基于 redis 实现的 RPC 协议 -

dubbo 推荐用什么协议?

默认使用 dubbo 协议 -

Dubbo 有些哪些注册中心?

Multicast 注册中心: Multicast 注册中心不需要任何中心节点,只要广播地址,就

能进行服务注册和发现。基于网络中组播传输实现;

Zookeeper 注册中心: 基于分布式协调系统 Zookeeper 实现,采用 Zookeeper 的

watch 机制实现数据变更;

redis 注册中心: 基于 redis 实现,采用 key/Map 存储,住 key 存储服务名和类

型,Map 中 key 存储服务 URL,value 服务过期时间。基于 redis 的发布/订阅模式通知

数据变更;

Simple 注册中心 -

Dubbo 默认采用注册中心?

采用 Zookeeper -

为什么需要服务治理?

过多的服务 URL 配置困难

负载均衡分配节点压力过大的情况下也需要部署集群

服务依赖混乱,启动顺序不清晰

过多服务导致性能指标分析难度较大,需要监控 -

Dubbo 的注册中心集群挂掉,发布者和订阅者之

间还能通信么?

可以的,启动 dubbo 时,消费者会从 zookeeper 拉取注册的生产者的地址接口等数据,

缓存在本地。每次调用时,按照本地存储的地址进行调用。 -

Dubbo 与 Spring 的关系?

Dubbo 采用全 Spring 配置方式,透明化接入应用,对应用没有任何 API 侵入,只需

用 Spring 加载 Dubbo 的配置即可,Dubbo 基于 Spring 的 Schema 扩展进行加载。 -

Dubbo 使用的是什么通信框架?

默认使用 NIO Netty 框架 -

Dubbo 集群提供了哪些负载均衡策略?

Random LoadBalance: 随机选取提供者策略,有利于动态调整提供者权重。截面碰撞

率高,调用次数越多,分布越均匀;

RoundRobin LoadBalance: 轮循选取提供者策略,平均分布,但是存在请求累积的问

题;? LeastActive LoadBalance: 最少活跃调用策略,解决慢提供者接收更少的请求;

ConstantHash LoadBalance: 一致性 Hash 策略,使相同参数请求总是发到同一提供

者,一台机器宕机,可以基于虚拟节点,分摊至其他提供者,避免引起提供者的剧烈变动;

缺省时为 Random 随机调用 -

Dubbo 的集群容错方案有哪些?

Failover Cluster

失败自动切换,当出现失败,重试其它服务器。通常用于读操作,但重试会带来更长延

迟。

Failfast Cluster

快速失败,只发起一次调用,失败立即报错。通常用于非幂等性的写操作,比如新增记

录。

Failsafe Cluster

失败安全,出现异常时,直接忽略。通常用于写入审计日志等操作。

Failback Cluster

失败自动恢复,后台记录失败请求,定时重发。通常用于消息通知操作。

Forking Cluster

并行调用多个服务器,只要一个成功即返回。通常用于实时性要求较高的读操作,但需

要浪费更多服务资源。可通过 forks=“2” 来设置最大并行数。

Broadcast Cluster

广播调用所有提供者,逐个调用,任意一台报错则报错 。通常用于通知所有提供者更

新缓存或日志等本地资源信息。 -

Dubbo 的默认集群容错方案?

Failover Cluster -

Dubbo 支持哪些序列化方式?

默认使用 Hessian 序列化,还有 Duddo、FastJson、Java 自带序列化。 -

Dubbo 超时时间怎样设置?

Dubbo 超时时间设置有两种方式:

服务提供者端设置超时时间,在 Dubbo 的用户文档中,推荐如果能在服务端多配置就

尽量多配置,因为服务提供者比消费者更清楚自己提供的服务特性。

服务消费者端设置超时时间,如果在消费者端设置了超时时间,以消费者端为主,即优

先级更高。因为服务调用方设置超时时间控制性更灵活。如果消费方超时,服务端线程不会

定制,会产生警告。 -

服务调用超时问题怎么解决?

dubbo 在调用服务不成功时,默认是会重试两次的。 -

Dubbo 在安全机制方面是如何解决?

Dubbo 通过 Token 令牌防止用户绕过注册中心直连,然后在注册中心上管理授权。

Dubbo 还提供服务黑白名单,来控制服务所允许的调用方。 -

Dubbo 和 Dubbox 之间的区别?

dubbox 基于 dubbo 上做了一些扩展,如加了服务可 restful 调用,更新了开源组件

等。 -

Dubbo 和 Spring Cloud 的关系?

Dubbo 是 SOA 时代的产物,它的关注点主要在于服务的调用,流量分发、流量监控和

熔断。而 Spring Cloud 诞生于微服务架构时代,考虑的是微服务治理的方方面面,另外由

于依托了 Spirng、Spirng Boot 的优势之上,两个框架在开始目标就不一致,Dubbo 定位

服务治理、Spirng Cloud 是一个生态。 -

Dubbo 和 Spring Cloud 的区别?

最大的区别:Dubbo 底层是使用 Netty 这样的 NIO 框架,是基于 TCP 协议传输的,

配合以 Hession 序列化完成 RPC 通信。

而 SpringCloud 是基于 Http 协议+Rest 接口调用远程过程的通信,相对来说,Http

请求会有更大的报文,占的带宽也会更多。但是 REST 相比 RPC 更为灵活,服务提供方和

调用方的依赖只依靠一纸契 -

Dubbo 中 zookeeper 做注册中心,如果注册中

心集群都挂掉,发布者和订阅者之间还能通信么?

可以通信的,启动 dubbo 时,消费者会从 zk 拉取注册的生产者的地址接口等数据,

缓存在本地。每次调用时,按照本地存储的地址进行调用;

注册中心对等集群,任意一台宕机后,将会切换到另一台;注册中心全部宕机后,服务

的提供者和消费者仍能通过本地缓存通讯。服务提供者无状态,任一台 宕机后,不影响使

用;服务提供者全部宕机,服务消费者会无法使用,并无限次重连等待服务者恢复;

挂掉是不要紧的,但前提是你没有增加新的服务,如果你要调用新的服务,则是不能办

到的。

附文档截图: -

dubbo 服务负载均衡策略?

l Random LoadBalance

随机,按权重设置随机概率。在一个截面上碰撞的概率高,但调用量越大分布越均匀,

而且按概率使用权重后也比

较均匀,有利于动态调整提供者权重。(权重可以在 dubbo 管控台配置)

l RoundRobin LoadBalance

轮循,按公约后的权重设置轮循比率。存在慢的提供者累积请求问题,比如:第二台机

器很慢,但没挂,当请求调

到第二台时就卡在那,久而久之,所有请求都卡在调到第二台上。

l LeastActive LoadBalance

最少活跃调用数,相同活跃数的随机,活跃数指调用前后计数差。使慢的提供者收到更

少请求,因为越慢的提供者的

调用前后计数差会越大。

l ConsistentHash LoadBalance

一致性 Hash,相同参数的请求总是发到同一提供者。当某一台提供者挂时,原本发往

该提供者的请求,基于虚拟节

点,平摊到其它提供者,不会引起剧烈变动。缺省只对第一个参数 Hash -