原文:Intelligent Projects Using Python

协议:CC BY-NC-SA 4.0

译者:飞龙

本文来自【ApacheCN 深度学习 译文集】,采用译后编辑(MTPE)流程来尽可能提升效率。

不要担心自己的形象,只关心如何实现目标。——《原则》,生活原则 2.3.c

一、人工智能系统的基础

人工智能(AI)在过去几年中一直处于技术的最前沿,并已进入主流应用,例如专家系统,移动设备上的个性化应用, 自然语言处理中的机器翻译,聊天机器人,自动驾驶汽车等。 但是,AI 的定义在很长一段时间以来一直是一个争论的主题。 这主要是因为所谓的 AI 效应将过去已经通过 AI 解决的工作归类为非 AI。 根据一位著名的计算机科学家的说法:

智能是机器尚未完成的一切。

–拉里·特斯勒(Larry Tesler)

在 1996 年 IBM 电脑 Deep Blue 击败 Gary Kasparov 之前,一直认为构建能下象棋的智能系统是 AI。类似地,曾经将视觉,言语和自然语言方面的问题视为复杂问题,但是由于 AI 的影响,它们现在仅被视为计算而非真正的 AI。 近来,人工智能已经能够解决复杂的数学问题,创作音乐和创作抽象绘画,并且人工智能的这些功能正在不断增加。 科学家将 AI 系统在未来等同于人类智能水平的点称为 AI 奇点。 机器是否会真正达到人类的智能水平这个问题非常令人着迷。

许多人会认为机器永远无法达到人类的智能水平,因为用来学习或执行智能任务的 AI 逻辑是由人类编程的,并且它们缺乏人类所拥有的意识和自我意识。 但是,一些研究人员提出了另一种想法,即人类意识和自我意识就像无限循环程序,可以通过反馈从周围的环境中学习。 因此,也有可能将意识和自我意识编程到机器中。 但是,就目前而言,我们将把 AI 的这一哲学方面再留一天,并简单地讨论我们所知道的 AI。

简而言之,AI 可以定义为机器(通常是计算机或机器人)以类人的智力执行任务的能力,例如具有推理,学习经验,归纳,破译含义和拥有的能力等属性。 视觉感知。 我们将坚持这个更实际的定义,而不是关注 AI 效应所带来的哲学内涵以及 AI 奇异性的前景。 尽管可能存在关于 AI 可以实现和不能实现的争论,但基于 AI 的系统的最新成功故事却令人瞩目。 下图描述了 AI 的一些较新的主流应用:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-hORVU4dY-1681653992465)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/623d9065-122c-4066-bfed-634f7ac3cd75.png)]

图 1.1:人工智能的应用

本书将涵盖来自 AI 的所有核心学科的项目的详细实现,概述如下:

- 基于迁移学习的 AI 系统

- 基于自然语言的 AI 系统

- 基于生成对抗网络(GAN)的应用

- 专家系统

- 视频到文本翻译应用

- 基于 AI 的推荐系统

- 基于 AI 的移动应用

- 基于 AI 的聊天机器人

- 强化学习应用

在本章中,我们将简要介绍实现机器学习和深度学习的概念,这些概念是实现以下各章中涉及的项目所必需的。

神经网络

神经网络是受人脑启发的机器学习模型。 它们由神经处理单元组成,它们以分层的方式相互连接。 这些神经处理单元称为人工神经元,它们在人脑中执行与轴突相同的功能。 在人脑中,树突接收来自邻近神经元的输入,并在将输入传输到神经元的体细胞之前减弱或放大输入。 在神经元的躯体中,这些修饰的信号被加在一起并传递到神经元的轴突。 如果轴突的输入超过指定的阈值,则信号将传递到相邻神经元的树突。

人工神经元松散地工作可能与生物神经元在相同的逻辑上起作用。 它接收来自邻近神经元的输入。 通过神经元的输入连接来缩放输入,然后将它们加在一起。 最后,求和的输入通过激活函数传递,该函数的输出传递到下一层的神经元。

下图说明了生物神经元和人工神经元,以进行比较:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Aa6arHAs-1681653992466)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/6527d133-7918-4ab3-96e8-36fa4181c4dc.png)]

图 1.2:生物神经元

下图说明了人工神经元:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-9f2bukQd-1681653992467)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/ed578913-a219-4604-be04-530487b57afa.png)]

图 1.3:人工神经元

现在,让我们看一下人工神经网络的结构,如下图所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-ZlRfPnxB-1681653992467)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/b767da6e-2a08-4790-8e59-3081c2ab9651.png)]

图 1.4:人工神经网络

输入x ∈ R^N穿过神经单元的连续层,这些层以分层方式排列。 特定层中的每个神经元都接收来自先前层的神经元的输入,这些输入被它们之间的连接权重所衰减或放大。 权重w[ij]^(l)对应于l层第i个神经元与l + 1层第j个神经元。 同样,每个神经元单元i在特定层1中都有一个偏置b[i]^(l)。 神经网络为输入向量x ∈ R^N预测输出y_hat。 如果数据的实际标签是y,其中y取连续值,则神经元网络将预测误差最小化(y - y_hat)^2来学习权重和偏差。 当然,对于所有标记的数据点,必须将误差最小化:(xi, yi), i ∈ 1, 2, ..., m。

如果我们用一个公共向量W表示一组权重和偏差,并且预测中的总误差由C表示,则在训练过程中,估计的W可以表示为:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-JqsHEvIU-1681653992468)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/973e52ab-5ebb-40a0-941c-20665d118f10.png)]

同样,预测输出y_hat可以由输入x的函数表示,并由权重向量W进行参数化,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-P8reOrtv-1681653992468)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/9e08ed5e-7e12-46d1-a2cb-a2e343d9c8d2.png)]

这种用于预测输出连续值的公式称为回归问题。

对于两类二分类,交叉熵损失最小,而不是平方误差损失,并且网络输出正类的概率而不是输出。 交叉熵损失可以表示为:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-HmQaswLT-1681653992468)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/c0fb9371-3b94-4ffa-9443-f51299bb5cb8.png)]

此处,p[i]是给定输入x的输出类别的预测概率,并且可以表示为输入x的函数。由权重向量参数化,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Z6x7kCN0-1681653992469)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/90eddcaa-84e7-46c8-8b42-d34e3fd7ef91.png)]

通常,对于多类别分类问题(例如n类),交叉熵损失可通过以下方式给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-CHT2Av4g-1681653992469)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/b8e45aea-221b-44e3-bbc3-0d9e88a4cf2d.png)]

在这里,y[i]^(j)是第i个数据点的第j类的输出标签。

神经激活单元

取决于架构和当前的问题,在神经网络中使用了几种神经激活单元。 我们将讨论最常用的激活函数,因为它们在确定网络架构和表现方面起着重要作用。 线性和 Sigmoid 单元激活函数主要用于人工神经网络,直到 Hinton 等人发明的整流线性单元(ReLUs)彻底改变了神经网络的表现。

线性激活单元

线性激活单元将总输入输出到衰减的神经元,如下图所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-w0OzUxtx-1681653992469)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/d1c95a3f-f648-44c6-88be-744da68e0aee.png)]

图 1.5:线性神经元

如果x是线性激活单元的总输入,则输出y可以表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-l3A5Jn0N-1681653992470)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/7db1c93b-6ac7-4b2c-b464-dd69836c6854.png)]

Sigmoid 激活单元

Sigmoid 激活单元,y的输出是其总输入x的函数,表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Bq7DSl5f-1681653992470)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/e72ceed8-eaaa-4d3e-bc39-256e36d389e2.png)]

由于 Sigmoid 激活单元响应是非线性函数,如下图所示,它可用于在神经网络中引入非线性:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-H3o5Suub-1681653992470)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/f54ce333-0cdb-400f-b9d1-22d60475291f.png)]

图 1.6:Sigmoid 激活函数

自然界中任何复杂的过程通常在输入输出关系上都是非线性的,因此,我们需要非线性激活函数通过神经网络对其进行建模。 两类分类的神经网络的输出概率通常由 Sigmoid 神经单元的输出给定,因为它的输出值从零到一。 输出概率可以表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Cg6Zf2uo-1681653992470)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/4e502901-d686-46cf-ba1c-e0b11d2c2707.png)]

在这里,x代表输出层中 Sigmoid 单元的总输入量。

双曲正切激活函数

给出了双曲正切激活函数(tanh)的输出y作为其总输入的函数x如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-ZG9VpHxc-1681653992471)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/ff09283d-c4ae-42d3-8b20-5c6cb9523899.png)]

tanh 激活函数输出的值在[-1, 1]范围内,如下图所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-dktR3vy1-1681653992482)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/58f98f0c-6a81-4acc-bafb-9b0f683ad9c9.png)]

图 1.7:Tanh 激活函数

需要注意的一件事是 Sigmoid 和 tanh 激活函数在很小的输入范围内都是线性的,超过该范围输出就会饱和。 在饱和区,激活函数(相对于输入)的梯度非常小或接近零; 这意味着它们非常容易消失梯度问题。 正如您将在后面看到的那样,神经网络将从反向传播方法中学习,在该方法中,层的梯度取决于后续层中直至最终输出层中激活单元的梯度。 因此,如果激活单元中的单元在饱和区域中工作,则将更少的误差反向传播到神经网络的早期层。 神经网络通过利用梯度来最小化预测误差,以学习权重和偏差(W)。 这意味着,如果梯度很小或消失为零,则神经网络将无法正确学习这些权重。

整流线性单元(ReLU)

当神经元的总输入大于零时,ReLU 的输出为线性,而当神经元的总输入为负时,ReLU 的输出为零。 这个简单的激活函数为神经网络提供了非线性,同时,它相对于总输入提供了一个恒定的梯度。 这个恒定的梯度有助于防止神经网络出现饱和或消失的梯度问题,如激活函数(如 Sigmoid 和 tanh 激活单元)所示。 ReLU 函数输出(如图“图 1.8”所示)可以表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-FPRC1BGK-1681653992482)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/f3c8b630-6ebc-4f71-903a-d192d27621f7.png)]

ReLU 激活函数可以绘制如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-uOmPDWkN-1681653992483)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/56ed1747-01f7-48fa-9a00-db7d1b05a8f9.png)]

图 1.8:ReLU 激活函数

ReLU 的限制条件之一是其输入负值的零梯度。 这可能会减慢训练速度,尤其是在初始阶段。 LReLU 激活函数(如图 1.9 所示)在这种情况下非常有用,即使输出和梯度不为零,即使输入为负值。 ReLU 输出函数泄漏可以表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-S4gi2H4B-1681653992483)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/048015a0-395a-46f0-bf04-524539aea052.png)]

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-uzFolLb7-1681653992483)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/66329819-1528-4067-afc8-bf3e505ecb09.png)]

将为 LReLU 激活函数提供α参数,而对于参数 ReLU,α是神经网络将通过训练学习的参数。 下图显示了 LReLU 激活函数的输出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-RjfbfOa5-1681653992483)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/908a6fec-a34a-4e27-a0a4-27dd3b5d84cc.png)]

图 1.9:LReLU 激活函数

softmax 激活单元

在多类别分类问题的情况下, softmax 激活单元通常用于输出类别概率。 假设我们正在处理n类分类问题,并且与这些类相对应的总输入如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-yu30DXdv-1681653992483)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/1e6529dc-c80f-4914-b540-4a7a23382feb.png)]

在这种情况下,softmax 激活单元的第k类的输出概率由以下公式给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-mcGlA4Kd-1681653992484)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/2c4f3f2d-fb61-4823-bad9-632d16200fe2.png)]

还有其他几种激活函数,大多数是这些基本版本的变体。 我们将在以下各章介绍的不同项目中讨论它们时,对它们进行讨论。

训练神经网络的反向传播方法

在反向传播方法中,神经网络通过梯度下降技术进行训练,其中组合权重向量W迭代更新,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-bmuexJBs-1681653992484)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/80a9c3b5-27aa-462b-a309-dec4fdbf49cb.png)]

这里,η是学习率, W^(t + 1)和W^(t)分别是迭代t + 1和t时的权重向量,∇C(W^(t))是迭代t时的成本函数或误差函数对于权重向量W的梯度。 先前由w ∈ W概括的单个权重或偏差的算法可以表示为:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Xc2rEHFh-1681653992484)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/2a2d7a65-e5d6-4570-8400-3895193259bb.png)]

从前面的表达式中可以得出,梯度下降学习方法的核心在于针对每个权重计算成本函数或误差函数的梯度。

从微分的链式规则中,我们知道如果我们有 y = f(x), z = f(y),那么以下是正确的:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Nrl36B3Q-1681653992484)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/c53a0c79-d20d-4f73-9d61-f2f8e93e8f00.png)]

该表达式可以推广为任意数量的变量。 现在,让我们看一个非常简单的神经网络,如下图所示,以了解反向传播算法:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-EI6rXhcX-1681653992485)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/98bc8f7e-872a-46ef-a018-c9ad01d911f8.png)]

图 1.10:说明反向传播的网络

令网络输入为二维向量, x = [x1, x2]^T, 输出标签和预测分别为 [外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-0kiIoJeW-1681653992485)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/df5f56eb-23da-40f8-900d-1da3eecfb2d3.png)] 和 [外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-aviFHxTN-1681653992485)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/b3cffb09-935e-4bc2-a6d1-330919797695.png)] 。 另外,我们假设神经网络中的所有激活单元都是 Sigmoid。 让广义权重将层l-1中的任何单元i连接到层l中的单元j表示为 [外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-V8aKG1ZB-1681653992485)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/29efb244-a597-41d7-baee-9826abbacd0b.png)] ,而l层中任何单元i的偏置应表示为 [外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Yvhqi7My-1681653992486)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/99d2725a-1b33-4aea-a0b1-7631b21edbc1.png)] 。 让我们得出一个数据点的梯度; 总梯度可以计算为训练(或小批量)中使用的所有数据点的总和。 如果输出是连续的,则可以选择损失函数C作为预测误差的平方:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-qc99igvJ-1681653992486)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/bb6a924b-9414-4008-b7a8-ee6cc0d11649.png)]

可以通过将相对于W向量的成本函数最小化来确定由集合W表示的网络的权重和偏差,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-YFX6SHpO-1681653992486)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/7de557d6-4617-45f4-8e7f-aeb5523343d5.png)]

为了通过梯度下降迭代地执行成本函数的最小化,我们需要针对每个权重计算成本函数的梯度w ∈ W,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-gB7GxHNr-1681653992486)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/c4b40a1e-3fc2-4c2c-b5be-1d20c9b34f17.png)]

现在我们有了所需的一切,让我们计算成本函数C相对于权重 [外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-l5URAIhr-1681653992486)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/8ef28fd7-2ae7-4473-bfcd-9020f9bb8903.png)] 的梯度。 使用差分的链式规则,我们得到以下信息:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-CG1dH99x-1681653992487)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/0b0d48f2-769e-4477-bc38-ba07495015a2.png)]

现在让我们看下面的公式:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-APMV9m59-1681653992487)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/8c25c79b-a37b-455f-95cc-e0501608846b.png)]

正如您在前面的表达式中看到的那样,导数不过是预测中的误差。 通常,在存在回归问题的情况下,输出单元激活函数是线性的,因此适用以下表达式:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-3ws5Qsrs-1681653992487)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/714abd7d-0c22-40db-80f2-bfc0e479ef6a.png)]

因此,如果我们要计算成本函数相对于输出单元总输入的梯度,则为∂C/∂s[1]^(3)。 这仍然等于输出预测中的误差。

根据输入权重和激活,输出单元上的总输入可以表示为:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-MCFBo4Tk-1681653992487)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/153c33ee-f998-4650-be8d-a77f9ef8ffbe.png)]

这意味着∂s[1]^(3)/∂w[21]^(3) = z[2]^(3)以及成本函数相对于权重w[21]^(3)的导数通过以下方式得出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-pAZnpRvL-1681653992487)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/34c1605c-eb43-4d09-b029-b8177ecd1dc6.png)]

如您所见,相对于最终输出层之前的层中的权重,该误差在计算成本函数的梯度时反向传播。 当我们计算成本函数相对于广义权重的梯度w[jk]^(2)时,这变得更加明显。 取对应于j = 1和k = 2的权重; 即w[jk]^(2)。 成本函数C相对于该权重的梯度可以表示为:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-4UL9Pc2c-1681653992488)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/474751ea-71f8-4c57-9d16-1679ed2fbea5.png)]

现在,∂s[2]^(2)/∂w[12]^(2) = z[1]^(2)表示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-h4VpsziP-1681653992488)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/d5f34043-fdeb-48ca-bf1b-d1a1915ba77d.png)]

因此,一旦我们确定了成本函数相对于神经元总输入的梯度为∂C/∂s,则任何权重的梯度w贡献了总输入量s,可以通过简单地乘以与权重相关的激活z来获得。

现在,成本函数相对于总输入的梯度s[2]^(2)可以再次通过链式法则得出,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-84Gyc7zq-1681653992488)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/ff5d7314-4a37-458c-933b-25a883f492bd.png)]

由于神经网络的所有单元(输出单元除外)均为 Sigmoid 激活函数,因此情况如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-PJpkobLk-1681653992488)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/665d5aaa-1fa7-4ab0-a7a8-5961d7faaf77.png)]

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-dQxHDysg-1681653992489)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/b43669e7-d10c-4ad9-bc67-b404ec992de1.png)]

结合(1), (2), (3),我们得到以下信息:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-IxfJEsf0-1681653992489)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/ed1832d2-e65e-4568-8594-f5ded856cfe3.png)]

在前面的派生梯度表达式中,您可以看到预测误差(y_hat - y)通过与相关的激活和权重(根据微分链规则)组合以计算每一层权重的梯度而向后传播 ,因此是 AI 术语中的反向传播名称。

卷积神经网络

卷积神经网络(CNN)利用卷积运算从具有关联拓扑的数据中提取有用信息。 这最适合图像和音频数据。 输入图像在通过卷积层时会生成多个输出图像,称为输出特征映射。 输出特征映射将检测特征。 初始卷积层中的输出特征映射可以学习检测基本特征,例如边缘和颜色成分变化。

第二卷积层可以检测到稍微复杂的特征,例如正方形,圆形和其他几何结构。 随着神经网络的发展,卷积层学会了检测越来越复杂的特征。 例如,如果我们有一个 CNN 可以对图像是猫还是狗进行分类,则神经网络底部的卷积层可能会学会检测诸如头部,腿部等特征。

“图 1.11”显示了 CNN 的架构图,该 CNN 处理猫和狗的图像以对其进行分类。 图像通过卷积层,该卷积层有助于检测相关特征,例如边缘和颜色组合。 ReLU 激活会增加非线性。 激活层之后的合并层汇总本地邻居信息,以提供一定数量的平移不变性。 在理想的 CNN 中,此卷积激活池操作在网络进入密集连接之前执行了几次:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-heHr3WWB-1681653992489)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/332c2f90-aae5-4b98-b417-ce942177e184.png)]

图 1.11:CNN 架构

当我们经过具有多个卷积激活池操作的网络时,图像的空间分辨率会降低,而输出特征映射的数量在每一层中都会增加。 卷积层中的每个输出特征映射都与过滤器核相关联,该过滤器核的权重是通过 CNN 训练过程学习的。

在卷积操作中,将过滤器核的翻转版本放置在整个图像或特征映射上,并为过滤器上每个位置计算过滤器核输入值与相应图像像素或特征映射值的点积。 输入图像或特征映射。 已经习惯了普通图像处理的读者可能已经使用了不同的过滤器核,例如高斯过滤器,Sobel 边缘检测过滤器等,其中许多过滤器的权重已预定义。 卷积神经网络的优点是通过训练过程确定不同的过滤器权重。 这意味着,针对卷积神经网络正在处理的问题,可以更好地定制过滤器。

当卷积运算涉及在输入的每个位置上覆盖过滤器核时,该卷积被称为跨度为 1。 如果我们选择在覆盖过滤器核时跳过一个位置,那么卷积将以两个步幅执行。 通常,如果将n位置跳过而将过滤器核覆盖在输入上,则表示卷积以n + 1的步幅执行。 大于 1 的步幅会减小卷积输出的空间大小。

通常,卷积层之后是池化层,池化层基本上总结了由池化的接收场确定的邻域中的输出特征映射激活。 例如,一个2 x 2的接收场将收集四个相邻的输出特征映射激活的本地信息。 对于最大池操作,将选择四个激活的最大值作为输出,而对于平均池化,将选择四个激活的平均值。 合并降低了特征映射的空间分辨率。 例如,对于具有2 x 2接收场的224 x 224大小的特征映射池化操作,特征映射的空间大小将减小为112 x 112。

要注意的一件事是,卷积运算减少了每层要学习的权重数。 例如,如果我们有一个空间大小为224 x 224的输入图像,而下一层的期望输出为大小为224 x 224的大小,那么对于具有完整连接的传统神经网络来说,要学习的权重数是224 x 224 x 224 x 224。对于具有相同输入和输出大小的卷积层,我们需要学习的只是过滤器核的权重。 因此,如果我们使用3 x 3过滤器核,我们只需要学习 9 个权重即可,而不是224 x 224 x 224 x 224权重。 这种简化是有效的,因为局部空间邻域中的图像和音频之类的结构之间具有高度相关性。

输入图像经过多层卷积和池化操作。 随着网络的发展,特征映射的数量增加,而图像的空间分辨率降低。 在卷积池层的末端,特征映射的输出被馈送到全连接层,然后是输出层。

输出单元取决于手头的任务。 如果执行回归,则输出激活单元是线性的,而如果是二分类问题,则输出单元是 Sigmoid 的。 对于多类别分类,输出层是 softmax 单元。

在本书的所有图像处理项目中,我们都将使用一种或另一种形式的卷积神经网络。

循环神经网络(RNN)

循环神经网络(RNN)在处理顺序或时间数据时非常有用,其中给定实例或位置的数据与先前时间步长或位置中的数据高度相关。 RNN 在处理文本数据方面已经非常成功,因为给定实例中的单词与它前面的单词高度相关。 在 RNN 中,网络在每个时间步执行相同的函数,因此名称中的术语为循环。 下图说明了 RNN 的架构:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-AM4GFnDP-1681653992489)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/0c426b93-140c-48a7-b982-e649cbaac4e3.png)]

图 1.12:RNN 架构

在每个给定的时间步长t处,计算记忆状态h[t],基于步骤t-1处的之前的状态h[t-1],以及时间步长t处的输入x[t]。 新状态h[t]用于在步骤t处预测输出o[t]。 控制 RNN 的方程式如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-GoEDN5yz-1681653992489)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/438f6f9e-0b82-497a-a27a-b6908e54889f.png)]

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Lxi7Xx6U-1681653992490)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/4ce6cd6d-4a3d-4c78-9aa6-364d288f20c7.png)]

如果我们要预测句子中的下一个单词,则函数f[2]通常是词汇表中单词的 softmax 函数。 根据当前问题,f[1]函数可以是任何激活函数。

在 RNN 中,步骤t中的输出误差会尝试纠正先前时间步中的预测,并通过k ∈ 1, 2, ..., t-1来概括。 通过传播先前时间步长中的误差来实现。 这有助于 RNN 了解彼此相距较远的单词之间的长期依赖性。 实际上,由于梯度问题的消失和爆炸,并非总是可能通过 RNN 学习这么长的依赖关系。

如您所知,神经网络通过梯度下降来学习,并且可以通过以下步骤来学习单词在时间步t与在先序列步k之间的关系。 记忆状态h[t]^(i)相对于记忆状态h[i]^(t)的梯度。 用以下公式表示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-bzimxzLw-1681653992490)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/4b851df6-5d8f-4c92-861e-2c0066c19254.png)]

如果从序列步骤k的存储状态h[k]^(i)到序列步骤k + 1的存储状态h[k + 1]^(i)的权重连接由*给出u[ii] ∈ W[hh],则以下是正确的:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-WyXz6D1w-1681653992490)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/94bf384a-86e7-413d-ae16-9b3f5249eef1.png)]

在前面的等式中,s[k + 1]^(i)是在时间步k + 1时存储状态i的总输入,因此情况如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-aYLRtsB1-1681653992490)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/82fd4549-3b28-4289-9145-320579f8f364.png)]

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-FgUnIgYI-1681653992491)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/6034762c-e89b-43a9-823a-588dae6f05fd.png)]

既然我们已经准备就绪,那么就很容易理解为什么 RNN 中可能会出现消失的梯度问题。 从前面的等式(3))和(4)得到以下结果:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Ub9UQ4mh-1681653992491)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/a5818e53-89c6-4a7a-8f79-f71fdfc2535d.png)]

对于 RNN,函数f[2]通常为 Sigmoid 或 tanh,其饱受饱和度的困扰,即具有超出指定输入值范围的低梯度。 现在,由于f[2]的导数彼此相乘,因此,如果激活函数的输入在饱和区工作,则∂h[t]^(i)/∂h[k]^(i)的斜率可以变为零,即使相对tk的中等值。 即使f[2]函数在饱和区中不起作用,但 Sigmoids 的f[2]函数的梯度始终比1小,因此很难学习序列中单词之间的远距离依存关系。 同样,可能会由于u[ii]^(t - k)因子而出现爆炸性梯度问题。 假设步t和k之间的距离约为10,而权重u[ii],大约两点。 在这种情况下,梯度将被放大两倍,即2 ^ 10 = 1024,从而导致爆炸梯度问题。

长短期记忆(LSTM)单元

消失的梯度问题在很大程度上由 RNN 的改进版本(称为长短期记忆(LSTM)单元)解决。 长短期存储单元的架构图如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-KUtKQAcn-1681653992491)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/eab0d93b-3c6d-4fb8-a9ac-d49481457c76.png)]

图 1.13:LSTM 架构

除了记忆状态h[t]之外,LSTM 还介绍了 RNN 单元状态C[t]。 单元状态由三个门控制:遗忘门,更新门和输出门。 遗忘门确定从先前的单元状态C[t-1]保留多少信息,其输出表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Ff2vOGa8-1681653992491)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/00985346-4740-4212-97ff-0506b23e7d21.png)]

更新门的输出表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-F8QssJ8b-1681653992492)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/16cfb5c1-3e84-497e-8725-fc5c0e571a30.png)]

潜在的新候选单元状态C_tilde[t]表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-kr3grJGt-1681653992492)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/d10b017e-3e19-4c63-8ece-90ca7b3d2dfe.png)]

基于先前的电池状态和当前的潜在电池状态,通过以下方式提供更新的电池状态输出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Fru6Aby0-1681653992492)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/e4d692b3-3335-41cb-a793-1d6504dda376.png)]

并非单元状态的所有信息都传递到下一步,并且应由输出门确定应释放多少单元状态到下一步。 输出门的输出通过以下方式给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-ZTgakVbP-1681653992492)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/959381ee-2245-42ab-92a9-fd26d61d3756.png)]

根据当前单元状态和输出门,通过以下方式给出传递给下一步的更新后的内存状态:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-xxAdrkW8-1681653992492)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/55a8e2c1-d673-4016-b4f2-a2baf36f73ed.png)]

现在出现了一个大问题:LSTM 如何避免消失的梯度问题? LSTM 中∂h[t]^(i)/∂h[k]^(i)的等效项由∂C[t]^(i)/∂C[k]^(i)给出,可以用以下产品形式表示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-0ZfZ735y-1681653992493)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/0467935c-2261-4019-86e5-d5cb976fdcfb.png)]

现在,单元状态单元的循环由以下给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-AJTm0B03-1681653992493)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/eb7d80c6-f2eb-44c2-8272-555b5611da6d.png)]

由此,我们得到以下内容:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-xPcQopsH-1681653992493)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/636e59ba-65ee-410a-8dce-c19ce20565c6.png)]

结果,梯度表达式∂C[t]^(i)/∂C[k]^(i)变为以下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-0hjN3MvM-1681653992493)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/78f1eac4-0f48-4f0f-8521-344d3a317e9d.png)]

如您所见,如果我们可以将遗忘单元格状态保持在一个附近,则梯度将几乎不衰减地流动,并且 LSTM 不会遭受梯度消失的困扰。

我们将在本书中看到的大多数文本处理应用将使用 RSTM 的 LSTM 版本。

生成对抗网络

生成对抗网络,通常称为 GAN ,是通过生成器G学习特定概率分布的生成模型。 生成器G与判别器D进行零和极小极大游戏,并且两者都会随着时间的流逝而逐渐达到纳什均衡。 生成器尝试生成类似于给定概率分布P(x)生成的样本,而判别器D尝试区分生成器生成的那些假数据样本。G来自原始分布的数据样本。 生成器G尝试通过转换样本z来生成与P(x)相似的样本。 噪声分布P(z)。 判别器D在假冒时学会将生成器G生成的样本标记为G(z);x原始时属于P(x)。 在 minimax 游戏的平衡状态下,生成器将学习生成与原始分布P(x)相似的样本,因此以下是正确的:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-lnVDmihC-1681653992494)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/0bb90a7f-37ac-4079-8896-baa81ed7b81d.png)]

下图说明了学习 MNIST 数字的概率分布的 GAN 网络:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-NrXcumpk-1681653992494)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/c8c7095f-4435-4ed0-a46b-3b89ed954f90.png)]

Figure 1.14: GAN architecture

判别器最小化的成本函数是二进制交叉熵,用于区分生成器生成的假数据,和属于概率分布P(x)的真实数据点z:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Z1PCNgah-1681653992494)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/b9cb9aa1-7eac-4174-983d-cb5be41b1eff.png)]

生成器将尝试最大化由(1)给出的相同成本函数。 这意味着,优化问题可以表示为具有效用函数 U(G, D)的 minimax 玩家,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Eb2q4UoS-1681653992494)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/56db8673-21ba-456d-94a5-f78f8d33506b.png)]

通常,要测量给定概率分布与给定分布的匹配程度,请使用f-发散度量,例如 Kullback-Leibler(KL)散度,詹森·香农散度和 Bhattacharyya 距离。 例如,以下给出两个概率分布P和Q之间的 KL 散度,其中对分布的期望是P:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-FJEiF1UR-1681653992494)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/a28bf1ff-ec23-480a-9740-060b00b8ab64.png)]

类似地,P和Q之间的詹森香农散度给出如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-zjWhhkTr-1681653992495)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/17bdf041-b5b0-442c-aea2-d56561c1f54e.png)]

现在,回到(2),表达式可以编写如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-LQcVg71T-1681653992495)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/0c60cfa5-eb0a-4114-aa84-beab07d5a6cc.png)]

在这里,G(x)是生成器的概率分布。 将期望扩展到其不可或缺的形式,我们得到以下内容:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-B7w8bhJD-1681653992495)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/f5932e0c-dc8c-4041-abe9-24e33bcfc95f.png)]

对于固定的生成器分配,如果满足以下条件,则G(x)对于判别器的效用函数将最小。

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-YjWXgDBr-1681653992495)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/ec1949f8-e469-4633-9aaf-d857c5f0831c.png)]

用(5)替换为(3)中的D(x),我们得到以下信息:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-ZAT085Jx-1681653992495)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/9dd0ea39-6a35-49d3-aa07-47e8242fd453.png)]

现在,生成器的任务是最大化工具V(G, D_hat)或最小化工具-V(G, D_hat)。 -V(G, D_hat)的表达式可以重新安排如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-lStPBxdx-1681653992496)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/2e348883-3d4b-421d-940e-8c0c8a593af0.png)]

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-kBbNXj8H-1681653992496)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/63acc434-0231-447f-a331-5afab842bd9a.png)]

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-EU1QRmtA-1681653992496)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/8893fadf-3fbf-4c42-bb8d-7a27f14dcb76.png)]

因此,我们可以看到生成器最小化-V(G, D_hat)等于最小化实际分布P(x)与生成器生成的样本分布之间的 Jensen Shannon 散度G(即G(x))。

训练 GAN 并不是一个简单的过程,在训练这样的网络时我们需要考虑几个技术方面的考虑。 我们将使用高级 GAN 网络在第 4 章“使用 GANs 的时装行业中的风格迁移”中构建跨域风格迁移应用。

强化学习

强化学习是机器学习的一个分支,它使机器和/或智能体可以通过采取特定行动在特定上下文中最大化某种形式的奖励。 强化学习不同于监督学习和无监督学习。 强化学习广泛用于博弈论,控制系统,机器人技术和其他新兴的人工智能领域。 下图说明了强化学习问题中智能体与环境之间的交互:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-W9NI3aWx-1681653992496)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/13aa6565-1619-42b6-a595-a2bf486f0a6e.png)]

图 1.15:强化学习模型中的智能体与环境交互

Q 学习

现在,我们将研究一种流行的强化学习算法,称为 Q 学习。 Q 学习用于确定给定的有限马尔可夫决策过程的最佳动作选择策略。 马尔可夫决策过程由状态空间S; 一个动作空间A; 立即奖励集R; 给定当前状态s[t]的下一个状态的概率S[t + 1]; 当前动作a[t]; P(S[t+1]/S[t];r[t]); 和折扣系数γ定义。 下图说明了马尔可夫决策过程,其中下一个状态取决于当前状态以及在当前状态下执行的任何操作:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-dsO4giP1-1681653992497)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/83330458-c0b9-4660-a1e3-6cd4927244a6.png)]

图 1.16:马尔可夫决策过程

假设我们有一系列状态,动作和相应的奖励,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-HmnmBxhv-1681653992497)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/3c565184-9ac9-488b-8caa-6136105ef059.png)]

如果我们考虑长期奖励R[t],则在步骤t处,它等于从t开始的每一步直到最后的立即奖励总和,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-XliTxXRi-1681653992497)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/94a7a7da-3528-4fb2-9e42-1af592e0c024.png)]

现在,马尔可夫决策过程是一个随机过程,无法每次基于S[t]和a[t]进行相同的下一步S[t + 1]; 因此,我们对未来的奖励应用了折扣系数γ。 这意味着长期奖励可以更好地表示为:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-QX2NRjRy-1681653992498)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/4a4b48fe-0a74-4d0f-92ad-bad7fdc7fb35.png)]

由于在时间步t上已经实现了即时奖励,为了最大化长期奖励,我们需要最大化时间步t + 1的长期奖励(即R[t + 1]),方法是选择最佳操作。 通过采取行动a[t]的状态S[t]所期望的最大长期回报,由以下 Q 函数表示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-uGpvkR0X-1681653992498)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/b3ecdb7c-d4cf-48a2-af93-c969b62fb41e.png)]

在每个状态s ∈ S,Q 学习中的主体尝试采取行动α ∈ A,以最大化其长期回报。 Q 学习算法是一个迭代过程,其更新规则如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-0sjIfFQw-1681653992498)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/b6e4a367-e0aa-406d-bd8b-5e1b2cb8c1d7.png)]

如您所见,该算法受(1)中表达的长期奖励概念的启发。

处于状态s[t]的采取行动a[t]的总累积奖励Q(s[t], a[t])取决于即时奖励r[t]以及在新步骤s[t+1]处的,我们希望的最大长期回报。 在马尔可夫决策过程中,新状态s[t + 1]随机依赖于当前状态,即s[t],然后通过P(S[t+1]/S[t];r[t])形式的概率密度/质量函数选取的动作a[t]。

该算法通过根据α的值对旧期望值和新长期奖励值进行加权平均,来不断更新期望长期累积奖励。

通过迭代算法构建了Q(s, a)函数后,在基于给定状态s进行游戏时,我们可以采取最佳措施a_hat, 作为最大化 Q 函数的策略:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-B5LfNIjr-1681653992498)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/88e6ee5c-d64d-4d70-a9cf-ee3eb0e6c32a.png)]

深度 Q 学习

在 Q 学习中,我们通常会处理一组有限的状态和动作。 这意味着,表格足以容纳 Q 值和奖励。 但是,在实际应用中,状态和适用动作的数量大多是无限的,并且需要更好的 Q 函数近似器来表示和学习 Q 函数。 深度神经网络是通用函数近似器,因此在这里就应运而生。 我们可以用神经网络表示 Q 函数,该神经网络将状态和动作作为输入并提供相应的 Q 值作为输出。 或者,我们可以只使用状态来训练神经网络,然后将输出作为与所有动作相对应的 Q 值。 下图说明了这两种情况。 由于 Q 值是奖励,因此我们在以下网络中处理回归:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-oD6OIG5e-1681653992499)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/673b706b-7aa2-488e-851d-860dffe3abfb.png)]

图 1.17:深度 Q 学习函数近似器网络

在本书中,我们将使用强化学习来训练赛车,以通过深度 Q 学习自行驾驶。

迁移学习

通常,迁移学习是指使用在一个领域中获得的知识来解决另一领域中的相关问题的概念。 但是,在深度学习中,它专门指的是将针对特定任务训练的神经网络重新用于不同领域中的相似任务的过程。 新任务使用从先前任务中学到的特征检测器,因此我们不必训练模型就可以学习它们。

由于不同层之间的连接模式的性质,深度学习模型倾向于具有大量参数。 要训练这么大的模型,需要大量的数据; 否则,模型可能会过拟合。 对于许多需要深度学习解决方案的问题,将无法获得大量数据。 例如,在用于对象识别的图像处理中,深度学习模型提供了最新的解决方案。 在这种情况下,可以基于从现有的经过训练的深度学习模型中学习到的特征检测器,使用迁移学习来创建特征。 然后,这些特征可用于使用可用数据构建简单模型,以解决当前的新问题。 因此,新模型需要学习的唯一参数是与构建简单模型有关的参数,从而减少了过拟合的机会。 通常在大量数据上训练预训练的模型,因此,它们具有作为特征检测器的可靠参数。

当我们在 CNN 中处理图像时,初始层会学会检测非常通用的特征,例如卷曲,边缘,颜色组成等。 随着网络的深入发展,更深层次的卷积层将学会检测与特定种类的数据集相关的更复杂特征。 我们可以使用预训练的网络,并选择不训练前几层,因为它们会学习非常通用的函数。 相反,我们可以只专注于训练最后几层的参数,因为它们将学习针对当前问题的复杂函数。 这样可以确保我们需要训练的参数较少,并且可以明智地使用数据,仅训练所需的复杂参数,而不训练通用特征。

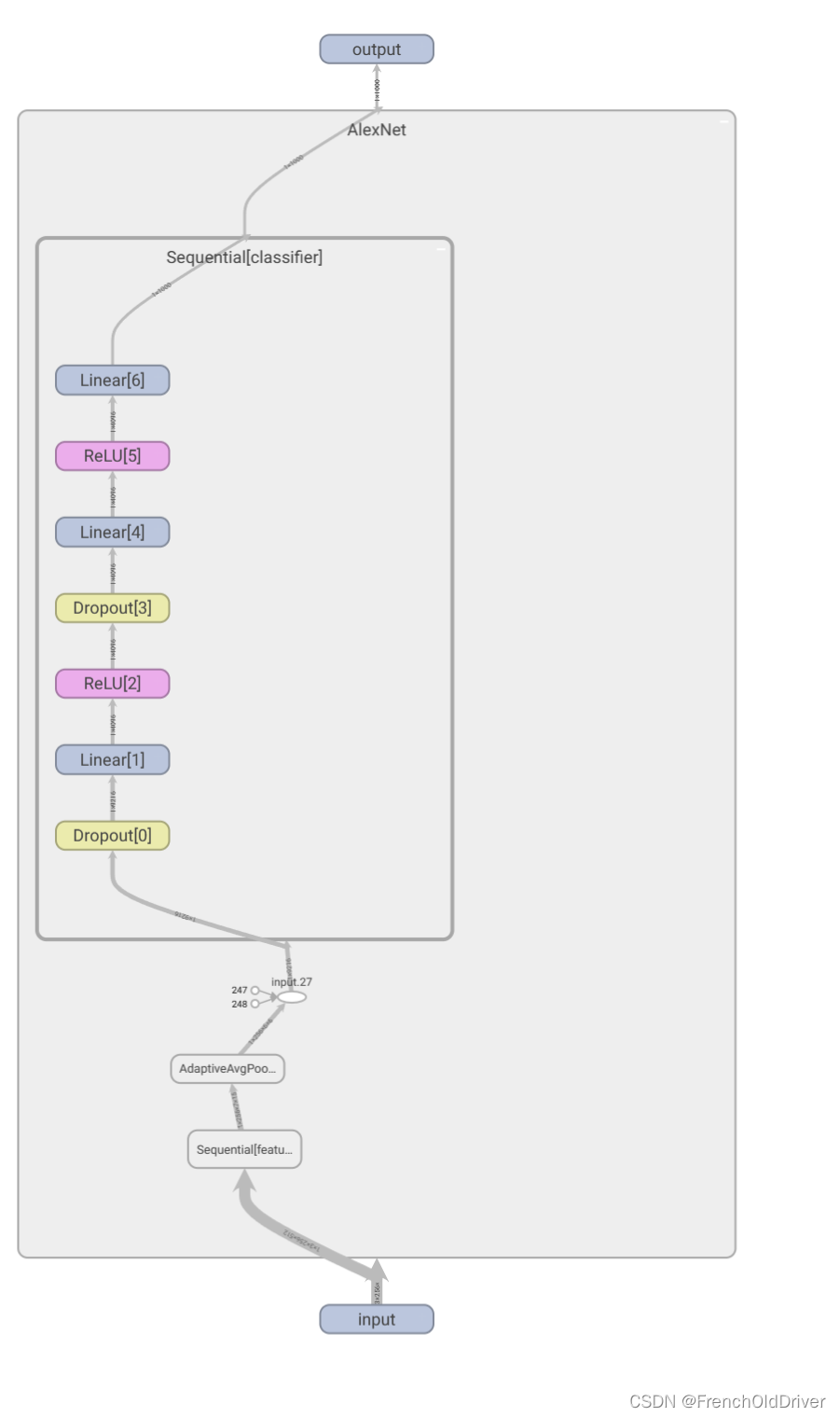

迁移学习已广泛应用于通过 CNN 进行图像处理的过程,其中过滤器充当特征检测器。 用于迁移学习的最常见的预训练 CNN 是AlexNet,VGG16,VGG19,Inception V3和ResNet等。 下图说明了用于迁移学习的预训练VGG16网络:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-g0Sdz8Wj-1681653992499)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/04ca3848-86ab-45e6-81f2-1c1d1011ef88.png)]

图 1.18:使用预训练的 VGG 16 网络进行迁移学习

以x表示的输入图像被馈送到预训练的 VGG 16 网络,以及4096维输出特征向量x',是从最后一个全连接层中提取的。 提取的特征x'以及相应的类别标签y用于训练简单的分类网络,从而减少解决问题所需的数据。

我们将通过使用第 2 章,“迁移学习”中的迁移学习来解决医疗保健领域中的图像分类问题。

受限玻尔兹曼机

受限玻尔兹曼机(RBM)是一门无监督的机器学习算法,用于学习数据的内部表示。 RBM 具有可见层v ∈ R^m,以及隐藏层h ∈ R^n。 RBM 学习在可见层中将输入呈现为隐藏层中的低维表示。 给定可见层输入,所有隐藏层单元在条件上都是独立的。 类似地,给定隐藏层输入,所有可见层在条件上都是独立的。 给定隐藏层输入,这使得 RBM 可以独立地对可见单元的输出进行采样,反之亦然。

下图说明了 RBM 的架构:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-RhhZCbR1-1681653992499)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/0c7517cc-ffec-4988-956f-e2258a4c314d.png)]

图 1.19:受限玻尔兹曼机

权重w[ij] ∈ W将可见单元i连接到隐藏单元j,其中W ∈ R^(mxn)是所有这些权重的集合,从可见单元到隐藏单元。 可见单元的偏差由b[i] ∈ b表示,而隐藏单元的偏差由c[j] ∈ c表示。

受统计物理学中玻耳兹曼分布的思想启发,可见层向量v和隐藏层向量h的联合分布正比于配置的负能量的指数:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-1pQSgnK4-1681653992499)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/1aea1d38-4ac6-4663-b3a2-31b6849a03a0.png)](1)

配置的能量由以下给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-FldV2zZc-1681653992500)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/e92fb4ee-090a-4067-b628-b1f0dcf9eac0.png)](2)

给定可见输入向量v的隐藏单元j的概率可以表示为:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-z30lC2kF-1681653992500)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/7e50218c-8aa9-4d4b-8d38-761ba1efb7ff.png)](2)

类似地,给出隐藏输入向量h的可见单元i的概率由以下公式给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-AbpDiiex-1681653992500)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/7bab8697-ec6f-46d1-8e2f-9ec1cf2bf5cc.png)](3)

因此,一旦我们通过训练了解了 RBM 的权重和偏差,就可以在给定隐藏状态的情况下对可见表示进行采样,而在给定可见状态的情况下可以对隐藏状态进行采样。

类似于主成分分析(PCA),RBM 是一种方法,将一个维度(由可见层v提供)中的数据表示为不同的维度(由隐藏层h提供)。 当隐藏层的大小小于可见层的大小时,RBM 执行减小大小的任务。 RBM 通常在二进制数据上训练。

通过最大化训练数据的可能性来训练 RBM。 在成本函数相对于权重和偏差的梯度下降的每次迭代中,都会出现采样,这会使训练过程变得昂贵并且在计算上有些棘手。 一种名为对比发散的聪明采样方法(使用吉布斯采样)用于训练 RBM。

在第 6 章,“智能推荐系统”中,我们将使用 RBM 构建推荐系统。

自编码器

与 RBM 十分相似,自编码器是一类无监督的学习算法,旨在发现数据中的隐藏结构。 在主成分分析(PCA)中,我们尝试捕获输入变量之间的线性关系,并尝试通过(输入变量的)线性组合来在降维空间中表示数据,这说明了数据的大部分差异。 但是,PCA 无法捕获输入变量之间的非线性关系。

自编码器是一种神经网络,可以捕获输入变量之间的非线性相互作用,同时在隐藏层中以不同维度表示输入。 在大多数情况下,隐藏层的大小小于输入的大小。 假设存在高维数据固有的低维结构,我们跳过了这一点。 例如,高维图像可以由低维流形表示,并且自编码器通常用于发现该结构。 下图说明了自编码器的神经架构:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Xf0sw8RB-1681653992500)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/594d3d11-05f5-4367-a760-726135cf225b.png)]

图 1.20:自编码器架构

自编码器有两个部分:编码器和解码器。 编码器尝试将输入数据x投影到隐藏层h中。 解码器尝试从隐藏层h重构输入。 通过最小化重构误差,即来自解码器和原始输入的重构输入x_tilde之间的误差,可以训练伴随此类网络的权重。 如果输入是连续的,则最小化重构误差的平方和,以学习自编码器的权重。

如果我们用函数f[W](x)表示编码器,而解码器则用f[U](x)表示,其中W和U是与编码器和解码器关联的权重矩阵,那么情况如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Q5Z9O7hu-1681653992500)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/40f56474-8d03-49d3-9567-3a30fce2337b.png)](1)

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-bZCXnQuW-1681653992501)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/7e6dae4f-91dc-43af-a351-d93afff1ecd7.png)](2)

训练集上的重构误差C,x[i], i ∈ 1, 2, 3, ..., m可以表示如下 :

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-8dl0bT6y-1681653992501)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/5ecc227c-e830-4604-898b-f08d92be4d0a.png)](3)

通过最小化(3)的成本函数,可以学习自编码器的最佳权重W_hat, U_hat,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-WfR1FzyM-1681653992501)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/1a645659-bc76-482d-9d08-7c790e29013e.png)](4)

自编码器用于多种目的,例如学习数据的潜在表示,降噪和特征检测。 降噪自编码器将实际输入的噪声版本作为其输入。 他们尝试构建实际的输入,以作为重建的标签。 类似地,自编码器可以用作生成模型。 可以用作生成模型的一类这样的自编码器称为变分自编码器。 当前,变分自编码器和 GAN 作为图像处理的生成模型非常受欢迎。

总结

现在,我们到了本章的结尾。 我们已经研究了人工神经网络的几种变体,包括用于图像处理目的的 CNN 和用于自然语言处理目的的 RNN。 此外,我们将 RBM 和 GAN 视为生成模型,将自编码器视为无监督方法,可以解决许多问题,例如降噪或解密数据的内部结构。 此外,我们还谈到了强化学习,这对机器人技术和 AI 产生了重大影响。

您现在应该熟悉本书其余各章中构建智能 AI 应用时将要使用的核心技术。 在构建应用时,我们将在需要时进行一些技术上的改动。 建议不熟悉深度学习的读者探索更多有关本章涉及的核心技术的信息,以便更全面地理解。

在随后的章节中,我们将讨论实用的 AI 项目,并使用本章中讨论的技术来实现它们。 在第 2 章,“迁移学习”中,我们将从使用迁移学习实现医疗保健应用进行医学图像分析开始。 我们希望您期待您的参与。

二、迁移学习

迁移学习是将特定领域中一项任务中获得的知识迁移到相似领域中相关任务中的过程。 在深度学习范例中,迁移学习通常是指将预训练模型的重用作为另一个问题的起点。 计算机视觉和自然语言处理中的问题需要大量数据和计算资源,才能训练出有意义的深度学习模型。 迁移学习在视觉和文本领域已变得非常重要,因为它减轻了对大量训练数据和训练时间的需求。 在本章中,我们将使用迁移学习来解决医疗保健问题。

我们将在本章中涉及的与迁移学习有关的一些关键主题如下:

- 使用迁移学习来检测人眼中的糖尿病性视网膜病变状况,并确定视网膜病变的严重程度

- 探索可用于训练可检测人眼眼底图像中的糖尿病性视网膜病变的卷积神经网络(CNN)的高级预训练卷积神经架构

- 查看实际实现 CNN 所需的不同图像预处理步骤

- 学习制定适合当前问题的成本函数

- 定义适当的度量标准来衡量训练模型的表现

- 使用仿射变换生成其他数据

- 与适当的学习率,优化器的选择等有关的训练错综复杂

- 查看端到端 Python 实现

技术要求

您将需要具备 Python 3,TensorFlow,Keras 和 OpenCV 的基础知识。

本章的代码文件可以在 GitHub 上找到

观看以下视频,查看运行中的代码。

迁移学习简介

在传统的机器学习范例中(请参见“图 2.1”),每个用例或任务都是根据手头的数据独立建模的。 在迁移学习中,我们使用从特定任务中获得的知识(以架构和模型参数的形式)来解决不同(但相关)的任务,如下图所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-64XnqN9d-1681653992501)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/07387bba-04ab-4758-9ac4-8740ea2f1bea.png)]

图 2.1:传统机器学习与迁移学习

吴安德(Andrew Ng)在其 2016 年 NIPS 教程中表示,迁移学习将成为机器学习商业成功的第二大推动力(在监督学习之后); 这一说法日新月异。 迁移学习现已广泛用于需要使用人工神经网络解决的问题中。 因此,最大的问题是为什么会这样。

从头开始训练人工神经网络是一项艰巨的任务,主要是由于以下两个原因:

- 人工神经网络的成本面是非凸的; 因此,它需要一组良好的初始权重才能实现合理的收敛。

- 人工神经网络具有很多参数,因此,它们需要大量数据进行训练。 不幸的是,对于许多项目而言,可用于训练神经网络的特定数据不足,而该项目旨在解决的问题非常复杂,需要神经网络解决方案。

在这两种情况下,迁移学习都可以解决。 如果我们使用在大量标记数据上训练的预训练模型,例如 ImageNet 或 CIFAR,则涉及迁移学习的问题将具有很好的初始权重来开始训练; 然后可以根据现有数据对这些权重进行微调。 同样,为了避免在较少的数据量上训练复杂的模型,我们可能希望从预训练的神经网络中提取复杂的特征,然后使用这些特征来训练相对简单的模型,例如 SVM 或逻辑回归模型。 举个例子,如果我们正在研究图像分类问题,并且已经有一个预训练的模型(例如,基于 1,000 个 ImageNet 的VGG16网络),我们可以通过VGG16的权重迁移训练数据,并从最后一个池化层提取特征。 如果我们有m个训练数据点,则可以使用等式(xi, yi), i = 1 -> m,其中x是特征向量,y是输出类。 然后,我们可以从预训练的VGG16网络中得出复杂的特征,例如向量h,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Xxt36aFH-1681653992502)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/bb55e155-7677-4ae6-8bf9-9998e72422ab.png)]

此处W是经过预训练的VGG16网络的权重集,直到最后一个池化层。

然后我们可以使用经过转换的训练数据点集(hi, yi), i = 1 -> m来构建相对简单的模型。

检测糖尿病性视网膜病变的迁移学习

在本章中,我们将使用迁移学习来构建一个模型,以检测人眼中的糖尿病性视网膜病变。 糖尿病性视网膜病通常在糖尿病患者中发现,其中高血糖水平导致视网膜血管的损害。 下图左侧为正常视网膜,右侧为糖尿病性视网膜病变:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-AbF3opW5-1681653992502)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/01145ccc-ee1f-48be-8662-d9fcd40381a7.png)]

图 2.2:正常人视网膜与患有糖尿病性视网膜病的视网膜

在医疗保健中,糖尿病性视网膜病变的检测通常是一个手动过程,需要受过训练的医师检查彩色眼底视网膜图像。 这导致诊断过程的延迟,通常导致延迟的治疗。 作为我们项目的一部分,我们将建立一个强大的人工智能系统,该系统可以拍摄视网膜的彩色眼底图像,并对糖尿病性视网膜病变的视网膜状况进行严重性分类。 我们将视网膜图像分类的不同条件如下:

*0:无糖尿病性视网膜病变

*1:轻度糖尿病性视网膜病变

*2:中度糖尿病性视网膜病变

*3:严重的糖尿病视网膜病变

*4:糖尿病性视网膜增生病

糖尿病视网膜病变数据集

用于构建糖尿病性视网膜病变检测应用的数据集可从 Kaggle 获得,可从以下链接下载。

训练和保留测试数据集都存在于train_dataset.zip文件中,该文件可在前面的链接中找到。

我们将使用标记的训练数据通过交叉验证来构建模型。 我们将在保持数据集上评估模型。

由于我们正在处理类别预测,因此准确率将是有用的验证指标。 精度定义如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-CYPF3RnS-1681653992502)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/654757ad-de20-47fc-9b3f-a320446f607c.png)]

此处,c是正确分类的样本数,N是评估样本的总数。

与 Kaggle 标准相比,我们还将使用二次加权 kappa 统计信息确定模型的质量,并确定模型的表现基准。 二次加权 kappa 定义如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-YssPrdil-1681653992502)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/54dadcbf-9122-4ff6-89f4-a98ca577f4b8.png)]

二次加权 kappa 表达式中的权重w[ij]如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-wjLwPn5l-1681653992502)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/e9f8f87c-4ebe-4065-8787-997893e22c33.png)]

在上式中,以下内容适用:

N代表类别数O[ij]表示已被预测为i类的图像数量,其中图像的预测类为i而实际类别为jE[ij]表示预测类别为i的预期观测个数,预测类为i而实际类别为j,假设预测类和实际类是独立的

为了更好地了解 kappa 指标组件,让我们看一下苹果和橘子的二分类。 假设预测类和实际类的混淆矩阵如下图所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-r9EpNA9X-1681653992503)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/0c2ae574-b0cc-4cc5-8dc7-51ddcce904f8.png)]

图 2.3:Kappa 指标项

真实标签为橙子,假设标签之间具有独立性时,预测苹果的预期计数由以下公式给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-ebWWURHy-1681653992503)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/81cdd503-0856-413d-806e-2d844b0dae16.png)] [外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-vNIYnuT4-1681653992503)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/01ae53b3-037d-4047-a4fe-b41a148af503.png)] [外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-NHmHEOP4-1681653992503)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/be17d2d1-dd00-4ba9-9165-571866d133b2.png)]

鉴于没有模型,此预期计数是您可能犯的最严重的错误。

如果您熟悉两个类别变量之间的独立性卡方检验,则假设类别变量之间具有独立性,则列联表中每个单元格中的预期计数都是基于相同的公式计算的。

可以从混淆矩阵中直接追踪模型的观测计数,该模型预测的真实标签为橙子时,预测的苹果等于5,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-jbKJzY9S-1681653992503)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/f6d73ecf-a072-4064-9b92-8e880c0080e6.png)]

因此,我们可以看到模型在预测橙子为苹果时所产生的误差小于我们不使用模型时所获得的误差。 与没有模型的预测相比,Kappa 通常衡量我们的表现如何。

如果我们观察二次权重的表达式w[ij],我们可以看到,当实际标签与预测标签之间的差异较大时,权重的值会更大。 由于类的序数性质,这是有道理的。 例如,让我们用类别标签 0 表示完美状态的眼睛; 患有轻度糖尿病性视网膜病的患者; 中度糖尿病视网膜病变伴两个; 并伴有严重的糖尿病性视网膜病变。 当轻度糖尿病性视网膜病被错误地分类为严重糖尿病性视网膜病而不是中度糖尿病性视网膜病时,这个二次项权重w[ij]将会更高。 这是有道理的,因为即使我们没有设法预测实际类别,我们也希望预测一个尽可能接近实际状况的状况。

我们将使用sklearn.metrics.cohen_kappa_score和weights= "quadratic"来计算 kappa 得分。 权重越高,kappa 得分越低。

定义损失函数

该用例的数据分为五类,分别与无糖尿病性视网膜病变,轻度糖尿病性视网膜病变,中度糖尿病性视网膜病变,严重糖尿病性视网膜病变和增生性糖尿病性视网膜病变有关。 因此,我们可以将其视为分类问题。 对于我们的分类问题,需要对输出标签进行一次热编码,如下所示:

- 无糖尿病性视网膜病变:

[1 0 0 0 0]^T - 轻度糖尿病性视网膜病变:

[0 1 0 0 0]^T - 中度糖尿病性视网膜病变:

[0 0 1 0 0]^T - 严重糖尿病性视网膜病变:

[0 0 0 1 0]^T - 增生糖尿病性视网膜病变:

[0 0 0 0 1]^T

Softmax 将是表示输出层中不同类别的概率的最佳激活函数,而每个数据点的分类交叉熵损失之和将是优化的最佳损失。 对于具有输出标签向量y和p的预测概率的单个数据点,交叉熵损失由以下公式给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-vaGBbUxv-1681653992504)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/8058232c-897d-4cec-9a2d-768e01646985.png)]

这里是y = [y1, ..., y5]^T和p = [p1, ..., p5]^T。

同样,M训练数据点上的平均损失可以表示为:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-2EnyCsTA-1681653992504)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/79a945ed-f72e-486f-9b76-d6a9a3ec21f2.png)]

在训练过程中,小批量的梯度基于(2)给出的平均对数损失,其中M是所选的批量大小。 对于我们将结合验证准确率进行监视的验证日志损失,M是验证集数据点的数量。 由于我们将在每个折叠中进行 K 折交叉验证,因此在每个折叠中我们将具有不同的验证数据集。

现在我们已经定义了训练方法,损失函数和验证指标,让我们继续进行数据探索和建模。

请注意,输出类别中的分类具有序数性质,因为严重性随类别而增加。 因此,回归可能会派上用场。 我们还将尝试通过回归来代替分类,以了解运气如何。 回归的挑战之一是将原始分数转换为类。 我们将使用一个简单的方案,将分数散列到最接近的整数严重性类别。

考虑类别失衡

在分类方面,类别失衡是一个主要问题。 下图描述了五个严重性类别的类别密度:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-pRsVpACt-1681653992504)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/5969eeb1-ca28-4fbb-b96c-12d2f4088362.png)]

图 2.4:五个严重性类别的类别密度

从上图可以看出,将近 73% 的训练数据属于 0 类,这代表没有糖尿病性视网膜病。 因此,如果我们碰巧将所有数据点标记为 0 类,那么我们将具有 73% 的准确率。 在患者健康状况下这是不希望的。 我们宁愿有一个测试说患者没有时有某种健康状况(假阳性),而有一项测试却漏诊时没有发现某种健康状况(假阴性)。 如果模型学会将所有点分类为属于 0 类,则 73% 的准确率可能毫无意义。

在严重性类别 0 上,检测较高的严重性类别比做好工作更为重要。 使用对数损失或交叉熵成本函数的分类模型的问题在于它偏爱多数类。 这是因为交叉熵误差是从最大似然原理中得出的,该似然原理倾向于将较高的概率分配给多数类别。 我们可以做两件事:

- 丢弃具有更多样本的类别中的数据,或者丢弃低频类别的上样本,以保持样本在各个类别之间的分布均匀。

- 在损失函数中,权重与类别的密度成反比。 这将确保当模型无法对低频类别进行分类时,对成本函数施加更高的惩罚。

我们将使用方案二,因为它不需要生成更多数据或丢弃现有数据。 如果我们将类别权重与类别频率的倒数成正比,则会得到以下类别权重:

| 严重类别 | 类权重 |

|---|---|

Class 0 | 0.0120353863 |

Class 1 | 0.1271350558 |

Class 2 | 0.0586961973 |

Class 3 | 0.3640234214 |

Class 4 | 0.4381974727 |

我们将在训练分类网络时使用这些权重。

预处理图像

不同类别的图像将存储在不同的文件夹中,因此可以轻松标记其类别。 我们将使用Opencv函数读取图像,并将其调整为不同的大小,例如224 x 224 x3。我们将基于 ImageNet 数据集从每个图像的通道方向上减去平均像素强度。 这意味着减法将使糖尿病性视网膜病变图像达到与在其上训练了预训练模型的处理过的 ImageNet 图像相同的强度范围。 提出每个图像后,它们将存储在numpy数组中。 图像预处理函数可以定义如下:

def get_im_cv2(path,dim=224):img = cv2.imread(path)resized = cv2.resize(img, (dim,dim), cv2.INTER_LINEAR)return resizeddef pre_process(img):img[:,:,0] = img[:,:,0] - 103.939img[:,:,1] = img[:,:,0] - 116.779img[:,:,2] = img[:,:,0] - 123.68return img通过opencv函数imread读取图像,然后使用线性插值方法将其调整为(224,224,3)或任何给定大小。 ImageNet 图像的红色,绿色和蓝色通道中的平均像素强度分别为103.939,116.779和123.68; 从图像中减去这些平均值之后,对预训练模型进行训练。 均值减法的这种活动用于使数据居中。 将数据定为零附近有助于解决消失和爆炸的梯度问题,进而帮助模型收敛更快。 同样,对每个通道进行归一化有助于保持梯度均匀地流入每个通道。 由于我们将为此项目使用预训练的模型,因此在将图像馈入预训练的网络之前,有必要根据通道平均像素值校正图像。 但是,并非必须要根据预训练网络所基于的 ImageNet 的平均值来校正图像。 您可以通过该项目的训练语料库的平均像素强度很好地进行归一化。

同样,您可以选择对整个图像进行均值归一化,而不是对通道进行均值归一化。 这需要从自身中减去每个图像的平均值。 想象一下 CNN 识别的对象在不同的光照条件下(例如白天和晚上)曝光的场景。 无论光照条件如何,我们都希望对物体进行正确的分类,但是不同的像素强度将以不同方式激活神经网络的神经元,从而导致错误分类物体的可能性。 但是,如果我们从自身中减去每个图像的平均值,则对象将不再受到不同光照条件的影响。 因此,根据我们使用的图像的性质,我们可以为自己选择最佳的图像标准化方案。 但是,任何默认的标准化方法都倾向于提供合理的表现。

使用仿射变换生成其他数据

我们将在图像像素坐标上使用仿射变换,使用 keras ImageDataGenerator生成其他数据。 我们将主要使用的转换是旋转,平移和缩放。 如果像素空间坐标由x = [x[1] x[2]]^T ∈ R^2定义 ,则像素的新坐标可以通过以下方式给出:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-eA1GAfKp-1681653992504)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/48a4bf27-bee5-46b1-8b5b-9fe1f96d8a52.png)]

这里, M = R^(2x2)是仿射变换矩阵, b = [b[1], b[2]]^T ∈ R^2是翻译向量。

项b[1]指定沿一个空间方向的翻译,而b[2]提供沿另一空间维度的翻译。

这些转换是必需的,因为神经网络通常不是平移不变,旋转不变或尺度不变。 合并操作确实提供了一些平移不变性,但是通常这还不够。 神经网络不会将图像中特定位置的一个对象和另一图像中平移位置的相同对象视为同一事物。 这就是为什么我们需要在不同平移位置的图像的多个实例,以使神经网络更好地学习。 相同的解释适用于旋转和缩放。

旋转

以下是旋转的仿射变换矩阵,其中θ表示旋转角度:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-rkPpu0qW-1681653992505)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/1fe912fc-2dba-41b7-abe9-03443e5a0be2.png)]

在这种情况下,转换向量b为零。 通过选择一个非零b,我们可以得到旋转和平移。

例如,下图显示了视网膜的照片,然后是旋转 90 度的同一张照片:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-fbVEJZ5Q-1681653992505)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/8e268fb7-87ef-4dc7-b478-4ae01ced9521.png)]

图 2.5:视网膜的旋转照片

平移

对于平移,仿射变换矩阵是单位矩阵,平移向量b具有非零值:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-35LTxOEZ-1681653992505)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/53b85765-1bcb-4f23-b8f3-60b223dbf0f7.png)]

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-4U6ESGbU-1681653992505)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/73d49d1a-f974-40f0-9638-6ee27f574016.png)]

例如,对于垂直方向上五个像素位置和水平方向上三个像素位置的平移,我们可以使用b = [5 3]^T和M作为单位矩阵。

以下是沿图像的宽度和高度按 24 个像素位置对视网膜进行的图像平移:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-UrNDQy7s-1681653992505)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/d8fe4d81-04d8-481f-afdd-3a8295ab2a1c.png)]

图 2.5:视网膜的图像平移

缩放比例

缩放可以通过对角矩阵M ∈ R^(2x2)执行,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-G7kclgrL-1681653992506)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/f7892eff-50fc-4cf8-a629-271ad0cd18e3.png)]

这里,S[v]表示沿垂直方向的比例因子,S[h]表示沿水平方向的比例因子(请参见 “图 2.6”为插图)。 我们还可以选择通过具有非零转换向量b来跟随转换的缩放:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Fe1dRnnM-1681653992506)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/3b758265-dbb1-48fb-a744-4a08fef9ce08.png)]

图 2.6 视网膜的图像缩放

反射

可以通过变换矩阵T ∈ R^(2x2)获得关于一条线L与水平角度为θ的反射,如下所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-W719IUbz-1681653992506)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/a5bd446b-cfaa-46c9-9797-36893efc4d5b.png)]

下图显示了视网膜照片的水平翻转:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-HKWKtLIA-1681653992506)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/380a724a-5cef-4a07-948a-f07da269bf10.png)]

图 2.7:视网膜照片的水平翻转

通过仿射变换产生更多图像

keras图像生成器将使用以下类来完成我们的任务:

datagen = ImageDataGenerator(horizontal_flip = True,vertical_flip = True,width_shift_range = 0.1,height_shift_range = 0.1,channel_shift_range=0,zoom_range = 0.2,rotation_range = 20)

从定义的生成器中可以看到,我们启用了水平和垂直翻转,这仅是图像沿水平和垂直轴的反射。 同样,我们将沿宽度和高度的图像平移定义为沿这些方向的像素位置的 10% 以内。 旋转范围限制为20度的角度,而比例因子定义为原始图像的0.8至1.2之内。

网络架构

现在,我们将对经过预训练的ResNet50,InceptionV3和VGG16网络进行实验,并找出哪种网络效果最好。 每个预训练模型的权重均基于 ImageNet。 我提供了 ResNet,InceptionV3和VGG16架构的原始论文的链接,以供参考。 建议读者仔细阅读这些文章,以深入了解这些架构及其之间的细微差别。

VGG 论文链接如下:

《用于大型图像识别的超深度卷积网络》

ResNet 论文链接如下:

《用于图像识别的深度残差学习》

InceptionV3 论文链接如下:

《重新思考计算机视觉的起始架构》

简而言之,VGG16是一个 16 层的 CNN,使用3 x 3过滤器和2 x 2接收场进行卷积。 整个网络使用的激活函数都是 ReLU。 由 Simonyan 和 Zisserman 开发的 VGG 架构是 2014 年 ILSVRC 竞赛的亚军。 VGG16网络由于其简单性而广受欢迎,它是从图像中提取特征的最受欢迎的网络。

ResNet50是一种深层的 CNN,它实现了残余块的概念,与VGG16网络的概念完全不同。 经过一系列的卷积激活池操作之后,该块的输入再次被反馈到输出。 ResNet 架构是由 Kaiming He 等人开发的,尽管具有 152 层,但它不如 VGG 网络复杂。 该架构通过实现 3.57% 的前五位错误率赢得了 2015 年 ILSVRC 竞赛,这比该竞赛数据集上的人类水平表现要好。 通过检查目标是否在概率最高的五类预测中来计算前五个错误率。 原则上,ResNet 网络尝试学习残差映射,而不是直接从输出映射到输入,如下面的残差框图所示:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-x56964Rx-1681653992507)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/6e52be2c-3618-4411-8f03-b372b21e42c7.png)]

图 2.8:ResNet 模型的残差块

InceptionV3 是 Google 提供的最新的 CNN。 InceptionV3 架构没有在每一层使用固定大小的卷积过滤器,而是使用不同大小的过滤器来提取不同粒度级别的特征。 下图说明了 InceptionV3 层的卷积块:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-hrXOlwsz-1681653992507)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/afb2d8e3-f919-49c3-9ede-13e707b6d72e.png)]

图 2.9:InceptionV3 卷积模块

Inception V1(GoogleNet)是 2014 年 ILSVRC 竞赛的获胜者。 它的最高 5% 错误率非常接近人类水平的表现,为 6.67%。

VGG16 迁移学习网络

我们将从预训练的VGG16网络中的最后一个合并层中获取输出,并添加一对全连接层,每个层 512 个单元,然后是输出层。 最终池化层的输出是从全局平均池化操作传递到全连接层之前的。 我们只可以展平池化层的输出,而不是执行全局平均池化-其思想是确保池化的输出不是二维晶格格式,而是一维数组格式, 非常像一个全连接层。 下图说明了基于预训练的VGG16的新VGG16的架构:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-ElY6rDAa-1681653992507)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/c2ef9608-eaff-46fd-990c-75a189d2463b.png)]

图 2.10:VGG16 迁移学习网络

如上图所示,我们将从预训练网络中的最后一个最大池化层提取输出,并在最终输出层之前附加两个全连接层。 基于先前的架构,可以使用keras如下代码块所示定义 VGG 定义函数:

def VGG16_pseudo(dim=224,freeze_layers=10,full_freeze='N'):# model_save_dest = {}model = VGG16(weights='imagenet',include_top=False)x = model.outputx = GlobalAveragePooling2D()(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)out = Dense(5,activation='softmax')(x)model_final = Model(input = model.input,outputs=out)if full_freeze != 'N':for layer in model.layers[0:freeze_layers]:layer.trainable = Falsereturn model_final

我们将使用 ImageNet 上训练的VGG16的权重作为模型的初始权重,然后对模型进行微调。 我们还冻结了前几层的权重(默认设置为10),因为在 CNN 中,前几层学会了检测通用特征,例如边缘,颜色成分等。 因此,特征在各个域之间不会有太大变化。 冻结层是指不训练该层特定的权重。 我们可以尝试冻结的层数,并选择提供最佳验证分数的层。 由于我们正在执行多类分类,因此已为输出层选择了 softmax 激活函数。

InceptionV3 迁移学习网络

在以下代码块中定义了用于我们任务的InceptionV3网络。 需要注意的一件事是,由于InceptionV3是一个更深的网络,因此我们可以拥有更多的初始层。 在数据可用性方面,不训练每个模型中的所有层的想法还有另一个优势。 如果我们使用较少的数据训练,则整个网络的权重可能会导致过拟合。 冻结层会减少要训练的权重数,因此提供了一种形式的规则化。

由于初始层学习通用特征,而与问题的范围无关,因此它们是冻结的最佳层。 我们还在全连接层中使用了丢弃,以防止过拟合:

def inception_pseudo(dim=224,freeze_layers=30,full_freeze='N'):model = InceptionV3(weights='imagenet',include_top=False)x = model.outputx = GlobalAveragePooling2D()(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)out = Dense(5,activation='softmax')(x)model_final = Model(input = model.input,outputs=out)if full_freeze != 'N':for layer in model.layers[0:freeze_layers]:layer.trainable = Falsereturn model_final

ResNet50 迁移学习网络

可以类似于VGG16和InceptionV3网络定义用于迁移学习的ResNet50模型,如下所示:

def resnet_pseudo(dim=224,freeze_layers=10,full_freeze='N'):# model_save_dest = {}model = ResNet50(weights='imagenet',include_top=False)x = model.outputx = GlobalAveragePooling2D()(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)out = Dense(5,activation='softmax')(x)model_final = Model(input = model.input,outputs=out)if full_freeze != 'N':for layer in model.layers[0:freeze_layers]:layer.trainable = Falsereturn model_final优化器和初始学习率

Adam 优化器(自适应矩估计器)用于实现随机梯度下降高级版本的训练。 Adam 优化器会考虑成本函数中的曲率,同时使用动量来确保朝着良好的局部最小值稳定发展。 对于眼前的问题,由于我们正在使用迁移学习,并且希望使用从预训练的网络中获得的尽可能多的先前学习的特征,因此我们将使用较小的初始学习率0.00001。 这将确保网络不会丢失经过预训练的网络学习到的有用特征,并根据当前问题的新数据将其微调至较不激进的最佳点。 Adam 优化器可以定义如下:

adam = optimizers.Adam(lr=0.00001, beta_1=0.9, beta_2=0.999, epsilon=1e-08, decay=0.0)

beta_1参数控制动量计算中当前梯度的贡献,而beta_2参数控制梯度归一化中梯度平方的贡献,这有助于解决成本函数中的曲率。

交叉验证

由于训练数据集很小,我们将执行五重交叉验证,以更好地了解模型对新数据进行泛化的能力。 我们还将在训练中使用交叉验证不同折中的所有五个模型进行推断。 属于类别标签的测试数据点的概率将是所有五个模型的平均概率预测,其表示如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-MtrmfUDO-1681653992507)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/f22caa67-e998-4298-96ca-80c28ffa53a8.png)]

由于目的是预测实际类别而不是概率,因此我们将选择具有最大概率的类别。 当我们使用基于分类的网络和成本函数时,此方法有效。 如果我们将问题视为回归问题,则该过程会有一些更改,我们将在后面讨论。

根据验证日志损失对检查点进行建模

它始终是一个很好的做法,以保存模型时所选择的评估验证分数提高。 对于我们的项目,我们将跟踪验证日志损失,并随着验证得分在不同周期的提高而保存模型。 这样,在训练之后,我们将保存提供最佳验证分数的模型权重,而不是保存我们停止训练后的最终模型权重。 训练将继续进行,直到达到为训练定义的最大周期数,或者直到连续10个周期的验证日志损失都没有减少为止。 当3周期的验证日志损失没有改善时,我们还将降低学习率。 以下代码块可用于执行学习率降低和检查点操作:

reduce_lr = keras.callbacks.ReduceLROnPlateau(monitor='val_loss', factor=0.50,patience=3, min_lr=0.000001)callbacks = [EarlyStopping(monitor='val_loss', patience=10, mode='min', verbose=1),CSVLogger('keras-5fold-run-01-v1-epochs_ib.log', separator=',', append=False),reduce_lr,ModelCheckpoint('kera1-5fold-run-01-v1-fold-' + str('%02d' % (k + 1)) + '-run-' + str('%02d' % (1 + 1)) + '.check',monitor='val_loss', mode='min', # mode must be set to max or keras will be confusedsave_best_only=True,verbose=1)]

如您在前面的代码块中所见,如果在3(patience=3)周期中验证损失没有改善,则学习率降低到一半(0.50)。 同样,如果在10(patience = 10)周期没有减少验证损失,我们将停止训练(通过执行EarlyStopping)。 每当验证日志损失减少时,都会保存模型,如以下代码片段所示:

'kera1-5fold-run-01-v1-fold-' + str('%02d' % (k + 1)) + '-run-' + str('%02d' % (1 + 1)) + '.check'

在keras-5fold-run-01-v1-epochs_ib.log 日志文件中跟踪训练过程的每个周期的验证日志损失,如果验证日志损失有所改善,为了保存模型,请参考该文件, 或决定何时降低学习率或停止训练。

通过使用keras save函数在用户定义的路径中保存每个折叠中的模型,而在推理过程中,使用keras.load_model函数将模型加载到内存中。

Python 实现训练过程

以下 Python 代码块显示了训练过程的端到端实现。 它由前面各节中讨论的所有函数块组成。 让我们首先调用所需的所有 Python 包,如下所示:

import numpy as np

np.random.seed(1000)import os

import glob

import cv2

import datetime

import pandas as pd

import time

import warnings

warnings.filterwarnings("ignore")

from sklearn.model_selection import KFold

from sklearn.metrics import cohen_kappa_score

from keras.models import Sequential,Model

from keras.layers.core import Dense, Dropout, Flatten

from keras.layers.convolutional import Convolution2D, MaxPooling2D, ZeroPadding2D

from keras.layers import GlobalMaxPooling2D,GlobalAveragePooling2D

from keras.optimizers import SGD

from keras.callbacks import EarlyStopping

from keras.utils import np_utils

from sklearn.metrics import log_loss

import keras

from keras import __version__ as keras_version

from keras.applications.inception_v3 import InceptionV3

from keras.applications.resnet50 import ResNet50

from keras.applications.vgg16 import VGG16

from keras.preprocessing.image import ImageDataGenerator

from keras import optimizers

from keras.callbacks import EarlyStopping, ModelCheckpoint, CSVLogger, Callback

from keras.applications.resnet50 import preprocess_input

import h5py

import argparse

from sklearn.externals import joblib

import json导入所需的库后,我们可以定义TransferLearning类:

class TransferLearning:def __init__(self):parser = argparse.ArgumentParser(description='Process the inputs')parser.add_argument('--path',help='image directory')parser.add_argument('--class_folders',help='class images folder names')parser.add_argument('--dim',type=int,help='Image dimensions to process')parser.add_argument('--lr',type=float,help='learning rate',default=1e-4)parser.add_argument('--batch_size',type=int,help='batch size')parser.add_argument('--epochs',type=int,help='no of epochs to train')parser.add_argument('--initial_layers_to_freeze',type=int,help='the initial layers to freeze')parser.add_argument('--model',help='Standard Model to load',default='InceptionV3')parser.add_argument('--folds',type=int,help='num of cross validation folds',default=5)parser.add_argument('--outdir',help='output directory')args = parser.parse_args()self.path = args.pathself.class_folders = json.loads(args.class_folders)self.dim = int(args.dim)self.lr = float(args.lr)self.batch_size = int(args.batch_size)self.epochs = int(args.epochs)self.initial_layers_to_freeze = int(args.initial_layers_to_freeze)self.model = args.modelself.folds = int(args.folds)self.outdir = args.outdir

接下来,让我们定义一个函数,该函数可以读取图像并将它们调整为合适的大小,如下所示:

def get_im_cv2(self,path,dim=224):img = cv2.imread(path)resized = cv2.resize(img, (dim,dim), cv2.INTER_LINEAR)return resized# Pre Process the Images based on the ImageNet pre-trained model Image transformationdef pre_process(self,img):img[:,:,0] = img[:,:,0] - 103.939img[:,:,1] = img[:,:,0] - 116.779img[:,:,2] = img[:,:,0] - 123.68return img# Function to build X, y in numpy format based on the train/validation datasetsdef read_data(self,class_folders,path,num_class,dim,train_val='train'):print(train_val)train_X,train_y = [],[] for c in class_folders:path_class = path + str(train_val) + '/' + str(c)file_list = os.listdir(path_class) for f in file_list:img = self.get_im_cv2(path_class + '/' + f)img = self.pre_process(img)train_X.append(img)train_y.append(int(c.split('class')[1]))train_y = keras.utils.np_utils.to_categorical(np.array(train_y),num_class) return np.array(train_X),train_y

接下来,我们现在将定义三个用于迁移学习的模型,从InceptionV3开始:

def inception_pseudo(self,dim=224,freeze_layers=30,full_freeze='N'):model = InceptionV3(weights='imagenet',include_top=False)x = model.outputx = GlobalAveragePooling2D()(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)out = Dense(5,activation='softmax')(x)model_final = Model(input = model.input,outputs=out)if full_freeze != 'N':for layer in model.layers[0:freeze_layers]:layer.trainable = Falsereturn model_final

然后,我们将定义用于迁移学习的ResNet50模型:

def resnet_pseudo(self,dim=224,freeze_layers=10,full_freeze='N'):model = ResNet50(weights='imagenet',include_top=False)x = model.outputx = GlobalAveragePooling2D()(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)out = Dense(5,activation='softmax')(x)model_final = Model(input = model.input,outputs=out)if full_freeze != 'N':for layer in model.layers[0:freeze_layers]:layer.trainable = Falsereturn model_final最后,我们将定义VGG16模型:

def VGG16_pseudo(self,dim=224,freeze_layers=10,full_freeze='N'):model = VGG16(weights='imagenet',include_top=False)x = model.outputx = GlobalAveragePooling2D()(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)out = Dense(5,activation='softmax')(x)model_final = Model(input = model.input,outputs=out)if full_freeze != 'N':for layer in model.layers[0:freeze_layers]:layer.trainable = Falsereturn model_final

现在,让我们定义训练函数,如下所示:

def train_model(self,train_X,train_y,n_fold=5,batch_size=16,epochs=40,

dim=224,lr=1e-5,model='ResNet50'):model_save_dest = {}k = 0kf = KFold(n_splits=n_fold, random_state=0, shuffle=True)for train_index, test_index in kf.split(train_X):k += 1 X_train,X_test = train_X[train_index],train_X[test_index]y_train, y_test = train_y[train_index],train_y[test_index]if model == 'Resnet50':model_final = self.resnet_pseudo(dim=224,freeze_layers=10,full_freeze='N')if model == 'VGG16':model_final = self.VGG16_pseudo(dim=224,freeze_layers=10,full_freeze='N') if model == 'InceptionV3':model_final = self.inception_pseudo(dim=224,freeze_layers=10,full_freeze='N')datagen = ImageDataGenerator(horizontal_flip = True,vertical_flip = True,width_shift_range = 0.1,height_shift_range = 0.1,channel_shift_range=0,zoom_range = 0.2,rotation_range = 20)adam = optimizers.Adam(lr=lr, beta_1=0.9, beta_2=0.999, epsilon=1e-08, decay=0.0)model_final.compile(optimizer=adam, loss= ["categorical_crossentropy"],metrics=['accuracy'])reduce_lr = keras.callbacks.ReduceLROnPlateau(monitor='val_loss', factor=0.50, patience=3, min_lr=0.000001)callbacks = [EarlyStopping(monitor='val_loss', patience=10, mode='min', verbose=1),CSVLogger('keras-5fold-run-01-v1-epochs_ib.log', separator=',', append=False),reduce_lr,ModelCheckpoint('kera1-5fold-run-01-v1-fold-' + str('%02d' % (k + 1)) + '-run-' + str('%02d' % (1 + 1)) + '.check',monitor='val_loss', mode='min',save_best_only=True,verbose=1)]model_final.fit_generator(datagen.flow(X_train,y_train, batch_size=batch_size),steps_per_epoch=X_train.shape[0]/batch_size, epochs=epochs,verbose=1, validation_data= (X_test,y_test),callbacks=callbacks, class_weight= {0:0.012,1:0.12,2:0.058,3:0.36,4:0.43})model_name = 'kera1-5fold-run-01-v1-fold-' + str('%02d' % (k + 1)) + '-run-' + str('%02d' % (1 + 1)) + '.check'del model_finalf = h5py.File(model_name, 'r+')del f['optimizer_weights']f.close()model_final = keras.models.load_model(model_name)model_name1 = self.outdir + str(model) + '___' + str(k) model_final.save(model_name1)model_save_dest[k] = model_name1return model_save_dest

我们还将为保持数据集定义一个inference函数,如下所示:

def inference_validation(self,test_X,test_y,model_save_dest,n_class=5,folds=5):pred = np.zeros((len(test_X),n_class))for k in range(1,folds + 1):model = keras.models.load_model(model_save_dest[k])pred = pred + model.predict(test_X)pred = pred/(1.0*folds) pred_class = np.argmax(pred,axis=1) act_class = np.argmax(test_y,axis=1)accuracy = np.sum([pred_class == act_class])*1.0/len(test_X)kappa = cohen_kappa_score(pred_class,act_class,weights='quadratic')return pred_class,accuracy,kappa

现在,让我们调用main函数,以触发训练过程,如下所示:

def main(self):start_time = time.time()self.num_class = len(self.class_folders)if self.mode == 'train':print("Data Processing..")file_list,labels= self.read_data(self.class_folders,self.path,self.num_class,self.dim,train_val='train')print(len(file_list),len(labels))print(labels[0],labels[-1])self.model_save_dest = self.train_model(file_list,labels,n_fold=self.folds,batch_size=self.batch_size,epochs=self.epochs,dim=self.dim,lr=self.lr,model=self.model)joblib.dump(self.model_save_dest,f'{self.outdir}/model_dict.pkl')print("Model saved to dest:",self.model_save_dest)else:model_save_dest = joblib.load(self.model_save_dest)print('Models loaded from:',model_save_dest)# Do inference/validationtest_files,test_y = self.read_data(self.class_folders,self.path,self.num_class,self.dim,train_val='validation')test_X = []for f in test_files:img = self.get_im_cv2(f)img = self.pre_process(img)test_X.append(img)test_X = np.array(test_X)test_y = np.array(test_y)print(test_X.shape)print(len(test_y))pred_class,accuracy,kappa = self.inference_validation(test_X,test_y,model_save_dest,n_class=self.num_class,folds=self.folds)results_df = pd.DataFrame()results_df['file_name'] = test_filesresults_df['target'] = test_yresults_df['prediction'] = pred_classresults_df.to_csv(f'{self.outdir}/val_resuts_reg.csv',index=False)print("-----------------------------------------------------")print("Kappa score:", kappa)print("accuracy:", accuracy) print("End of training")print("-----------------------------------------------------")print("Processing Time",time.time() - start_time,' secs')

我们可以更改几个参数,例如学习率,批量大小,图像大小等,并且我们可以进行实验以得出一个不错的模型。 在训练阶段,模型位置保存在model_save_dest字典中,该字典被写入dict_model文件中。

在推理阶段,该模型仅基于训练后的模型对新的测试数据进行预测。

可以如下调用名为TransferLearning.py的用于迁移学习的脚本:

python TransferLearning.py --path '/media/santanu/9eb9b6dc-b380-486e-b4fd-c424a325b976/book AI/Diabetic Retinopathy/Extra/assignment2_train_dataset/' --class_folders '["class0","class1","class2","class3","class4"]' --dim 224 --lr 1e-4 --batch_size 16 --epochs 20 --initial_layers_to_freeze 10 --model InceptionV3 --folds 5 --outdir '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/'

脚本的输出日志如下:

Model saved to dest: {1: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/categorical/InceptionV3___1', 2: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/categorical/InceptionV3___2', 3: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/categorical/InceptionV3___3', 4: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/categorical/InceptionV3___4', 5: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/categorical/InceptionV3___5'}

validation

-----------------------------------------------------

Kappa score: 0.42969781637876836

accuracy: 0.5553973227000855

End of training

-----------------------------------------------------

Processing Time 26009.3344039917 secs

从日志中的结果可以看出,我们达到了不错的交叉验证精度,约为56%,二次 Kappa 约为0.43。

在此脚本中,我们将所有数据加载到内存中,然后将增强图像从ImageDataGenerator馈送到模型进行训练。 如果训练图像集很少和/或大小适中,那么将数据加载到内存中可能不会引起太大关注。 但是,如果图像语料库很大和/或我们资源有限,那么将所有数据加载到内存中将不是可行的选择。 由于运行这些实验的计算机具有 64 GB RAM,因此我们能够毫无问题地训练这些模型。 即使是 16 GB 的 RAM 计算机也可能不足以通过将所有数据加载到内存中来运行这些实验,并且您可能会遇到内存错误。

问题是,我们是否需要一次将所有数据加载到内存中?

由于神经网络适用于小型批量,因此我们只需要与一个小型批量对应的数据即可一次通过反向传播训练模型。 类似地,对于下一个反向传播,我们可以丢弃与当前批量相对应的数据,然后处理下一个批量。 因此,以某种方式,每个小型批量中的内存需求仅是与该批量相对应的数据。 因此,我们可以在训练时创建动态批量,从而避免在内存较少的机器上训练深度学习模型。 Keras 具有在训练时创建动态批量的良好功能,我们将在下一节中讨论。

训练期间动态创建小批量

仅加载与小批量对应的数据的一种方法是通过从其位置随机处理图像来动态创建小批量。 小批量处理的图像数量将等于我们指定的小批量大小。 当然,由于在训练期间会动态创建小批量生产,因此在训练过程中会遇到一些瓶颈,但是这一瓶颈可以忽略不计。 特殊的包,例如keras,具有有效的动态批量创建机制。 我们将在训练过程中利用 keras 中的flow_from_directory函数动态创建迷你批,以减少训练过程的内存需求。 我们仍将继续使用ImageDataGenerator进行图像增强。 可以如下定义训练生成器和验证生成器。

通过将pre_process函数作为输入输入到ImageDataGenerator的preprocessing_function中,完成从三个通道中减去平均图像像素强度的图像预处理步骤:

def pre_process(img):img[:,:,0] = img[:,:,0] - 103.939img[:,:,1] = img[:,:,0] - 116.779img[:,:,2] = img[:,:,0] - 123.68return imgtrain_file_names = glob.glob(f'{train_dir}/*/*')val_file_names = glob.glob(f'{val_dir}/*/*')train_steps_per_epoch = len(train_file_names)/float(batch_size)val_steps_per_epoch = len(val_file_names)/float(batch_size)train_datagen = ImageDataGenerator(horizontal_flip =True,vertical_flip =True,width_shift_range =0.1,height_shift_range = 0.1,channel_shift_range=0,zoom_range = 0.2,rotation_range = 20,preprocessing_function=pre_process)val_datagen =ImageDataGenerator(preprocessing_function=pre_process)train_generator =train_datagen.flow_from_directory(train_dir,target_size=(dim,dim),batch_size=batch_size,class_mode='categorical')val_generator =val_datagen.flow_from_directory(val_dir,target_size=(dim,dim),batch_size=batch_size,class_mode='categorical')print(train_generator.class_indices)joblib.dump(train_generator.class_indices,f'{self.outdir}/class_indices.pkl')flow_from_directory函数将一个图像目录作为输入,并期望一个与该图像目录中的类有关的文件夹。 然后,它从文件夹名称推断类标签。 如果图像目录的图像目录具有以下结构,则将类别推断为0,1,2,3,4,与类别文件夹'class0','class1'有关 ,'class2','class3'和'class4'。

flow_from_directory函数的其他重要输入是batch_size,target_size和class_mode。 target_size用于指定要馈送到神经网络的图像的大小,而class_mode用于指定问题的性质。 对于二分类,将class_mode设置为二进制,而对于多分类,将其设置为categorical。

接下来,我们将通过创建动态批量来训练同一模型,而不是一次将所有数据加载到内存中。 我们只需要使用flow_from_directory选项创建一个生成器,然后将其绑定到数据扩充对象即可。 数据生成器对象可以如下生成:

# Pre processing for channel wise mean pixel subtraction

def pre_process(img):img[:,:,0] = img[:,:,0] - 103.939img[:,:,1] = img[:,:,0] - 116.779img[:,:,2] = img[:,:,0] - 123.68return img# Add the pre_process function at the end of the ImageDataGenerator,

#rest all of the data augmentation options

# remain the same. train_datagen =

ImageDataGenerator(horizontal_flip = True,vertical_flip = True,width_shift_range = 0.1,height_shift_range = 0.1,channel_shift_range=0,zoom_range = 0.2,rotation_range = 20,preprocessing_function=pre_process)# For validation no data augmentation on image mean subtraction preprocessing

val_datagen = ImageDataGenerator(preprocessing_function=pre_process)# We build the train generator using flow_from_directory

train_generator = train_datagen.flow_from_directory(train_dir,target_size=(dim,dim),batch_size=batch_size,class_mode='categorical')# We build the validation generator using flow_from_directory

val_generator = val_datagen.flow_from_directory(val_dir,target_size=(dim,dim),batch_size=batch_size,class_mode='categorical')

在前面的代码中,我们将ImageDataGenerator传递给执行均值像素减法的附加任务,因为我们没有控制将图像数据加载到内存中并通过pre_process函数传递的任何控制权。 在preprocessing_function选项中,我们可以为任何特定的预处理任务传递任何所需的自定义函数。

通过train_dir和val_dir,我们将训练和验证目录传递给使用flow_with_directory选项创建的训练和验证生成器。 生成器通过查看传递的训练数据目录(此处为train_dir)中的类别文件夹数来识别类别数。 在基于batch_size的训练时间内,图像根据指定的batch_size读入内存

class_mode帮助生成器识别其二分类还是多分类('categotical')。

详细的实现在 GitHub 上的TransferLearning_ffd.py文件夹中列出。

Python 脚本TransferLearning_ffd.py可以按以下方式调用:

python TransferLearning_ffd.py --path '/media/santanu/9eb9b6dc-b380-486e-b4fd-c424a325b976/book AI/Diabetic Retinopathy/Extra/assignment2_train_dataset/' --class_folders '["class0","class1","class2","class3","class4"]' --dim 224 --lr 1e-4 --batch_size 32 --epochs 50 --initial_layers_to_freeze 10 --model InceptionV3 --outdir '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/' 作业运行的输出日志结尾如下:

Validation results saved at : /home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/val_results.csv

[0 0 0 ... 4 2 2]

[0 0 0 ... 4 4 4]

Validation Accuracy: 0.5183708345200797

Validation Quadratic Kappa Score: 0.44422008110380984如我们所见,通过重用现有网络并在同一网络上执行迁移学习,我们能够实现不错的0.44二次方 Kappa。

分类结果

通过使用所有三个神经网络架构VGG16,ResNet50和InceptionV3进行分类。 对于该糖尿病性视网膜病用例,使用迁移学习网络的InceptionV3版本可获得最佳结果。 如果是分类分类,我们只是将具有最大预测分类概率的分类转换为预测严重性标签。 但是,由于问题中的类别具有序数意义,因此我们可以利用 softmax 概率的方法之一是针对 softmax 概率对类别严重性进行期望并得出预期分数y_hat如下 :

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-zzLPKsCq-1681653992508)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/13040376-dbdd-411b-85da-5ae7e4231683.png)]

我们可以对分数进行排序,并确定三个阈值来确定图像属于哪个类别。 这些阈值可以通过将这些预期得分作为特征训练辅助模型来选择。 建议读者按照这些思路进行试验,看看是否有任何好处。

作为该项目的一部分,我们正在使用迁移学习来解决一个难题。 通过在给定的数据集上从头开始训练网络,模型表现可能会更好。

测试时推断

以下代码可用于对未标记的测试数据进行推断:

import keras

import numpy as np

import pandas as pd

import cv2

import os

import time

from sklearn.externals import joblib

import argparse# Read the Image and resize to the suitable dimension size

def get_im_cv2(path,dim=224):img = cv2.imread(path)resized = cv2.resize(img, (dim,dim), cv2.INTER_LINEAR)return resized# Pre Process the Images based on the ImageNet pre-trained model Image transformation

def pre_process(img):img[:,:,0] = img[:,:,0] - 103.939img[:,:,1] = img[:,:,0] - 116.779img[:,:,2] = img[:,:,0] - 123.68return img# Function to build test input data

def read_data_test(path,dim):test_X = [] test_files = []file_list = os.listdir(path) for f in file_list:img = get_im_cv2(path + '/' + f)img = pre_process(img)test_X.append(img)f_name = f.split('_')[0]test_files.append(f_name)return np.array(test_X),test_files

让我们定义推理:

def inference_test(test_X,model_save_dest,n_class):folds = len(list(model_save_dest.keys()))pred = np.zeros((len(test_X),n_class))for k in range(1,folds + 1):model = keras.models.load_model(model_save_dest[k])pred = pred + model.predict(test_X)pred = pred/(1.0*folds) pred_class = np.argmax(pred,axis=1) return pred_class def main(path,dim,model_save_dest,outdir,n_class):test_X,test_files = read_data_test(path,dim)pred_class = inference_test(test_X,model_save_dest,n_class)out = pd.DataFrame()out['id'] = test_filesout['class'] = pred_classout['class'] = out['class'].apply(lambda x:'class' + str(x))out.to_csv(outdir + "results.csv",index=False)if __name__ == '__main__':parser = argparse.ArgumentParser(description='arguments')parser.add_argument('--path',help='path of images to run inference on')parser.add_argument('--dim',type=int,help='Image dimension size to process',default=224)parser.add_argument('--model_save_dest',help='location of the trained models')parser.add_argument('--n_class',type=int,help='No of classes')parser.add_argument('--outdir',help='Output DIrectory')args = parser.parse_args()path = args.pathdim = args.dimmodel_save_dest = joblib.load(args.model_save_dest)n_class = args.n_classoutdir = args.outdirmain(path,dim,model_save_dest,outdir,n_class)执行回归而不是分类

我们在“损失函数公式”部分中讨论的一件事是,类别标签不是独立的分类类别,但随着糖尿病性视网膜病变情况的严重性增加,它们确实具有序数意义。 因此,值得通过定义的迁移学习网络进行回归,而不是进行分类,并观察结果如何。 我们唯一需要更改的是输出单元,从 softmax 到线性单元。 实际上,我们将其更改为 ReLU,因为我们希望避免出现负分数。 以下代码块显示了回归网络的InceptionV3版本:

def inception_pseudo(dim=224,freeze_layers=30,full_freeze='N'):model = InceptionV3(weights='imagenet',include_top=False)x = model.outputx = GlobalAveragePooling2D()(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)x = Dense(512, activation='relu')(x)x = Dropout(0.5)(x)out = Dense(1,activation='relu')(x)model_final = Model(input = model.input,outputs=out)if full_freeze != 'N':for layer in model.layers[0:freeze_layers]:layer.trainable = Falsereturn model_final

与其像分类网络中那样使分类交叉熵(对数损失)最小化,不如使回归网络的均方误差最小。 对于回归问题最小化的成本函数如下,其中y_hat是预测的标签:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-aMdVRjDn-1681653992508)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/8e955dd6-0917-4280-936d-2df33cbe371e.png)]

一旦我们预测了回归分数,就将其舍入到最接近的严重性类别(零到四)。

使用 keras utils.sequence作为生成器

Keras 具有一个名为keras.utils.sequence()的优秀批量生成器,可帮助您以极大的灵活性自定义批量创建。 实际上,使用keras.utils.sequence()可以设计整个周期流水线。 我们将在此回归问题中使用此工具以习惯该工具。 对于迁移学习问题,我们可以使用keras.utils.sequence()设计生成器类,如下所示:

class DataGenerator(keras.utils.Sequence):'Generates data for Keras'def __init__(self,files,labels,batch_size=32,n_classes=5,dim=(224,224,3),shuffle=True):'Initialization'self.labels = labelsself.files = filesself.batch_size = batch_sizeself.n_classes = n_classesself.dim = dimself.shuffle = shuffleself.on_epoch_end()def __len__(self):'Denotes the number of batches per epoch'return int(np.floor(len(self.files) / self.batch_size))def __getitem__(self, index):'Generate one batch of data'# Generate indexes of the batchindexes = self.indexes[index*self.batch_size:(index+1)*self.batch_size]# Find list of files to be processed in the batchlist_files = [self.files[k] for k in indexes]labels = [self.labels[k] for k in indexes]# Generate dataX, y = self.__data_generation(list_files,labels)return X, ydef on_epoch_end(self):'Updates indexes after each epoch'self.indexes = np.arange(len(self.files))if self.shuffle == True:np.random.shuffle(self.indexes)def __data_generation(self,list_files,labels):'Generates data containing batch_size samples' # X : (n_samples, *dim, n_channels)# InitializationX = np.empty((len(list_files),self.dim[0],self.dim[1],self.dim[2]))y = np.empty((len(list_files)),dtype=int)# print(X.shape,y.shape)# Generate datak = -1for i,f in enumerate(list_files):# print(f)img = get_im_cv2(f,dim=self.dim[0])img = pre_process(img)label = labels[i]#label =keras.utils.np_utils.to_categorical(label,self.n_classes)X[i,] = imgy[i,] = label# print(X.shape,y.shape) return X,y在前面的代码中,我们使用keras.utils.Sequence定义了DataGenerator类。

我们定义数据生成器以接受图像文件名,标签,批量大小,类数以及我们希望将图像调整大小的大小。 另外,我们指定是否希望将图像在一个周期中的处理顺序进行混排。

我们指定的函数是从keras.utils.Sequence继承的,因此,这些函数中每个函数的特定活动都无法在其他位置指定。len函数用于计算一个周期中的批量数。

类似地,在on_epoch_end函数中,我们可以指定在周期结束时要执行的活动,例如打乱周期中要处理输入的顺序。 我们可以在每个周期创建一组不同的数据集进行处理。 当我们有大量数据并且我们不想在每个周期处理所有数据时,这通常很有用。 __getitem__函数通过提取与特定于批量的所有数据点索引相对应的数据来帮助创建批量。 如果数据创建过程更复杂,则可以利用__data_generation 函数具有特定于批量中每个单独数据点提取的逻辑。 例如,我们将与批量中的数据点索引相对应的文件名传递给__data_generation函数,以使用opencv读取每个图像,并使用preprocess函数对其进行预处理,我们必须进行平均像素减法。

基于回归的迁移学习的训练函数可以编码如下:

def train_model(self,file_list,labels,n_fold=5,batch_size=16,

epochs=40,dim=224,lr=1e-5,model='ResNet50'):model_save_dest = {}k = 0kf = KFold(n_splits=n_fold, random_state=0, shuffle=True)for train_index,test_index in kf.split(file_list):k += 1file_list = np.array(file_list)labels = np.array(labels)train_files,train_labels = file_list[train_index],labels[train_index]val_files,val_labels = file_list[test_index],labels[test_index]if model == 'Resnet50':model_final = self.resnet_pseudo(dim=224,freeze_layers=10,full_freeze='N')if model == 'VGG16':model_final = self.VGG16_pseudo(dim=224,freeze_layers=10,full_freeze='N')if model == 'InceptionV3':model_final = self.inception_pseudo(dim=224,freeze_layers=10,full_freeze='N')adam = optimizers.Adam(lr=lr, beta_1=0.9, beta_2=0.999, epsilon=1e-08, decay=0.0)model_final.compile(optimizer=adam, loss=["mse"],metrics=['mse'])reduce_lr = keras.callbacks.ReduceLROnPlateau(monitor='val_loss', factor=0.50,patience=3, min_lr=0.000001)early = EarlyStopping(monitor='val_loss', patience=10, mode='min', verbose=1)logger = CSVLogger('keras-5fold-run-01-v1-epochs_ib.log', separator=',', append=False)checkpoint = ModelCheckpoint('kera1-5fold-run-01-v1-fold-' + str('%02d' % (k + 1))+ '-run-' + str('%02d' % (1 + 1)) + '.check',monitor='val_loss', mode='min',save_best_only=True,verbose=1)callbacks = [reduce_lr,early,checkpoint,logger]train_gen = DataGenerator(train_files,train_labels,batch_size=32,n_classes=len(self.class_folders),dim=(self.dim,self.dim,3),shuffle=True)val_gen = DataGenerator(val_files,val_labels,batch_size=32,n_classes=len(self.class_folders),dim=(self.dim,self.dim,3),shuffle=True)model_final.fit_generator(train_gen,epochs=epochs,verbose=1,validation_data=(val_gen),callbacks=callbacks)model_name ='kera1-5fold-run-01-v1-fold-' + str('%02d' % (k + 1)) + '-run-' + str('%02d' % (1 + 1)) + '.check'del model_finalf = h5py.File(model_name, 'r+')del f['optimizer_weights']f.close()model_final = keras.models.load_model(model_name)model_name1 = self.outdir + str(model) + '___' + str(k)model_final.save(model_name1)model_save_dest[k] = model_name1return model_save_dest

从前面的代码中我们可以看到,训练生成器和验证生成器是使用DataGenerator类创建的,该类继承了keras.utils.sequence类。 推理函数可以编码如下:

def inference_validation(self,test_X,test_y,model_save_dest,n_class=5,

folds=5):print(test_X.shape,test_y.shape)pred = np.zeros(test_X.shape[0])for k in range(1,folds + 1):print(f'running inference on fold: {k}')model = keras.models.load_model(model_save_dest[k])pred = pred + model.predict(test_X)[:,0]pred = predprint(pred.shape)print(pred)pred = pred/float(folds)pred_class = np.round(pred)pred_class = np.array(pred_class,dtype=int)pred_class = list(map(lambda x:4 if x > 4 else x,pred_class))pred_class = list(map(lambda x:0 if x < 0 else x,pred_class))act_class = test_yaccuracy = np.sum([pred_class == act_class])*1.0/len(test_X)kappa = cohen_kappa_score(pred_class,act_class,weights='quadratic')return pred_class,accuracy,kappa从前面的代码中我们可以看到,计算出每一折的预测平均值,并通过四舍五入预测分数将其转换为最接近的严重性类别。 用于回归的 Python 脚本位于 GitHub 链接中。 名称为TransferLearning_reg.py。 可以通过运行以下命令来调用相同的命令:

python TransferLearning_reg.py --path '/media/santanu/9eb9b6dc-b380-486e-b4fd-c424a325b976/book AI/Diabetic Retinopathy/Extra/assignment2_train_dataset/' --class_folders '["class0","class1","class2","class3","class4"]' --dim 224 --lr 1e-4 --batch_size 32 --epochs 5 --initial_layers_to_freeze 10 --model InceptionV3 --folds 5 --outdir '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/'

训练的输出日志如下:

Model saved to dest: {1: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___1', 2: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___2', 3: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___3', 4: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___4', 5: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___5'}

如我们所见,对应于5折叠的5模型已保存在我们指定的Regression文件夹下。 接下来,我们可以对验证数据集进行推断,并查看回归模型的运行情况。 可以如下调用相同的 Python 脚本:

python TransferLearning_reg.py --path '/media/santanu/9eb9b6dc-b380-486e-b4fd-c424a325b976/book AI/Diabetic Retinopathy/Extra/assignment2_train_dataset/' --class_folders '["class0","class1","class2","class3","class4"]' --dim 224 --lr 1e-4 --batch_size 32 --model InceptionV3 --outdir '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/' --mode validation --model_save_dest --'/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/model_dict.pkl' --folds 5

推断结果如下:

Models loaded from: {1: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___1', 2: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___2', 3: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___3', 4: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___4', 5: '/home/santanu/ML_DS_Catalog-/Transfer_Learning_DR/Regression/InceptionV3___5'}-----------------------------------------------------

Kappa score: 0.4662660860310418

accuracy: 0.661350042722871

End of training

-----------------------------------------------------

Processing Time 138.52878069877625 secs从前面的日志中可以看到,假设我们刚刚使用回归得分将模型映射到最接近的严重性条件,该模型可实现约 66% 的不错的验证准确率和0.466的二次 Kappa 得分。 建议读者进行实验,看看是否基于预测的二级模型对进行评分,并且眼睛是左眼还是右眼比将朴素的评分映射到最近的严重性类别给出了更好的结果。

总结

在本章中,我们介绍了迁移学习的实际方面,以解决医疗保健领域的现实问题。 希望读者通过尽可能尝试定制这些示例来进一步构建这些概念。

我们通过分类和基于回归的神经网络获得的准确率和 kappa 分数足以用于生产实现。 在第 3 章,“神经机器翻译”中,我们将致力于实现智能机器翻译系统,这是比本章介绍的主题更为高级的主题。 我期待您的参与。

三、神经机器翻译

机器翻译简而言之,是指使用计算机将文本从一种语言翻译成另一种语言。 它是计算机语言学的一个分支,已经发展了几年。 目前,在美国,翻译业是一个价值 400 亿美元的产业,并且在欧洲和亚洲也正在快速发展。 翻译存在巨大的社会,政府,经济和商业需求,并且 Google,Facebook,eBay 等公司在其应用中广泛使用它。 尤其是 Google 的神经翻译系统是目前最先进的翻译系统之一,能够仅用一种模型执行多种语言的翻译。

早期的机器翻译系统首先将文本中的单词和短语翻译成所需目标语言的相关替代词。 但是,由于以下原因,通过这些简单的技术实现的翻译质量受到限制:

- 从源语言到目标语言的词到词映射并非始终可用。

- 即使在源语言和目标语言之间确实存在精确的词对词映射,这些语言的句法结构通常也不相互对应。 机器翻译中的此问题通常称为对齐错误。

但是,随着循环神经网络(RNN)架构的最新进展,机器翻译不仅提供了更高的翻译质量,而且还提供了更高的翻译质量。这种系统的复杂性远远小于传统系统。

机器翻译系统大致可分为三类:基于规则的机器翻译,统计机器翻译和神经机器翻译。

在本章中,我们将介绍以下主题:

- 基于规则的机器翻译

- 统计机器学习系统

- 神经机器翻译

- 序列到序列的神经翻译

- 神经翻译的损失函数

技术要求

您将需要具有 Python 3,TensorFlow 和 Keras 的基础知识。

可以在 GitHub 上找到本章的代码文件

观看以下视频,查看运行中的代码。

基于规则的机器翻译

基于经典规则的机器翻译系统严重依赖于将文本从源语言转换为目标语言的规则。 这些规则通常由语言学家创建,通常在句法,语义和词汇层面上起作用。 传统的基于规则的机器翻译系统通常分为三个阶段:

- 分析阶段

- 词汇翻译阶段

- 生成阶段

图 3.1 是典型的基于规则的机器翻译系统的流程图:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-ekRab2Oe-1681653992509)(https://gitcode.net/apachecn/apachecn-dl-zh/-/raw/master/docs/intel-proj-py/img/87104398-8e42-45a6-bf08-3dbad0d1e745.png)]

图 3.1:基于规则的机器翻译系统的流程图

分析阶段