1、Kafka Broker

1.1 Kafka Broker工作流程

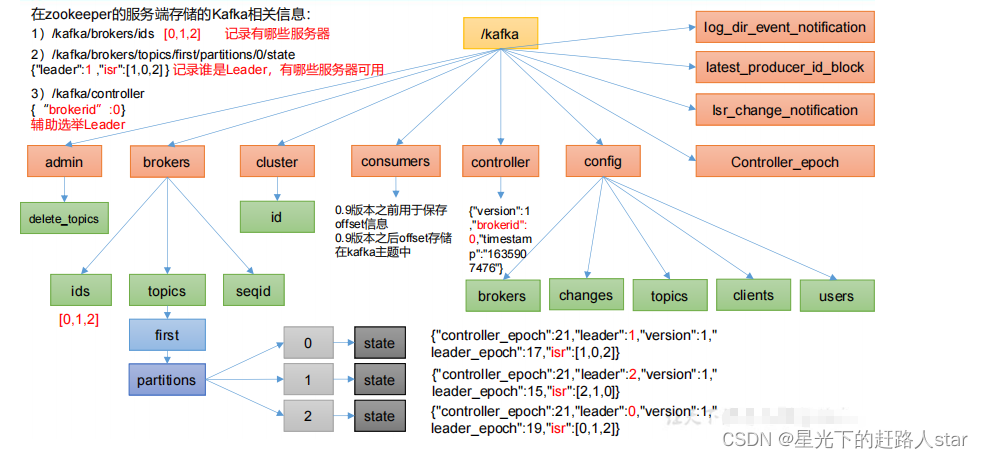

1.1.1 Zookeeper储存的Kafka信息

(1)启动Zookeeper集群、再启动Kafka集群,然后启动Zookeeper客户端

(2)通过ls命令可以查看kafka相关信息。

1.1.2 Kafka Broker总体工作流程

1、模拟Kafka上下线,Zookeeper中数据变化

(1)查看/kafka/brokers/ids 路径上的节点。

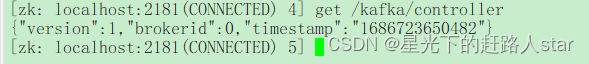

(2)查看/kafka/controller 路径上的数据

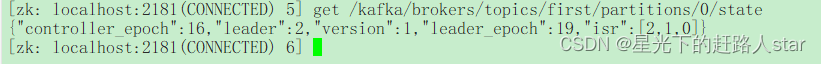

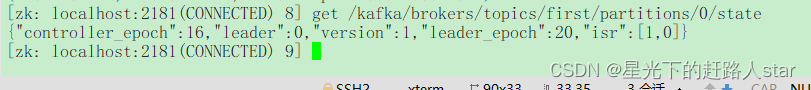

(3)查看/kafka/brokers/topics/first/partitions/0/state 路径上的数据。

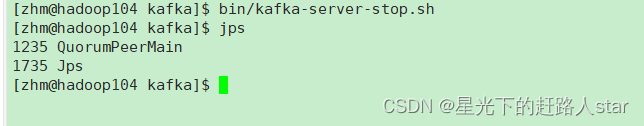

(4)停止 hadoop104 上的 kafka

(5)再次查看/kafka/brokers/ids 路径上的节点。

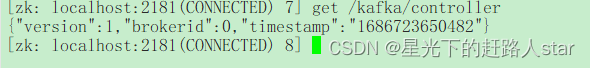

(6)再次查看/kafka/controller 路径上的数据。

(7)再次查看/kafka/brokers/topics/first/partitions/0/state 路径上的数据。

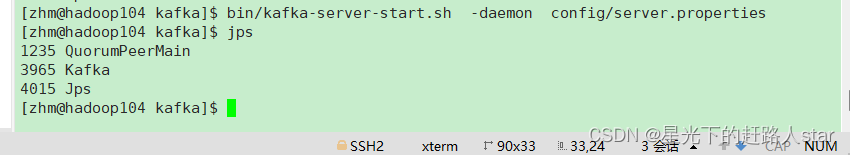

(8)启动 hadoop104 上的 kafka。

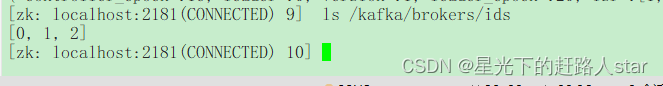

(9)查看/kafka/brokers/ids 路径上的节点。

4.1.3 Broker重要参数

| 参数名称 | 描述 |

|---|---|

| replica.lag.time.max.ms | ISR 中,如果 Follower 长时间未向 Leader 发送通信请求或同步数据,则该 Follower 将被踢出 ISR。该时间阈值,默认 30s。 |

| auto.leader.rebalance.enable | 默认是 true。 自动 Leader Partition 平衡。 |

| leader.imbalance.per.broker.percentage | 默认是 10%。每个 broker 允许的不平衡的 leader的比率。如果每个 broker 超过了这个值,控制器会触发 leader 的平衡。 |

| leader.imbalance.check.interval.seconds | 默认值 300 秒。检查 leader 负载是否平衡的间隔时间。 |

| log.segment.bytes | Kafka 中 log 日志是分成一块块存储的,此配置是指 log 日志划分 成块的大小,默认值 1G。 |

| log.index.interval.bytes | 默认 4kb,kafka 里面每当写入了 4kb 大小的日志(.log),然后就往 index 文件里面记录一个索引。 |

| log.retention.hours | Kafka 中数据保存的时间,默认 7 天。 |

| log.retention.minutes | Kafka 中数据保存的时间,分钟级别,默认关闭。 |

| log.retention.ms | Kafka 中数据保存的时间,毫秒级别,默认关闭。 |

| log.retention.check.interval.ms | 检查数据是否保存超时的间隔,默认是 5分钟。 |

| log.retention.bytes | 默认等于-1,表示无穷大。超过设置的所有日志总大小,删除最早的 segment |

| log.cleanup.policy | 默认是 delete,表示所有数据启用删除策略;如果设置值为 compact,表示所有数据启用压缩策略 |

| num.io.threads | 默认是 8。负责写磁盘的线程数。整个参数值要占总核数的 50%。 |

| num.replica.fetchers | 副本拉取线程数,这个参数占总核数的 50%的 1/3 |

| num.network.threads | 默认是 3。数据传输线程数,这个参数占总核数的50%的 2/3 。 |

| log.flush.interval.messages | 强制页缓存刷写到磁盘的条数,默认是 long 的最大值,9223372036854775807。一般不建议修改,交给系统自己管理。 |

| log.flush.interval.ms | 每隔多久,刷数据到磁盘,默认是 null。一般不建议修改,交给系统自己管理。 |

1.2 生产经验——节点服役和退役

1.2.1 服役新节点

1、新节点准备

(1)关闭 hadoop104,并右键执行克隆操作。

(2)开启克隆机,并修改 IP 地址。

(3)在 hadoop105 上,修改主机名称为 hadoop105

(4)重新启动 hadoop104、hadoop105

(5)修改 haodoop105 中 kafka 的 broker.id 为 3

(6)删除 hadoop105 中 kafka 下的 datas 和 logs。

(7)启动 hadoop102、hadoop103、hadoop104 上的 kafka 集群。

(8)单独启动 hadoop105 中的 kafka。

bin/kafka-server-start.sh -daemon ./config/server.properties

2、执行负载均衡操作

(1)创建一个要均衡的主题

vim topics-to-move.json

##填入下面信息

{"topics": [{"topic": "first"}],"version": 1

}

(2)生成一个负载均衡的计划

bin/kafka-reassign-partitions.sh --bootstrap-server hadoop102:9092 --topics-to-move-json-file topics-to-move.json --broker-list "0,1,2,3" --generate

Current partition replica assignment

{"version":1,"partitions":[{"topic":"first","partition":0,"replic

as":[0,2,1],"log_dirs":["any","any","any"]},{"topic":"first","par

tition":1,"replicas":[2,1,0],"log_dirs":["any","any","any"]},{"to

pic":"first","partition":2,"replicas":[1,0,2],"log_dirs":["any","

any","any"]}]}Proposed partition reassignment configuration

{"version":1,"partitions":[{"topic":"first","partition":0,"replic

as":[2,3,0],"log_dirs":["any","any","any"]},{"topic":"first","par

tition":1,"replicas":[3,0,1],"log_dirs":["any","any","any"]},{"to

pic":"first","partition":2,"replicas":[0,1,2],"log_dirs":["any","

any","any"]}]}

(3)创建副本储存计划(所有副本存储在 broker0、broker1、broker2、broker3 中)

vim increase-replication-factor.json

输入如下内容:

{"version":1,"partitions":[{"topic":"first","partition":0,"replic

as":[2,3,0],"log_dirs":["any","any","any"]},{"topic":"first","par

tition":1,"replicas":[3,0,1],"log_dirs":["any","any","any"]},{"to

pic":"first","partition":2,"replicas":[0,1,2],"log_dirs":["any","

any","any"]}]}

(4)执行副本计划

bin/kafka-reassign-partitions.sh --bootstrap-server hadoop102:9092 --reassignment-json-file increase-replication-factor.json --exectue

(5)验证副本储存计划

bin/kafka-reassign-partitions.sh --bootstrap-server hadoop102:9092 --reassignment-json-file increase-replication-factor.json --verify

1.2.2 退役旧节点

1、执行负载均衡操作

先按照退役一台节点,生成执行计划,然后按照服役时操作流程执行负载均衡。

(1)创建一个要均衡的主题

vim topics-to-move.json

##插入如下信息

{"topics": [{"topic": "first"}],"version": 1

}(2)创建执行计划

bin/kafka-reassign-partitions.sh --bootstrap-server hadoop102:9092 --topics-to-move-json-file topics-to-move.json --broker-list "0,1,2" --generateCurrent partition replica assignment

{"version":1,"partitions":[{"topic":"first","partition":0,"replic

as":[2,0,1],"log_dirs":["any","any","any"]},{"topic":"first","par

tition":1,"replicas":[3,1,2],"log_dirs":["any","any","any"]},{"to

pic":"first","partition":2,"replicas":[0,2,3],"log_dirs":["any","

any","any"]}]}Proposed partition reassignment configuration

{"version":1,"partitions":[{"topic":"first","partition":0,"replic

as":[2,0,1],"log_dirs":["any","any","any"]},{"topic":"first","par

tition":1,"replicas":[0,1,2],"log_dirs":["any","any","any"]},{"to

pic":"first","partition":2,"replicas":[1,2,0],"log_dirs":["any","

any","any"]}]}

(3)创建副本储存计划(所有副本储存在broker0、broker1、broker2中)

vim increase-replication-factor.json

##插入如下信息

{"version":1,"partitions":[{"topic":"first","partition":0,"replic

as":[2,0,1],"log_dirs":["any","any","any"]},{"topic":"first","par

tition":1,"replicas":[0,1,2],"log_dirs":["any","any","any"]},{"to

pic":"first","partition":2,"replicas":[1,2,0],"log_dirs":["any","

any","any"]}]}(4)执行副本计划

bin/kafka-reassign-partitions.sh --bootstrap-server hadoop102:9092 --reassignment-json-file increase-replication-factor.json --execute

(5)验证副本储存计划

bin/kafka-reassign-partitions.sh --bootstrap-server hadoop102:9092 --reassignment-json-file increase-replication-factor.json --verify

2、执行停止计划

在hadoop105上执行停止命令即可

bin/kafka-server-stop.sh

1.3 Kafka副本

1.3.1 副本基本信息

1、Kafka副本的作用:提高数据可靠性

2、Kafka默认副本1个,生产环境一般配置两个,保证数据可靠性;太多副本会增加磁盘储存空间,增加网络上数据传输,降低效率。

3、Kafka中副本分为Leader和Follower。Kafka生产者只会把数据发往Leader,然后Flower找Leader进行同步数据。

4、Kafka分区中的所以副本统称为AR(Assigned Repllicas).

AR=ISR+OSR

ISR:表示和Leader保持同步的Follower集合。如果Follower长时间未向Leader发送通信请求或同步数据,则该Follower将被提出ISR。该时间阙值由replica.lag.time.max.ms参数设定,默认30s。Leader发生故障之后,就会从ISR中选举新的Leader。

OSR表示Follower与Leader副本同步时,延迟过多的副本。

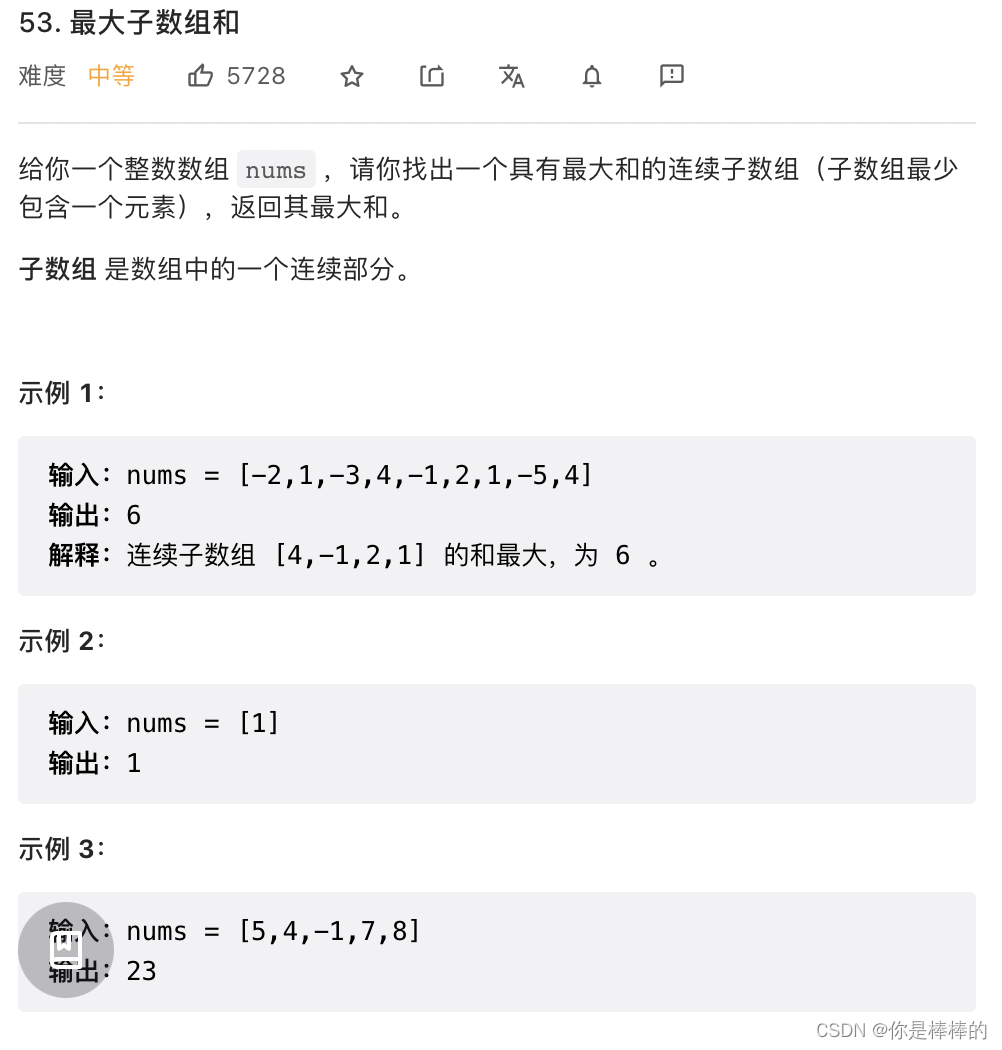

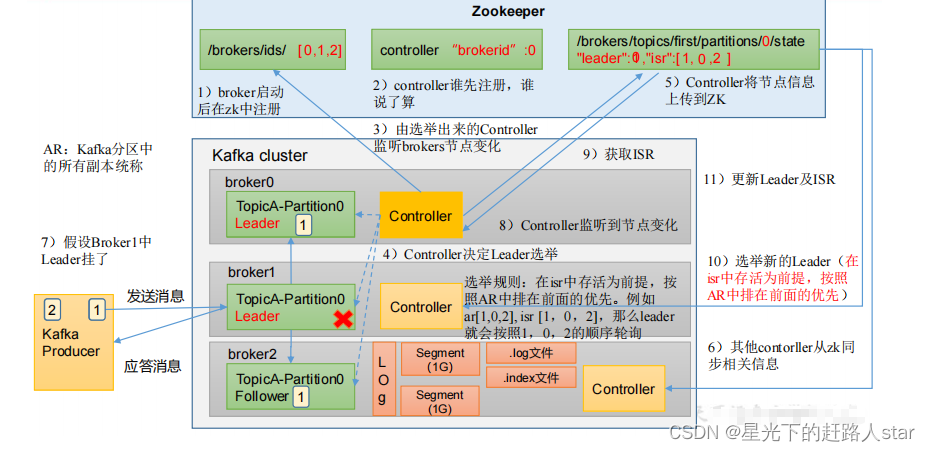

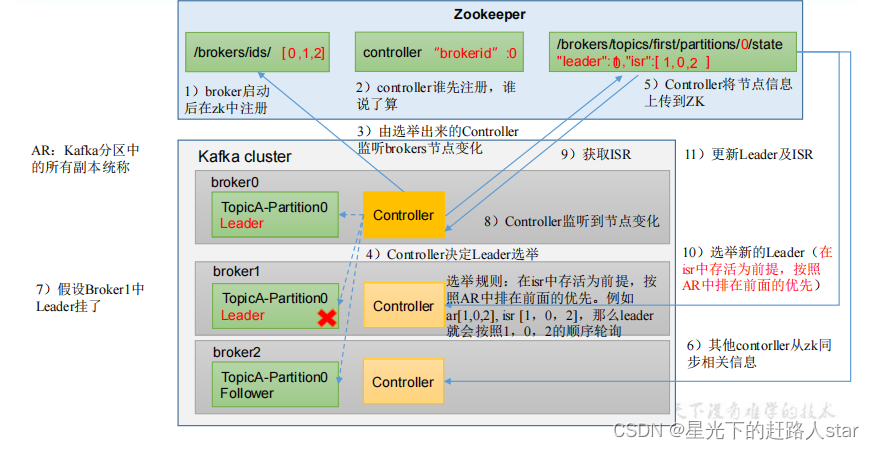

1.3.2 Leader选举流程

Kafka集群中有一个broker的Controller会被选举为Controller Leader,负责管理集群broker的上下线,所有topic的分区副本分配和Leader选举等工作。

Controller的信息同步工作时依赖于Zookeeper的。

1.3.3 Leader和Follower故障处理细节

LEO(Log End Offset):每个副本的最后一个offset,LEO其实就是最新的offset+1.

HW(High Watermark):所有副本中最小的LEO。

1、Follower故障

(1)Follower发生故障后会被临时踢出ISR

(2)这个期间Leader和Follower继续接受数据

(3)待该Follower恢复后,Follower会读取本地磁盘记录的上次HW,并将log文件高于HW的部分截取掉,从HW开始向Leader进行同步。

(4)邓该Follower的LEO大于等于该Partition的HW,即Follower追上Leader之后,就可以重新加入ISR了。

2、Leader故障

(1)Leader发生故障之后,会从ISR中选出一个新的Leader

(2)为保证多个副本之间的数据一致性,其余的Follower会先将各自的log文件高于HW的部分截掉,然后从新的Leader同步数据。

注意:这只能保证副本之间的数据一致性,并不能保证数据不丢失或不重复。

1.4 文件储存

1.4.1 文件储存机制

1、Topic数据的储存机制

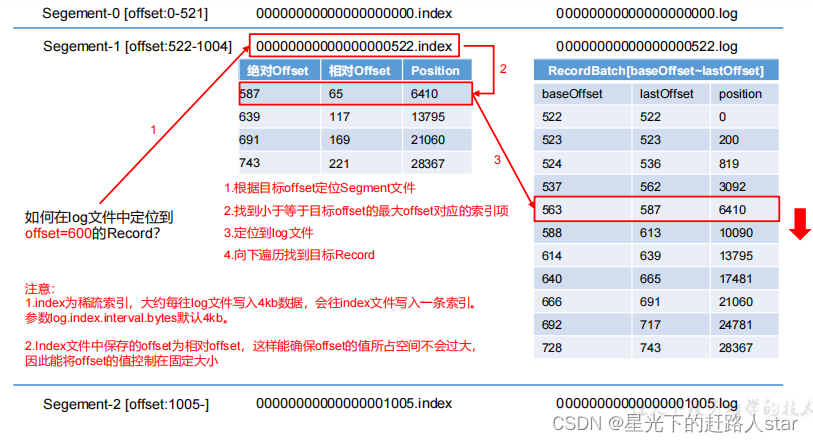

Topic是逻辑上的概念,而partition是物理上的概念,每个partition对应于一个log文件,该log文件中存储的就是Producer生产的数据。Producer生产的数据会被不断追加到该log文件末端,为防止log文件过大导致数据定位效率低下,Kafka采取了分片和索引机制,将每个partition分为多个segment。每个segment包括:“.index”文件、“.log”文件和.timeindex等文件。这些文件位于一个文件夹下,该文件夹的命名规则为:topic名称+分区序号,例如:first-0。

2、index文件和log文件详解

日志储存参数配置

| 参数 | 描述 |

|---|---|

| log.segment.bytes | Kafka 中 log 日志是分成一块块存储的,此配置是指 log 日志划分成块的大小,默认值 1G。 |

| log.index.interval.bytes | 默认 4kb,kafka 里面每当写入了 4kb 大小的日志(.log),然后就往 index 文件里面记录一个索引。 稀疏索引。 |

1.4.2 文件清理策略

Kafka 中默认的日志保存时间为 7 天,可以通过调整如下参数修改保存时间。

⚫ log.retention.hours,最低优先级小时,默认 7 天。

⚫ log.retention.minutes,分钟。

⚫ log.retention.ms,最高优先级毫秒。

⚫ log.retention.check.interval.ms,负责设置检查周期,默认 5 分钟。

那么日志一旦超过了设置的时间,怎么处理呢?

Kafka 中提供的日志清理策略有 delete 和 compact 两种。

1、delete 日志删除:将过期数据删除

⚫ log.cleanup.policy = delete 所有数据启用删除策略

(1)基于时间:默认打开。以 segment 中所有记录中的最大时间戳作为该文件时间戳。

(2)基于大小:默认关闭。超过设置的所有日志总大小,删除最早的 segment。

log.retention.bytes,默认等于-1,表示无穷大。

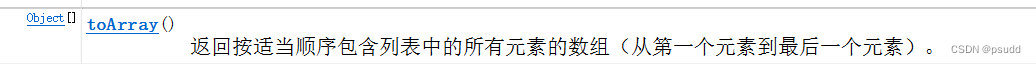

2、compact 日志压缩

compact日志压缩:对于相同key的不同value值,只保留最后一个版本。

⚫ log.cleanup.policy = compact 所有数据启用压缩策略

压缩后的offset可能是不连续的,比如上图中没有6,当从这些offset消费消息时,将会拿到比这个offset大

的offset对应的消息,实际上会拿到offset为7的消息,并从这个位置开始消费。

这种策略只适合特殊场景,比如消息的key是用户ID,value是用户的资料,通过这种压缩策略,整个消息

集里就保存了所有用户最新的资料。

1.5 高效读写数据

1、Kafka本身是分布式集群,可以采用分区技术,并行度高

2、读数据采用稀疏索引,可以快速定位要消费的数据

3、顺序写磁盘

Kafka 的 producer 生产数据,要写入到 log 文件中,写的过程是一直追加到文件末端,为顺序写。官网有数据表明,同样的磁盘,顺序写能到 600M/s,而随机写只有 100K/s。这与磁盘的机械机构有关,顺序写之所以快,是因为其省去了大量磁头寻址的时间。

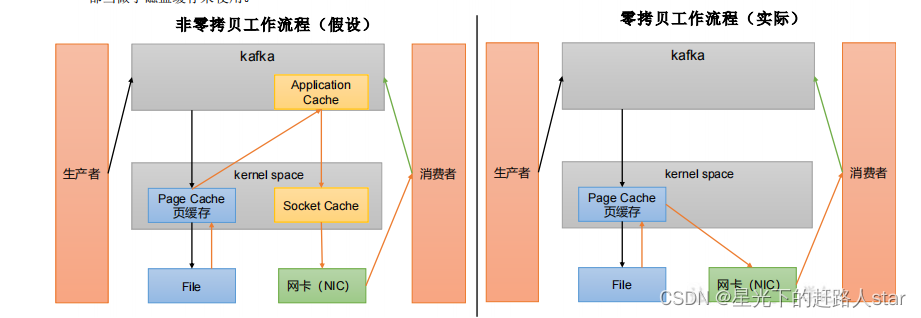

4、页缓存 + 零拷贝技术

零拷贝:Kafka的数据加工处理操作交由Kafka生产者和Kafka消费者处理。Kafka Broker应用层不关心存储的数据,所以就不用

走应用层,传输效率高。

PageCache页缓存:Kafka重度依赖底层操作系统提供的PageCache功 能。当上层有写操作时,操作系统只是将数据写入

PageCache。当读操作发生时,先从PageCache中查找,如果找不到,再去磁盘中读取。实际上PageCache是把尽可能多的空闲内存都当做了磁盘缓存来使用。

| 参数 | 描述 |

|---|---|

| log.flush.interval.messages | 强制页缓存刷写到磁盘的条数,默认是 long 的最大值,9223372036854775807。一般不建议修改,交给系统自己管理 |

| log.flush.interval.ms | 每隔多久,刷数据到磁盘,默认是 null。一般不建议修改,交给系统自己管理。 |