目录

- 感受野(Receptive Field)

- 上采样(upsampling)

- 下采样(subsampled)

- 残差网络(Resnet)

- 神经网络

- 人工神经网络(ANN)

- 卷积神经网络(CNN)

- 经典的卷积神经网络

- 循环神经网络或递归神经网络(RNN)

- LSTM

- 对抗神经网络(GAN)

- [孪生网络( Siamese Network)](http://t.csdn.cn/UMmOx)

- 语义分割

感受野(Receptive Field)

感受野的定义是卷积神经网络每一层输出的特征图(feature map)上的像素点在输入图片上映射的区域大小

参考:https://blog.csdn.net/program_developer/article/details/80958716

上采样(upsampling)

上采样:又名放大图像、图像插值;

主要目的是放大原图像,从而可以显示在更高分辨率的显示设备上;

上采样有3种常见的方法:双线性插值(bilinear),反卷积(Transposed Convolution),反池化(Unpooling);

插值算法还包括了传统插值,基于边缘图像的插值,还有基于区域的图像插值。

下采样(subsampled)

下采样:又名降采样、缩小图像;

主要目的有两个:1、使得图像符合显示区域的大小;2、生成对应图像的缩略图;

其实下采样就是池化;

残差网络(Resnet)

56层比20层要错误要高很多,那多的36层怎么搞,需要来进行同等映射,不能剔除,那就把有用的层保持,无用的层权重参数变成0

原来卷积结果+最初的,旧和新的相加,里面可能有白玩的,好的用,错的白玩,这样就能保证至少不比原来差

50层101层比较常见

神经网络

人工神经网络(ANN)

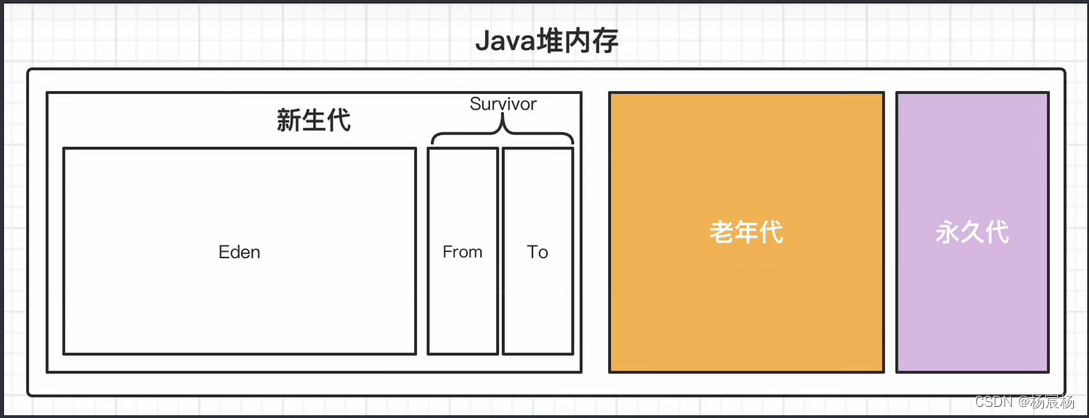

卷积神经网络(CNN)

卷积和池化层叠加实现对输入数据的特征提取,最后链接全连接层实现分类

对图像处理有出色表现,在计算机视觉中得到广泛应用

卷积神经网络:卷积层+池化层+全连接层

- 每个神经元只需要对 局部图像 进行感知

- 将在更高层将局部信息综合起来,得到全局信息

- 应用:图像分类、目标检测、目标跟踪、语义分割、实例分割等

经典的卷积神经网络

http://t.csdn.cn/k0wU5

- LeNet5:LeNet5是由Y.LeCun等人提出的,主要进行手写数字识别和英文字母识别。

- AlexNet

- VGG-16

- Inception Net

- ResNet(残差神经网络)

- DenseNet (密集网络)

- UNet

R-CNN系列:另外发展起来的

循环神经网络或递归神经网络(RNN)

在传统神经网络上改进的,有圈

输入——隐层——输出

在处理时间序列上有先天优势

CNN主要用来计算机视觉中,Rnn多用在自然语言处理中

http://t.csdn.cn/tc4wY

LSTM

rnn每一个都堪称同等重要,但是每一个重要性不同,此模型就是将不重要的淘汰

过滤信息

对抗神经网络(GAN)

一种用来学习类别特征的神经网络结构,主要由两部分组成,生成网络、判别网络

http://t.csdn.cn/VcQ9N

孪生网络( Siamese Network)

孪生网络最早用于验证支票上的签名与银行预留签名是否一致,后用于对比两个输入的相似度,随后又慢慢应用到目标跟踪领域。