文章目录

- 摘要

- 解决问题

- 贡献

- 方法

- LOSS

3D-3D对应

摘要

在这项工作中,我们提出了 FFB6D,这是一种全流双向融合网络,专为从单个 RGBD 图像进行 6D 姿态估计而设计。我们的主要见解是 RGB 图像中的外观信息和深度图像中的几何信息是两个互补的数据源,如何充分利用它们仍然未知。为此,我们提出了 FFB6D,它学习结合外观和几何信息进行表示学习以及输出表示选择。具体来说,在表示学习阶段,我们在两个网络的全流程中构建双向融合模块,将融合应用于每个编码和解码层。通过这种方式,两个网络可以利用来自另一个网络的局部和全局互补信息来获得更好的表示。此外,在输出表示阶段,我们设计了一个简单但有效的 3D 关键点选择算法,考虑了物体的纹理和几何信息,简化了关键点定位,以实现精确的姿态估计。

解决问题

- 作者认为先在RGB图像出估计初始位姿,再通过点云ICP(Posecnn)或multi-view hypothesis verification来优化非常耗时,而且使用不了端到端的RGB图像优化。

- 将RGB和点云分割开在某些情况下性能不佳(由于外观特征和几何特征是分开提取的,这两个网络无法通信和共享信息,从而限制了学习表示的表达能力。),比如具有相似外观或具有反射表面的物体,孤立的CNN和PCN对这种情况都识别不出太好的结果,但是融合方法应该1+1>2,而不是1+1=2。

贡献

- FFB6D网络

- 一些选定的关键点可能出现在不明显的区域,如光滑的表面,没有独特的纹理,因此很难定位。相反,我们将对象纹理和几何信息都考虑在内,并提出SIFT-FPS算法用于自动选择3D关键点。以这种方式过滤的显著关键点更易于网络定位,并有助于姿势估计性能。

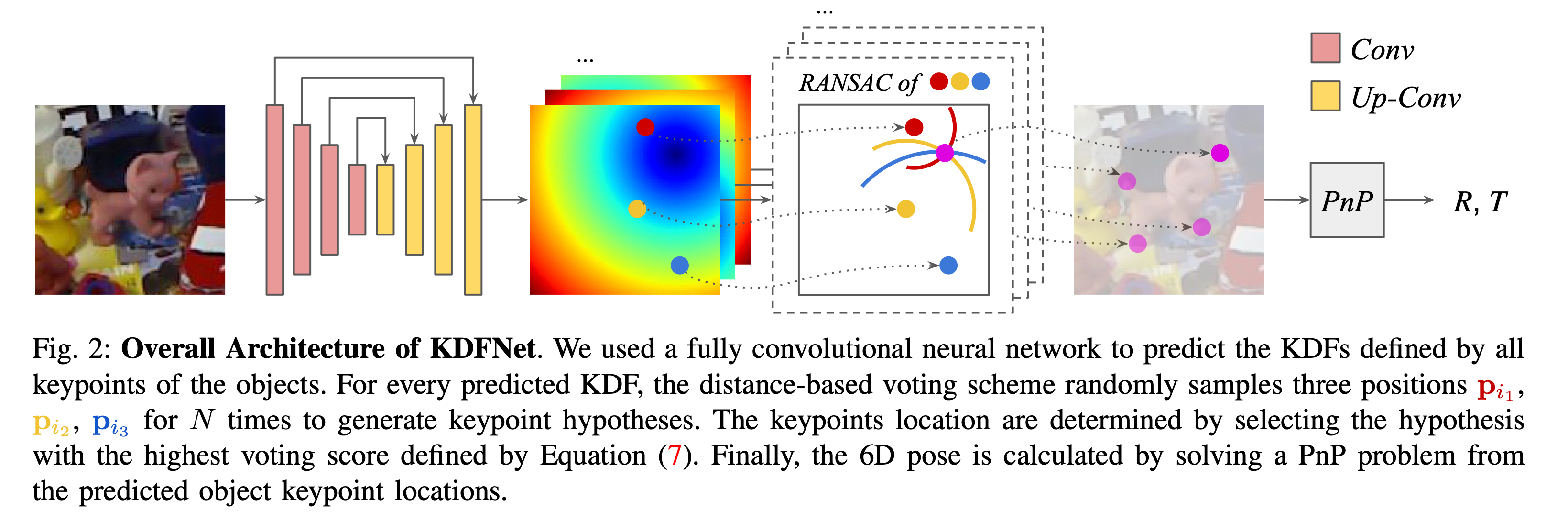

方法

FFB6D的主干。利用CNN和点云网络分别对RGB图像和点云进行表示学习。在两个网络的流程中,添加了双向融合模块作为通信桥。然后将提取的逐点特征输入实例语义分割和3D关键点投票模块,以获得逐对象3D关键点。最后,利用最小二乘拟合算法恢复姿态。

密集双向融合模块。

(1) 像素到点融合模块将RGB特征融合到点云特征。对于每个点,我们在XYZ地图中找到其 K r 2 p K_{r2p} Kr2p最近的邻居,并从RGB特征地图中收集其相应的外观特征。然后,通过最大池和共享MLP处理这些功能,以获得最重要的外观功能。最后,共享的MLP融合外观特征和几何特征的串联,以获得融合的点特征。

(2) 点对像素融合模块与点对点融合模块类似地获得融合像素特征

PVN3D中3D关键点选取方法的缺点

由于该算法仅考虑欧氏距离,因此选定的点可能出现在非显著区域,例如没有明显纹理的平面。这些点很难检测,估计姿态的精度降低。为了充分利用物体的纹理和几何信息,

我们提出了一种简单而有效的3D关键点选择算法SIFT-FPS。具体来说,我们使用SIFT算法检测纹理图像中不同的2D关键点,然后将其提升到3D。然后应用FPS算法选择其中的前N个关键点。这样,选定的关键点不仅均匀分布在对象表面上,而且纹理独特,易于检测。

LOSS

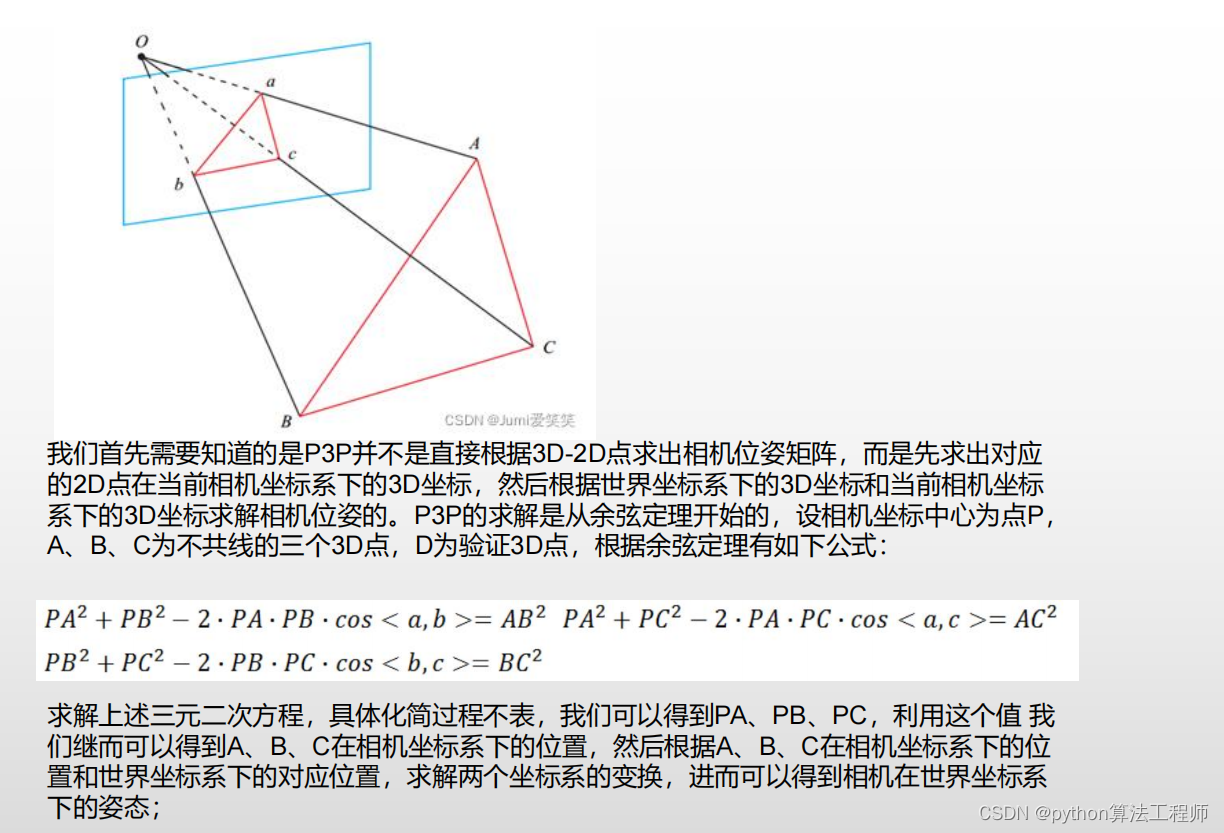

- p i ∗ : 是世界坐标下的 3 D 关键点; p_i^*:是世界坐标下的3D关键点; pi∗:是世界坐标下的3D关键点;

- p 是相机坐标系下的 3 D 关键点; p是相机坐标系下的3D关键点; p是相机坐标系下的3D关键点;