Practical and Secure Federated Recommendation with Personalized Mask | SpringerLink

摘要

联合推荐解决了推荐系统的数据筒仓和隐私问题。目前的联合推荐系统主要利用密码学或混淆方法来保护原始评分不被泄露。然而,前者带来了额外的通信和计算成本,后者损害了模型的准确性。它们都不能同时满足推荐系统的实时反馈和准确的个性化需求。在这项工作中,我们提出了联邦屏蔽矩阵分解(FedMMF),以保护联邦推荐系统中的数据隐私,而不牺牲效率和效果。在更多的细节,我们介绍了新的想法,个性化的面具只从本地数据生成,并将其应用在FedMMF。

一方面,个性化口罩为参与者的私人数据提供了保护,而不会损失有效性。

另一方面,结合自适应安全聚合协议,个性化掩码可以进一步提高效率。

从理论上分析了个性化口罩的安全性。经验上,我们还显示了所设计的模型在不同的现实世界的数据集上的优越性。

1 引言

联邦推荐系统(FedRec)是联邦学习在推荐场景中的重要应用[ 19]。近年来,联邦学习一直是一个快速发展的研究领域,它将私有数据保存在多方本地,并以安全和隐私保护的方式协同训练模型[ 13,14,20]。例如,[ 2]提出了一种联邦矩阵分解算法,该算法将训练过程分布在每个本地方,并将计算的梯度聚合在中央服务器上。隐私保护是联邦学习的主要挑战之一。与传统的数据中心培训方案相比,数据去中心化确实减轻了隐私风险。然而,在不同方之间传输的梯度仍然可能泄露用户隐私[3,23]。

为了解决隐私问题,当前的FedRec方法可以大致分为两类。第一类解决方案基于密码技术,例如同态加密(HE)[ 8]或安全多方计算(SMC)[ 21]。例如,基于HE的FedRec [ 6]利用HE来保护传输的梯度。这些方法可以导致无损模型性能。然而,它们产生额外的计算和通信成本,因为联邦学习需要大量的计算和中间结果交换。第二类解决方案利用混淆方法,例如差分隐私(DP)[ 7]。例如,基于DP的FedRec [ 10]旨在提供推荐服务,而不会泄露多个来源的数据隐私。虽然DP为基础的联邦算法是有效的,他们损害模型的准确性。因此,上述解决方案在应用于实际问题时都存在困难。 它们不能同时满足推荐系统(RecSys)的两个要求,即,个性化和实时性。

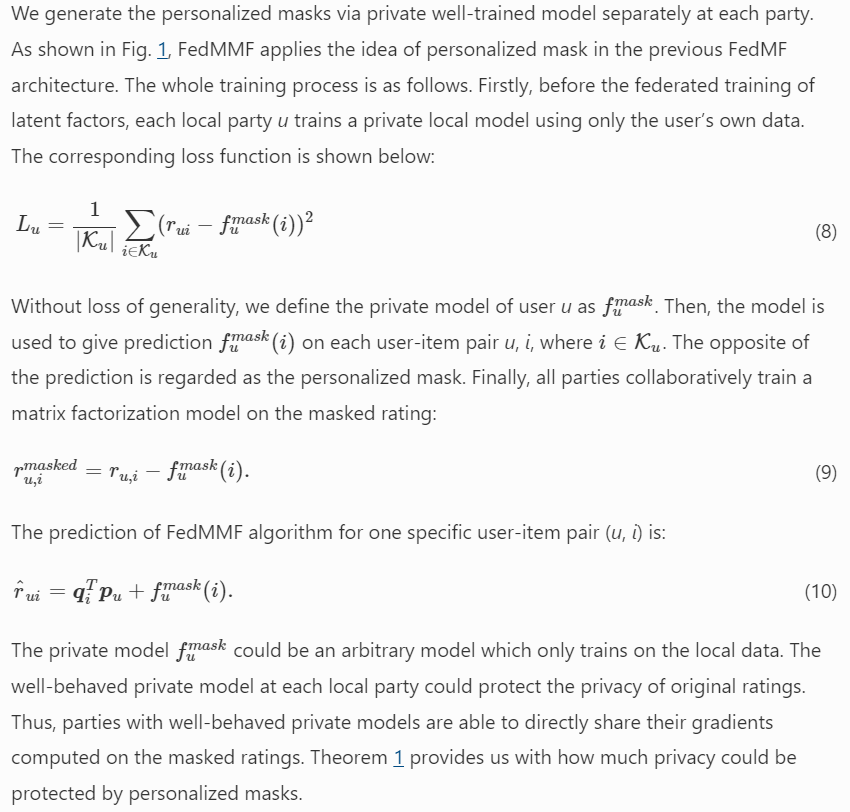

在这项工作中,我们提出了联邦掩码矩阵分解(FedMMF)作为一种新的FedRec方法。所设计的FedMMF方法可以在不牺牲效率和有效性的前提下保护FedRec的数据隐私。如图所示。1,我们在FedRec中引入了一种保护隐私数据不被泄露的新思想,而不是使用加密或混淆方法,这就是所谓的个性化掩码。个性化掩码是本地生成的掩码,其添加了原始数据以在不损失有效性的情况下保护隐私。在一个参与者的掩蔽评级上计算的梯度可以足够安全以直接与其他方共享。此外,结合自适应安全聚合协议,个性化掩码也进一步缓解了FedRec的效率问题。从理论和实验上,我们证明了FedMMF的优越性。

2 Preliminaries

联邦矩阵分解(FedMF)

在vanilla FedMF算法[ 2]中,所有项目潜在因素qi都保存在中央服务器上,

而每个用户的潜在因素 pu都保存在本地方。

训练过程如下并循环直到模型参数收敛:

1)u方从服务器下载项目i的潜在因素 qi ;

2)u方使用私有本地数据 ru 更新用户的潜在因素 pu;

3)u方计算每个项目的潜在因子 ηui=λ⋅qi−eui⋅pu与 ru和更新的 pu的梯度;

4)u方向服务器发送 ηui ;

5)服务器聚合梯度 ∑u∈U ηui并更新 qi。

Secure FedMF.

为了解决vanilla FedMF的梯度泄漏问题,已经提出了一些安全的FedMF算法。例如,基于HE的FedMF [ 6]和基于DP的FedMF [ 10]分别利用HE和DP来进一步保护隐私。基于HE的FedMF在将项目潜在因素的梯度传输到服务器之前用HE对项目潜在因素的梯度进行加密。然后,服务器对加密梯度进行安全聚合,更新密文状态的项目潜在因子,并将新的加密项目潜在因子分发给每个用户。以类似的方式,基于DP的FedMF在聚合之前向梯度添加噪声。然而,前者导致额外的成本,而后者导致精度损失。

3 联合掩蔽矩阵分解

3.1 Personalized Mask