引言

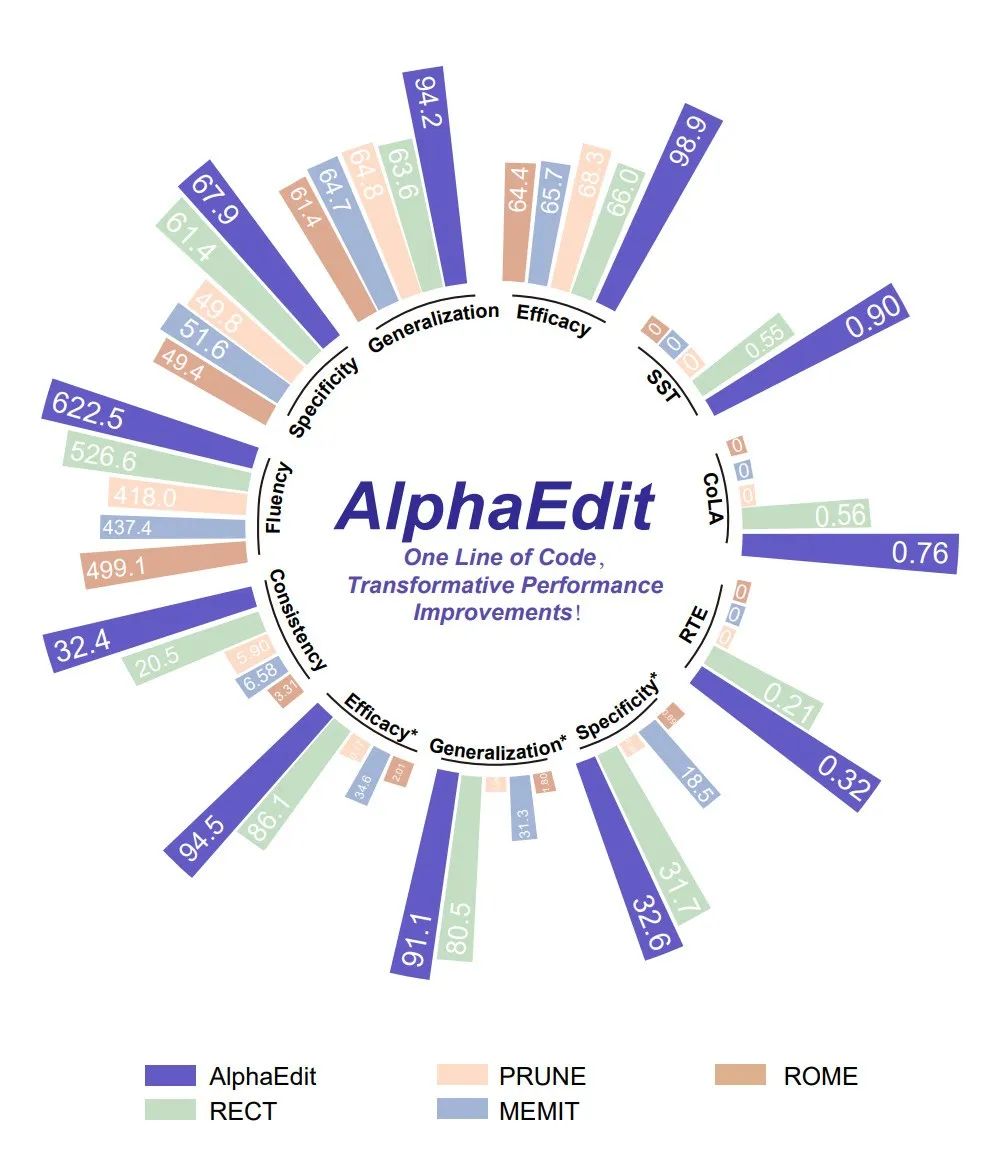

LLMs常因错误/过时知识产生幻觉,而基于新知识微调耗时且易过拟合、引入额外的知识库或参数模块又会带来不断增加的存储空间压力。因此,基于“Locate-then-Edit”的知识编辑(如ROME)被提出,用“少时间成本、零空间成本”来精准更新特定知识。在此基础上,中科大LDS Lab提出AlphaEdit,仅需在主流编辑方法中加入一行代码,便可暴涨LLaMA3在序列知识编辑任务上的表现,如下图。

图1:各类模型编辑方法在 LLaMA3(8B)上的表现。星号上标用于区别Counterfact数据集和 ZsRE 数据集。SST、RTE 和 CoLA 评估了编辑后模型的通用能力。

相关论文:

AlphaEdit: Null-Space Constrained Knowledge Editing for Language Models

论文链接:https://arxiv.org/abs/2410.02355

代码链接:https://github.com/jianghoucheng/AlphaEdit

Neuron-Level Sequential Editing for Large Language Models

论文链接:https://arxiv.org/pdf/2410.04045

代码链接:https://github.com/jianghoucheng/NSE

目录:1. 背景介绍 2. AlphaEdit 3. NSE

1.背景介绍

图2:当前方法与AlphaEdit的对比

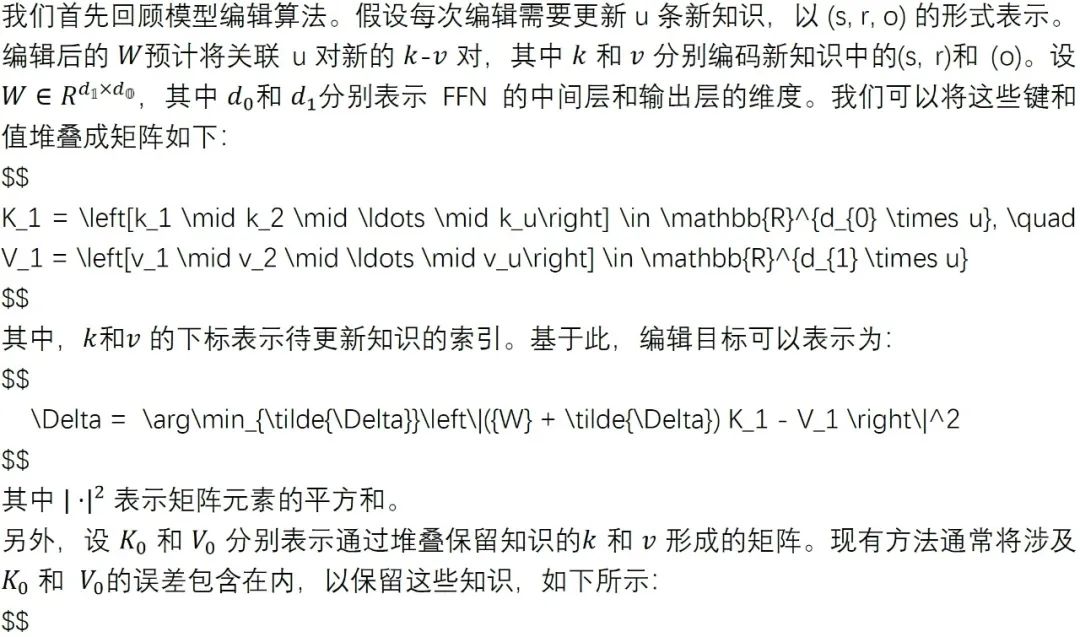

2. AlphaEdit

图3:AlphaEdit是如何通过一行代码实现效果激增的。

表1:各方法在编辑效果上的对比。

图4:各方法在模型通用能力上的对比。

3.NSE

此外,该团队提出的NSE从另一个角度:权重更新方式的角度尝试对序列编辑的效果进行优化。具体而言, NSE通过排序关键层中的神经元激活,选择性地收集“有影响力的神经元”来更新权重,而不是像以往的方法那样更新所有关键层的权重。这种选择性修改最大限度地保护了模型功能不被削弱。另外,对于包含大量神经元的大规模LLM,NSE引入了多层迭代编辑,以简化神经元选择过程,使其能够在单次编辑中有效地完成大规模知识更新。NSE从权重更新方式的角度,通过每次更新部分神经元来缓解持续知识编辑过程中的参数更新冲突和累计变化异常问题,其包括三个步骤:

步骤1:基于权重回溯的值向量计算

步骤2:神经元级别权重更新

步骤3:迭代多层编辑

非常推荐对序列编辑感兴趣的读者去阅读NSE的原文:https://arxiv.org/pdf/2410.04045。再次感谢大家的关注!

图 5:NSE流程图。(a)权重回溯, (b)神经元粒度权重更新,© 迭代编辑。

[1] Model editing harms general abilities of large language models: Regularization to the rescue.

[2] Perturbation-restrained sequential model editing.

[3] Training networks in null space of feature covariance for continual learning. CVPR 2021

如何学习大模型

现在社会上大模型越来越普及了,已经有很多人都想往这里面扎,但是却找不到适合的方法去学习。

作为一名资深码农,初入大模型时也吃了很多亏,踩了无数坑。现在我想把我的经验和知识分享给你们,帮助你们学习AI大模型,能够解决你们学习中的困难。

我已将重要的AI大模型资料包括市面上AI大模型各大白皮书、AGI大模型系统学习路线、AI大模型视频教程、实战学习,等录播视频免费分享出来,需要的小伙伴可以扫取。

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,我下面分享的这个学习路线希望能够帮助到你们学习AI大模型。

二、AI大模型视频教程

三、AI大模型各大学习书籍

四、AI大模型各大场景实战案例

五、结束语

学习AI大模型是当前科技发展的趋势,它不仅能够为我们提供更多的机会和挑战,还能够让我们更好地理解和应用人工智能技术。通过学习AI大模型,我们可以深入了解深度学习、神经网络等核心概念,并将其应用于自然语言处理、计算机视觉、语音识别等领域。同时,掌握AI大模型还能够为我们的职业发展增添竞争力,成为未来技术领域的领导者。

再者,学习AI大模型也能为我们自己创造更多的价值,提供更多的岗位以及副业创收,让自己的生活更上一层楼。

因此,学习AI大模型是一项有前景且值得投入的时间和精力的重要选择。