PyTorch 数据的准备

1. 生成数据的准备工作

import torch

import torch.utils.data as Data#准备建模数据

x = torch.unsqueeze(torch.linspace(-1, 1, 500), dim=1) # 生成列向量

y = x.pow(3) # y=x^3#设置超参数

batch_size = 15 # 分块大小

torch.manual_seed(10) # 设置种子点#设置数据加载器

dataset = Data.TensorDataset(x, y) # 通过 Data 对象构造数据集

loader = Data.DataLoader(dataset=dataset,batch_size=batch_size,shuffle=True,num_workers=2)for step, (batch_x, batch_y) in enumerate(loader):print(step,(batch_x.data.shape, batch_y.data.shape)) # 分批处理

0 (torch.Size([15, 1]), torch.Size([15, 1]))

1 (torch.Size([15, 1]), torch.Size([15, 1]))

2 (torch.Size([15, 1]), torch.Size([15, 1]))

3 (torch.Size([15, 1]), torch.Size([15, 1]))

4 (torch.Size([15, 1]), torch.Size([15, 1]))

5 (torch.Size([15, 1]), torch.Size([15, 1]))

6 (torch.Size([15, 1]), torch.Size([15, 1]))

7 (torch.Size([15, 1]), torch.Size([15, 1]))

8 (torch.Size([15, 1]), torch.Size([15, 1]))

9 (torch.Size([15, 1]), torch.Size([15, 1]))

10 (torch.Size([15, 1]), torch.Size([15, 1]))

11 (torch.Size([15, 1]), torch.Size([15, 1]))

12 (torch.Size([15, 1]), torch.Size([15, 1]))

13 (torch.Size([15, 1]), torch.Size([15, 1]))

14 (torch.Size([15, 1]), torch.Size([15, 1]))

15 (torch.Size([15, 1]), torch.Size([15, 1]))

16 (torch.Size([15, 1]), torch.Size([15, 1]))

17 (torch.Size([15, 1]), torch.Size([15, 1]))

18 (torch.Size([15, 1]), torch.Size([15, 1]))

19 (torch.Size([15, 1]), torch.Size([15, 1]))

20 (torch.Size([15, 1]), torch.Size([15, 1]))

21 (torch.Size([15, 1]), torch.Size([15, 1]))

22 (torch.Size([15, 1]), torch.Size([15, 1]))

23 (torch.Size([15, 1]), torch.Size([15, 1]))

24 (torch.Size([15, 1]), torch.Size([15, 1]))

25 (torch.Size([15, 1]), torch.Size([15, 1]))

26 (torch.Size([15, 1]), torch.Size([15, 1]))

27 (torch.Size([15, 1]), torch.Size([15, 1]))

28 (torch.Size([15, 1]), torch.Size([15, 1]))

29 (torch.Size([15, 1]), torch.Size([15, 1]))

30 (torch.Size([15, 1]), torch.Size([15, 1]))

31 (torch.Size([15, 1]), torch.Size([15, 1]))

32 (torch.Size([15, 1]), torch.Size([15, 1]))

33 (torch.Size([5, 1]), torch.Size([5, 1]))

2. 本地数据的准备工作

import torch

import numpy as np

import pandas as pd

import datetime

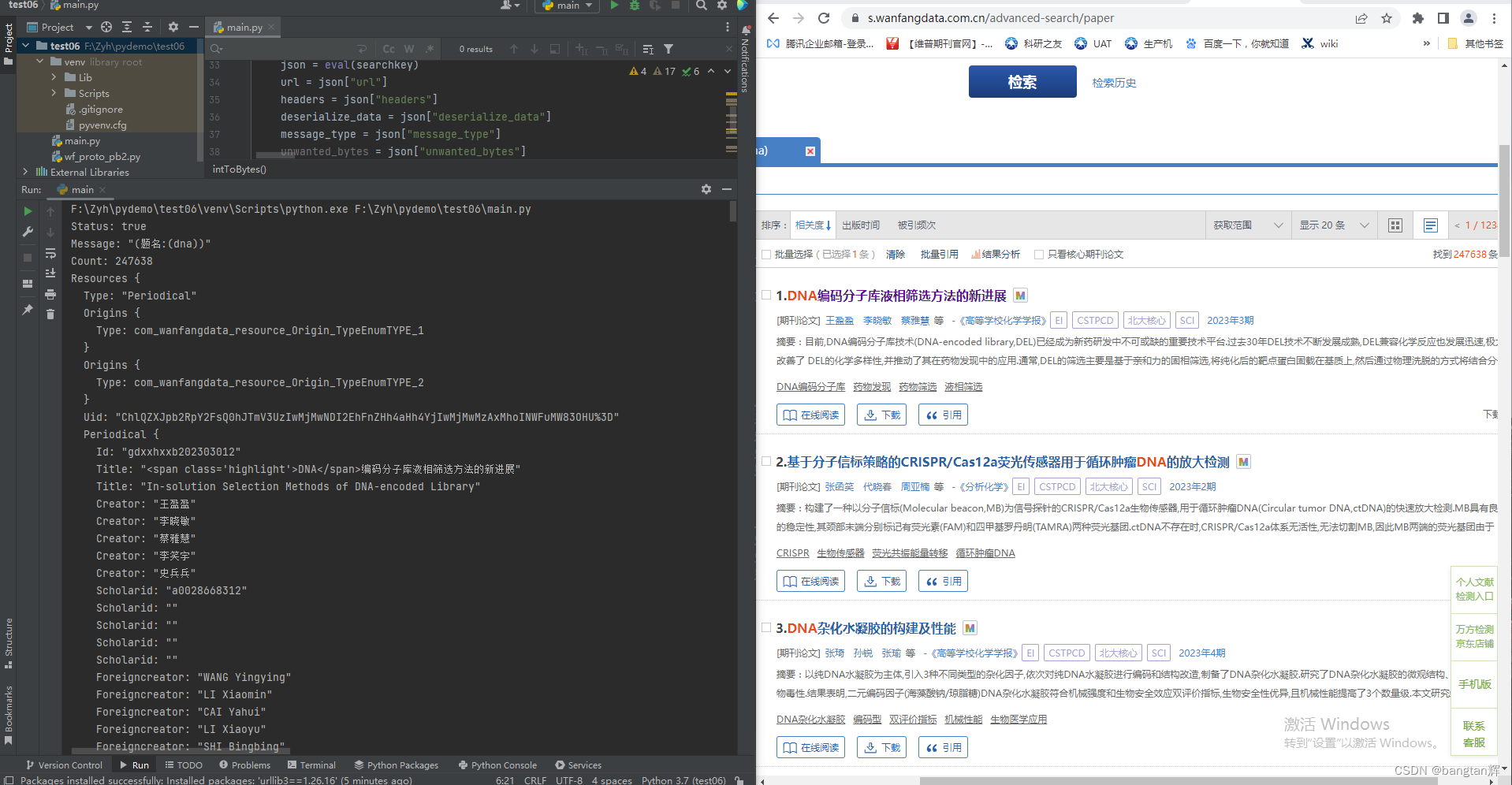

from sklearn import preprocessingfeatures = pd.read_csv('temps.csv')#标签,要预测的温度的真实值

labels = np.array(features['actual'])#在特征中去掉标签

features = features.drop('actual', axis=1)#训练集每列名字单独保存,留备用

feature_list = list(features.columns)#转换成合适的格式

features = np.array(features)

input_features = preprocessing.StandardScaler().fit_transform(features)batch_size = 8 # 设置每一批数据集的大小

step = 0for start in range(0, len(input_features), batch_size):end = start + batch_size if start + batch_size < len(input_features) else len(input_features)xx = torch.tensor(input_features[start:end], dtype=torch.float, requires_grad=True)yy = torch.tensor(labels[start:end], dtype=torch.float, requires_grad=True)print(step,(xx.data.shape,yy.data.shape))step = step + 1

0 (torch.Size([8, 6]), torch.Size([8]))

1 (torch.Size([8, 6]), torch.Size([8]))

2 (torch.Size([8, 6]), torch.Size([8]))

3 (torch.Size([6, 6]), torch.Size([6]))

3. 网络数据的准备工作

图像分类数据集Fashion-MNIST

import matplotlib.pyplot as plt

# 其中matplotlib包可用于作图,且设置成嵌入式

import torch

import torchvision #torchvision这个库 它是一Pytorch对于个计算机识别一些模型实现的一个库。

import torchvision.transforms as transforms #对数据进行操作的一个模具。

import matplotlib.pyplot as plt

import time

import sys

from IPython import display

获取数据集

"""

通过框架中的内置函数将Fashion-MNIST数据集下载并读取到内存中

通过ToTensor实例将图像数据从PLL类型变换成32位浮点数格式,最简单的一个预处理 transform=transforms.ToTensor()

"""# 训练数据集

#从torchvision中的datasets中将Fashion-MNIST数据集拿到;root是目录;train=True表示下载的是训练数据集;download=True表示确定从网上下载;

mnist_train = torchvision.datasets.FashionMNIST(root='./Datasets',train=True, download=False,transform=transforms.ToTensor())# 测试数据集

mnist_test = torchvision.datasets.FashionMNIST(root='./Datasets',train=False, download=False,transform=transforms.ToTensor())

# 上⾯的 mnist_train 和 mnist_test 都是 torch.utils.data.Dataset 的⼦类,所以我们可以⽤ len() 来获取该数据集的⼤⼩,还可以⽤下标来获取具体的⼀个样本。

print(type(mnist_train))

print(len(mnist_train), len(mnist_test))# 我们可以通过下标来访问任意一个样本

feature, label = mnist_train[0]

print(feature.shape, label)

# 变量feature对应的高和宽均为28像素的图像,输出显示的第一维是通道数,因为数据集是灰度图像,所以通道数为1,后面两维分别是图像的宽和高。

<class ‘torchvision.datasets.mnist.FashionMNIST’>

60000 10000

torch.Size([1, 28, 28]) 9

输出训练集中的10个样本的图像内容和文本标签

"""

Fashion-MNIST中⼀共包括了10个类别,分别为t-shirt(T恤)、trouser(裤⼦)、pullover(套衫)、

dress(连⾐裙)、coat(外套)、sandal(凉鞋)、shirt(衬衫)、sneaker(运动鞋)、

bag(包)和ankle boot(短靴)。以下函数可以将数值标签转成相应的⽂本标签。

"""

def get_fashion_mnist_labels(labels):text_lables = ['t-shirt', 'trouser', 'pullover', 'dress', 'coat','sandal', 'shirt', 'sneaker', 'bag', 'ankle boot']return [text_lables[int(i)] for i in labels]

#定义绘图函数

def use_svg_display():# 用矢量图显示display.set_matplotlib_formats('svg')def set_figsize(figsize=(3.5, 2.5)):use_svg_display()# 设置图的尺寸plt.rcParams['figure.figsize'] = figsize

# 下⾯定义⼀个可以在⼀⾏⾥画出多张图像和对应标签的函数。

def show_fashion_mnist(images, labels):use_svg_display()# 这⾥的_表示我们忽略(不使⽤)的变量_, figs = plt.subplots(1, len(images), figsize=(12, 12))for f, img, lbl in zip(figs, images, labels):f.imshow(img.view((28, 28)).numpy())f.set_title(lbl)f.axes.get_xaxis().set_visible(False)f.axes.get_yaxis().set_visible(False)plt.show()# 输出训练集中的10个样本的图像内容和文本标签

X, y = [], []

for i in range(10):X.append(mnist_train[i][0])y.append(mnist_train[i][1])

show_fashion_mnist(X, get_fashion_mnist_labels(y))

读取小批量

#num_work来设置4个进程读取数据

batch_size=256

if sys.platform.startswith('win'):num_workers=0 #0表示不用额外的进程来加速读取数据

else:num_workers=4

train_iter=torch.utils.data.DataLoader(mnist_train,batch_size=batch_size,shuffle=True,num_workers=num_workers)

test_iter=torch.utils.data.DataLoader(mnist_test,batch_size=batch_size,shuffle=True,#随机num_workers=num_workers) #短进程

#最后查看读取一遍训练数据需要的时间

start=time.time()

for X,y in train_iter:continue

print('%.2f sec'% (time.time()- start))