医学大模型开源项目: 医学大模型的局限性 + 改进思路

- GPT在医学上的优势:专业性凸显,实用性兼备

- 大模型在医学上的局限:问诊详细程度完全随机、推理和决策逻辑不完整、建议偏方向性实用性欠缺

- 方案一:海量相关数据 + GPT4 + 恐怖算力暴力

- 方案二:设置快慢双系统,快系统理解信息,慢系统辅助决策

- 【临床推理与鉴别诊断不充分】的问题与改进思路

- 【诊断辅助检查方案不准确】的问题与改进思路

- 【诊断逻辑与诊断不完整】的问题与改进思路

- 【治疗方案设计不全面】的问题与改进思路

- 知识图谱

- 医学指南

- 临床数据和决策逻辑

- 监管

- 医学大模型开源项目

GPT在医学上的优势:专业性凸显,实用性兼备

可得性启发,几乎适用于所有病情的【初步诊断】,尤其是【小众病,罕见病】,极大概率避免诊断错误(误诊、诊断过度、无效诊断)。

专业性凸显,实用性兼备。

大模型在医学上的局限:问诊详细程度完全随机、推理和决策逻辑不完整、建议偏方向性实用性欠缺

相当于家庭医生,但达不到专科要求。

这是医学数据微调的大模型,微调数据决定了做不到专科医生独立的、全流程的、完备的诊断。

大模型执行临床诊疗任务的四个问题:

【临床推理与鉴别诊断不充分】、【诊断辅助检查方案不准确】、【诊断逻辑与诊断不完整】、【治疗方案设计不全面】

方案一:海量相关数据 + GPT4 + 恐怖算力暴力

完备的推理能力,我只在 GPT4 上看过。

能玩超长的文字冒险游戏,还能得高分。

但我不确定这种推理能力能否胜任医学的全流程诊断。

更关键的是,GPT4微调、部署、数据安全、成本都有问题,这种方案不可行。

方案二:设置快慢双系统,快系统理解信息,慢系统辅助决策

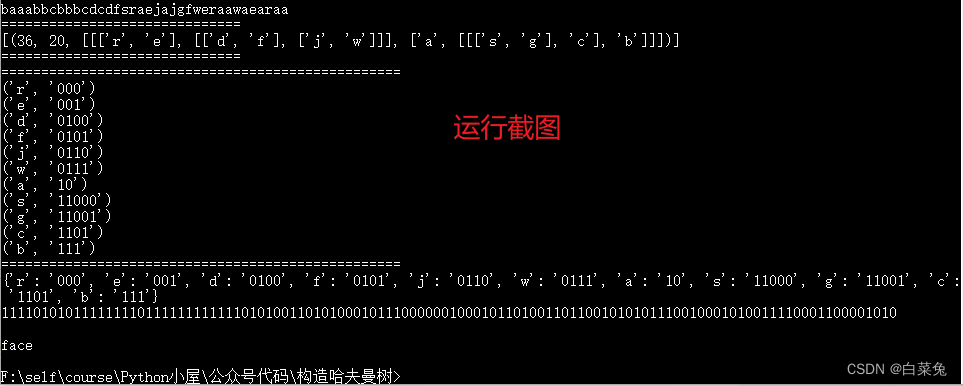

快系统是LLM,微调的医学大模型,功能是自然语义理解和对话、复杂的信息集成和洞察

慢系统是临床知识图谱 + 文本向量库,功能是医疗决策逻辑、最新医学知识

设置独立的临床推理算法,因子与参数独立存储,每条都经过医学指南、三甲医生验证

【临床推理与鉴别诊断不充分】涉及要素:重要既往史、一般情况、诊治经过、主要症状特点、病情发展与演变、病因与诱因、伴随症状、相关基础病、既往诊治、起病时间和起病情况

【诊断辅助检查方案不准确】涉及要素:必要证据、可能证据、充分证据、排除证据,完善辅助检查推荐逻辑

【诊断逻辑与诊断分型不完整】涉及要素:确诊标准(正向因子+排除其他相关主要疾病因子),对每种疾病根据症状匹配诊断推断公式

【治疗方案设计不全面】涉及要素:接确诊后,必须有实用性(药物治疗方案、一般治疗、随访计划)

【临床推理与鉴别诊断不充分】的问题与改进思路

医学大模型问题,如下:

- 偏离主诉和没抓住核心,顶级医生发现用户问题会一追到底,而不是跟随用户关注无关内容,单纯理解对一句话是毫无意义

- 缺症状细节、缺鉴别内容,只能问患者有什么症状,不能自己主动猜有什么问题(反问和求证)

- 逻辑顺序错乱

- 与问诊内容无关

- 错误内容

- 思路过窄未考虑到

- 诊断范围过宽,冗余输出

- 缺主要诊断

- 缺重要合并诊诊断

- 缺并发症诊断

- 未关联并发症

- 主次顺序错误

- 分型错误

- 缺原发病诊断

不足:大模型问诊不稳定,导致有的信息获取不全

改进:临床知识图谱 + 文本向量库,把临床规则放入向量库,辅助问诊获取全面的信息

【诊断辅助检查方案不准确】的问题与改进思路

医学大模型问题,如下:

- 缺确诊检查项、缺鉴别检查项

- 检查无依据、无关、相关度低

- 有错误

- 检查非常规、普及性低

- 检查重复(CT、MRI、X线)

【诊断辅助检查方案不准确】涉及要素:必要证据、可能证据、充分证据、排除证据,完善辅助检查推荐逻辑。

【诊断逻辑与诊断不完整】的问题与改进思路

医学大模型问题,如下:

- 缺进一步检查建议

- 过于宽泛

- 缺相项问题解读

不足:模糊、宽泛、方向性建议

改进:结合教科书、临床指南、临床思维,结构化存储到决策系统中,实现精准医疗

【治疗方案设计不全面】的问题与改进思路

医学大模型问题,如下:

- 诊断不清楚就推荐治疗

- 方向性错误、无适应症、无依据、无评估

- 推荐已用过效果不好的药

- 用药不全面

- 存在明确禁忌

- 优先顺序错误

- 缺病因治疗

- 其他治疗不全面

- 治疗不合适疾病分期

- 手术不全面

- 重复开同类药物

- 复杂病重没有请多学科会诊

- 复查周期过长

不足:实用性欠缺,偏方向性

改进:结合教科书、临床指南、临床思维,结构化存储到决策系统中,实现精准医疗(不同疾病的分期、分型下,诊断方法的适用条件、成本、风险、收益综合分析)

知识图谱

知识图谱 = 实体 + 关系

实体:现实世界存在的事物,如小明、小强

关系:实体之间的关系,如朋友

三元组:实体、实体、关系

黎明-电话-xxx,黎明-年龄-20,黎明-朋友-张三

实体识别、实体抽取、关系抽取、实体统一、实体消歧(如苹果是水果,还是公司)

{'age': 25,'location': 'beijing'

}

医学指南

从医学教材、指南上抽取诊断逻辑、治疗方案。

全世界的大部分地方的医生,对于绝大多数的常见病,是当着病人的面查怎么治病。

看到主治医生查房的时候,每个小医生人手一个Pad。主治医生说到一个病的时候,每个医生赶紧查,然后按照Pad上面说的给病人开药。

他们在查临床诊治指南:

- 针对特定的临床情况,系统制订出的帮助临床医生和患者做出恰当处理的推荐意见。

去医院治疗普遍的问题,担心自己接受的治疗是不是最好的?医生的水平如何?会不会技术不行?会不会因为想挣钱,过度医疗?

指南就是解决所有这些问题的。

它是一套标准化的方案,对医生治病的每一个环节都有建议。

比如,怎么检查、怎么治疗、怎么手术、怎么用药、剂量多少、联合用什么药。几乎所有的常见病都有这么细的指南。

同时,对于同一种病,不论这种病有多简单,都会用到多个不同的指南。

就拿阑尾炎这种外科医生入门级的手术来说,也至少要用到4个指南。

麻醉有《麻醉学操作指南》;手术有《阑尾炎诊治指南》;术后要用到《抗菌药物在围手术期的预防应用指南》;如果感染严重,还会用到《抗菌药物临床应用指南》。

再比如,冠心病的病人,可能要用到至少10个指南。包括《高血压管理指南》、《中国心血管病预防指南》等等。

指南就是这么重要。它几乎涵盖到了临床上所有的常见病,以及常见病里所有的类型。

一个医生规范地应用指南,就可以保证病的基本治疗。

指南是最基础、最标准、最规范的方案。

按照这个方案做,就可以避免不同操作者的水平差异带来的治疗差异,还能保证效果、降低风险。

而且制定指南用到的科学方法,是医学上最讲证据的方法 — 循证医学。

循证,也就是让证据说话,把证据转化为最好的临床指导建议。

把世界上治疗这个病全部的、最好的证据拿来评估,并根据这些证据制定治疗建议。

而且不断地升级迭代,保证了指南的前沿性和时效性。

永远是利用最新的证据,给病人制定治疗方案。

临床数据和决策逻辑

指南只能保证已知问题的情况,最佳流程。

但在治疗中,其实要面对巨大的不确性。

一个学生游泳被溺,送过来的时候一个心跳电信号都没有。

按照指南按压100-120 次 / 分,出现了几个微弱的电信号,再提升他的心率,但心率紊乱。

接下来呢,指南没有?

是先升血压呢?还是先维持这种紊乱的心律呢?或者是用药物纠正这个心律呢?

这些都需要具体情况具体分析,需要临床数据和决策逻辑。

监管

在2022年,国家卫生健康委办公厅、国家中医药局办公室联合制定的《互联网诊疗监管细则(试行)》文件中,

针对主体、业务活动、互联网诊疗质量及安全方面提出了明确监管要求,其中就强调了:

处方必须由接诊医师本人开具,严禁使用人工智能等自动生成处方。

处方药应当凭医师处方销售、调剂和使用。

处方药的意思是,必须有医生开的方才能拿到的药,因为这些药有很强副作用。

而非处方药是可以的,其实大部分模型报的药名都是非处方药。

比如糖尿病的二甲双胍,在硅谷不是糖尿病也会吃,在硅谷,吃二甲双胍已经成了一种风尚,这个 open AI 的创始人山姆奥特曼都在吃。

因为ta能模拟少吃的效果,少吃寿命就长,当然我不推荐正常人吃,临床试验还在进行,可能有副作用。

医学大模型开源项目

根据以上思路,长期迭代医学大模型项目:https://github.com/DebroonAir/MedLLM.git