1.Paddle飞桨设计之“道”

当读者使用飞桨框架编写多个深度学习模型后,会发现程序呈现出“八股文”的形态。即不同的程序员、使用不同模型、解决不同任务的时候,他们编写的建模程序是极其相似的。虽然这些设计在某些“极客”的眼里缺乏精彩,但从实用性的角度,我们更期望建模者聚焦需要解决的任务,而不是将精力投入在框架的学习上。因此使用飞桨编写模型是有标准的套路设计的,只要通过一个示例程序掌握使用飞桨的方法,编写不同任务的多种建模程序将变得十分容易。

这点与Python的设计思想一致:对于某个特定功能,并不是实现方式越灵活、越多样越好,最好只有一种符合“道”的最佳实现。此处“道”指的是如何更加匹配人的思维习惯。当程序员第一次看到Python的多种应用方式时,感觉程序天然就应该如此实现。但不是所有的编程语言都具备这样合“道”的设计,很多编程语言的设计思路是人需要去理解机器的运作原理,而不能以人类习惯的方式设计程序。同时,灵活意味着复杂,会增加程序员之间的沟通难度,也不适合现代工业化生产软件的趋势。

飞桨设计的初衷不仅要易于学习,还期望使用者能够体会到它的美感和哲学,与人类最自然的认知和使用习惯契合。

2. 使用Paddle飞桨实现波士顿房价预测任务

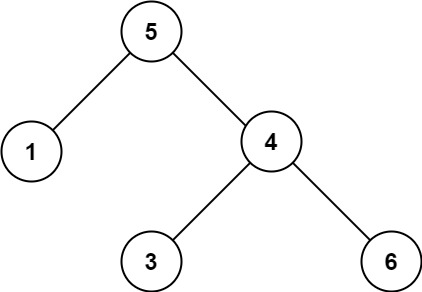

本案例覆盖计算机视觉、自然语言处理和推荐系统等主流应用场景,使用飞桨实现这些案例的流程基本一致,如 图1 所示。

在我上一篇文章中,我们学习了使用Python和NumPy实现波士顿房价预测任务的方法,本章我们将尝试使用飞桨重写房价预测任务,体会二者的异同。在数据处理之前,需要先加载飞桨框架的相关类库。

#加载飞桨、NumPy和相关类库

import paddle

from paddle.nn import Linear

import paddle.nn.functional as F

import numpy as np

import os

import random

代码中参数含义如下:

- paddle:飞桨的主库,paddle 根目录下保留了常用API的别名,当前包括:paddle.tensor、paddle.framework、paddle.device目录下的所有API;

- Linear:神经网络的全连接层函数,包含所有输入权重相加的基本神经元结构。在房价预测任务中,使用只有一层的神经网络(全连接层)实现线性回归模型。

- paddle.nn:组网相关的API,包括 Linear、卷积 Conv2D、循环神经网络LSTM、损失函数CrossEntropyLoss、激活函数ReLU等;

- paddle.nn.functional:与paddle.nn一样,包含组网相关的API,如:Linear、激活函数ReLU等,二者包含的同名模块功能相同,运行性能也基本一致。 差别在于paddle.nn目录下的模块均是类,每个类自带模块参数;paddle.nn.functional目录下的模块均是函数,需要手动传入函数计算所需要的参数。在实际使用时,卷积、全连接层等本身具有可学习的参数,建议使用paddle.nn;而激活函数、池化等操作没有可学习参数,可以考虑使用paddle.nn.functional。

说明:

飞桨支持两种深度学习建模编写方式,更方便调试的动态图模式和性能更好并便于部署的静态图模式。

- 动态图模式(命令式编程范式,类比Python):解析式的执行方式。用户无需预先定义完整的网络结构,每写一行网络代码,即可同时获得计算结果;

- 静态图模式(声明式编程范式,类比C++):先编译后执行的方式。用户需预先定义完整的网络结构,再对网络结构进行编译优化后,才能执行获得计算结果。

飞桨框架2.0及之后的版本,默认使用动态图模式进行编码,同时提供了完备的动转静支持,开发者仅需添加一个装饰器( to_static ),飞桨会自动将动态图的程序转换为静态图的program,并使用该program训练并可保存静态模型以实现推理部署。

附:Paddle 1.8 与 Paddle 2.0 API 映射表

2.1 数据处理

数据处理的代码不依赖框架实现,与使用Python构建房价预测任务的代码相同,详细解读请参考波士顿房价预测——机器学习入门级案例章节,这里不再赘述。

def load_data():# 从文件导入数据datafile = './work/housing.data'data = np.fromfile(datafile, sep=' ', dtype=np.float32)# 每条数据包括14项,其中前面13项是影响因素,第14项是相应的房屋价格中位数feature_names = [ 'CRIM', 'ZN', 'INDUS', 'CHAS', 'NOX', 'RM', 'AGE', \'DIS', 'RAD', 'TAX', 'PTRATIO', 'B', 'LSTAT', 'MEDV' ]feature_num = len(feature_names)# 将原始数据进行Reshape,变成[N, 14]这样的形状data = data.reshape([data.shape[0] // feature_num, feature_num])# 将原数据集拆分成训练集和测试集# 这里使用80%的数据做训练,20%的数据做测试# 测试集和训练集必须是没有交集的ratio = 0.8offset = int(data.shape[0] * ratio)training_data = data[:offset]# 计算train数据集的最大值,最小值maximums, minimums = training_data.max(axis=0), training_data.min(axis=0)# 记录数据的归一化参数,在预测时对数据做归一化global max_valuesglobal min_valuesmax_values = maximumsmin_values = minimums# 对数据进行归一化处理for i in range(feature_num):data[:, i] = (data[:, i] - min_values[i]) / (maximums[i] - minimums[i])# 训练集和测试集的划分比例training_data = data[:offset]test_data = data[offset:]return training_data, test_data

# 验证数据集读取程序的正确性

training_data, test_data = load_data()

print(training_data.shape)

print(training_data[1,:])

结果如下:

(404, 14)

[2.35922547e-04 0.00000000e+00 2.62405723e-01 0.00000000e+00

1.72839552e-01 5.47997713e-01 7.82698274e-01 3.48961979e-01

4.34782617e-02 1.14822544e-01 5.53191364e-01 1.00000000e+00

2.04470202e-01 3.68888885e-01]

2.2 模型设计

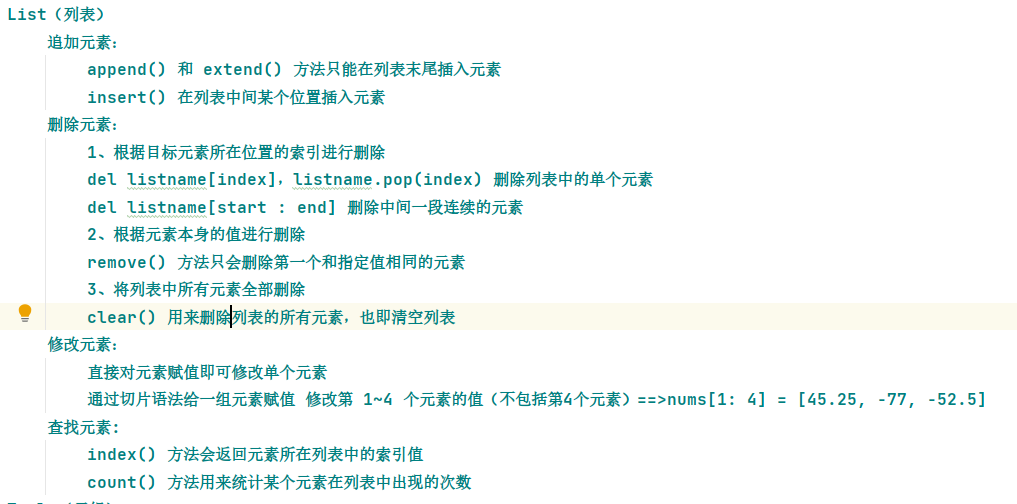

模型定义的实质是定义线性回归的网络结构,飞桨建议通过创建Python类的方式完成模型网络的定义,该类需要继承paddle.nn.Layer父类,并且在类中定义init函数和forward函数。forward函数是框架指定实现前向计算逻辑的函数,程序在调用模型实例时会自动执行,forward函数中使用的网络层需要在init函数中声明。

- 定义init函数:在类的初始化函数中声明每一层网络的实现函数。在房价预测任务中,只需要定义一层全连接层,模型结构和波士顿房价预测——机器学习入门级案例章节保持一致;

- 定义forward函数:构建神经网络结构,实现前向计算过程,并返回预测结果,在本任务中返回的是房价预测结果。

class Regressor(paddle.nn.Layer):# self代表类的实例自身def __init__(self):# 初始化父类中的一些参数super(Regressor, self).__init__()# 定义一层全连接层,输入维度是13,输出维度是1self.fc = Linear(in_features=13, out_features=1)# 网络的前向计算def forward(self, inputs):x = self.fc(inputs)return x

2.3 训练配置

训练配置过程如 图2 所示:

- 本教程默认使用AI Studio训练模型,因此无需指定机器资源;

- 声明定义好的回归模型实例为Regressor,并将模型的状态设置为train;

- 使用load_data函数加载训练数据和测试数据;

- 设置优化算法和学习率,优化算法采用随机梯度下降SGD,学习率设置为0.01。

# 声明定义好的线性回归模型

model = Regressor()

# 开启模型训练模式

model.train()

# 加载数据

training_data, test_data = load_data()

# 定义优化算法,使用随机梯度下降SGD

# 学习率设置为0.01

opt = paddle.optimizer.SGD(learning_rate=0.01, parameters=model.parameters())

说明:

模型实例有两种状态:训练状态.train()和预测状态.eval()。训练时要执行正向计算和反向传播梯度两个过程,而预测时只需要执行正向计算,为模型指定运行状态,有两点原因:

- 部分高级的算子在两个状态执行的逻辑不同,如:Dropout和BatchNorm(在后续的“计算机视觉”章节会详细介绍);

- 从性能和存储空间的考虑,预测状态时更节省内存(无需记录反向梯度),性能更好。

在“波士顿房价预测——机器学习入门级案例”的章节中,我们已经为实现梯度下降编写了大量代码,而使用飞桨框架只需要设置SGD函数的参数并调用,即可实现优化器设置,大大简化了这个过程。

2.4 训练过程

训练过程采用二层循环嵌套方式:

- 内层循环: 负责整个数据集的一次遍历,采用分批次方式(batch)。假设数据集样本数量为1000,一个批次有10个样本,则遍历一次数据集的批次数量是1000/10=100,即内层循环需要执行100次。

for iter_id, mini_batch in enumerate(mini_batches):

- 外层循环: 定义遍历数据集的次数,通过参数EPOCH_NUM设置。

for epoch_id in range(EPOCH_NUM):

说明:

batch的取值会影响模型训练效果,batch过大,会增大内存消耗和计算时间,且训练效果并不会明显提升(每次参数只向梯度反方向移动一小步,因此方向没必要特别精确);batch过小,每个batch的样本数据没有统计意义,计算的梯度方向可能偏差较大。由于房价预测模型的训练数据集较小,因此将batch设置为10。

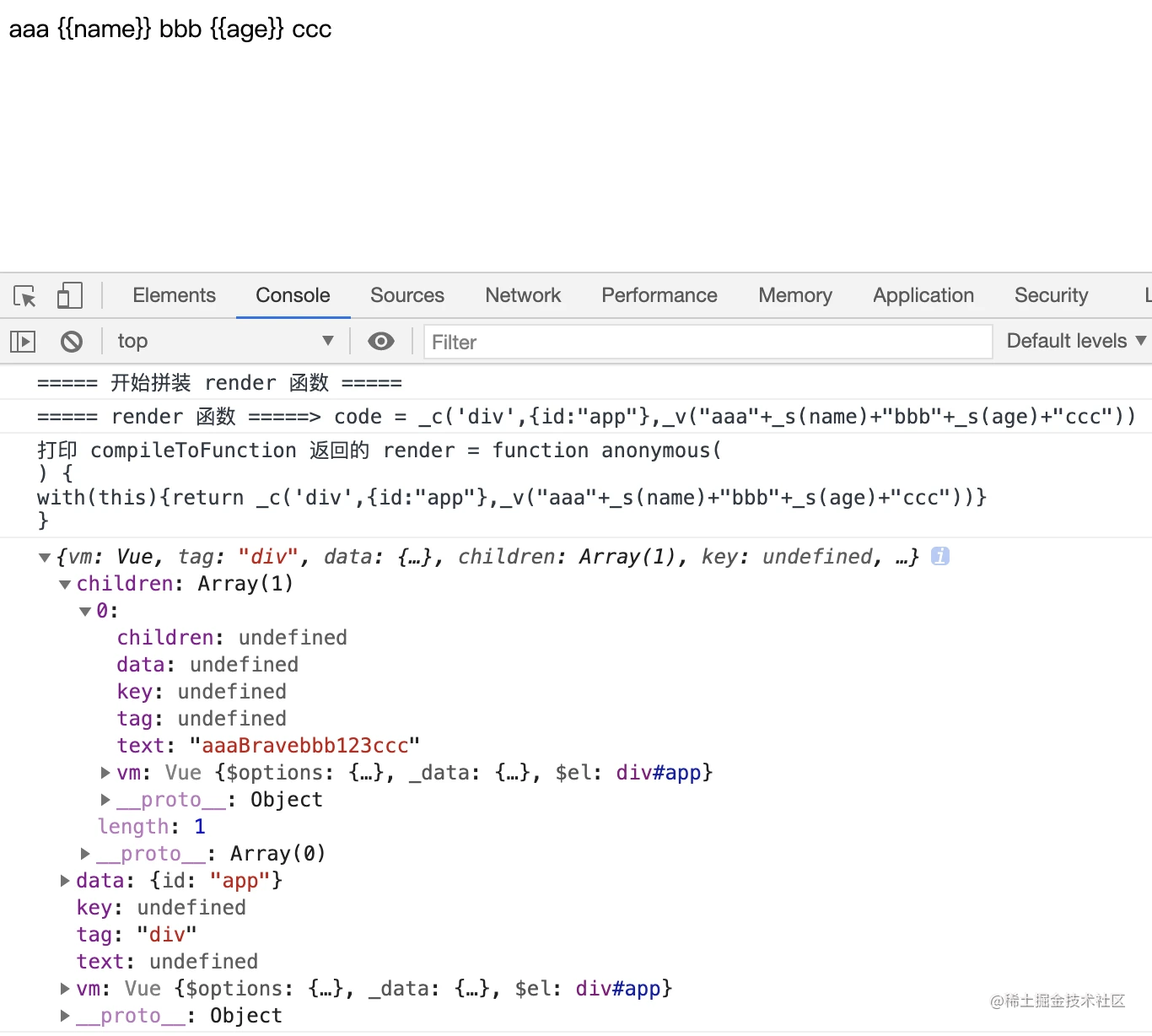

每次内层循环都需要执行如 图3 所示的步骤,计算过程与使用Python编写模型完全一致。

- 数据准备:将一个批次的数据先转换成nparray格式,再转换成Tensor格式;

- 前向计算:将一个批次的样本数据灌入网络中,计算输出结果;

- 计算损失函数:以前向计算结果和真实房价作为输入,通过损失函数square_error_cost API计算出损失函数值(Loss)。飞桨所有的API接口都有完整的说明和使用案例,可以登录飞桨官网API文档获取;

- 反向传播:执行梯度反向传播backward函数,即从后到前逐层计算每一层的梯度,并根据设置的优化算法更新参数(opt.step函数)。

EPOCH_NUM = 10 # 设置外层循环次数

BATCH_SIZE = 10 # 设置batch大小# 定义外层循环

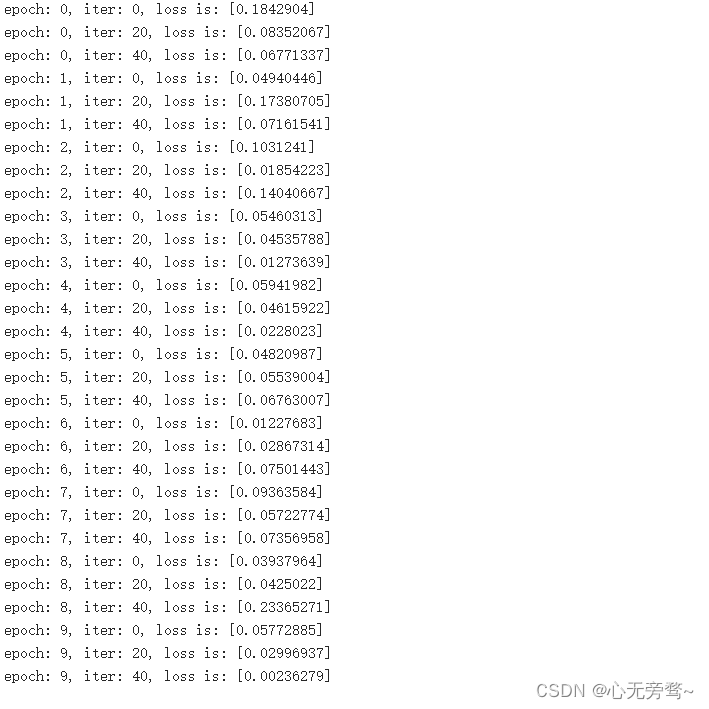

for epoch_id in range(EPOCH_NUM):# 在每轮迭代开始之前,将训练数据的顺序随机的打乱np.random.shuffle(training_data)# 将训练数据进行拆分,每个batch包含10条数据mini_batches = [training_data[k:k+BATCH_SIZE] for k in range(0, len(training_data), BATCH_SIZE)]# 定义内层循环for iter_id, mini_batch in enumerate(mini_batches):x = np.array(mini_batch[:, :-1]) # 获得当前批次训练数据y = np.array(mini_batch[:, -1:]) # 获得当前批次训练标签(真实房价)# 将numpy数据转为飞桨动态图tensor的格式house_features = paddle.to_tensor(x)prices = paddle.to_tensor(y)# 前向计算predicts = model(house_features)# 计算损失loss = F.square_error_cost(predicts, label=prices)avg_loss = paddle.mean(loss)if iter_id%20==0:print("epoch: {}, iter: {}, loss is: {}".format(epoch_id, iter_id, avg_loss.numpy()))# 反向传播,计算每层参数的梯度值avg_loss.backward()# 更新参数,根据设置好的学习率迭代一步opt.step()# 清空梯度变量,以备下一轮计算opt.clear_grad()

这个实现过程令人惊喜,前向计算、计算损失和反向传播梯度,每个操作只需要1~2行代码即可实现!飞桨已经帮助我们自动实现了反向梯度计算和参数更新的过程,不再需要逐一编写代码,这就是使用飞桨框架的威力!

2.5 保存并测试模型

2.5.1 保存模型

使用paddle.save API将模型当前的参数数据 model.state_dict() 保存到文件中,用于模型预测或校验的程序调用。

# 保存模型参数,文件名为LR_model.pdparams

paddle.save(model.state_dict(), 'LR_model.pdparams')

print("模型保存成功,模型参数保存在LR_model.pdparams中")

模型保存成功,模型参数保存在LR_model.pdparams中

说明:

为什么要执行保存模型操作,而不是直接使用训练好的模型进行预测?理论而言,直接使用模型实例即可完成预测,但是在实际应用中,训练模型和使用模型往往是不同的场景。模型训练通常使用大量的线下服务器(不对外向企业的客户/用户提供在线服务);模型预测则通常使用线上提供预测服务的服务器实现或者将已经完成的预测模型嵌入手机或其他终端设备中使用。因此本教程中“先保存模型,再加载模型”的讲解方式更贴合真实场景的使用方法。

2.5.2 测试模型

下面选择一条数据样本,测试下模型的预测效果。测试过程和在应用场景中使用模型的过程一致,主要可分成如下三个步骤:

- 配置模型预测的机器资源。本案例默认使用本机,因此无需写代码指定。

- 将训练好的模型参数加载到模型实例中。由两个语句完成,第一句是从文件中读取模型参数;第二句是将参数内容加载到模型。加载完毕后,需要将模型的状态调整为eval()(校验)。上文中提到,训练状态的模型需要同时支持前向计算和反向传导梯度,模型的实现较为臃肿,而校验和预测状态的模型只需要支持前向计算,模型的实现更加简单,性能更好。

- 将待预测的样本特征输入到模型中,打印输出的预测结果。

通过load_one_example函数实现从数据集中抽一条样本作为测试样本,具体实现代码如下所示。

def load_one_example():# 从上边已加载的测试集中,随机选择一条作为测试数据idx = np.random.randint(0, test_data.shape[0])idx = -10one_data, label = test_data[idx, :-1], test_data[idx, -1]# 修改该条数据shape为[1,13]one_data = one_data.reshape([1,-1])return one_data, label

# 参数为保存模型参数的文件地址

model_dict = paddle.load('LR_model.pdparams')

model.load_dict(model_dict)

model.eval()# 参数为数据集的文件地址

one_data, label = load_one_example()

# 将数据转为动态图的variable格式

one_data = paddle.to_tensor(one_data)

predict = model(one_data)# 对结果做反归一化处理

predict = predict * (max_values[-1] - min_values[-1]) + min_values[-1]

# 对label数据做反归一化处理

label = label * (max_values[-1] - min_values[-1]) + min_values[-1]print("Inference result is {}, the corresponding label is {}".format(predict.numpy(), label))

Inference result is [[20.991867]], the corresponding label is 19.700000762939453

通过比较“模型预测值”和“真实房价”可见,模型的预测效果与真实房价接近。房价预测仅是一个最简单的模型,使用飞桨编写均可事半功倍。那么对于工业实践中更复杂的模型,使用飞桨节约的成本是不可估量的。同时飞桨针对很多应用场景和机器资源做了性能优化,在功能和性能上远强于自行编写的模型。

完整代码

# 加载飞桨、NumPy和相关类库

import paddle

from paddle.nn import Linear

import paddle.nn.functional as F

import numpy as npdef load_data():# 从文件导入数据datafile = 'housing.data'data = np.fromfile(datafile, sep=' ', dtype=np.float32)# 每条数据包括14项,其中前面13项是影响因素,第14项是相应的房屋价格中位数feature_names = ['CRIM', 'ZN', 'INDUS', 'CHAS', 'NOX', 'RM', 'AGE', 'DIS', 'RAD', 'TAX', 'PTRATIO', 'B', 'LSTAT','MEDV']feature_num = len(feature_names)# 将原始数据进行Reshape,变成[N, 14]这样的形状data = data.reshape([data.shape[0] // feature_num, feature_num])# 将原数据集拆分成训练集和测试集# 这里使用80%的数据做训练,20%的数据做测试# 测试集和训练集必须是没有交集的ratio = 0.8offset = int(data.shape[0] * ratio)training_data = data[:offset]# 计算train数据集的最大值,最小值maximums, minimums = training_data.max(axis=0), training_data.min(axis=0)# 记录数据的归一化参数,在预测时对数据做归一化global max_valuesglobal min_valuesmax_values = maximumsmin_values = minimums# 对数据进行归一化处理for i in range(feature_num):data[:, i] = (data[:, i] - min_values[i]) / (maximums[i] - minimums[i])# 训练集和测试集的划分比例training_data = data[:offset]test_data = data[offset:]return training_data, test_dataclass Regressor(paddle.nn.Layer):# self代表类的实例自身def __init__(self):# 初始化父类中的一些参数super(Regressor, self).__init__()# 定义一层全连接层,输入维度是13,输出维度是1self.fc = Linear(in_features=13, out_features=1)# 网络的前向计算def forward(self, inputs):x = self.fc(inputs)return x# 声明定义好的线性回归模型

model = Regressor()

# 开启模型训练模式

model.train()

# 加载数据

training_data, test_data = load_data()

# 定义优化算法,使用随机梯度下降SGD

# 学习率设置为0.01

opt = paddle.optimizer.SGD(learning_rate=0.01, parameters=model.parameters())EPOCH_NUM = 100 # 设置外层循环次数

BATCH_SIZE = 10 # 设置batch大小# 定义外层循环

for epoch_id in range(EPOCH_NUM):# 在每轮迭代开始之前,将训练数据的顺序随机的打乱np.random.shuffle(training_data)# 将训练数据进行拆分,每个batch包含10条数据mini_batches = [training_data[k:k + BATCH_SIZE] for k in range(0, len(training_data), BATCH_SIZE)]# 定义内层循环for iter_id, mini_batch in enumerate(mini_batches):x = np.array(mini_batch[:, :-1]) # 获得当前批次训练数据y = np.array(mini_batch[:, -1:]) # 获得当前批次训练标签(真实房价)# 将numpy数据转为飞桨动态图tensor的格式house_features = paddle.to_tensor(x)prices = paddle.to_tensor(y)# 前向计算predicts = model(house_features)# 计算损失loss = F.square_error_cost(predicts, label=prices)avg_loss = paddle.mean(loss)if iter_id % 20 == 0:print("epoch: {}, iter: {}, loss is: {}".format(epoch_id, iter_id, avg_loss.numpy()))# 反向传播,计算每层参数的梯度值avg_loss.backward()# 更新参数,根据设置好的学习率迭代一步opt.step()# 清空梯度变量,以备下一轮计算opt.clear_grad()# 保存模型参数,文件名为LR_model.pdparams

paddle.save(model.state_dict(), 'LR_model.pdparams')

print("模型保存成功,模型参数保存在LR_model.pdparams中")def load_one_example():# 从上边已加载的测试集中,随机选择一条作为测试数据idx = np.random.randint(0, test_data.shape[0])idx = -10one_data, label = test_data[idx, :-1], test_data[idx, -1]# 修改该条数据shape为[1,13]one_data = one_data.reshape([1, -1])return one_data, label# 参数为保存模型参数的文件地址

model_dict = paddle.load('LR_model.pdparams')

model.load_dict(model_dict)

model.eval()# 参数为数据集的文件地址

one_data, label = load_one_example()

# 将数据转为动态图的variable格式

one_data = paddle.to_tensor(one_data)

predict = model(one_data)# 对结果做反归一化处理

predict = predict * (max_values[-1] - min_values[-1]) + min_values[-1]

# 对label数据做反归一化处理

label = label * (max_values[-1] - min_values[-1]) + min_values[-1]print("Inference result is {}, the corresponding label is {}".format(predict.numpy()[0][0], label))训练和测试结果:

W0112 11:54:07.968986 6924 gpu_resources.cc:61] Please NOTE: device: 0, GPU Compute Capability: 8.6, Driver API Version: 11.6, Runtime API Version: 11.6

W0112 11:54:07.971987 6924 gpu_resources.cc:91] device: 0, cuDNN Version: 8.6.

epoch: 0, iter: 0, loss is: [0.07582213]

epoch: 0, iter: 20, loss is: [0.03548948]

epoch: 0, iter: 40, loss is: [0.02555539]

epoch: 1, iter: 0, loss is: [0.11978696]

epoch: 1, iter: 20, loss is: [0.16856399]

epoch: 1, iter: 40, loss is: [0.02500438]

epoch: 2, iter: 0, loss is: [0.06267784]

epoch: 2, iter: 20, loss is: [0.0729256]

epoch: 2, iter: 40, loss is: [0.03819146]

epoch: 3, iter: 0, loss is: [0.16565429]

epoch: 3, iter: 20, loss is: [0.03884603]

epoch: 3, iter: 40, loss is: [0.0387187]

epoch: 4, iter: 0, loss is: [0.06751122]

epoch: 4, iter: 20, loss is: [0.01589721]

epoch: 4, iter: 40, loss is: [0.01388385]

epoch: 5, iter: 0, loss is: [0.07534505]

epoch: 5, iter: 20, loss is: [0.03471756]

epoch: 5, iter: 40, loss is: [0.02336933]

epoch: 6, iter: 0, loss is: [0.04414212]

epoch: 6, iter: 20, loss is: [0.09071548]

epoch: 6, iter: 40, loss is: [0.01255949]

epoch: 7, iter: 0, loss is: [0.09737112]

epoch: 7, iter: 20, loss is: [0.07142238]

epoch: 7, iter: 40, loss is: [0.31612638]

epoch: 8, iter: 0, loss is: [0.03586553]

epoch: 8, iter: 20, loss is: [0.08447323]

epoch: 8, iter: 40, loss is: [0.06576787]

epoch: 9, iter: 0, loss is: [0.04013788]

epoch: 9, iter: 20, loss is: [0.02914195]

epoch: 9, iter: 40, loss is: [0.08335038]

模型保存成功,模型参数保存在LR_model.pdparams中

Inference result is 22.877676010131836, the corresponding label is 19.700000762939453

loss函数可视化

# 加载飞桨、NumPy和相关类库

import paddle

from paddle.nn import Linear

import paddle.nn.functional as F

import numpy as np

from matplotlib import pyplot as pltdef load_data():# 从文件导入数据datafile = 'housing.data'data = np.fromfile(datafile, sep=' ', dtype=np.float32)# 每条数据包括14项,其中前面13项是影响因素,第14项是相应的房屋价格中位数feature_names = ['CRIM', 'ZN', 'INDUS', 'CHAS', 'NOX', 'RM', 'AGE', 'DIS', 'RAD', 'TAX', 'PTRATIO', 'B', 'LSTAT','MEDV']feature_num = len(feature_names)# 将原始数据进行Reshape,变成[N, 14]这样的形状data = data.reshape([data.shape[0] // feature_num, feature_num])# 将原数据集拆分成训练集和测试集# 这里使用80%的数据做训练,20%的数据做测试# 测试集和训练集必须是没有交集的ratio = 0.8offset = int(data.shape[0] * ratio)training_data = data[:offset]# 计算train数据集的最大值,最小值maximums, minimums = training_data.max(axis=0), training_data.min(axis=0)# 记录数据的归一化参数,在预测时对数据做归一化global max_valuesglobal min_valuesmax_values = maximumsmin_values = minimums# 对数据进行归一化处理for i in range(feature_num):data[:, i] = (data[:, i] - min_values[i]) / (maximums[i] - minimums[i])# 训练集和测试集的划分比例training_data = data[:offset]test_data = data[offset:]return training_data, test_dataclass Regressor(paddle.nn.Layer):# self代表类的实例自身def __init__(self):# 初始化父类中的一些参数super(Regressor, self).__init__()# 定义一层全连接层,输入维度是13,输出维度是1self.fc = Linear(in_features=13, out_features=1)# 网络的前向计算def forward(self, inputs):x = self.fc(inputs)return x# 声明定义好的线性回归模型

model = Regressor()

# 开启模型训练模式

model.train()

# 加载数据

training_data, test_data = load_data()

# 定义优化算法,使用随机梯度下降SGD

# 学习率设置为0.01

opt = paddle.optimizer.SGD(learning_rate=0.01, parameters=model.parameters())def train(EPOCH_NUM, BATCH_SIZE):losses = []for epoch_id in range(EPOCH_NUM):# 在每轮迭代开始之前,将训练数据的顺序随机的打乱np.random.shuffle(training_data)# 将训练数据进行拆分,每个batch包含10条数据mini_batches = [training_data[k:k + BATCH_SIZE] for k in range(0, len(training_data), BATCH_SIZE)]# 定义内层循环for iter_id, mini_batch in enumerate(mini_batches):x = np.array(mini_batch[:, :-1]) # 获得当前批次训练数据y = np.array(mini_batch[:, -1:]) # 获得当前批次训练标签(真实房价)# 将numpy数据转为飞桨动态图tensor的格式house_features = paddle.to_tensor(x)prices = paddle.to_tensor(y)# 前向计算predicts = model(house_features)# 计算损失loss = F.square_error_cost(predicts, label=prices)avg_loss = paddle.mean(loss)losses.append(avg_loss)if iter_id % 20 == 0:print("epoch: {}, iter: {}, loss is: {}".format(epoch_id, iter_id, avg_loss.numpy()))# 反向传播,计算每层参数的梯度值avg_loss.backward()# 更新参数,根据设置好的学习率迭代一步opt.step()# 清空梯度变量,以备下一轮计算opt.clear_grad()return losses

EPOCH_NUM = 10 # 设置外层循环次数

BATCH_SIZE = 10 # 设置batch大小

losses = train(EPOCH_NUM, BATCH_SIZE)# 画出损失函数的变化趋势

plot_x = np.arange(len(losses))

plot_y = np.array(losses)

plt.plot(plot_x, plot_y)

plt.show()

# 保存模型参数,文件名为LR_model.pdparams

paddle.save(model.state_dict(), 'LR_model.pdparams')

print("模型保存成功,模型参数保存在LR_model.pdparams中")def load_one_example():# 从上边已加载的测试集中,随机选择一条作为测试数据idx = np.random.randint(0, test_data.shape[0])idx = -10one_data, label = test_data[idx, :-1], test_data[idx, -1]# 修改该条数据shape为[1,13]one_data = one_data.reshape([1, -1])return one_data, label# 参数为保存模型参数的文件地址

model_dict = paddle.load('LR_model.pdparams')

model.load_dict(model_dict)

model.eval()# 参数为数据集的文件地址

one_data, label = load_one_example()

# 将数据转为动态图的variable格式

one_data = paddle.to_tensor(one_data)

predict = model(one_data)# 对结果做反归一化处理

predict = predict * (max_values[-1] - min_values[-1]) + min_values[-1]

# 对label数据做反归一化处理

label = label * (max_values[-1] - min_values[-1]) + min_values[-1]print("Inference result is {}, the corresponding label is {}".format(predict.numpy()[0][0], label))