文章目录

- 摘要

- 文献阅读

- 1.题目

- 2.要点

- 3.问题

- 4.解决方案

- 5.本文贡献

- 6.方法

- 6.1 特征选择

- 6.2 时间序列平稳性检测与数据分解

- 6.3 基于GRU神经网络的PM2.5浓度预测

- 7.实验

- 7.1 网络参数

- 7.2 实验结果

- 7.3 对比实验

- 8.讨论

- 9.结论

- 10.展望

- PINNS模型

- 1.自动微分

- 2.全连接神经网络

- 3.PINNs模型的PI

- 4.可能存在的问题

- 深度学习

- 总结

摘要

This week, I read a computer science about the prediction of PM2.5 concentration at surface monitoring points by GRU neural network based on empirical mode decomposition. Due to the timeliness and nonlinearity of PM2.5 concentration series, more and more deep learning methods have been applied to PM2.5 prediction, but most of them ignore the non-stationarity of time series, resulting in low prediction accuracy of the model. In this paper, a gated recurrent unit neural network integration method based on empirical mode decomposition (EMD-GRU) is proposed to predict PM2.5 concentration. First, the empirical mode decomposition is used to decompose the PM2.5 concentration series, and then the decomposed stationary series and meteorological characteristics are successively input into the GRU network for training. Finally, the output sub-series are added to obtain the prediction result of PM2.5 concentration. The experimental results show that the prediction effect of EMD-GRU model is better than that of other single RNN model. In addition, I learn about the PINNs model, which has the potential to surpass numerical methods in accuracy.

本周,阅读了一篇基于经验模态分解的GRU神经网络地表监测点PM2.5浓度预测的文章。由于PM2.5浓度序列的时效性和非线性,越来越多的深度学习方法被应用到PM2.5预测中,但大多忽略了时间序列的非平稳性,导致模型预测精度较低。对此,提出了一种基于经验模态分解的门控递归单元神经网络预测PM2.5浓度的积分方法,EMD-GRU。首先利用经验模态分解对PM2.5浓度序列进行分解,然后将分解后的多个平稳子序列和气象特征依次输入GRU网络中训练,最后将输出的子序列相加,得到PM2.5浓度的预测结果。实验结果表明,EMD-GRU模型的预测效果明显优于其他单一的RNN模型。此外,我学习了PINNs模型的知识,其在精度上具有超越数值方法的潜力。

文献阅读

1.题目

文献阅读:PM2.5 concentration forecasting at surface monitoring sites using GRU neural network based on empirical mode decomposition

2.要点

1)提出基于数据分解的深度学习方法,对PM2.5浓度进行有效预测。

2)通过计算ACF和ADF测试,检查空气污染物浓度序列的平稳性。

3)使用EMD分解PM2.5浓度序列。

4)构建多步预测GRU神经网络。

3.问题

1)由于PM2.5浓度超标带来的危害,PM2.5浓度预测问题越来越受到重视,但目前预测方法的准确性仍不理想。

2)线性模型在处理非线性特征时,不可能准确捕捉非线性变化规律,这使得模型的预测误差很高。

3)空气污染物在时间维度上可以看作是一个多变量时间序列预测问题,但此前并没有将空气污染物的非平稳性作为时间序列来考虑,往往忽略了非平稳性在时间序列预测中的影响。

4.解决方案

1)神经网络可以在处理复杂的非线性关系中充分发挥重要作用,因此深度学习模型在空气质量预测中的应用掀起了一股热潮。

2)针对大气污染物序列的非平稳性和长期依赖性,提出了一种基于经验模态分解方法的门控单元循环神经网络对北京市PM2.5浓度的短期预测。

3)EMD-GRU模型可以根据历史标记数据的特征进行训练,即将未知特征数据(如明天或下一小时的气象数据)作为输入,通过训练后的模型能有效地输出PM2.5值。

5.本文贡献

1)通过计算自相关函数(ACF)和增广Dickey-Fuller(ADF)检验,检验了大气污染物浓度序列的平稳性,同时通过计算部分自相关函数(PACF)来确定GRU神经网络的时间步数。

2)EMD-GRU模型首先利用EMD对PM2.5浓度序列进行分解,然后将分解后得到的多个平稳子序列与气象特征输入到构建的GRU神经网络中进行训练。最后,对GRU预测输出的子序列进行求和得到预测结果。

3)利用2010-2014年北京地区空气质量数据,验证了EMD-GRU模型的有效性。通过实验结果表明,反映出EMD-GRU模型在PM2.5的短期预测中具有更细粒度的特点。

6.方法

6.1 特征选择

1)采用Pearson相关系数来表示PM2.5浓度与气象特征之间的关系:

其中:x、y分别表示PM2.5浓度序列和气象特征;N是序列中的样本数。

2)PM2.5浓度与气象特征相关系数的热图:

风向、风速、湿度三种气象条件对PM2.5浓度值的影响最大。此外,温度和气压对PM2.5浓度值呈负相关关系。

3)从BDS检验结果来看,在95%置信区间下,z统计量均远高于临界值,p值均小于0.05。因此,得到了PM2.5浓度序列为非线性时间序列的结论。

6.2 时间序列平稳性检测与数据分解

1)对于时间序列{Xt, t∈T},随机选取t, s∈t,时间序列{Xt}的自相关系数为r(s, t),其中r(s, t)的计算公式定义如下:

2)该序列的波形分布不均衡,波动幅度较大,不具有平稳序列的特征。

3)ACF系数和ADF检验结果都表明,PM2.5逐时浓度序列是非平稳序列。

6.3 基于GRU神经网络的PM2.5浓度预测

1)时间步长确定

滞后k偏自相关系数是指给定时间序列的中间k-1个随机变量Xt-1,Xt-2,…,Xt-k+1时,Xt-k对Xt影响的相关度量。滞后k偏自相关系数(PACF)的计算公式如下:

随着时间步长的增加,模型的预测误差总体呈下降趋势。通过实验发现,将时间步长设置为4的倍数往往可以使模型的预测误差最小化。

2)多步预测模型

多步预测GRU神经网络处理时间序列的过程如下:

GRU函数中ht的求解过程:

7.实验

7.1 网络参数

1)数据集

数据集来自于UCI机器学习库提供的2010/1/5-2014/12/31美国驻北京大使馆PM2.5浓度值和北京首都机场气象数据,数据属于时间序列,涵盖PM2.5浓度、露点、温度、气压、风向、风速、降雪量、降雨量等8个特征。

2)评估指标

3)使用EMD算法对PM2.5浓度序列进行分解,将时间序列分解为18个本征模态函数(IMFs)和1个残差。

7.2 实验结果

1)EMD-GRU模型的RMSE、MAE和SMAPE均低于其他7个模型,R-square更接近于1。这表明了EMD-GRU模型比传统的机器学习和深度学习模型具有更好的模型拟合效果和更高的预测精度。

2)EMD-GRU模型预测值更接近观测值,综上所述,EMD-GRU模型有效地解决了GRU模型在处理非平稳时间序列时产生的时间滞后问题,进一步提高了模型预测的精度。

7.3 对比实验

1)模型的时间成本方面

VMD-GRU模型子序列最少,迭代次数最少,因此运行时间成本在三种模型中最低。

2)预测结果误差方面

MD-GRU模型在RMSE和MAE指标上都是最小的。

3)总的来说,EMD-GRU模型虽然时间成本最大,但模型预测误差最小。但是EMD-GRU的计算过程是离线的,其时间消耗是可以接受的。

8.讨论

1)证明了深度学习在时间序列预测方面具有很强的优势,可以有效地捕捉时间序列数据的时间依赖性。

2)结果表明GRU比RNN和LSTM等其他深度学习模型更适合于北京PM2.5浓度的预测,EMD-GRU模型将数据分解与神经网络相结合,进一步解决了GRU模型在预测非平稳时间序列方面的性能缺陷。

3)从对比实验结果来看,EMD-GRU模型虽然迭代计算次数最多,耗时较长,但预测误差最小。

9.结论

1)EMD-GRU模型充分考虑了气象特征与PM2.5浓度的关系,以及时间序列的非平稳性对预测的影响。

2)EMD-GRU模型以数据分解和神经网络的形式,将稳定后的时间序列数据输入到GRU网络中,结果表明该方法大大降低了模型的预测误差。

3)EMD-GRU模型提高了模型的拟合性,初步解决了GRU模型存在的时滞问题,同时预测精度高于传统机器学习方法和单一深度学习方法。

4)以上发现,都反映了数据分解在促进深度学习方法中的作用。

10.展望

1)只考虑了一个单独的站点来验证模型预测的准确性,但这并不代表EMD-GRU模型在PM2.5预测上存在地理局限性,因此后续模型将使用多个站点的空气质量数据和天气数据来预测每小时PM2.5浓度。

2)由于缺乏与PM2.5相关的空间特征信息,EMD-GRU模型在不同区域的泛化性无法解释。因此后续将收集大量真实有效的空气质量相关数据,并将模型应用于多个不同区域的数据集进行验证。

PINNS模型

1.自动微分

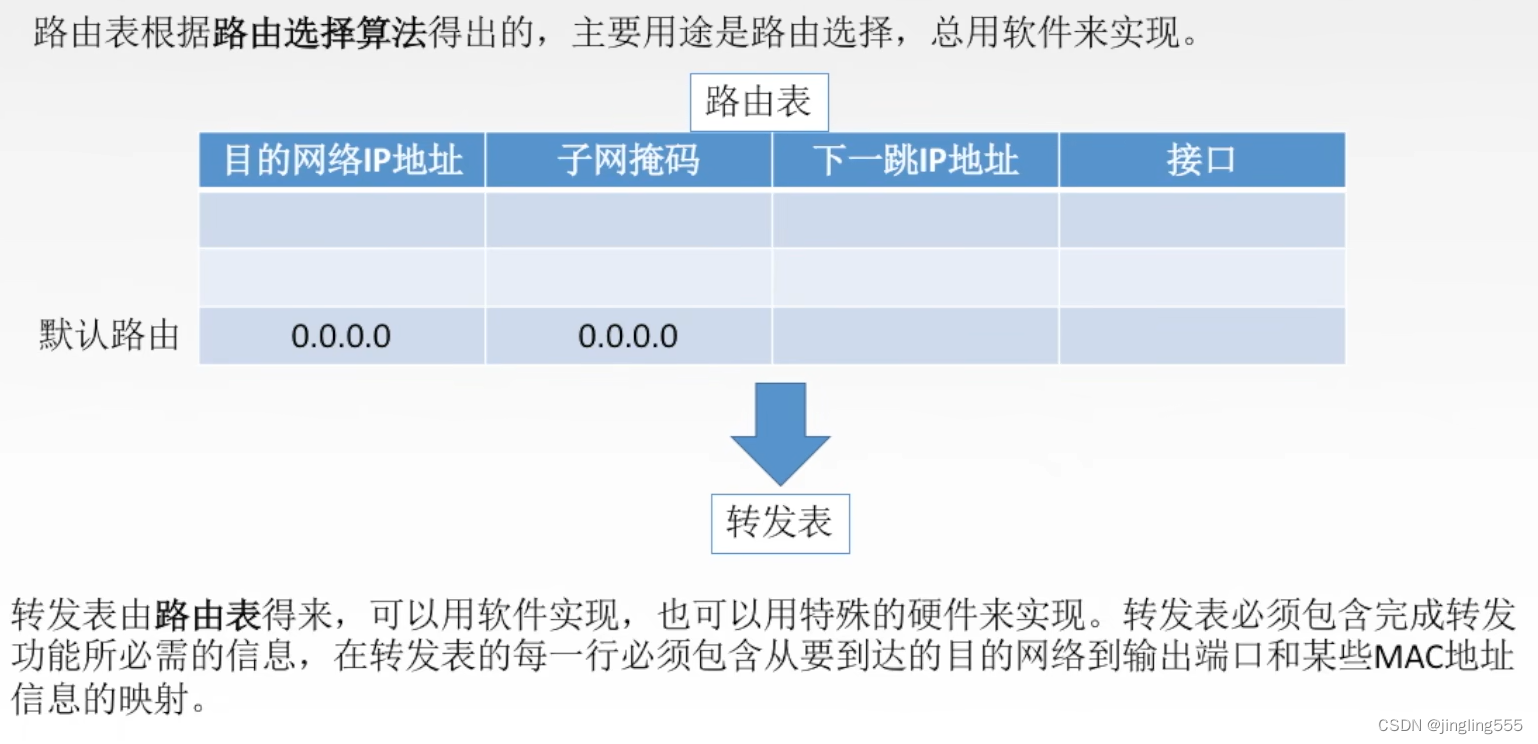

1)偏微分方程难以在计算机中求解,是因为微分算子无法直接在计算机中表达。而计算机可以抽象成一个只能计算加减乘除的机器,因此算法就是把复杂的计算任务分解成数和数的四则运算问题。

2)传统的数值方法为了求解偏微分方程,首先要解决的是微分算子离散化的问题。以有限差分法为例,其核心原则是使用差分近似微分。

于是导数就变成了四则运算,但上式的极限取不到无限小,因此就会产生误差。

3)泰勒展开式可以用来分析差分离散带来的误差,以u对时间t的导数为例,进行泰勒展开,舍去二阶以后的项,即可得到差分后的形式。

其中被舍掉的就是截断误差,并且该误差无法避免。但PINNs模型可以避免截断误差,这也是它比传统数值方法更准的潜力的原因。

4)自动微分需要表达式,而数值方法不需要表达式,可以直接把导数拆成四则运算。因此,初始化一个表达式,根据自动微分技术精确的算出Loss,并通过Loss的反向传播,让这个表达式的参数随着Loss逐渐修正,使得该表达式逐渐趋近于方程的解。当收敛之后,就得到了一个近似解。

2.全连接神经网络

1)从数学上来看,神经网络就是一个明确的数学表达式。因此,我们的目标就是让这一组数学表达式(神经网络)逼近收敛成目标方程的解。

2)PINNs模型中的神经网络是全连接神经网络,该网络模型的输入是自变量,而输出则是待求的解。即该神经网络可以写成数学表达式如下:

3)使用神经网络对方程的解进行建模,从形式上看和解析解是一样的。即每给定一组(x,t),神经网络就会输出一个值u,也就是训练自变量坐标对解的映射。

3.PINNs模型的PI

1)为了实现只有初边值条件和方程就可以约束神经网络,PINNs模型的损失函数分为两部分,一部分是初始条件和边界条件,另一部分是方程。

以Burgers方程为例:

使用初边界条件做约束,直接计算模型的输出在初始和边界时和条件的MSE:

PINNs模型的亮点在于计算方程的Loss,当输出的u和对应的导数满足方程时,f是等于0的。因此,目标是让f尽可能的接近0。这样就实现了即使不知道真值u,也能计算出方程的Loss用于指导神经网络参数的更新,实现了非监督学习的效果。

写成MSE的形式:

而二者的权重分配,分别采用了定值和动态调整的策略:

2)从训练集中的数据来说,损失函数的设计思路就是在定义域中选择一定数量的坐标点用作训练集的输入,来对神经网络进行约束。其中边界上的点被方程和标签同时约束,内部的点只受方程约束。

3)PINNs模型的选择策略是在定义域内随机取一定数量的点,但它的训练速度是比较慢的。如果只使用固定的5000个点训练可能会导致反向传播的误差梯度的信息量越来越少,使得收敛越来越慢。如果定期随机换一批点的话,又不能保证这些点是有价值的。

4.可能存在的问题

1)PINNs模型不仅对神经网络的输出有要求,还对神经网络内部做了约束,即神经网络对输入的神经元x和t的导数也做了约束。这使得训练难度和训练时间显著增加,同时显存占用量显著增加。

2)PINNs模型存在收敛难的问题,这是因为PINNs引入了逼近误差,并且逼近误差的数量级是大于截断误差的,这使得很难得到最优。

3)PINNs模型靠方程约束会出现方程的Loss很小,但解的形态明显不正确的情况,即求得解不唯一。

4)PINNs模型需要求导,但深度学习中的标准化会影响求导的准确性。这就导致该方法在有的初始条件下效果相对好,有的条件下逼近效果较差,因此PINNs模型的稳定性难以保证。

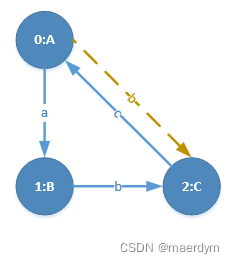

深度学习

在一个二维空间中的物质传输:

1)定义一个位置张量P,其中 P(i, j) 表示物质在位置 (i, j) 处的质点。类似地,定义一个速度张量V,其中 V(i, j) 表示在位置 (i, j) 处的质点的速度。

2)假设物质在介质中受到一些作用力F,我们可以将这个作用力表示为一个与位置相关的张量,即 F(i, j) 表示在位置 (i, j) 处的作用力。根据牛顿第二定律:F = m*a,其中 m 是质点的质量,a 是质点的加速度。将这个定律用张量表示,我们可以得到:F(i, j) = m * A(i, j),其中A(i, j) 表示在位置 (i, j) 处的质点的加速度

3)由于加速度是速度关于时间的导数,我们可以将加速度表示为速度的变化率张量:A(i, j) = dV(i, j)/dt,于是就将物质的运动表示为了张量之间的关系,将速度表示为位置的变化率,将加速度表示为速度的变化率,而作用力则通过质点的质量乘以加速度来表示。

总结

本周,我简单地学习了一些PINNs模型的知识点,其理论解释和分析近乎完美,也是AI在偏微分方程领域中不多的只需要初值条件、边值条件和方程即可求解的模型。PINNs模型被应用到的方程数量少,而且定义域空间小,通过较长的训练时间是可以得到不错的效果,但也制约了PINNs模型在大规模数值模拟上的应用。下周,我会继续学习论文相关的知识点,继续思考论文的创新点。