市面上已经有成熟的AI编码助手,先有Github的Copilot,后有国内各个厂家提供的助手,以及现在能力更强大的cursor等。只是目前市面的编码助手,只支持VSCode和JetBrains,对一些Vim高度依赖的开发者很不友好。正好找到了一款Vim插件,支持本地离线AI模型进行编码提效。

首先需要安装Vim插件,以Mac代码为例,下载llama.vim到bundle中:

cd ~/.vim/bundle

git clone https://github.com/ggml-org/llama.vim

配置Plugin 'llama.vim' 到 .vimrc的 vundle#begin() 区域:

set rtp+=~/.vim/bundle/Vundle.vim

call vundle#begin()

Plugin 'VundleVim/Vundle.vim'

Plugin 'ggml-org/llama.vim'

call vundle#end()

接着安装llama.cpp:

brew install llama.cpp

接下来安装离线模型,下面是建议的配置,具体取决于我们的VRAM数量:

- 超过 16GB VRAM:

llama-server \-hf ggml-org/Qwen2.5-Coder-7B-Q8_0-GGUF \--port 8012 -ngl 99 -fa -ub 1024 -b 1024 \--ctx-size 0 --cache-reuse 256 - 小于 16GB VRAM:

llama-server \-hf ggml-org/Qwen2.5-Coder-3B-Q8_0-GGUF \--port 8012 -ngl 99 -fa -ub 1024 -b 1024 \--ctx-size 0 --cache-reuse 256 - 小于 8GB VRAM:

llama-server \-hf ggml-org/Qwen2.5-Coder-1.5B-Q8_0-GGUF \--port 8012 -ngl 99 -fa -ub 1024 -b 1024 \--ctx-size 0 --cache-reuse 256

这里我们选择千问2.5,7B 版本:

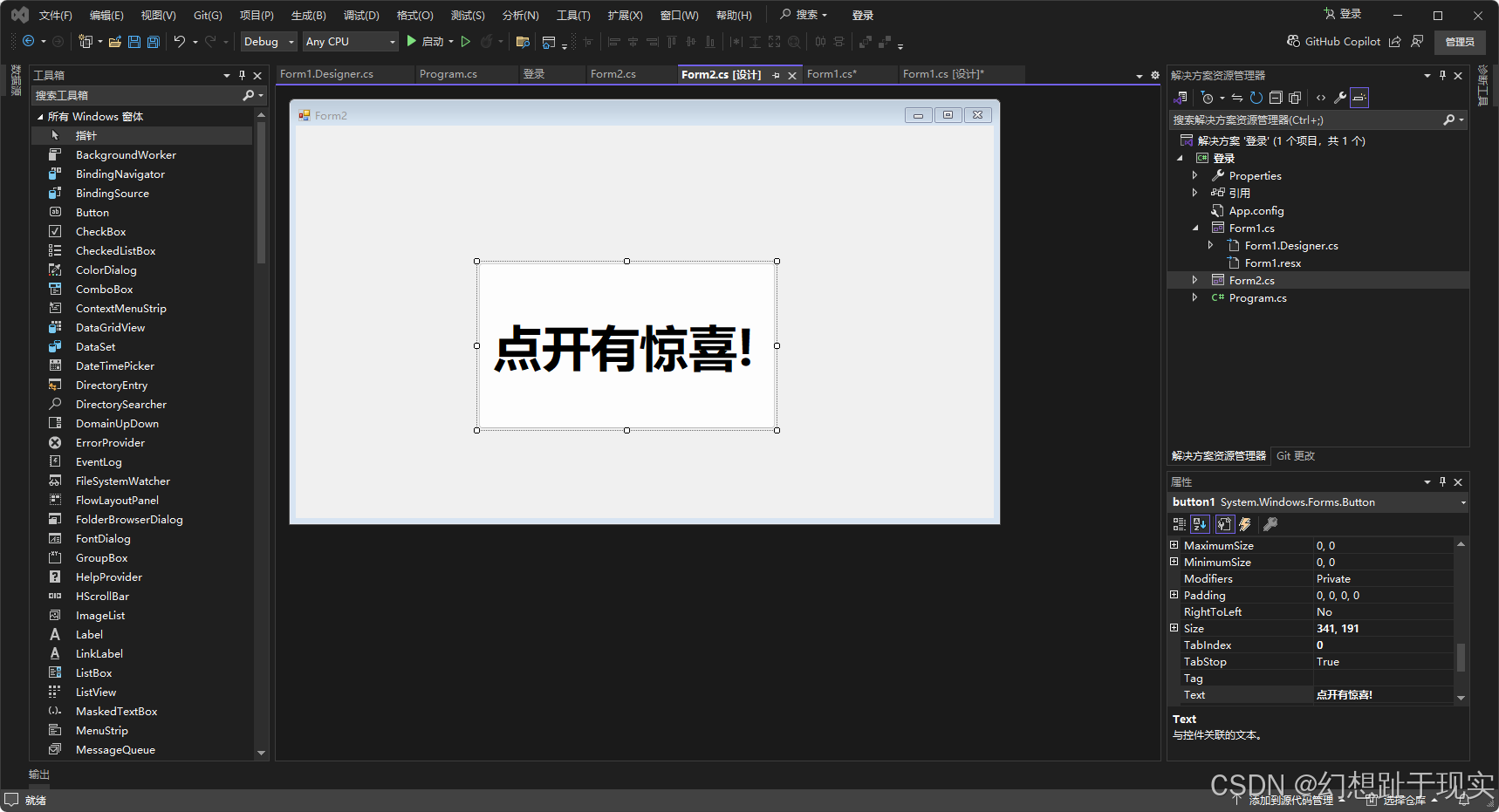

接下来就可以快乐的使用代码生成辅助了: