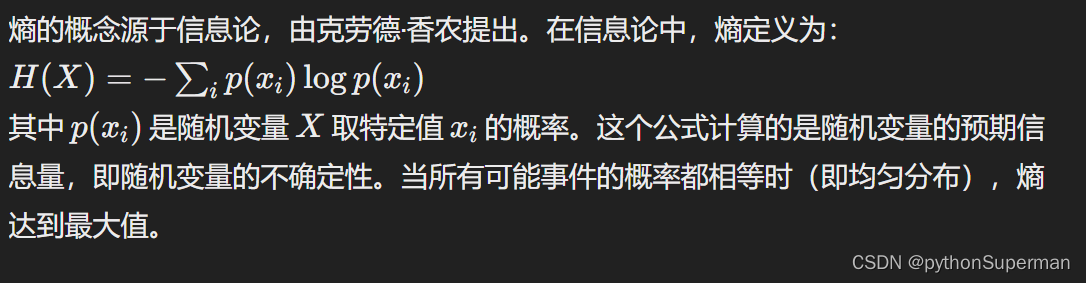

熵的基本概念

熵用来表示随机变量的不确定性,当所有可能事件的概率都相等时(即均匀分布),熵达到最大值。

熵与机器学习中的应用

在机器学习,尤其是分类任务中,模型常常会输出一个概率分布,表示输入属于各个类别的概率。如果模型对某个类别非常确定,那么输出的概率分布会在某个类别上接近1,其他类别接近0,这种情况下的熵很低。相反,如果模型对所有类别几乎同等不确定,输出的概率分布将接近均匀分布,熵就会很高。

- 高熵的优点:模型输出高熵的概率分布可以防止模型对训练数据过拟合,使模型在面对未见过的数据时具有更好的泛化能力。高熵鼓励模型探索多种可能的输出而非确定性地锁定在某个预测上。

- 低熵的风险:如果模型输出的概率分布熵太低,即模型过于自信,这可能导致模型对噪声和异常值过度敏感,从而影响其泛化性能。

在实际应用中,通过在损失函数中添加一个促使概率分布熵增加的项(如前面代码中的负熵损失),可以帮助调节模型的自信度,防止过度自信而忽视其他可能的类别,从而提高模型对新情况的适应性和鲁棒性。