1. 项目背景与需求分析

1.1 自动驾驶的关键性

自动驾驶技术正在迅速发展,目标检测是自动驾驶系统中的关键组成部分之一。通过高效、准确的目标检测算法,车辆可以实时识别道路上的行人、车辆、交通标志、障碍物等,确保行车安全。

1.2 项目需求

本项目旨在开发一个基于YOLO深度学习模型的自动驾驶目标检测系统,系统能够在实时视频流或静态图片中检测和标识不同的目标,并提供一个简单易用的用户界面(UI)来展示检测结果。主要需求包括:

- 目标检测:实时检测并标注视频流中的行人、车辆、交通标志等。

- UI界面:用户可以通过上传图片或摄像头实时监控来查看检测结果。

- 模型训练:使用公开数据集训练YOLO模型,提高检测精度。

2. 开发环境与工具链准备

2.1 Python环境配置

确保系统中安装了Python 3.8或更高版本。使用Anaconda创建独立的虚拟环境,便于管理项目依赖。

# 创建并激活虚拟环境

conda create -n autodrive_detection python=3.8

conda activate autodrive_detection

2.2 安装必要的Python库

本项目使用PyTorch作为深度学习框架,同时还需要安装OpenCV、Flask等库来支持图像处理和前后端开发。

pip install torch torchvision torchaudio

pip install opencv-python

pip install flask # 用于开发简单的UI界面

pip install ultralytics # YOLOv8库

2.3 GPU支持配置

自动驾驶系统通常需要处理大量的图像数据,使用GPU可以大幅加速模型的训练和推理。确保安装了CUDA和cuDNN,并验证PyTorch是否正确识别GPU。

import torch

print(torch.cuda.is_available()) # 返回True表示GPU可用

3. 数据集获取与标注

3.1 数据集选择

选择适合自动驾驶目标检测的数据集,如COCO、KITTI、Pascal VOC等。这些数据集涵盖了行人、车辆、交通标志等多种目标类别,并且具有标准的标注格式。

3.2 数据集下载与准备

下载所选数据集,并将其解压到指定目录下。确保数据集中每张图像都有对应的标注文件,通常标注格式为YOLO格式或COCO格式。

# 示例:下载并解压KITTI数据集

mkdir -p ./data/kitti

cd ./data/kitti

wget http://www.cvlibs.net/download.php?file=data_object_image_2.zip

unzip data_object_image_2.zip

3.3 数据集标注

如果数据集中有需要手动标注的部分,可以使用LabelImg工具对图像进行标注,并生成YOLO格式的标签文件。

# 安装并启动LabelImg进行标注

pip install labelImg

labelImg

3.4 数据增强

通过对图像进行数据增强,如旋转、缩放、裁剪等操作,可以增加数据集的多样性,提升模型的泛化能力。

from torchvision import transforms

from PIL import Image# 数据增强

transform = transforms.Compose([transforms.RandomHorizontalFlip(),transforms.RandomCrop(640),transforms.ColorJitter(brightness=0.2, contrast=0.2, saturation=0.2),

])img = Image.open('data/kitti/image_2/000001.png')

img_aug = transform(img)

img_aug.save('data/kitti/image_2/000001_aug.png')

YOLO_84">4. YOLO模型配置与训练

4.1 模型选择

YOLO系列模型具有良好的速度与精度平衡,可以选择YOLOv5、YOLOv6、YOLOv7或YOLOv8进行目标检测任务。对于资源有限的开发环境,可以选择轻量级的YOLOv5s模型。

4.2 模型配置

配置YOLO模型的相关参数,包括输入图像尺寸、类别数量、学习率等。以下是一个YOLOv5模型配置的示例:

# data.yaml 配置文件示例

train: ./data/kitti/train/

val: ./data/kitti/val/nc: 3 # 类别数量(如行人、车辆、交通标志)

names: ['person', 'car', 'traffic sign']# 使用的YOLOv5模型

model: yolov5s.yaml

4.3 模型训练

在配置好模型后,启动训练过程。训练过程中可以观察损失值的变化、模型的mAP等指标来评估模型的性能。

python train.py --img 640 --batch 16 --epochs 100 --data data.yaml --weights yolov5s.pt

4.4 模型优化

如果在初步训练后模型的表现不理想,可以尝试调整学习率、增加数据集、或使用更复杂的模型结构来进一步优化模型。

# 调整学习率并继续训练

python train.py --img 640 --batch 16 --epochs 150 --data data.yaml --weights yolov5s.pt --cos-lr

5. 系统开发与联调

5.1 前端UI设计

使用HTML、CSS、JavaScript设计用户界面,使用户能够上传图片或接入摄像头视频流,实时查看检测结果。

<!DOCTYPE html>

<html lang="en">

<head><meta charset="UTF-8"><title>自动驾驶目标检测系统</title><style>/* 基本样式 */body { font-family: Arial, sans-serif; }#upload, #camera { margin: 10px; }#result { display: block; margin-top: 20px; }</style>

</head>

<body><h1>自动驾驶目标检测系统</h1><input type="file" id="upload" /><video id="camera" autoplay></video><canvas id="result"></canvas><script>// JavaScript处理图片上传和视频流的实时检测</script>

</body>

</html>

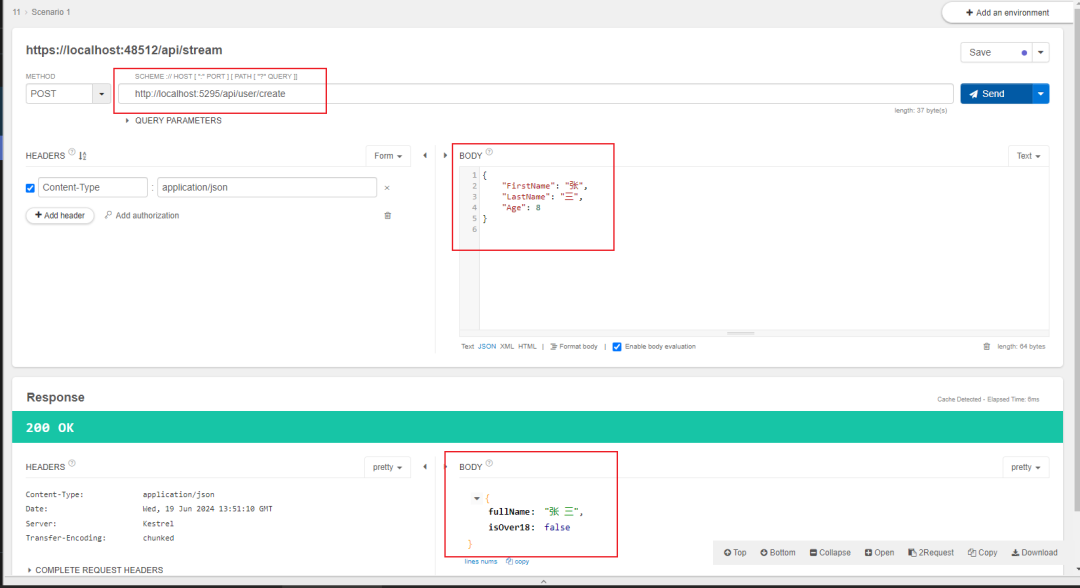

5.2 后端服务开发

使用Flask开发简单的后端服务,用于接收前端上传的图片或视频帧,调用YOLO模型进行目标检测,并将结果返回给前端。

from flask import Flask, request, jsonify

import torch

import cv2app = Flask(__name__)# 加载训练好的模型

model = torch.load('best.pt')@app.route('/detect', methods=['POST'])

def detect():img = cv2.imdecode(np.fromstring(request.files['image'].read(), np.uint8), cv2.IMREAD_COLOR)results = model(img)return jsonify(results)if __name__ == '__main__':app.run(debug=True)

5.3 前后端联调

通过JavaScript的Fetch API与后端进行通信,实时获取检测结果并在UI界面上展示。

document.getElementById('upload').addEventListener('change', function() {let file = this.files[0];let formData = new FormData();formData.append('image', file);fetch('/detect', {method: 'POST',body: formData}).then(response => response.json()).then(data => {// 将检测结果渲染到canvas上drawResults(data);});

});function drawResults(data) {let canvas = document.getElementById('result');let ctx = canvas.getContext('2d');ctx.clearRect(0, 0, canvas.width, canvas.height);// 根据data绘制检测框和标签

}

6. 系统测试与评估

6.1 测试与调试

在开发完成后,使用多种测试场景对系统进行测试,确保目标检测的准确性和实时性。常见测试场景包括:

- 静态图片测试:上传多张静态图片进行目标检测。

- 视频流测试:通过摄像头实时监控目标检测的效果。

6.2 系统评估

评估系统的整体性能,主要包括:

- 检测精度(mAP):检测目标的准确率。

- 实时性:系统的处理速度,是否能够在合理的时间内给出检测结果。

- 鲁棒性:系统对不同光线、天气等环境变化的适应能力。

7. 声明

声明:本文只是简单的项目思路,如有部署的想法,想要(UI界面+YOLOv8/v7/v6/v5代码+训练数据集+视频教学)的可以联系作者.