OPENAI中RAG实现原理以及示例代码用PYTHON来实现

1. 引言

在当今人工智能领域,自然语言处理(NLP)是一个非常重要的研究方向。近年来,OPENAI发布了许多创新的NLP模型,其中之一就是RAG(Retrieval-Augmented Generation)模型。RAG模型结合了检索和生成两种方法,可以用于生成与给定问题相关的高质量文本。

本文将介绍RAG模型的实现原理,并提供使用Python编写的示例代码。

2. RAG模型的实现原理

RAG模型的实现原理可以分为两个主要步骤:检索和生成。

2.1 检索

RAG模型首先使用一个检索模型来从大规模文档集中找到与给定问题相关的文档。这个检索模型可以是传统的信息检索模型,也可以是使用预训练的语言模型进行检索。

2.2 生成

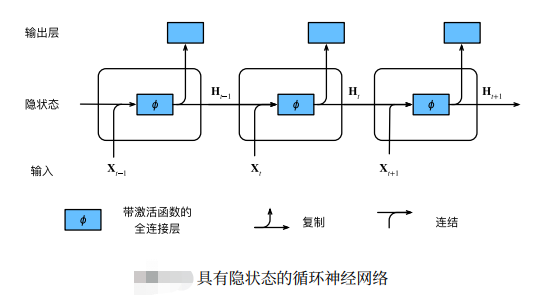

一旦找到了相关的文档,RAG模型将使用生成模型来生成与给定问题相关的高质量文本。生成模型可以是基于循环神经网络(RNN)的模型,也可以是基于Transformer的模型。

RAG模型通过将检索到的文档作为输入,结合生成模型的输出,生成与给定问题相关的文本。

3. RAG模型的示例代码

下面是使用Python实现RAG模型的示例代码:

python">import torch

from transformers import RagTokenizer, RagRetriever, RagSequenceForGeneration# 加载RAG模型

tokenizer = RagTokenizer.from_pretrained("facebook/rag-token-base")

retriever = RagRetriever.from_pretrained("facebook/rag-token-base")

model = RagSequenceForGeneration.from_pretrained("facebook/rag-token-base")# 输入问题和文档

question = "What is the capital of France?"

documents = ["Paris is the capital and most populous city of France."]# 编码问题和文档

input_dict = tokenizer.prepare_input(question, documents, return_tensors="pt")# 检索

retrieved_doc_ids = retriever.retrieve(input_dict["input_ids"])# 生成

generated = model.generate(input_ids=input_dict["input_ids"],attention_mask=input_dict["attention_mask"],retrieved_doc_embeds=retriever.get_doc_embeddings(retrieved_doc_ids),max_length=100,num_return_sequences=1,

)# 解码生成的文本

generated_text = tokenizer.batch_decode(generated, skip_special_tokens=True)[0]print("Generated Text:", generated_text)

上述代码使用了Hugging Face的Transformers库,该库提供了方便的接口来使用预训练的NLP模型。首先,我们加载了RAG模型的tokenizer、retriever和生成模型。然后,我们输入问题和文档,并使用tokenizer对其进行编码。接下来,我们使用retriever模型检索相关文档,并将其嵌入到生成模型中。最后,我们使用生成模型生成与给定问题相关的文本,并将其解码为可读的文本。

4. 结论

本文介绍了OPENAI中RAG模型的实现原理,并提供了使用Python编写的示例代码。RAG模型结合了检索和生成两种方法,可以用于生成与给定问题相关的高质量文本。通过使用Hugging Face的Transformers库,我们可以方便地使用预训练的RAG模型进行NLP任务。

希望本文对于对RAG模型感兴趣的读者有所帮助。如果你想深入了解RAG模型的更多细节,请参考相关文献和官方文档。