什么是数据库事务以及事务的ACID属性?

数据库事务是一组操作,这些操作作为一个整体单元执行,要么全部成功,要么全部失败。事务是数据库管理系统中保证数据完整性和一致性的基本单位。了解事务及其属性(通常称为ACID属性)对于设计和维护可靠的数据库系统至关重要。ACID是原子性(Atomicity)、一致性(Consistency)、隔离性(Isolation)、持久性(Durability)的缩写,每一个属性都解决了数据处理过程中的一个关键问题。

原子性(Atomicity)

原子性确保事务内的所有操作要么全部成功完成,要么完全不执行。如果事务中的任何操作失败,整个事务都会回滚到事务开始前的状态,就像这些操作从未发生过一样。这避免了操作部分完成的情况,保证事务是一个不可分割的单位。

一致性(Consistency)

一致性确保事务的执行将数据库从一个一致的状态带到另一个一致的状态。在此上下文中,一致性意味着数据库的数据将遵守所有定义的规则,包括数据完整性约束、级联操作和触发器。无论事务执行过程中发生什么,一旦所有事务操作完成,数据库的数据和状态必须是正确的。

隔离性(Isolation)

隔离性属性确保并发事务的执行不会互相干扰,事务对数据的修改在提交之前对其他事务是不可见的。这个属性主要解决了所谓的并发问题,如前面提到的脏读、不可重复读和幻读等。隔离性通过各种锁机制和隔离级别来实现,不同的隔离级别提供了不同程度的隔离,以平衡性能和一致性的需求。

持久性(Durability)

持久性保证了一旦事务被提交,它对数据库所做的更改就是永久的,即使系统发生故障也不会丢失。数据库系统会使用各种故障恢复技术,如日志记录,确保即便在系统崩溃或其他故障情况下,所有已提交的事务修改都能被恢复。

综合应用

在实际的数据库操作中,事务的ACID属性允许开发人员设计出可靠和健壮的数据库应用。例如,一个简单的银行转账操作:从一个账户扣款并向另一个账户存款,可以设计为一个事务。这个事务必须具备原子性以确保两个操作要么同时成功,要么同时失败;必须保持数据一致性,确保不会因为转账而导致总金额不匹配;隔离性保证这个转账操作不会与其他账户操作相冲突;持久性确保一旦转账完成,结果就是永久的。

理解并实现这些属性,是设计任何需要精确和可靠数据处理的数据库系统的关键。

并发控制可能引发的问题:脏读、不可重复读、幻读、以及丢失更新

在并发环境中,多个事务同时操作数据库可能会引起一系列问题,影响数据的一致性和完整性。下面是一些主要的并发问题以及它们的含义:

1. 脏读(Dirty Read)

脏读发生在一个事务读取了另一个事务未提交的数据。如果那个事务回滚(撤销更改),那么第一个事务读取的数据就是无效的。例如,事务A读取了事务B修改但尚未提交的记录。如果B事务失败,它对数据的更改将被撤销,但A已经基于错误的信息做出了决策。

2. 不可重复读(Non-repeatable Read)

不可重复读是指在一个事务内多次读取同一数据集时,因其他并发事务的更新操作,导致多次读取的结果不一致。例如,事务A读取一个记录,事务B更新了该记录并提交,当事务A再次读取同一记录时,值已经改变。这可能导致事务A基于旧数据做出的决策失效。

3. 幻读(Phantom Read)

幻读是一种特殊的不可重复读。它发生在一个事务读取几行数据,然后另一个事务插入或删除了一些符合第一个事务搜索条件的新行,当第一个事务再次尝试读取相同的数据集时,它会发现有额外的“幻影”行。例如,事务A根据某个条件选择多行数据,事务B在此期间插入了符合同一搜索条件的新行,当事务A重复其读取操作时,会发现多了之前未见的行。

4. 丢失更新(Lost Update)

丢失更新通常有两种情况:第一类丢失更新和第二类丢失更新。

-

第一类丢失更新:当两个事务同时读取同一个记录并基于读取的值更新该记录时,可能导致其中一个事务的更改被另一个事务的更改覆盖。例如,事务A和事务B同时读取同一个记录,它们都基于当前值进行修改,事务A的修改可能被事务B的修改所覆盖。

-

第二类丢失更新:发生在一个事务在长期运行的过程中,对一个记录进行了读取,然后基于这次读取的数据准备更新该记录。与此同时,另一个事务也修改了这条记录并提交。当第一个事务尝试提交其更新时,它可能无意中覆盖了第二个事务所做的修改,因为它没有意识到在其长期运行过程中数据已经被改变。

解决并发问题

为了解决这些并发问题,数据库管理系统提供了事务隔离级别。通过设置不同的隔离级别,可以在性能和一致性之间进行权衡。较低的隔离级别(如读未提交)可能会提高系统性能,但增加了并发问题的风险;而较高的隔离级别(如序列化)虽然可以避免这些问题,但可能会降低并发性能。每种隔离级别都有其适用场景,选择合适的隔离级别需要根据具体的应用需求和数据库特性进行综合考虑。

各种隔离级别以及他们如何影响事务处理的并发问题

在数据库系统中,事务隔离级别是用来定义在并发环境中多个事务如何相互隔离,以避免并发问题的一种机制。不同的隔离级别提供了不同程度的数据保护和系统性能。以下是四种常见的隔离级别及其对并发问题的影响:

1. 读未提交(Read Uncommitted)

- 定义:在这个级别下,事务可以读取尚未由其他事务提交的更改。这是最低的隔离级别,提供最少的数据隔离。

- 并发问题:允许脏读。这意味着一个事务可能读到另一个事务未提交的修改,如果那个事务回滚,读到的数据就会是不正确的。

- 使用场景:适用于对一致性要求不高,但需要高性能的场合。

2. 读已提交(Read Committed)

- 定义:这个隔离级别允许事务只能看到已经被提交的更改。这阻止了脏读。

- 并发问题:虽然防止了脏读,但是不可重复读(事务在读取相同的数据两次时可能会得到不同结果,因为其他事务在两次读取之间可能已经提交了更新)依然存在。

- 使用场景:适用于大多数应用场景,是很多数据库系统的默认隔离级别。

3. 可重复读(Repeatable Read)

- 定义:在这个隔离级别下,确保了在一个事务内多次读取同一数据集时,结果是一致的,即事务中的一次读取可以多次重复进行,每次都返回相同的数据集。

- 并发问题:防止了不可重复读,但是幻读(事务在对一个范围的记录进行重复读取时,另一个事务插入了一条符合这个范围的新记录)仍然可能发生。

- 使用场景:适用于需要较高数据一致性,但可以容忍幻读的场景。

4. 序列化(Serializable)

- 定义:这是最高的隔离级别。它通过完全序列化事务执行,使得一个事务在执行时,其他事务无法对其可见的数据进行修改或新增。

- 并发问题:此级别防止了脏读、不可重复读和幻读。序列化执行事务,使得每个事务都是在隔离的环境中完成。

- 使用场景:适用于需要严格数据一致性和完整性的场景,如金融服务。但这种级别的性能成本较高,因为它限制了操作的并行性。

不同数据库系统的事务隔离级别实现和默认设置

不同的数据库系统实现事务隔离级别的方式和默认设置可能有所不同,这些差异反映了各自数据库设计的哲学和优化方向。下面我们会分别探讨MySQL、PostgreSQL、Oracle和SQL Server的事务隔离级别实现和它们的默认设置。

MySQL

- 隔离级别:

- MySQL支持所有四个标准的隔离级别:读未提交、读已提交、可重复读、序列化。

- 默认设置:

- 在MySQL中,InnoDB存储引擎的默认隔离级别是可重复读(Repeatable Read)。这个级别在MySQL中特别优化,以避免幻读,通过使用一种叫做多版本并发控制(MVCC)的技术。

- 特点:

- MySQL的可重复读隔离级别通过MVCC来减少锁的需求,从而提高性能。

PostgreSQL

- 隔离级别:

- PostgreSQL同样支持标准的四个隔离级别。

- 默认设置:

- PostgreSQL的默认隔离级别是读已提交(Read Committed)。这意味着一个事务只能看到其他事务已经提交的更改。

- 特点:

- PostgreSQL使用MVCC来实现高效的并发控制,即使在默认的读已提交级别下也能有效地支持高并发访问。

Oracle

- 隔离级别:

- Oracle支持读已提交和序列化两种隔离级别。它不支持读未提交和默认不提供可重复读,但通过其他机制实现类似的效果。

- 默认设置:

- Oracle的默认隔离级别是读已提交(Read Committed)。

- 特点:

- Oracle使用行级锁和一致性读的机制,通过撤销信息(undo data)来构建查询时刻的数据快照,从而支持高并发。

SQL Server

- 隔离级别:

- SQL Server支持所有四个标准的隔离级别,并引入了两个附加的隔离级别:快照隔离(Snapshot Isolation)和读提交快照(Read Committed Snapshot)。

- 默认设置:

- SQL Server的默认隔离级别是读已提交(Read Committed)。但是,可以配置为使用读提交快照,这也基于MVCC。

- 特点:

- SQL Server的读提交快照和快照隔离级别都使用版本控制,减少了锁的需求,从而可能提高并发性能。

案例研究

通过具体的例子和场景分析不同隔离级别下可能发生的并发问题

要更好地理解不同事务隔离级别如何影响并发操作,我们可以通过一些具体的例子和场景来分析可能发生的并发问题。这些例子将帮助我们看到在不同隔离级别下如何处理常见的并发问题,如脏读、不可重复读和幻读等。

场景 1: 脏读

假设有两个事务,事务A和事务B。

- 事务A: 读取银行账户的余额。

- 事务B: 向同一银行账户存款,但最终决定撤销存款(回滚)。

在读未提交(Read Uncommitted)级别下:

- 事务A可以读取到事务B存款之后的余额,尽管这个存款最终被撤销。这就是脏读,因为事务A读取到了最终不存在的数据。

在读已提交(Read Committed)级别以上:

- 事务A只能看到事务B提交后的数据。由于B回滚了存款,事务A将不会看到这个变动。

场景 2: 不可重复读

假设事务A在读取一笔订单的总金额时,事务B更新了订单中的一项商品价格并提交。

- 事务A: 两次读取同一订单的总金额。

- 事务B: 在事务A的两次读取之间更新了订单中的商品价格并提交。

在读已提交(Read Committed)级别下:

- 事务A第一次读取时得到原始金额,但第二次读取时可能看到更新后的金额,因为事务B在两次读取之间已经提交了更新。这就是不可重复读。

在可重复读(Repeatable Read)级别下:

- 事务A两次读取将会得到相同的结果,即使事务B在两次读取之间更改并提交了数据,这些更改对事务A在当前执行中是不可见的。

场景 3: 幻读

假设事务A计算某个特定条件下的记录数量,而事务B在此期间插入了符合该条件的新记录。

- 事务A: 两次查询符合特定条件的记录总数。

- 事务B: 在事务A的两次查询之间插入新的符合条件的记录并提交。

在可重复读(Repeatable Read)级别下:

- 事务A在第一次查询时可能看不到由事务B插入的新记录,但如果事务B在事务A的第二次查询前提交,事务A的第二次查询可能会包含新的记录,导致幻读。

在序列化(Serializable)级别下:

- 事务A和事务B会被完全序列化执行,避免了幻读的问题。事务A在整个事务期间都不会看到事务B插入的记录,无论B何时提交。

总结

通过这些具体的场景,我们可以看到在不同隔离级别下,数据库如何处理并发事务所带来的问题。低隔离级别(如读未提交)可能导致数据不一致的风险,但执行效率高;高隔离级别(如序列化)虽然提供了很高的数据一致性保证,但可能会显著降低系统的并发性能。选择合适的隔离级别通常需要在数据的正确性和系统性能之间做出权衡。

如何选择适合特定应用和需求的隔离级别

选择合适的数据库事务隔离级别是确保应用性能和数据一致性之间平衡的关键决策。选择时需要考虑多个因素,包括应用的业务逻辑、数据的一致性需求、系统的并发量、以及性能影响。下面是一些具体的步骤和考虑因素,帮助决定最适合特定应用和需求的隔离级别。

1. 分析业务需求

首先,需要理解应用的业务逻辑和数据一致性的要求。不同的业务场景对数据的一致性和完整性有不同的要求:

- 金融服务:如银行系统,通常需要高度的数据一致性和完整性,可能更倾向于使用高隔离级别(如序列化)以避免任何并发异常。

- 社交媒体:更新频繁但对即时一致性要求不高的应用,可以考虑较低的隔离级别(如读已提交),以提高系统的响应速度和吞吐量。

2. 理解并发问题的影响

根据应用可能遇到的并发问题(如脏读、不可重复读、幻读),选择可以有效防止这些问题的隔离级别:

- 脏读:如果应用不能接受错误数据的风险,应避免使用读未提交。

- 不可重复读和幻读:如果业务逻辑依赖于事务中数据的重复可读性,可重复读或序列化可能是更好的选择。

3. 考虑性能影响

隔离级别越高,可能对系统性能的影响越大,因为高隔离级别通常需要更多的资源(如锁定资源),从而降低并发性能:

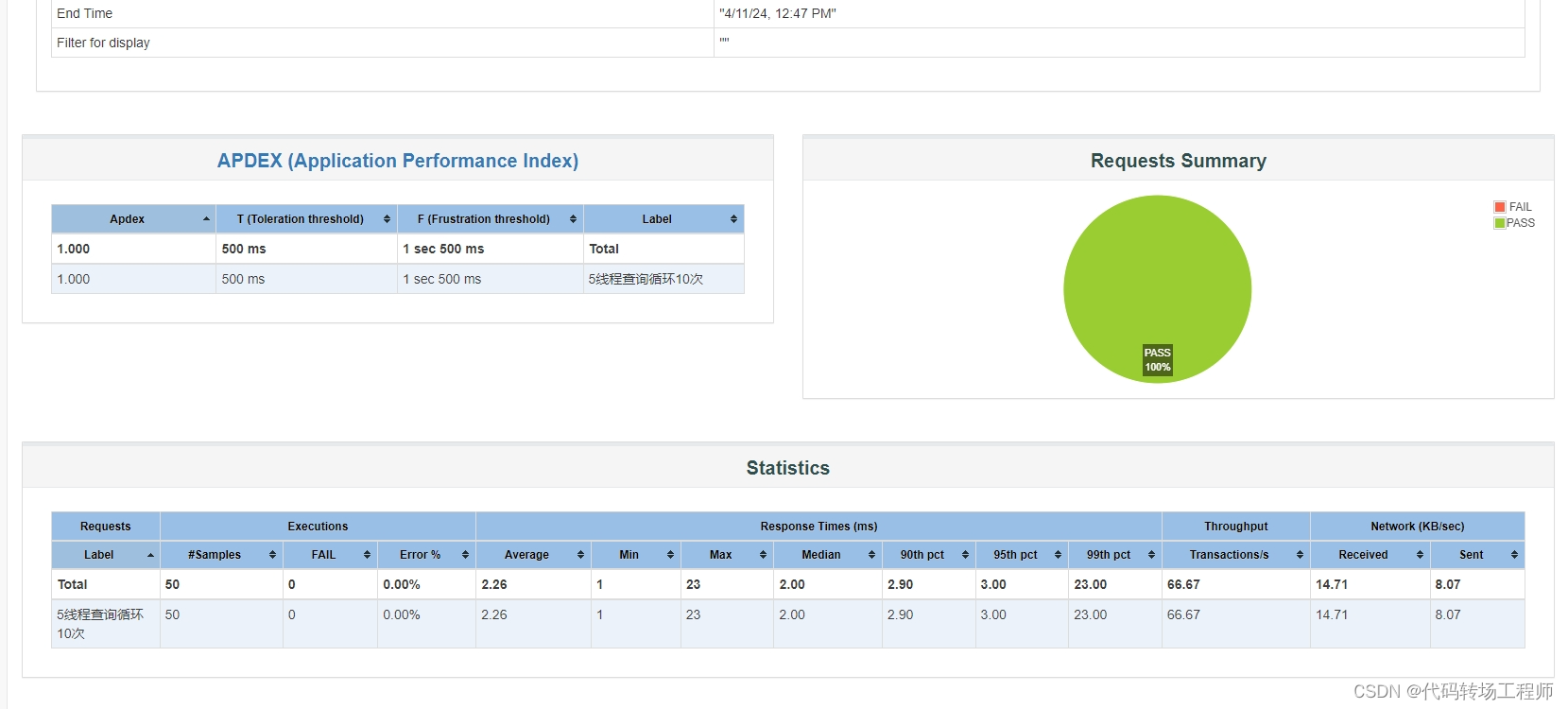

- 性能测试:在开发过程中,可以对不同的隔离级别进行性能测试,看它们如何影响应用的响应时间和并发处理能力。

- 监控和调整:生产环境中的监控可以帮助你了解当前隔离级别是否满足性能需求,或是否需要调整以应对变化的用户负载和数据量。

4. 兼顾实用性和简单性

选择隔离级别时,还应考虑其实用性和实施的复杂度。例如,虽然序列化提供最高级别的隔离,但在需要高并发的系统中可能不是最实际的选择。相反,可以考虑使用可重复读或读已提交,并结合应用层的逻辑控制来管理数据一致性。

5. 利用数据库特性

不同的数据库可能在相同的隔离级别下提供额外的优化和特性。例如:

- MySQL 的可重复读通过MVCC防止幻读,这是其他数据库在同一隔离级别下不一定能提供的。

- SQL Server 提供的快照隔离可以是一个在高并发场景下减少锁竞争的好选择。

结论

选择正确的隔离级别需要对业务需求、并发场景、性能影响、以及数据库的特定实现有深入的理解。这通常涉及到对现有系统的分析、测试和调整,以确保在数据一致性和系统性能之间找到最佳平衡点。

数据库使用的不同类型的锁以及它们如何影响事务的隔离性和并发性

数据库管理系统中使用锁是为了管理对共享资源,如数据行、页或整个表的访问,保障数据的完整性和一致性。锁机制可以帮助解决并发访问时可能出现的问题,如数据冲突和并发异常。主要有两种基本类型的锁:共享锁(Shared Lock)和排他锁(Exclusive Lock),以及一些特殊类型的锁,如意向锁、更新锁等。我们先看基本锁的定义和它们对事务隔离性与并发性的影响。

共享锁(Shared Lock)

- 定义:共享锁允许一个事务读取一份数据,而在持有共享锁时,其他事务也可以申请并获得同一数据的共享锁,从而允许多个事务同时读取同一份数据。

- 用途:主要用于实现事务在执行读操作时的数据一致性,确保读取操作在执行期间数据不会被修改。

- 影响:虽然共享锁支持多个事务同时读取数据,增强了并发性,但它限制了数据的修改。只要共享锁存在,任何需要修改数据的事务都必须等待直到所有共享锁释放。

排他锁(Exclusive Lock)

- 定义:排他锁保证事务独占某项数据。当事务对数据加上排他锁后,其他任何事务都无法对该数据加任何类型的锁(共享锁和排他锁都不行)。

- 用途:用于执行写操作,如更新、删除或插入数据,保证在锁持有期间没有其他事务可以读取或修改这些数据。

- 影响:排他锁显著降低了并发性,因为它阻止了任何其他事务对被锁定数据的访问,直到锁被释放。

其他类型的锁

- 意向锁(Intention Locks):这是一种表级锁,用来表明某个事务打算在表中的单个行上加锁。这种锁的主要目的是优化锁定性能,避免在每次行级锁申请时都检查整个表。

- 更新锁(Update Locks):这种锁通常用在更新操作前的查询阶段,防止死锁。更新锁可以被多个事务持有,但如果事务要修改数据,则更新锁会转换为排他锁。

锁的影响分析

- 事务隔离性:使用锁可以帮助实现不同隔离级别的要求。例如,通过共享锁和排他锁的组合使用,数据库可以管理不可重复读或幻读的问题。较高的隔离级别通常需要更严格的锁策略,可能会使用更多的排他锁。

- 并发性:锁的使用虽然可以提高数据的安全性和事务的隔离性,但过多地使用排他锁会显著降低系统的并发能力,因为它们限制了同时访问同一数据的事务数量。理想的锁策略应该是一个平衡点,能够在保证数据一致性的同时,尽可能提高并发性。

在数据库设计和事务管理中,正确地选择和使用锁是非常重要的。开发者和数据库管理员需要根据具体的应用场景和数据一致性要求,合理配置锁策略,以达到性能和一致性的最佳平衡。